MeltwaterBench: Deep learning for spatiotemporal downscaling of surface meltwater

作者: Björn Lütjens, Patrick Alexander, Raf Antwerpen, Til Widmann, Guido Cervone, Marco Tedesco

分类: cs.CV, cs.AI, cs.LG, physics.ao-ph, physics.data-an

发布日期: 2025-12-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出MeltwaterBench,利用深度学习进行冰川表面融水时空降尺度研究

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 冰川融水 时空降尺度 深度学习 多源数据融合 遥感 UNet DeepLabv3+ MeltwaterBench

📋 核心要点

- 现有融水地图在时间和空间分辨率上存在权衡,难以同时获得高时空分辨率的融水分布。

- 提出一种基于深度学习的方法,融合遥感观测和物理模型数据,实现融水地图的时空降尺度。

- 实验结果表明,该方法在准确率上优于传统方法,并发布了MeltwaterBench数据集作为基准。

📝 摘要(中文)

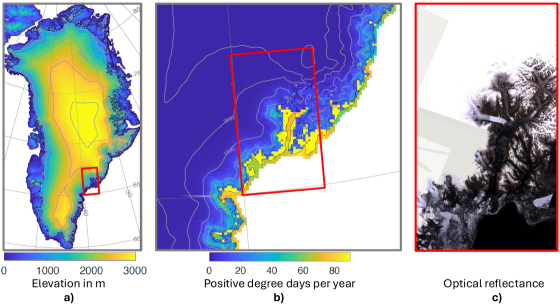

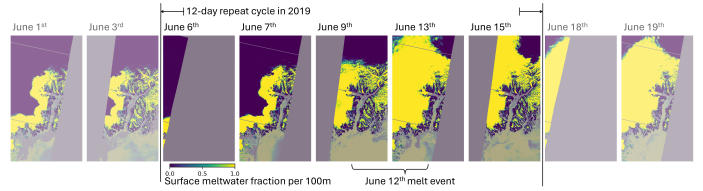

由于一些尚未完全理解且难以测量的过程,格陵兰冰盖正以加速的速度融化。地表融水的分布有助于理解这些过程,并且可以通过遥感观测。然而,目前融水地图面临一个权衡:它们在时间或空间上具有高分辨率,但不能同时兼顾。我们开发了一个深度学习模型,通过融合来自遥感观测和物理模型的多个数据流,创建每日100米分辨率的网格化地表融水地图。特别地,我们使用合成孔径雷达(SAR)、被动微波(PMW)和一个数字高程模型(DEM),对2017-2023年格陵兰东部Helheim冰川上的区域气候模型(RCM)输出进行时空降尺度。使用SAR衍生的融水作为“ground truth”,我们表明,基于深度学习并融合所有数据流的方法,比仅依赖于区域气候模型(83% vs. 95% 准确率)或被动微波观测(72% vs. 95% 准确率)的现有非深度学习方法,在我们的研究区域上准确率高出10个百分点以上。另外,通过SAR数据进行滑动窗口计算来创建网格化产品会低估极端融化事件,但也实现了显著的准确率(90%),并且不依赖于深度学习。我们评估了标准深度学习方法(UNet和DeepLabv3+),并将我们的时空对齐数据集发布为一个基准,MeltwaterBench,用于与更复杂的数据驱动降尺度方法进行比较。代码和数据可在github.com/blutjens/hrmelt获取。

🔬 方法详解

问题定义:论文旨在解决格陵兰冰盖融水分布的时空分辨率不足问题。现有的融水地图要么时间分辨率高但空间分辨率低,要么空间分辨率高但时间分辨率低,无法满足对冰川融化过程进行精细研究的需求。传统方法依赖于区域气候模型或被动微波观测,精度有限。

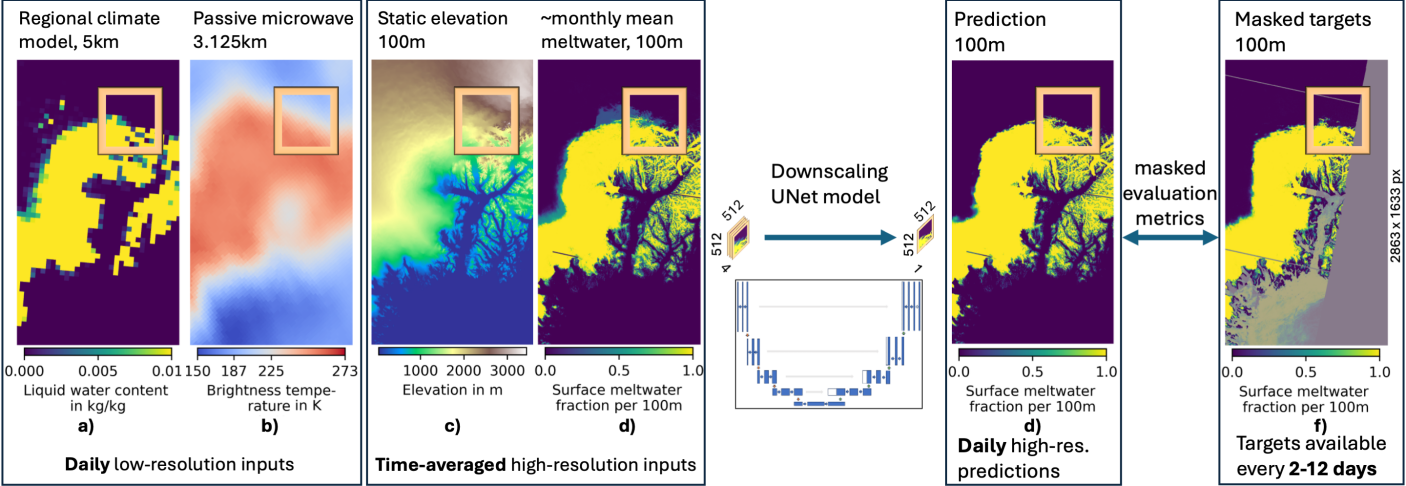

核心思路:论文的核心思路是利用深度学习模型,融合来自不同来源的数据(包括区域气候模型、合成孔径雷达、被动微波和数字高程模型),进行时空降尺度。通过深度学习模型学习不同数据源之间的复杂关系,从而生成高时空分辨率的融水地图。

技术框架:整体框架包括数据预处理、模型训练和结果评估三个主要阶段。首先,对来自不同来源的数据进行预处理,包括时空对齐和标准化。然后,使用预处理后的数据训练深度学习模型,模型采用UNet和DeepLabv3+等经典架构。最后,使用SAR衍生的融水作为ground truth,评估模型的性能。

关键创新:论文的关键创新在于提出了一种基于深度学习的多源数据融合方法,用于冰川融水时空降尺度。与传统方法相比,该方法能够更有效地利用不同数据源的信息,从而提高融水地图的精度。此外,论文还发布了MeltwaterBench数据集,为该领域的研究提供了一个新的基准。

关键设计:论文评估了UNet和DeepLabv3+两种深度学习架构。损失函数方面,具体使用的损失函数细节未知。数据集方面,论文构建了包含SAR、PMW、DEM和RCM输出的时空对齐数据集。参数设置和网络结构等更详细的技术细节在论文中未明确说明。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于深度学习的多源数据融合方法在融水地图的准确率上显著优于传统方法。与仅依赖区域气候模型的方法相比,准确率提高了12个百分点(83% vs. 95%)。与仅依赖被动微波观测的方法相比,准确率提高了23个百分点(72% vs. 95%)。

🎯 应用场景

该研究成果可应用于冰川融化过程的精细研究、气候变化评估、海平面上升预测以及水资源管理等领域。高分辨率的融水地图能够帮助科学家更好地理解冰川的动态变化,从而更准确地预测未来的冰川融化趋势,为应对气候变化提供科学依据。

📄 摘要(原文)

The Greenland ice sheet is melting at an accelerated rate due to processes that are not fully understood and hard to measure. The distribution of surface meltwater can help understand these processes and is observable through remote sensing, but current maps of meltwater face a trade-off: They are either high-resolution in time or space, but not both. We develop a deep learning model that creates gridded surface meltwater maps at daily 100m resolution by fusing data streams from remote sensing observations and physics-based models. In particular, we spatiotemporally downscale regional climate model (RCM) outputs using synthetic aperture radar (SAR), passive microwave (PMW), and a digital elevation model (DEM) over the Helheim Glacier in Eastern Greenland from 2017-2023. Using SAR-derived meltwater as "ground truth", we show that a deep learning-based method that fuses all data streams is over 10 percentage points more accurate over our study area than existing non deep learning-based approaches that only rely on a regional climate model (83% vs. 95% Acc.) or passive microwave observations (72% vs. 95% Acc.). Alternatively, creating a gridded product through a running window calculation with SAR data underestimates extreme melt events, but also achieves notable accuracy (90%) and does not rely on deep learning. We evaluate standard deep learning methods (UNet and DeepLabv3+), and publish our spatiotemporally aligned dataset as a benchmark, MeltwaterBench, for intercomparisons with more complex data-driven downscaling methods. The code and data are available at $\href{https://github.com/blutjens/hrmelt}{github.com/blutjens/hrmelt}$.