V-RGBX: Video Editing with Accurate Controls over Intrinsic Properties

作者: Ye Fang, Tong Wu, Valentin Deschaintre, Duygu Ceylan, Iliyan Georgiev, Chun-Hao Paul Huang, Yiwei Hu, Xuelin Chen, Tuanfeng Yang Wang

分类: cs.CV

发布日期: 2025-12-12

备注: Project Page: https://aleafy.github.io/vrgbx

💡 一句话要点

V-RGBX:提出首个内参感知的视频编辑框架,实现精确控制和逼真合成。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱四:生成式动作 (Generative Motion)

关键词: 视频编辑 逆渲染 内参感知 视频合成 关键帧编辑

📋 核心要点

- 现有视频生成模型缺乏对场景内参属性的理解和控制,限制了编辑的精确性和真实感。

- V-RGBX通过逆渲染将视频分解为内参通道,并利用这些通道进行视频合成和编辑,实现物理上合理的控制。

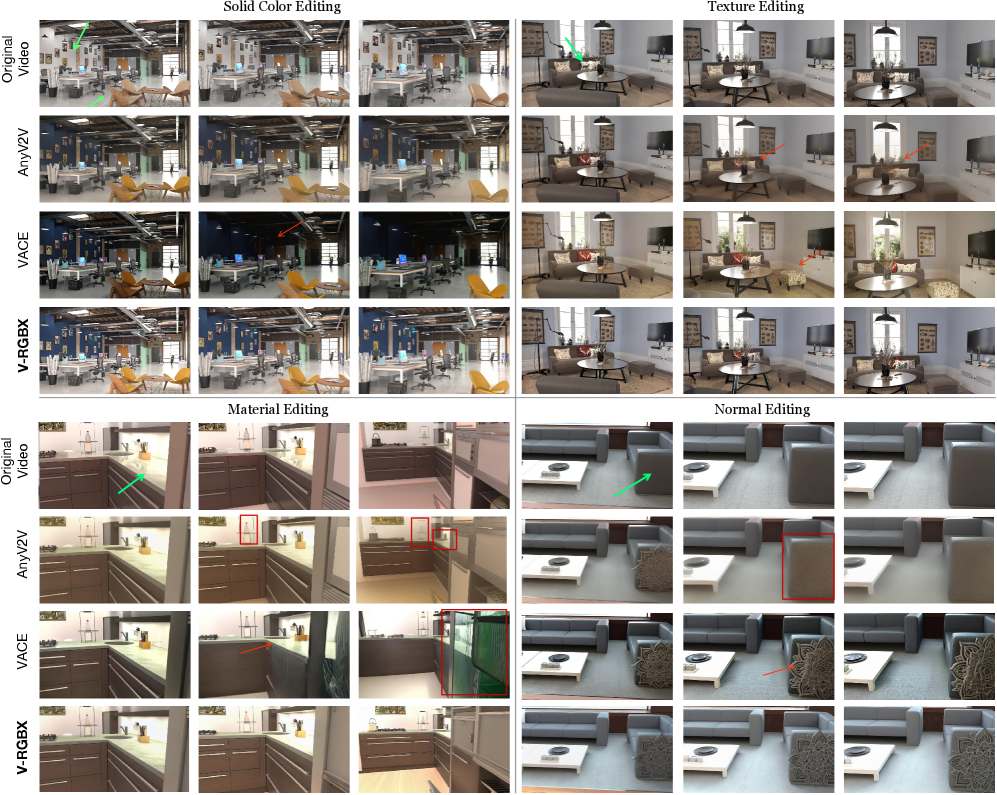

- 实验结果表明,V-RGBX在时间一致性、真实感和编辑效果方面优于现有方法,适用于对象外观编辑和场景重照明等应用。

📝 摘要(中文)

大规模视频生成模型在建模真实场景中的光照交互和逼真外观方面展现了巨大的潜力。然而,一个能够联合理解内参属性(如反照率、法线、材质和辐照度),利用它们进行视频合成,并支持可编辑内参表示的闭环框架仍未被探索。我们提出了V-RGBX,这是第一个用于内参感知视频编辑的端到端框架。V-RGBX统一了三个关键能力:(1)将视频逆渲染为内参通道,(2)从这些内参表示中进行逼真的视频合成,以及(3)基于关键帧的、以内部通道为条件的视频编辑。V-RGBX的核心是一种交错条件机制,通过用户选择的关键帧实现直观、物理上合理的视频编辑,支持对任何内参模态的灵活操作。大量的定性和定量结果表明,V-RGBX能够生成时间上一致、逼真的视频,同时以物理上合理的方式在序列中传播关键帧编辑。我们展示了其在各种应用中的有效性,包括对象外观编辑和场景级重新照明,超越了现有方法的性能。

🔬 方法详解

问题定义:现有视频编辑方法通常直接操作像素空间,缺乏对场景内在属性(如光照、材质、几何)的理解,导致编辑结果不真实,难以控制。例如,改变物体颜色可能导致光照不一致,或者改变光照影响到所有物体,缺乏局部控制能力。因此,需要一种能够理解和控制视频内参属性的编辑框架。

核心思路:V-RGBX的核心思路是将视频分解为内参表示(反照率、法线、材质、辐照度等),然后在这些内参空间进行编辑,最后再将编辑后的内参重新合成为视频。这种方法能够实现对场景属性的精确控制,并保证编辑结果在物理上是合理的。通过关键帧编辑,用户可以直观地修改内参属性,系统自动将修改传播到整个视频序列。

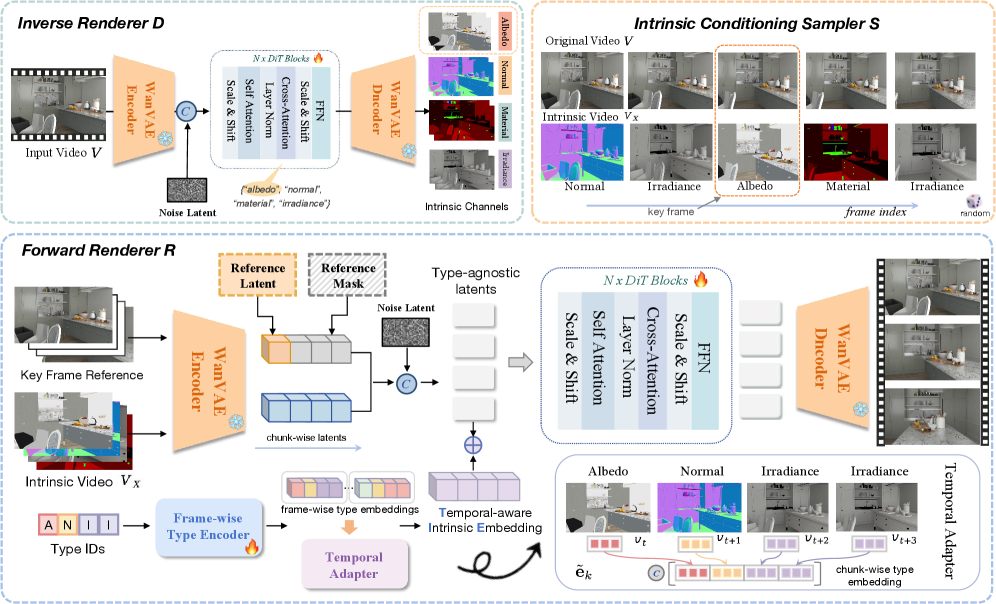

技术框架:V-RGBX包含三个主要模块:视频逆渲染模块、视频合成模块和关键帧编辑模块。视频逆渲染模块将输入视频分解为内参通道。视频合成模块从内参表示重建视频。关键帧编辑模块允许用户在选定的关键帧上编辑内参通道,编辑结果通过交错条件机制传播到整个视频序列。整个框架是端到端可训练的。

关键创新:V-RGBX的关键创新在于其内参感知的视频编辑框架和交错条件机制。内参感知使得编辑更加精确和可控,交错条件机制保证了编辑结果在时间上的一致性和物理上的合理性。这是首个能够实现对视频内参属性进行精确编辑的端到端框架。

关键设计:V-RGBX使用了基于神经网络的逆渲染和合成模块,具体网络结构未知。损失函数可能包含重建损失、时间一致性损失和物理合理性损失。交错条件机制的具体实现方式未知,可能涉及注意力机制或循环神经网络。

🖼️ 关键图片

📊 实验亮点

论文通过大量的定性和定量实验验证了V-RGBX的有效性。实验结果表明,V-RGBX在对象外观编辑和场景重照明等任务上优于现有方法。具体的性能数据和提升幅度未知,但论文强调了V-RGBX在时间一致性和物理合理性方面的优势。

🎯 应用场景

V-RGBX可应用于电影制作、游戏开发、虚拟现实等领域。例如,可以用于快速修改场景的光照条件,改变物体的材质和外观,或者创建具有特定风格的视频内容。该技术还可以用于修复老旧视频,提升视频质量,以及进行视频风格迁移等任务。未来,V-RGBX有望成为视频编辑领域的重要工具。

📄 摘要(原文)

Large-scale video generation models have shown remarkable potential in modeling photorealistic appearance and lighting interactions in real-world scenes. However, a closed-loop framework that jointly understands intrinsic scene properties (e.g., albedo, normal, material, and irradiance), leverages them for video synthesis, and supports editable intrinsic representations remains unexplored. We present V-RGBX, the first end-to-end framework for intrinsic-aware video editing. V-RGBX unifies three key capabilities: (1) video inverse rendering into intrinsic channels, (2) photorealistic video synthesis from these intrinsic representations, and (3) keyframe-based video editing conditioned on intrinsic channels. At the core of V-RGBX is an interleaved conditioning mechanism that enables intuitive, physically grounded video editing through user-selected keyframes, supporting flexible manipulation of any intrinsic modality. Extensive qualitative and quantitative results show that V-RGBX produces temporally consistent, photorealistic videos while propagating keyframe edits across sequences in a physically plausible manner. We demonstrate its effectiveness in diverse applications, including object appearance editing and scene-level relighting, surpassing the performance of prior methods.