Vision-Language Models for Infrared Industrial Sensing in Additive Manufacturing Scene Description

作者: Nazanin Mahjourian, Vinh Nguyen

分类: cs.CV, cs.RO

发布日期: 2025-12-11

💡 一句话要点

VLM-IRIS:面向增材制造红外工业感知的视觉-语言模型零样本框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 红外图像处理 视觉-语言模型 零样本学习 增材制造 工业感知

📋 核心要点

- 传统视觉系统在低光照或封闭的制造环境中表现不佳,红外相机提供了互补优势,但缺乏大规模标注数据。

- VLM-IRIS框架通过将红外图像预处理为RGB兼容格式,使现有的视觉-语言模型能够直接应用于红外数据,实现零样本学习。

- 实验表明,VLM-IRIS在3D打印机床上实现了高精度的工件存在检测,证明了其在热成像应用中的有效性。

📝 摘要(中文)

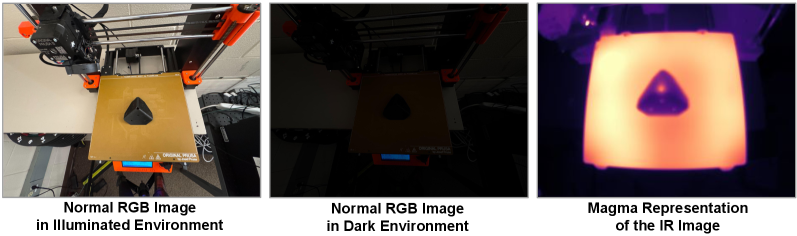

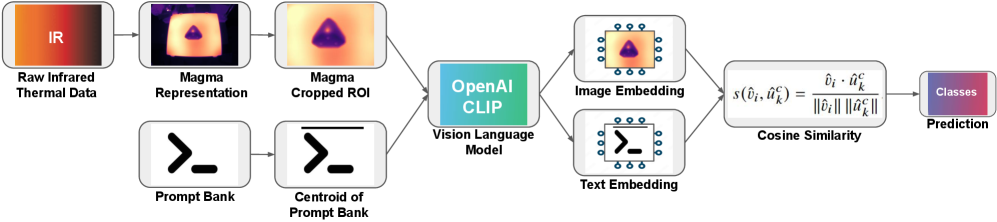

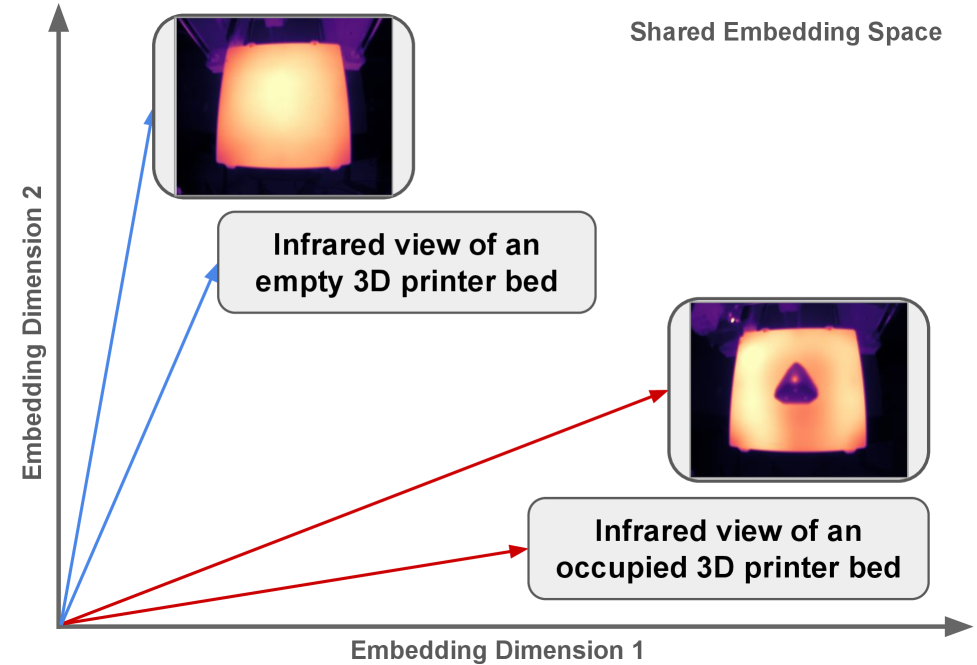

本文提出了一种名为VLM-IRIS(Vision-Language Models for InfraRed Industrial Sensing)的零样本框架,旨在将视觉-语言模型(VLMs)应用于红外数据。由于现有VLMs基于RGB数据训练,无法直接理解红外图像。VLM-IRIS通过预处理红外图像,将其转换为RGB兼容的输入,使其能够被基于CLIP的编码器处理。具体而言,使用FLIR Boson传感器捕获红外图像,并将其转换为magma表示。随后,采用centroid prompt ensembling和CLIP ViT-B/32编码器,实现了在3D打印机床上进行工件存在检测的零样本预测,无需任何模型再训练。实验结果表明,该方法能够有效扩展VLMs到热成像应用,实现无标签监控。

🔬 方法详解

问题定义:现有视觉-语言模型(VLMs)主要基于RGB图像进行训练,无法直接应用于红外图像。在增材制造等工业场景中,红外相机常用于低光照或封闭环境下的目标检测和监控,但缺乏大规模标注的红外图像数据集,限制了有监督学习方法的应用。因此,如何利用现有的VLMs实现红外图像的零样本学习是一个关键问题。

核心思路:VLM-IRIS的核心思路是将红外图像转换为VLMs能够理解的RGB兼容格式,从而利用VLMs强大的零样本学习能力。通过图像预处理,将红外图像的温度信息编码到RGB通道中,使得VLMs能够提取红外图像的特征。同时,采用centroid prompt ensembling技术,提高模型的鲁棒性和准确性。

技术框架:VLM-IRIS框架主要包含以下几个阶段:1) 红外图像采集:使用FLIR Boson传感器采集红外图像。2) 图像预处理:将红外图像转换为magma表示,即将温度值映射到RGB颜色空间。3) 特征提取:使用CLIP ViT-B/32编码器提取图像特征。4) 文本编码:使用CLIP的文本编码器对文本提示进行编码。5) 零样本预测:计算图像特征和文本特征之间的相似度,选择相似度最高的文本作为预测结果。centroid prompt ensembling用于提升预测的稳定性。

关键创新:VLM-IRIS的关键创新在于将红外图像转换为RGB兼容格式,从而使得现有的VLMs能够直接应用于红外图像的零样本学习。此外,centroid prompt ensembling技术进一步提高了模型的鲁棒性和准确性。该方法无需对VLMs进行任何再训练,即可实现红外图像的有效识别。

关键设计:红外图像到RGB的转换采用magma颜色映射,将温度值线性映射到RGB颜色空间。centroid prompt ensembling通过选择多个具有代表性的文本提示,并计算它们与图像特征的相似度,从而提高预测的准确性。CLIP ViT-B/32作为特征提取器,其预训练的知识能够有效提取图像的语义信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VLM-IRIS在3D打印机床上实现了高精度的工件存在检测,无需任何模型再训练。通过将红外图像转换为magma表示,并结合centroid prompt ensembling和CLIP ViT-B/32编码器,该方法能够有效利用现有的视觉-语言模型进行红外图像的零样本学习,为红外图像处理提供了一种新的思路。

🎯 应用场景

VLM-IRIS可广泛应用于增材制造、工业自动化、安防监控等领域。例如,在3D打印过程中,可以利用VLM-IRIS实时监控工件是否存在、温度是否异常等,从而提高生产效率和产品质量。此外,在低光照或恶劣环境下,VLM-IRIS可以用于目标检测、人员识别等任务,具有重要的实际应用价值和未来发展潜力。

📄 摘要(原文)

Many manufacturing environments operate in low-light conditions or within enclosed machines where conventional vision systems struggle. Infrared cameras provide complementary advantages in such environments. Simultaneously, supervised AI systems require large labeled datasets, which makes zero-shot learning frameworks more practical for applications including infrared cameras. Recent advances in vision-language foundation models (VLMs) offer a new path in zero-shot predictions from paired image-text representations. However, current VLMs cannot understand infrared camera data since they are trained on RGB data. This work introduces VLM-IRIS (Vision-Language Models for InfraRed Industrial Sensing), a zero-shot framework that adapts VLMs to infrared data by preprocessing infrared images captured by a FLIR Boson sensor into RGB-compatible inputs suitable for CLIP-based encoders. We demonstrate zero-shot workpiece presence detection on a 3D printer bed where temperature differences between the build plate and workpieces make the task well-suited for thermal imaging. VLM-IRIS converts the infrared images to magma representation and applies centroid prompt ensembling with a CLIP ViT-B/32 encoder to achieve high accuracy on infrared images without any model retraining. These findings demonstrate that the proposed improvements to VLMs can be effectively extended to thermal applications for label-free monitoring.