VDAWorld: World Modelling via VLM-Directed Abstraction and Simulation

作者: Felix O'Mahony, Roberto Cipolla, Ayush Tewari

分类: cs.CV

发布日期: 2025-12-11

备注: Website: https://felixomahony.github.io/vdaworld/

💡 一句话要点

VDAWorld:提出基于VLM引导的抽象与仿真世界建模框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 世界建模 视觉-语言模型 物理仿真 场景抽象 动态预测

📋 核心要点

- 现有生成视频模型在世界建模中存在物理逻辑违背、缺乏交互性等问题,难以构建结构化世界。

- VDAWorld利用视觉-语言模型(VLM)将图像-文本对抽象为可仿真的表示,并自适应选择物理模拟器。

- 实验表明,VDAWorld通过智能抽象和自适应模拟,在各种动态场景中实现了高质量的仿真效果。

📝 摘要(中文)

生成式视频模型是世界建模的一种主要方法,但面临着物理和逻辑规则违背、缺乏交互性以及作为不透明黑盒难以构建结构化、可查询世界等根本性限制。为了克服这些挑战,我们提出了一种新的范式,专注于将图像-文本对提炼成易于处理的、为仿真优化的抽象表示。我们介绍了VDAWorld,一个视觉-语言模型(VLM)作为智能体来协调这一过程的框架。VLM通过选择一套视觉工具自主构建一个接地的(2D或3D)场景表示,并相应地选择一个兼容的物理模拟器(例如,刚体、流体)来对其进行操作。然后,VDAWorld可以从静态场景推断潜在的动态,以预测合理的未来状态。我们的实验表明,这种智能抽象和自适应模拟的结合产生了一个通用的世界模型,能够跨越各种动态场景产生高质量的模拟。

🔬 方法详解

问题定义:现有生成式视频模型在世界建模中存在诸多问题。它们常常违反基本的物理和逻辑规则,例如物体穿透、不合理的运动等。此外,这些模型通常缺乏交互性,用户难以对场景进行编辑和控制。更重要的是,这些模型通常是黑盒模型,难以理解其内部的推理过程,也无法构建可查询的结构化世界表示。

核心思路:VDAWorld的核心思路是将图像和文本信息提炼成一个抽象的、易于仿真的场景表示。通过这种抽象,模型可以更好地理解场景的结构和关系,并利用物理模拟器来预测未来的状态。这种方法避免了直接生成视频的复杂性,而是通过模拟的方式来生成动态场景。

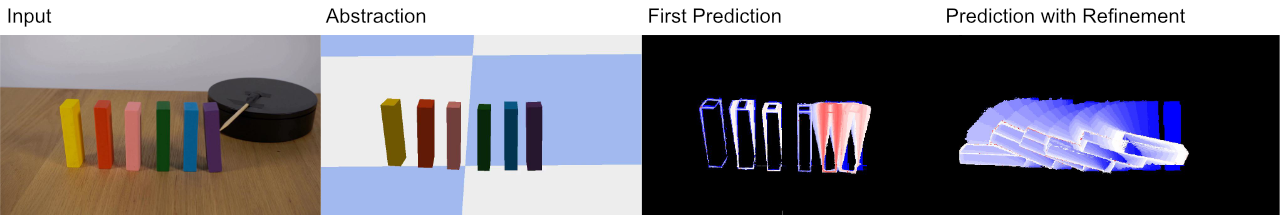

技术框架:VDAWorld框架包含以下几个主要模块:1) VLM驱动的场景抽象:利用VLM将图像-文本对转化为场景的抽象表示,包括物体的位置、形状、材质等信息。2) 物理模拟器选择:根据场景的特性,自动选择合适的物理模拟器,例如刚体模拟器、流体模拟器等。3) 动态预测:利用物理模拟器对场景进行模拟,预测未来的状态。整个流程由VLM作为智能体进行协调,自主选择视觉工具和物理模拟器。

关键创新:VDAWorld的关键创新在于利用VLM来驱动场景的抽象和仿真过程。传统的生成式视频模型通常是端到端的,难以控制和解释。而VDAWorld通过VLM将场景理解和物理模拟解耦,使得模型更加灵活和可控。此外,VDAWorld还能够根据场景的特性自适应地选择合适的物理模拟器,从而提高仿真的质量。

关键设计:VDAWorld使用预训练的视觉-语言模型(VLM)作为核心组件,用于理解图像和文本信息,并生成场景的抽象表示。具体来说,VLM需要能够识别场景中的物体,并估计它们的位置、形状和材质等属性。此外,VDAWorld还设计了一套视觉工具,用于辅助VLM进行场景理解,例如物体检测器、深度估计器等。在物理模拟方面,VDAWorld支持多种物理模拟器,例如刚体模拟器、流体模拟器等。模型会根据场景的特性自动选择合适的模拟器。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VDAWorld在各种动态场景中都能够产生高质量的仿真效果。与传统的生成式视频模型相比,VDAWorld能够更好地捕捉场景的物理和逻辑关系,生成更加逼真的视频。此外,VDAWorld还具有更好的可控性和可解释性,用户可以方便地对场景进行编辑和控制。具体性能数据未知,但论文强调了其在多种场景下的通用性和高质量仿真能力。

🎯 应用场景

VDAWorld具有广泛的应用前景,例如机器人导航、游戏开发、虚拟现实等。在机器人导航领域,VDAWorld可以用于生成逼真的环境,帮助机器人学习如何在复杂的环境中进行导航。在游戏开发领域,VDAWorld可以用于快速生成各种动态场景,提高游戏开发的效率。在虚拟现实领域,VDAWorld可以用于创建更加逼真的虚拟世界,提高用户的沉浸感。

📄 摘要(原文)

Generative video models, a leading approach to world modeling, face fundamental limitations. They often violate physical and logical rules, lack interactivity, and operate as opaque black boxes ill-suited for building structured, queryable worlds. To overcome these challenges, we propose a new paradigm focused on distilling an image caption pair into a tractable, abstract representation optimized for simulation. We introduce VDAWorld, a framework where a Vision-Language Model (VLM) acts as an intelligent agent to orchestrate this process. The VLM autonomously constructs a grounded (2D or 3D) scene representation by selecting from a suite of vision tools, and accordingly chooses a compatible physics simulator (e.g., rigid body, fluid) to act upon it. VDAWorld can then infer latent dynamics from the static scene to predict plausible future states. Our experiments show that this combination of intelligent abstraction and adaptive simulation results in a versatile world model capable of producing high quality simulations across a wide range of dynamic scenarios.