Empowering Dynamic Urban Navigation with Stereo and Mid-Level Vision

作者: Wentao Zhou, Xuweiyi Chen, Vignesh Rajagopal, Jeffrey Chen, Rohan Chandra, Zezhou Cheng

分类: cs.CV

发布日期: 2025-12-11

备注: Project Page: https://www.cs.virginia.edu/~tsx4zn/stereowalk/

💡 一句话要点

StereoWalker:融合双目视觉与中层视觉,提升动态城市导航性能

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人导航 双目视觉 中层视觉 深度估计 像素跟踪 端到端学习 动态环境

📋 核心要点

- 现有端到端机器人导航模型依赖大量像素到动作的监督,难以在动态环境中实现稳健导航,尤其是在单目视觉下存在深度尺度模糊。

- StereoWalker通过引入双目视觉和显式中层视觉(深度估计、像素跟踪)来增强导航模型,利用双目视觉解决深度尺度模糊问题。

- 实验表明,StereoWalker仅用1.5%的训练数据即可达到现有技术水平,使用完整数据时超越现有技术,验证了中层视觉的有效性。

📝 摘要(中文)

语言和视觉领域的基础模型激发了对端到端机器人导航基础模型(NFMs)的研究。NFMs直接将单目视觉输入映射到控制动作,完全忽略了中层视觉模块(跟踪、深度估计等)。虽然视觉能力将隐式出现的假设很有吸引力,但它需要大量的像素到动作的监督,而这些监督很难获得。在动态和非结构化环境中,这一挑战尤其突出,因为稳健的导航需要精确的几何和动态理解,而单目视图中的深度尺度模糊进一步限制了精确的空间推理。本文表明,依赖单目视觉并忽略中层视觉先验是低效的。我们提出了StereoWalker,它利用双目输入和显式中层视觉(如深度估计和密集像素跟踪)来增强NFMs。我们的直觉很简单:双目输入解决了深度尺度模糊问题,而现代中层视觉模型提供了动态场景中可靠的几何和运动结构。我们还策划了一个大型双目导航数据集,其中包含来自互联网双目视频的自动动作注释,以支持StereoWalker的训练并促进未来的研究。通过我们的实验,我们发现中层视觉使StereoWalker能够以仅1.5%的训练数据达到与最先进技术相当的性能,并使用完整数据超越最先进技术。我们还观察到,双目视觉比单目输入产生更高的导航性能。

🔬 方法详解

问题定义:现有基于单目视觉的端到端机器人导航模型,在动态和非结构化环境中,由于深度尺度模糊和缺乏几何信息,难以实现稳健和精确的导航。这些模型需要大量的像素到动作的监督数据,训练成本高昂。

核心思路:论文的核心思路是利用双目视觉提供准确的深度信息,并结合中层视觉模块(深度估计和密集像素跟踪)来增强导航模型的几何和运动感知能力。通过显式地利用这些信息,可以减少对大量训练数据的依赖,并提高在动态环境中的导航性能。

技术框架:StereoWalker的整体框架包括以下几个主要模块:1) 双目视觉输入:使用双目相机获取左右图像。2) 中层视觉模块:包括深度估计模块,用于从双目图像中估计深度图;以及密集像素跟踪模块,用于跟踪场景中的运动物体。3) 导航模型:一个端到端的神经网络,将双目图像、深度图和像素跟踪信息作为输入,输出控制动作。

关键创新:该论文的关键创新在于将双目视觉和中层视觉显式地集成到端到端导航模型中。与以往依赖单目视觉和隐式学习几何信息的模型不同,StereoWalker直接利用深度信息和运动信息,从而提高了导航的准确性和鲁棒性。此外,论文还提出了一个用于训练StereoWalker的大型双目导航数据集。

关键设计:论文的关键设计包括:1) 使用现有的深度估计和像素跟踪模型作为中层视觉模块。2) 设计合适的网络结构,将双目图像、深度图和像素跟踪信息融合在一起。3) 使用自动动作标注方法,从互联网双目视频中生成训练数据。4) 损失函数的设计需要考虑导航任务的特点,例如,可以使用模仿学习损失来学习人类驾驶员的行为。

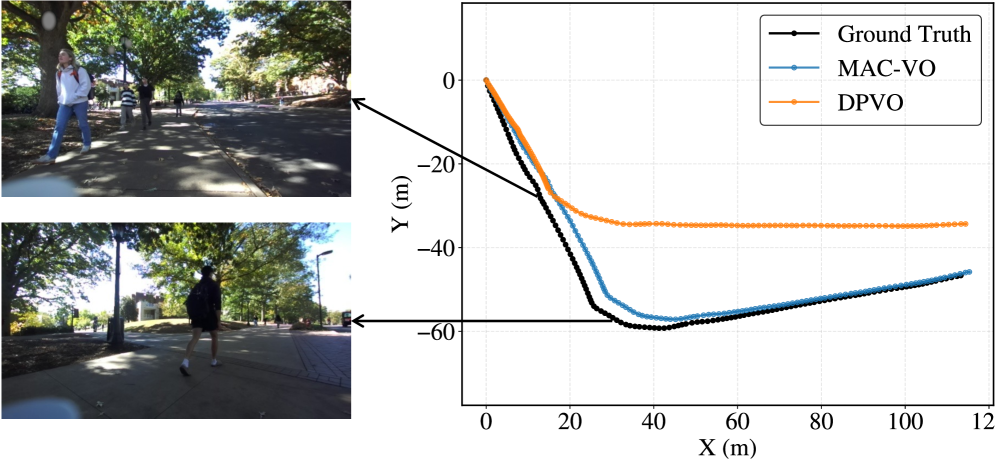

🖼️ 关键图片

📊 实验亮点

StereoWalker在导航任务中表现出色,仅使用1.5%的训练数据即可达到与最先进技术相当的性能。使用完整数据集后,StereoWalker的性能超越了现有技术。实验还表明,双目视觉输入显著优于单目视觉输入,验证了双目视觉和中层视觉对于提高导航性能的有效性。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、无人机等领域,尤其是在城市等复杂动态环境中。通过提高导航的准确性和鲁棒性,可以减少事故风险,提高效率,并为更广泛的机器人应用提供技术支持。未来,该方法可以扩展到其他传感器模态,例如激光雷达和毫米波雷达,以进一步提高导航性能。

📄 摘要(原文)

The success of foundation models in language and vision motivated research in fully end-to-end robot navigation foundation models (NFMs). NFMs directly map monocular visual input to control actions and ignore mid-level vision modules (tracking, depth estimation, etc) entirely. While the assumption that vision capabilities will emerge implicitly is compelling, it requires large amounts of pixel-to-action supervision that are difficult to obtain. The challenge is especially pronounced in dynamic and unstructured settings, where robust navigation requires precise geometric and dynamic understanding, while the depth-scale ambiguity in monocular views further limits accurate spatial reasoning. In this paper, we show that relying on monocular vision and ignoring mid-level vision priors is inefficient. We present StereoWalker, which augments NFMs with stereo inputs and explicit mid-level vision such as depth estimation and dense pixel tracking. Our intuition is straightforward: stereo inputs resolve the depth-scale ambiguity, and modern mid-level vision models provide reliable geometric and motion structure in dynamic scenes. We also curate a large stereo navigation dataset with automatic action annotation from Internet stereo videos to support training of StereoWalker and to facilitate future research. Through our experiments, we find that mid-level vision enables StereoWalker to achieve a comparable performance as the state-of-the-art using only 1.5% of the training data, and surpasses the state-of-the-art using the full data. We also observe that stereo vision yields higher navigation performance than monocular input.