GaussianHeadTalk: Wobble-Free 3D Talking Heads with Audio Driven Gaussian Splatting

作者: Madhav Agarwal, Mingtian Zhang, Laura Sevilla-Lara, Steven McDonagh

分类: cs.CV

发布日期: 2025-12-11

备注: IEEE/CVF Winter Conference on Applications of Computer Vision 2026

💡 一句话要点

提出GaussianHeadTalk,利用音频驱动的高斯溅射生成无抖动3D说话头

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 说话头生成 高斯溅射 3D形变模型 音频驱动 Transformer 实时渲染 人机交互

📋 核心要点

- 现有语音驱动的说话头方法在视觉逼真度和时间稳定性之间存在trade-off,难以兼顾实时性和高质量。

- GaussianHeadTalk利用3D形变模型映射高斯溅射,并使用Transformer从音频预测模型参数,以保证时间一致性。

- 该方法仅需单目视频和音频输入,即可生成实时且视觉效果好的说话头视频,并在定量和定性指标上表现出色。

📝 摘要(中文)

语音驱动的说话头技术近年来兴起,实现了交互式化身。然而,现有方法虽然视觉逼真度高,但速度慢,或者速度快但时间稳定性差,限制了其在现实世界的应用。扩散模型虽然能生成逼真的图像,但在单样本设置中表现不佳。高斯溅射方法是实时的,但面部跟踪不准确或高斯映射不一致会导致输出不稳定和视频伪影,这不利于实际应用。本文通过使用3D形变模型映射高斯溅射来生成特定人物的化身,从而解决了这个问题。我们引入了基于Transformer的模型参数预测,直接从音频驱动时间一致性。从单目视频和独立的音频语音输入,我们的方法能够生成实时的说话头视频,并报告了具有竞争力的定量和定性性能。

🔬 方法详解

问题定义:现有语音驱动的说话头方法,要么基于扩散模型,生成质量高但速度慢,不适合实时应用;要么基于高斯溅射,速度快但容易出现抖动和伪影,影响视觉体验。核心痛点在于如何在保证实时性的同时,提升说话头视频的时间稳定性和视觉质量。

核心思路:本文的核心思路是将高斯溅射与3D形变模型(3DMM)相结合。3DMM提供了一个参数化的面部模型,可以约束高斯溅射的形变,从而提高时间一致性。同时,使用Transformer网络直接从音频预测3DMM参数,避免了传统方法中复杂的中间步骤,提高了效率。

技术框架:GaussianHeadTalk的整体框架包括以下几个主要模块:1) 3DMM参数预测模块:使用Transformer网络从音频特征中预测3DMM参数,包括形状、表情和头部姿态。2) 高斯溅射生成模块:根据预测的3DMM参数,对高斯溅射进行形变和渲染,生成说话头视频。3) 优化模块:通过优化高斯溅射的参数,进一步提高视频质量和时间一致性。

关键创新:最重要的技术创新点在于将3DMM作为先验知识引入到高斯溅射中,从而约束了高斯溅射的形变空间,避免了不自然的抖动和伪影。此外,直接从音频预测3DMM参数也简化了流程,提高了效率。

关键设计:在3DMM参数预测模块中,使用了Transformer网络,并采用了多层感知机(MLP)作为解码器,将音频特征映射到3DMM参数。损失函数包括3DMM参数的重建损失、音频-视觉同步损失和时间一致性损失。时间一致性损失用于惩罚相邻帧之间3DMM参数的突变,从而保证视频的平滑性。

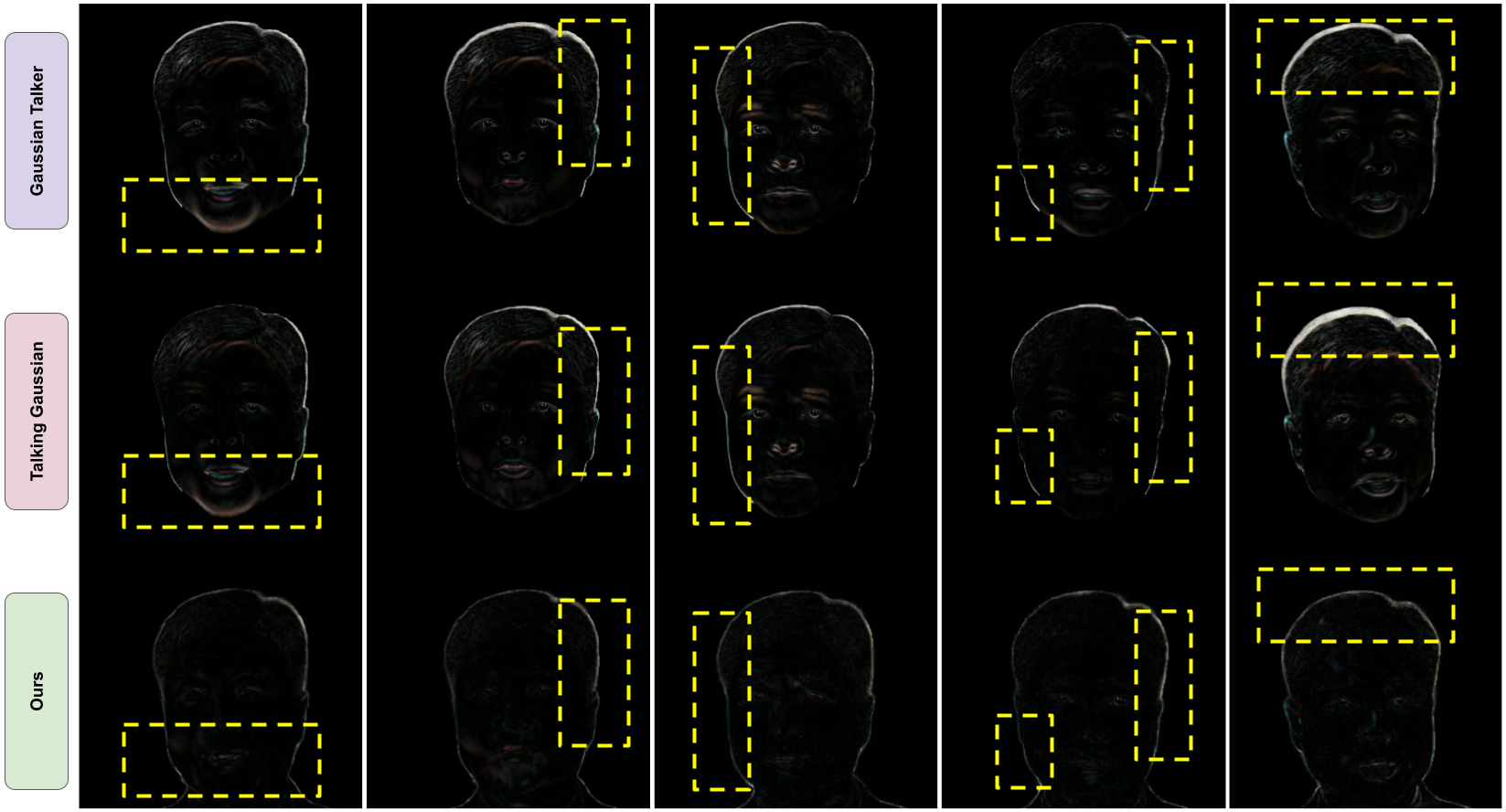

🖼️ 关键图片

📊 实验亮点

实验结果表明,GaussianHeadTalk在时间稳定性和视觉质量方面均优于现有方法。定量指标方面,该方法在LPIPS和DISTS等指标上取得了显著提升。定性方面,生成的说话头视频更加平滑自然,避免了明显的抖动和伪影。与基线方法相比,GaussianHeadTalk在保持实时性的同时,显著提高了视觉效果。

🎯 应用场景

该技术可应用于虚拟主播、在线会议、游戏角色定制、个性化教育等领域。通过输入用户的语音,即可生成逼真的3D说话头,实现更自然、更具表现力的人机交互。未来,该技术有望进一步扩展到移动端应用,为用户提供更加便捷的虚拟化身服务。

📄 摘要(原文)

Speech-driven talking heads have recently emerged and enable interactive avatars. However, real-world applications are limited, as current methods achieve high visual fidelity but slow or fast yet temporally unstable. Diffusion methods provide realistic image generation, yet struggle with oneshot settings. Gaussian Splatting approaches are real-time, yet inaccuracies in facial tracking, or inconsistent Gaussian mappings, lead to unstable outputs and video artifacts that are detrimental to realistic use cases. We address this problem by mapping Gaussian Splatting using 3D Morphable Models to generate person-specific avatars. We introduce transformer-based prediction of model parameters, directly from audio, to drive temporal consistency. From monocular video and independent audio speech inputs, our method enables generation of real-time talking head videos where we report competitive quantitative and qualitative performance.