BabyVLM-V2: Toward Developmentally Grounded Pretraining and Benchmarking of Vision Foundation Models

作者: Shengao Wang, Wenqi Wang, Zecheng Wang, Max Whitton, Michael Wakeham, Arjun Chandra, Joey Huang, Pengyue Zhu, Helen Chen, David Li, Jeffrey Li, Shawn Li, Andrew Zagula, Amy Zhao, Andrew Zhu, Sayaka Nakamura, Yuki Yamamoto, Jerry Jun Yokono, Aaron Mueller, Bryan A. Plummer, Kate Saenko, Venkatesh Saligrama, Boqing Gong

分类: cs.CV, cs.AI

发布日期: 2025-12-11

💡 一句话要点

BabyVLM-V2:面向发育导向的视觉基础模型预训练与评测框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉基础模型 预训练 发育导向 视觉-语言建模 认知评估

📋 核心要点

- 现有视觉基础模型预训练缺乏对婴儿早期发育轨迹的有效模拟,导致样本效率低下。

- BabyVLM-V2通过构建纵向、多方面的婴儿中心视听语料库,模拟婴儿的学习过程,实现高效预训练。

- 实验表明,BabyVLM-V2预训练的紧凑模型在DevCV工具箱上表现出色,部分任务超越GPT-4o。

📝 摘要(中文)

本文提出了BabyVLM-V2,一个发育导向的视觉-语言建模框架,旨在通过模拟婴儿的学习方式,实现视觉基础模型的样本高效预训练。BabyVLM-V2在BabyVLM-V1的基础上进行了大幅改进,包括一个纵向、多方面的预训练数据集,一个通用的模型,以及用于认知评估的DevCV工具箱。预训练数据集最大化了覆盖范围,同时最小化了对以婴儿为中心的纵向视听语料库的整理,从而产生了反映婴儿体验的视频-话语、图像-话语和多轮对话数据。DevCV工具箱将最近发布的NIH Baby Toolbox的所有视觉相关指标改编为一个包含十个多模态任务的基准测试套件,涵盖了与早期儿童能力相符的空间推理、记忆和词汇理解。实验结果表明,从头开始预训练的紧凑模型可以在DevCV工具箱上实现有竞争力的性能,并在某些任务上优于GPT-4o。该研究希望BabyVLM-V2框架能够加速视觉基础模型发育合理预训练的研究。

🔬 方法详解

问题定义:现有视觉基础模型的预训练方法通常采用大规模数据集,但忽略了人类早期认知发展过程,导致模型训练效率低下,且难以模拟人类的认知能力。因此,需要一种更符合人类认知发展规律的预训练方法,以提高模型的样本效率和泛化能力。

核心思路:BabyVLM-V2的核心思路是模拟婴儿的学习方式,通过构建一个纵向、多方面的婴儿中心视听语料库,让模型像婴儿一样逐步学习视觉和语言信息。这种方法旨在利用婴儿早期认知发展的关键阶段,实现更高效、更自然的预训练。

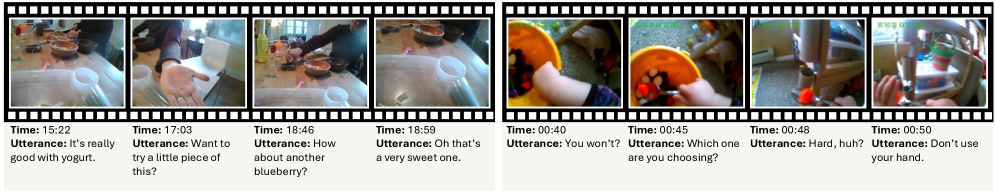

技术框架:BabyVLM-V2框架主要包含三个部分:1) 纵向、多方面的预训练数据集,包含视频-话语、图像-话语和多轮对话数据;2) 一个通用的视觉-语言模型,用于学习预训练数据中的信息;3) DevCV工具箱,用于评估模型在认知任务上的表现。预训练过程包括多模态数据的对齐和融合,以及基于对比学习和生成学习的目标函数优化。

关键创新:BabyVLM-V2的关键创新在于其发育导向的预训练方法和DevCV工具箱。通过模拟婴儿的学习过程,该方法能够更有效地利用数据,提高模型的样本效率和泛化能力。DevCV工具箱提供了一套全面的认知评估任务,可以更准确地评估模型在认知能力方面的表现。

关键设计:预训练数据集的设计考虑了婴儿的认知发展阶段,包含了不同类型的视听数据。模型结构采用了Transformer架构,并针对多模态数据进行了优化。损失函数包括对比学习损失和生成学习损失,用于学习视觉和语言信息之间的关联。DevCV工具箱中的任务涵盖了空间推理、记忆和词汇理解等多个认知领域。

🖼️ 关键图片

📊 实验亮点

BabyVLM-V2在DevCV工具箱上进行了实验,结果表明,从头开始预训练的紧凑模型可以在多个认知任务上实现有竞争力的性能,并在某些任务上优于GPT-4o。这表明BabyVLM-V2框架能够有效地提高模型的认知能力,并为视觉基础模型的发展提供了一种新的思路。

🎯 应用场景

BabyVLM-V2的研究成果可应用于开发更智能、更自然的视觉-语言模型,例如智能助手、机器人和教育工具。通过模拟人类的认知发展过程,这些模型可以更好地理解人类的需求,并提供更个性化的服务。此外,该研究还可以促进对人类认知发展机制的理解,为人工智能的未来发展提供新的思路。

📄 摘要(原文)

Early children's developmental trajectories set up a natural goal for sample-efficient pretraining of vision foundation models. We introduce BabyVLM-V2, a developmentally grounded framework for infant-inspired vision-language modeling that extensively improves upon BabyVLM-V1 through a longitudinal, multifaceted pretraining set, a versatile model, and, most importantly, DevCV Toolbox for cognitive evaluation. The pretraining set maximizes coverage while minimizing curation of a longitudinal, infant-centric audiovisual corpus, yielding video-utterance, image-utterance, and multi-turn conversational data that mirror infant experiences. DevCV Toolbox adapts all vision-related measures of the recently released NIH Baby Toolbox into a benchmark suite of ten multimodal tasks, covering spatial reasoning, memory, and vocabulary understanding aligned with early children's capabilities. Experimental results show that a compact model pretrained from scratch can achieve competitive performance on DevCV Toolbox, outperforming GPT-4o on some tasks. We hope the principled, unified BabyVLM-V2 framework will accelerate research in developmentally plausible pretraining of vision foundation models.