MMSI-Video-Bench: A Holistic Benchmark for Video-Based Spatial Intelligence

作者: Jingli Lin, Runsen Xu, Shaohao Zhu, Sihan Yang, Peizhou Cao, Yunlong Ran, Miao Hu, Chenming Zhu, Yiman Xie, Yilin Long, Wenbo Hu, Dahua Lin, Tai Wang, Jiangmiao Pang

分类: cs.CV, cs.AI

发布日期: 2025-12-11

💡 一句话要点

MMSI-Video-Bench:用于评估视频空间智能的多模态大模型基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频理解 空间智能 多模态大模型 基准测试 机器人视觉

📋 核心要点

- 现有的多模态大模型在理解物理环境中的空间关系方面存在不足,缺乏全面的评估基准。

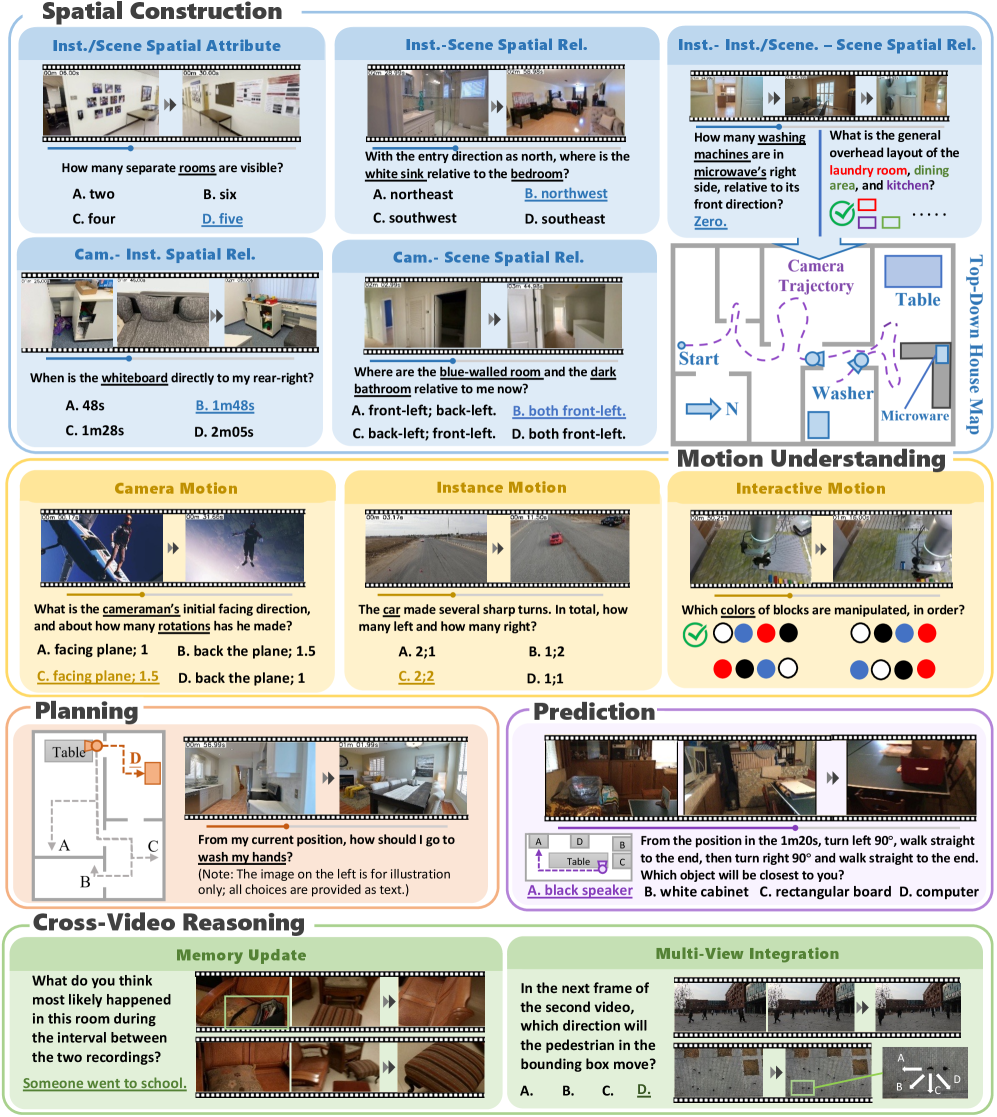

- MMSI-Video-Bench通过构建包含感知、规划、预测和跨视频推理四个层次的任务,全面评估模型的空间智能。

- 实验结果表明,现有模型在空间智能方面与人类存在显著差距,且空间微调模型的泛化能力有限。

📝 摘要(中文)

本文提出了MMSI-Video-Bench,一个全面的人工标注基准,用于评估多模态大模型(MLLM)在视频空间智能方面的进展。该基准通过1,106个问题,基于来自25个数据集和内部视频的1,278个片段,将空间智能操作化为四个层次:感知、规划、预测和跨视频推理。每个项目都由3D视觉专家精心设计和审查,并附有解释性理由,以确保精确、明确的基础。MMSI-Video-Bench还支持三个面向领域的子基准(室内场景感知基准、机器人基准和基础基准),用于有针对性的能力评估。对25个强大的开源和专有MLLM的评估表明,存在显著的人工智能差距:许多模型的性能接近随机水平,最佳推理模型落后人类近60%。空间微调模型也未能有效泛化。细粒度的错误分析揭示了几何推理、运动基础、长时程预测和跨视频对应中的系统性失败。典型的帧采样策略在推理密集型基准上表现不佳,3D空间线索和思维链提示均未产生有意义的收益。该基准旨在为推进基于视频的空间智能建立坚实的测试平台。

🔬 方法详解

问题定义:论文旨在解决多模态大模型在理解视频中的空间信息方面的能力评估问题。现有的评估方法要么不够全面,无法覆盖空间智能的各个方面,要么缺乏精确的人工标注,导致评估结果不够可靠。因此,需要一个全面、精确的基准来评估模型在视频空间智能方面的进展。

核心思路:论文的核心思路是将视频空间智能分解为四个层次:感知、规划、预测和跨视频推理。通过构建包含这四个层次的任务,可以全面评估模型在理解视频中的空间信息方面的能力。此外,论文还采用了人工标注的方式,确保评估结果的精确性和可靠性。

技术框架:MMSI-Video-Bench的整体框架包括以下几个部分:1)数据收集:收集来自25个数据集和内部视频的1,278个视频片段。2)任务设计:设计包含感知、规划、预测和跨视频推理四个层次的1,106个问题。3)人工标注:由3D视觉专家对每个问题进行标注,并提供解释性理由。4)模型评估:使用MMSI-Video-Bench评估25个多模态大模型。5)错误分析:对模型的错误进行细粒度的分析,找出模型的不足之处。

关键创新:MMSI-Video-Bench的关键创新在于其全面性和精确性。它不仅覆盖了空间智能的各个方面,而且采用了人工标注的方式,确保评估结果的可靠性。此外,MMSI-Video-Bench还支持三个面向领域的子基准,可以对模型的特定能力进行有针对性的评估。

关键设计:在任务设计方面,论文精心设计了每个问题,确保其能够精确地评估模型在特定方面的能力。例如,在感知方面,问题可能要求模型识别视频中的物体或场景;在规划方面,问题可能要求模型预测物体的运动轨迹;在预测方面,问题可能要求模型预测未来的事件;在跨视频推理方面,问题可能要求模型比较不同视频中的场景或物体。在数据标注方面,论文采用了三位3D视觉专家进行标注和审核,保证了标注的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有模型在MMSI-Video-Bench上的表现与人类存在显著差距,最佳推理模型落后人类近60%。此外,空间微调模型也未能有效泛化,表明现有模型在空间智能方面仍有很大的提升空间。错误分析揭示了几何推理、运动基础、长时程预测和跨视频对应中的系统性失败。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、智能监控等领域。通过提升多模态大模型在视频空间智能方面的能力,可以使机器人在复杂环境中更好地理解和交互,从而实现更智能化的应用。

📄 摘要(原文)

Spatial understanding over continuous visual input is crucial for MLLMs to evolve into general-purpose assistants in physical environments. Yet there is still no comprehensive benchmark that holistically assesses the progress toward this goal. In this work, we introduce MMSI-Video-Bench, a fully human-annotated benchmark for video-based spatial intelligence in MLLMs. It operationalizes a four-level framework, Perception, Planning, Prediction, and Cross-Video Reasoning, through 1,106 questions grounded in 1,278 clips from 25 datasets and in-house videos. Each item is carefully designed and reviewed by 3DV experts with explanatory rationales to ensure precise, unambiguous grounding. Leveraging its diverse data sources and holistic task coverage, MMSI-Video-Bench also supports three domain-oriented sub-benchmarks (Indoor Scene Perception Bench, Robot Bench and Grounding Bench) for targeted capability assessment. We evaluate 25 strong open-source and proprietary MLLMs, revealing a striking human--AI gap: many models perform near chance, and the best reasoning model lags humans by nearly 60%. We further find that spatially fine-tuned models still fail to generalize effectively on our benchmark. Fine-grained error analysis exposes systematic failures in geometric reasoning, motion grounding, long-horizon prediction, and cross-video correspondence. We also show that typical frame-sampling strategies transfer poorly to our reasoning-intensive benchmark, and that neither 3D spatial cues nor chain-of-thought prompting yields meaningful gains. We expect our benchmark to establish a solid testbed for advancing video-based spatial intelligence.