TriDF: Evaluating Perception, Detection, and Hallucination for Interpretable DeepFake Detection

作者: Jian-Yu Jiang-Lin, Kang-Yang Huang, Ling Zou, Ling Lo, Sheng-Ping Yang, Yu-Wen Tseng, Kun-Hsiang Lin, Chia-Ling Chen, Yu-Ting Ta, Yan-Tsung Wang, Po-Ching Chen, Hongxia Xie, Hong-Han Shuai, Wen-Huang Cheng

分类: cs.CV, cs.CR

发布日期: 2025-12-11 (更新: 2025-12-23)

💡 一句话要点

TriDF:一个用于可解释DeepFake检测的综合基准,评估感知、检测和幻觉。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: DeepFake检测 可解释性 基准测试 感知 幻觉 多模态学习 合成媒体

📋 核心要点

- 现有DeepFake检测方法缺乏可解释性,难以提供清晰可靠的推理依据,限制了其在安全敏感场景的应用。

- TriDF基准通过评估感知、检测和幻觉三个关键方面,旨在理解检测准确性、证据识别和解释可靠性之间的相互作用。

- 实验表明,准确的感知对于可靠的检测至关重要,但幻觉会严重扰乱决策,揭示了三者之间的依赖性。

📝 摘要(中文)

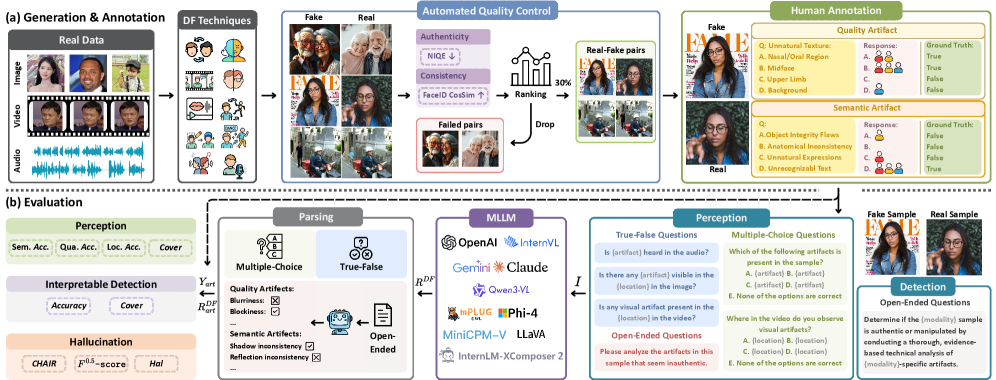

生成模型的进步使得伪造逼真的人物形象变得越来越容易,给安全、通信和公众信任带来了严重风险。检测这种人为操纵的内容需要系统不仅能区分篡改内容与真实媒体,还能提供清晰可靠的推理。本文提出了TriDF,一个用于可解释DeepFake检测的综合基准。TriDF包含来自先进合成模型的高质量伪造数据,涵盖图像、视频和音频模态的16种DeepFake类型。该基准评估三个关键方面:感知(使用人工标注的证据来衡量模型识别细粒度操纵伪影的能力)、检测(评估跨不同伪造类型和生成器的分类性能)和幻觉(量化模型生成解释的可靠性)。在最先进的多模态大型语言模型上的实验表明,准确的感知对于可靠的检测至关重要,但幻觉会严重扰乱决策,揭示了这三个方面的相互依赖性。TriDF提供了一个统一的框架,用于理解检测准确性、证据识别和解释可靠性之间的相互作用,为构建解决现实世界合成媒体威胁的可信系统奠定了基础。

🔬 方法详解

问题定义:当前DeepFake检测方法主要关注分类准确率,缺乏对模型决策过程的解释能力。现有方法难以识别细粒度的伪造痕迹,并且容易产生幻觉,即给出不准确或不相关的解释,导致用户难以信任检测结果。因此,如何构建一个可解释的DeepFake检测系统,并对其感知能力、检测能力和解释可靠性进行全面评估,是一个亟待解决的问题。

核心思路:TriDF基准的核心思路是将DeepFake检测问题分解为三个相互关联的方面:感知、检测和幻觉。感知侧重于模型识别细粒度伪造痕迹的能力;检测侧重于模型区分真假样本的分类性能;幻觉侧重于模型生成解释的可靠性。通过综合评估这三个方面,可以更全面地了解DeepFake检测系统的性能,并发现潜在的缺陷。

技术框架:TriDF基准包含一个高质量的DeepFake数据集和一个评估框架。数据集包含图像、视频和音频模态的16种DeepFake类型,由先进的合成模型生成。评估框架包括三个评估指标:感知准确率、检测准确率和幻觉率。感知准确率衡量模型识别人工标注的伪造痕迹的准确程度;检测准确率衡量模型区分真假样本的准确程度;幻觉率衡量模型生成不准确或不相关解释的频率。

关键创新:TriDF基准的关键创新在于其综合评估框架,该框架不仅关注检测准确率,还关注模型的感知能力和解释可靠性。通过评估这三个方面,TriDF可以更全面地了解DeepFake检测系统的性能,并发现潜在的缺陷。此外,TriDF数据集包含多种DeepFake类型,可以更全面地评估模型的泛化能力。

关键设计:TriDF数据集包含来自先进合成模型的高质量伪造数据,涵盖图像、视频和音频模态的16种DeepFake类型。评估指标包括感知准确率、检测准确率和幻觉率。感知准确率通过比较模型预测的伪造痕迹与人工标注的痕迹来计算。检测准确率通过计算模型区分真假样本的准确率来计算。幻觉率通过人工评估模型生成的解释的准确性和相关性来计算。

🖼️ 关键图片

📊 实验亮点

在最先进的多模态大型语言模型上的实验表明,准确的感知对于可靠的检测至关重要,但幻觉会严重扰乱决策。实验结果揭示了感知、检测和幻觉这三个方面的相互依赖性,强调了构建可解释DeepFake检测系统的重要性。

🎯 应用场景

TriDF基准可应用于开发更可靠、可信的DeepFake检测系统,从而提高在线内容安全,保护公众免受虚假信息的侵害。该基准还可以促进对DeepFake检测模型的可解释性研究,帮助研究人员理解模型的决策过程,并改进模型的设计。

📄 摘要(原文)

Advances in generative modeling have made it increasingly easy to fabricate realistic portrayals of individuals, creating serious risks for security, communication, and public trust. Detecting such person-driven manipulations requires systems that not only distinguish altered content from authentic media but also provide clear and reliable reasoning. In this paper, we introduce TriDF, a comprehensive benchmark for interpretable DeepFake detection. TriDF contains high-quality forgeries from advanced synthesis models, covering 16 DeepFake types across image, video, and audio modalities. The benchmark evaluates three key aspects: Perception, which measures the ability of a model to identify fine-grained manipulation artifacts using human-annotated evidence; Detection, which assesses classification performance across diverse forgery families and generators; and Hallucination, which quantifies the reliability of model-generated explanations. Experiments on state-of-the-art multimodal large language models show that accurate perception is essential for reliable detection, but hallucination can severely disrupt decision-making, revealing the interdependence of these three aspects. TriDF provides a unified framework for understanding the interaction between detection accuracy, evidence identification, and explanation reliability, offering a foundation for building trustworthy systems that address real-world synthetic media threats.