RaLiFlow: Scene Flow Estimation with 4D Radar and LiDAR Point Clouds

作者: Jingyun Fu, Zhiyu Xiang, Na Zhao

分类: cs.CV

发布日期: 2025-12-11

备注: Accepted by AAAI

💡 一句话要点

提出RaLiFlow,首个基于4D雷达和激光雷达点云的场景流估计框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 场景流估计 雷达 激光雷达 多模态融合 自动驾驶

📋 核心要点

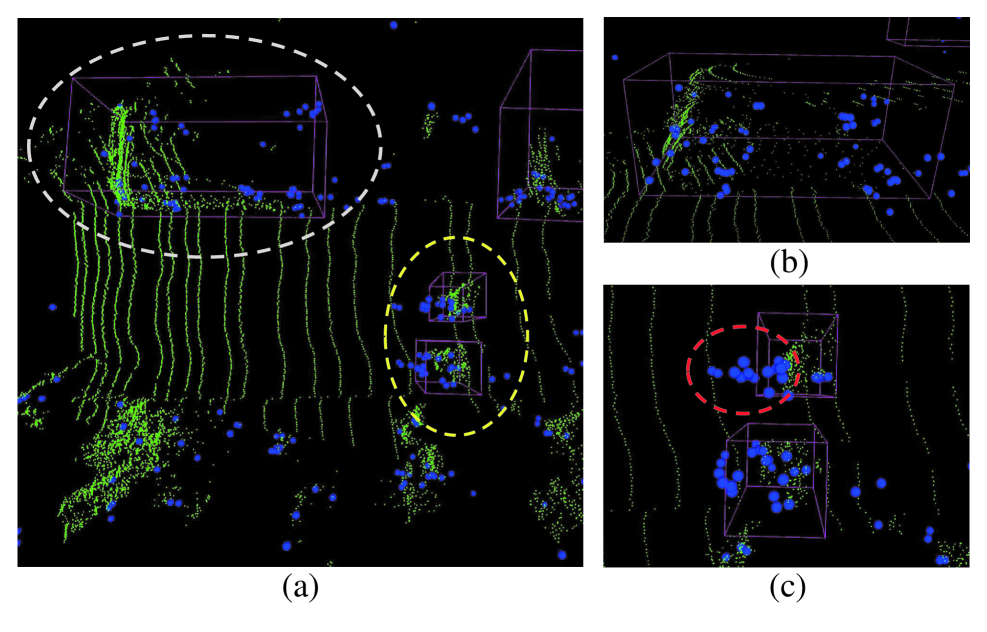

- 现有场景流估计方法主要集中于图像与激光雷达融合,忽略了雷达在恶劣天气下的鲁棒性和速度感知能力,雷达与激光雷达融合仍有挑战。

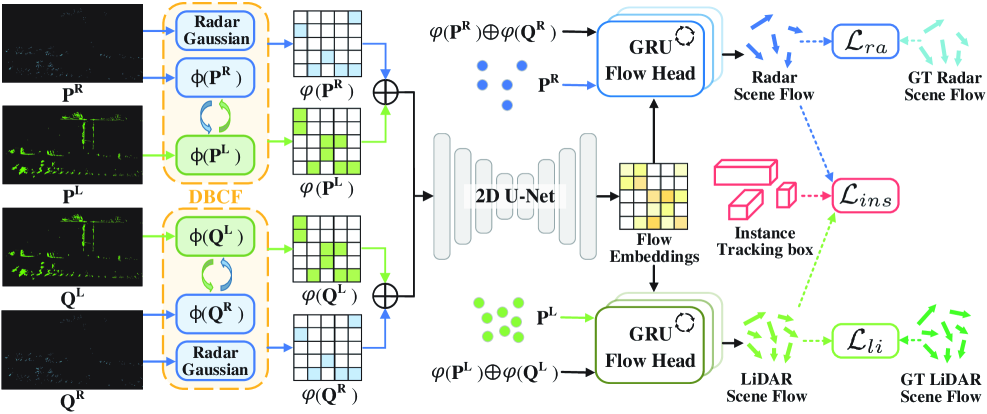

- RaLiFlow通过动态感知双向跨模态融合(DBCF)模块,将雷达的动态信息融入激光雷达特征中,实现更有效的跨模态信息交互。

- 实验表明,RaLiFlow在自建的雷达-激光雷达场景流数据集上,显著优于现有的单模态方法,尤其在动态前景区域性能提升明显。

📝 摘要(中文)

本文提出了一种新的场景流估计方法,该方法融合了4D毫米波雷达和激光雷达点云数据。现有方法主要集中在图像与激光雷达的融合,而雷达与激光雷达的融合尚待探索。雷达成本更低,在各种天气条件下更鲁棒,并且能够检测点级别的速度,是对激光雷达的宝贵补充。然而,雷达数据存在噪声、分辨率低和稀疏性等挑战。为此,本文构建了一个基于公开真实世界汽车数据集的雷达-激光雷达场景流数据集。提出了一种有效的雷达去噪和场景流标签生成策略,为物体边界外的雷达点推导出更可靠的流真值。此外,本文还提出了RaLiFlow,这是第一个用于4D雷达和激光雷达的联合场景流学习框架,通过一种新颖的动态感知双向跨模态融合(DBCF)模块和精心设计的损失函数集,实现了有效的雷达-激光雷达融合。DBCF模块将来自雷达的动态线索集成到局部跨注意力机制中,从而实现跨模态的上下文信息传播。同时,所提出的损失函数减轻了训练期间不可靠雷达数据的不利影响,并增强了来自两种模态的场景流预测中的实例级一致性,特别是对于动态前景区域。在重新设计的场景流数据集上的大量实验表明,本文的方法明显优于现有的基于激光雷达和雷达的单模态方法。

🔬 方法详解

问题定义:论文旨在解决如何有效融合4D雷达和激光雷达数据进行场景流估计的问题。现有方法主要依赖图像和激光雷达的融合,忽略了雷达在恶劣天气下的优势以及直接测量速度的能力。雷达数据固有的噪声、低分辨率和稀疏性给融合带来了挑战,同时缺乏相应的雷达-激光雷达场景流数据集也限制了相关研究的开展。

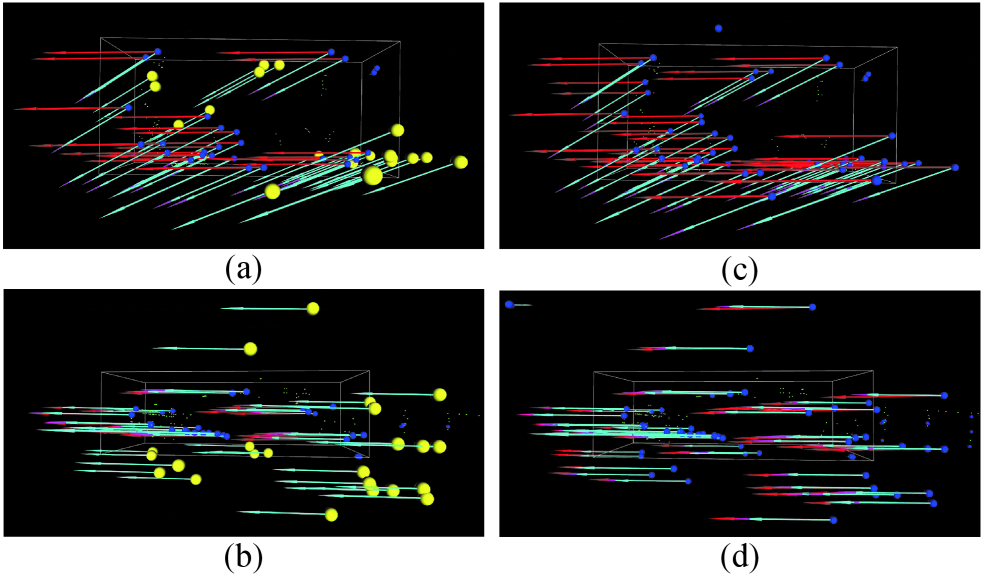

核心思路:论文的核心思路是利用雷达提供的动态信息(速度)来指导激光雷达特征的学习,从而实现更鲁棒和准确的场景流估计。通过设计的动态感知双向跨模态融合(DBCF)模块,将雷达的速度信息融入到激光雷达的特征中,增强模型对动态物体的感知能力。

技术框架:RaLiFlow框架主要包含以下几个阶段:1) 雷达和激光雷达数据的预处理,包括雷达去噪和场景流标签生成;2) 特征提取,分别从雷达和激光雷达数据中提取特征;3) 动态感知双向跨模态融合(DBCF),将雷达的动态信息融入激光雷达特征;4) 场景流预测,基于融合后的特征预测场景流;5) 损失函数优化,通过设计的损失函数来优化模型参数。

关键创新:论文的关键创新在于提出了动态感知双向跨模态融合(DBCF)模块。该模块利用雷达提供的速度信息,通过局部跨注意力机制,自适应地调整激光雷达特征的权重,从而更好地融合两种模态的信息。这种融合方式能够有效地利用雷达的动态信息,提高模型对动态物体的感知能力。

关键设计:DBCF模块的关键设计在于利用雷达的速度信息作为注意力机制的先验知识。具体来说,雷达的速度信息被用来计算激光雷达特征的权重,速度越高的点,其对应的激光雷达特征权重越高。此外,论文还设计了一系列损失函数,包括场景流损失、平滑损失和一致性损失,以提高场景流预测的准确性和一致性。特别地,一致性损失用于约束雷达和激光雷达预测的场景流在实例级别上的一致性。

🖼️ 关键图片

📊 实验亮点

RaLiFlow在自建的雷达-激光雷达场景流数据集上取得了显著的性能提升。实验结果表明,RaLiFlow明显优于现有的基于激光雷达和雷达的单模态方法。尤其是在动态前景区域,RaLiFlow的性能提升更为显著,验证了DBCF模块的有效性。

🎯 应用场景

RaLiFlow在自动驾驶领域具有广阔的应用前景。通过融合雷达和激光雷达数据,可以提高自动驾驶系统在各种天气条件下的感知能力,从而提高行驶安全性。此外,该方法还可以应用于机器人导航、三维重建等领域,具有重要的实际价值和未来影响。

📄 摘要(原文)

Recent multimodal fusion methods, integrating images with LiDAR point clouds, have shown promise in scene flow estimation. However, the fusion of 4D millimeter wave radar and LiDAR remains unexplored. Unlike LiDAR, radar is cheaper, more robust in various weather conditions and can detect point-wise velocity, making it a valuable complement to LiDAR. However, radar inputs pose challenges due to noise, low resolution, and sparsity. Moreover, there is currently no dataset that combines LiDAR and radar data specifically for scene flow estimation. To address this gap, we construct a Radar-LiDAR scene flow dataset based on a public real-world automotive dataset. We propose an effective preprocessing strategy for radar denoising and scene flow label generation, deriving more reliable flow ground truth for radar points out of the object boundaries. Additionally, we introduce RaLiFlow, the first joint scene flow learning framework for 4D radar and LiDAR, which achieves effective radar-LiDAR fusion through a novel Dynamic-aware Bidirectional Cross-modal Fusion (DBCF) module and a carefully designed set of loss functions. The DBCF module integrates dynamic cues from radar into the local cross-attention mechanism, enabling the propagation of contextual information across modalities. Meanwhile, the proposed loss functions mitigate the adverse effects of unreliable radar data during training and enhance the instance-level consistency in scene flow predictions from both modalities, particularly for dynamic foreground areas. Extensive experiments on the repurposed scene flow dataset demonstrate that our method outperforms existing LiDAR-based and radar-based single-modal methods by a significant margin.