GTAvatar: Bridging Gaussian Splatting and Texture Mapping for Relightable and Editable Gaussian Avatars

作者: Kelian Baert, Mae Younes, Francois Bourel, Marc Christie, Adnane Boukhayma

分类: cs.CV, cs.GR

发布日期: 2025-12-09

💡 一句话要点

GTAvatar:结合高斯溅射与纹理映射,实现可重光照和编辑的高斯头像

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 UV纹理映射 头像重建 可编辑性 重光照

📋 核心要点

- 现有高斯溅射方法重建的头像缺乏传统网格方法提供的直观编辑能力,限制了其应用。

- 该论文提出将高斯溅射与UV纹理映射结合,在UV空间中嵌入高斯基元,实现可编辑的材质纹理重建。

- 实验表明,该方法重建精度高,重光照效果好,并能通过纹理映射直观地修改头像外观和几何形状。

📝 摘要(中文)

近年来,高斯溅射技术的进步使得重建逼真的头部头像成为可能,为视觉特效、视频会议和虚拟现实等领域带来了机遇。然而,它缺乏传统基于三角网格方法所提供的直观可编辑性。为了解决这个问题,我们提出了一种结合2D高斯溅射的精度和保真度与UV纹理映射的直观性的方法。通过将每个规范高斯基元的局部坐标系以计算高效的方式嵌入到模板网格的UV空间中的一个patch中,我们从单个单目视频中重建连续可编辑的材质头部纹理到常规UV域上。此外,我们利用高效的基于物理的反射模型来实现这些内在材质贴图的重光照和编辑。通过与最先进的方法进行广泛的比较,我们证明了我们重建的准确性、重光照结果的质量,以及通过纹理映射提供直观控制来修改头像外观和几何形状的能力,而无需额外的优化。

🔬 方法详解

问题定义:现有基于高斯溅射的头像重建方法虽然能实现高精度和高保真度的重建,但缺乏传统基于三角网格方法所具备的直观编辑性。用户难以直接修改头像的几何形状和材质属性,限制了其在需要定制化头像的应用场景中的使用。

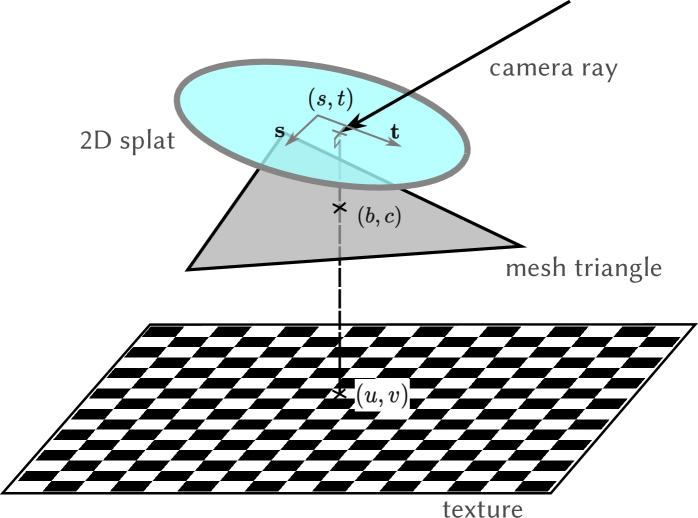

核心思路:该论文的核心思路是将高斯溅射的优势(高精度重建)与UV纹理映射的优势(直观可编辑性)结合起来。通过建立高斯基元与UV空间之间的对应关系,将高斯溅射重建的结果映射到UV纹理上,从而实现对头像材质和几何形状的直观编辑。

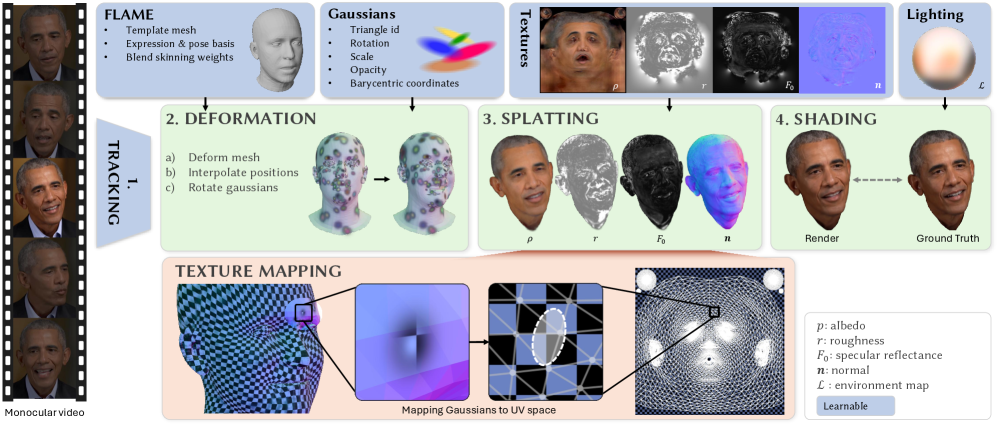

技术框架:该方法主要包含以下几个阶段:1) 使用高斯溅射从单目视频中重建头部模型;2) 将每个高斯基元的局部坐标系嵌入到模板网格的UV空间中的一个patch中,建立高斯基元与UV空间的对应关系;3) 将高斯溅射重建的结果映射到UV纹理上,得到可编辑的材质纹理;4) 利用基于物理的渲染模型,实现对材质纹理的重光照和编辑。

关键创新:该论文的关键创新在于将高斯溅射与UV纹理映射相结合,提出了一种新的头像重建和编辑框架。通过将高斯基元嵌入到UV空间中,实现了对高斯溅射重建结果的直观编辑,克服了传统高斯溅射方法缺乏可编辑性的缺点。

关键设计:该方法的关键设计包括:1) 如何高效地将高斯基元的局部坐标系嵌入到UV空间中;2) 如何将高斯溅射重建的结果准确地映射到UV纹理上;3) 如何利用基于物理的渲染模型实现对材质纹理的真实感重光照。具体实现细节可能包括特定的UV参数化方法、纹理映射算法以及BRDF模型的选择。

🖼️ 关键图片

📊 实验亮点

论文通过与最先进的方法进行比较,证明了该方法重建的准确性、重光照结果的质量,以及通过纹理映射提供直观控制来修改头像外观和几何形状的能力,而无需额外的优化。具体的性能数据和提升幅度需要在论文中查找,但总体而言,该方法在可编辑性和重建质量之间取得了良好的平衡。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、增强现实、视频会议、游戏等领域。用户可以利用该技术创建高度逼真且可定制的虚拟化身,用于社交互动、远程协作、内容创作等。此外,该技术还可以用于数字资产的创建和编辑,例如游戏角色、电影特效等,具有重要的商业价值和应用前景。

📄 摘要(原文)

Recent advancements in Gaussian Splatting have enabled increasingly accurate reconstruction of photorealistic head avatars, opening the door to numerous applications in visual effects, videoconferencing, and virtual reality. This, however, comes with the lack of intuitive editability offered by traditional triangle mesh-based methods. In contrast, we propose a method that combines the accuracy and fidelity of 2D Gaussian Splatting with the intuitiveness of UV texture mapping. By embedding each canonical Gaussian primitive's local frame into a patch in the UV space of a template mesh in a computationally efficient manner, we reconstruct continuous editable material head textures from a single monocular video on a conventional UV domain. Furthermore, we leverage an efficient physically based reflectance model to enable relighting and editing of these intrinsic material maps. Through extensive comparisons with state-of-the-art methods, we demonstrate the accuracy of our reconstructions, the quality of our relighting results, and the ability to provide intuitive controls for modifying an avatar's appearance and geometry via texture mapping without additional optimization.