Terrain Diffusion: A Diffusion-Based Successor to Perlin Noise in Infinite, Real-Time Terrain Generation

作者: Alexander Goslin

分类: cs.CV, cs.AI, cs.GR, cs.LG

发布日期: 2025-12-09 (更新: 2026-01-11)

备注: Project website: https://xandergos.github.io/terrain-diffusion/ Code: https://github.com/xandergos/terrain-diffusion/

💡 一句话要点

Terrain Diffusion:基于扩散模型的实时无限地形生成,替代Perlin噪声

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 程序化生成 地形生成 扩散模型 无限生成 计算机图形学

📋 核心要点

- 传统程序世界依赖Perlin噪声等函数,但其真实性和大规模连贯性存在根本限制。

- Terrain Diffusion通过InfiniteDiffusion算法,在无界域上重新定义扩散采样,实现无限生成。

- 实验表明,该框架在消费级GPU上速度提升9倍,支持交互式逼真地形生成。

📝 摘要(中文)

本文提出Terrain Diffusion,一个生成框架,将扩散模型的高保真度与程序噪声的特性相结合,程序噪声具有无缝无限范围、种子一致性和恒定时间随机访问等优点。核心是InfiniteDiffusion,一种用于无限生成的新算法,它为无界域重新制定了标准扩散采样。虽然噪声函数仍然接近瞬时,但我们的框架在消费级GPU上的速度比轨道速度快9倍,从而能够以交互速率生成逼真的地形。我们集成了一个分层扩散模型堆栈,将行星上下文与局部细节相结合,一个紧凑的拉普拉斯编码,以稳定地球尺度动态范围内的输出,以及一个开源的无限张量框架,用于恒定内存操作无界张量。总之,这些组件将扩散模型定位为下一代无限虚拟世界的实用、可扩展的基础。

🔬 方法详解

问题定义:传统程序化地形生成方法,如Perlin噪声,虽然速度快且可以无限生成,但在真实感和大规模连贯性上存在局限性。这些方法难以生成具有复杂结构和自然特征的地形,并且难以在不同尺度上保持一致性。

核心思路:论文的核心思路是将扩散模型应用于程序化地形生成,利用扩散模型强大的生成能力来提高地形的真实感和连贯性。通过设计一种新的扩散采样算法InfiniteDiffusion,使其适用于无界域,从而实现无限地形的生成。

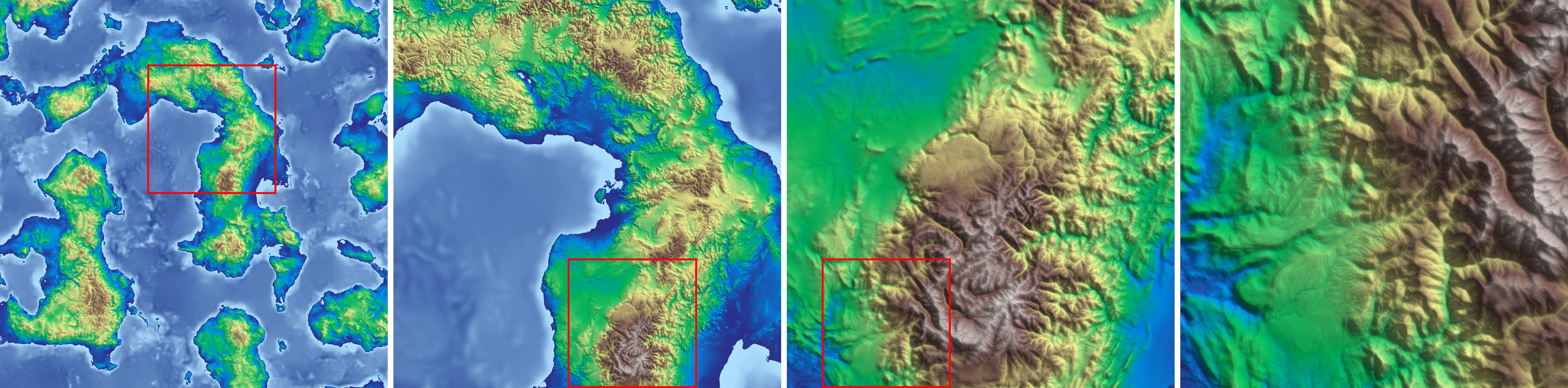

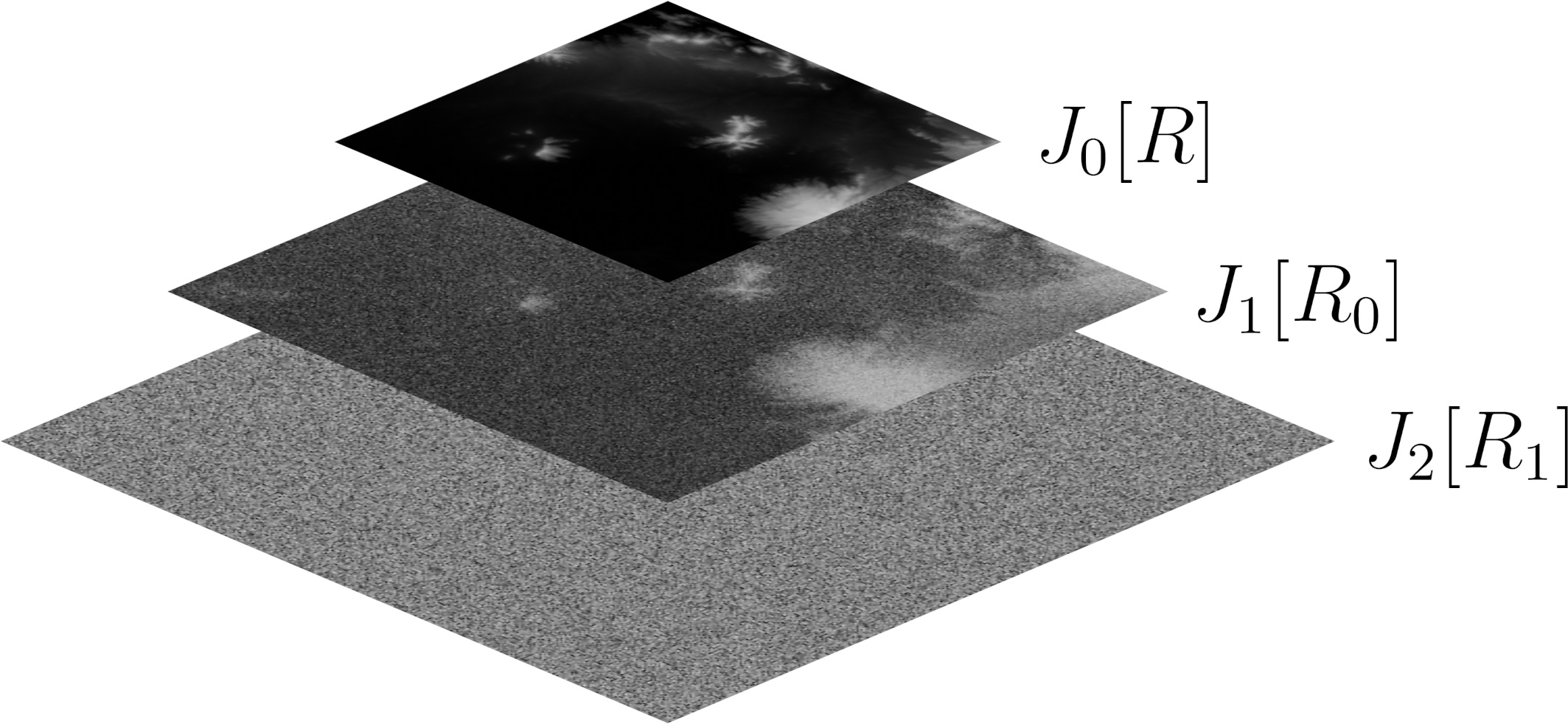

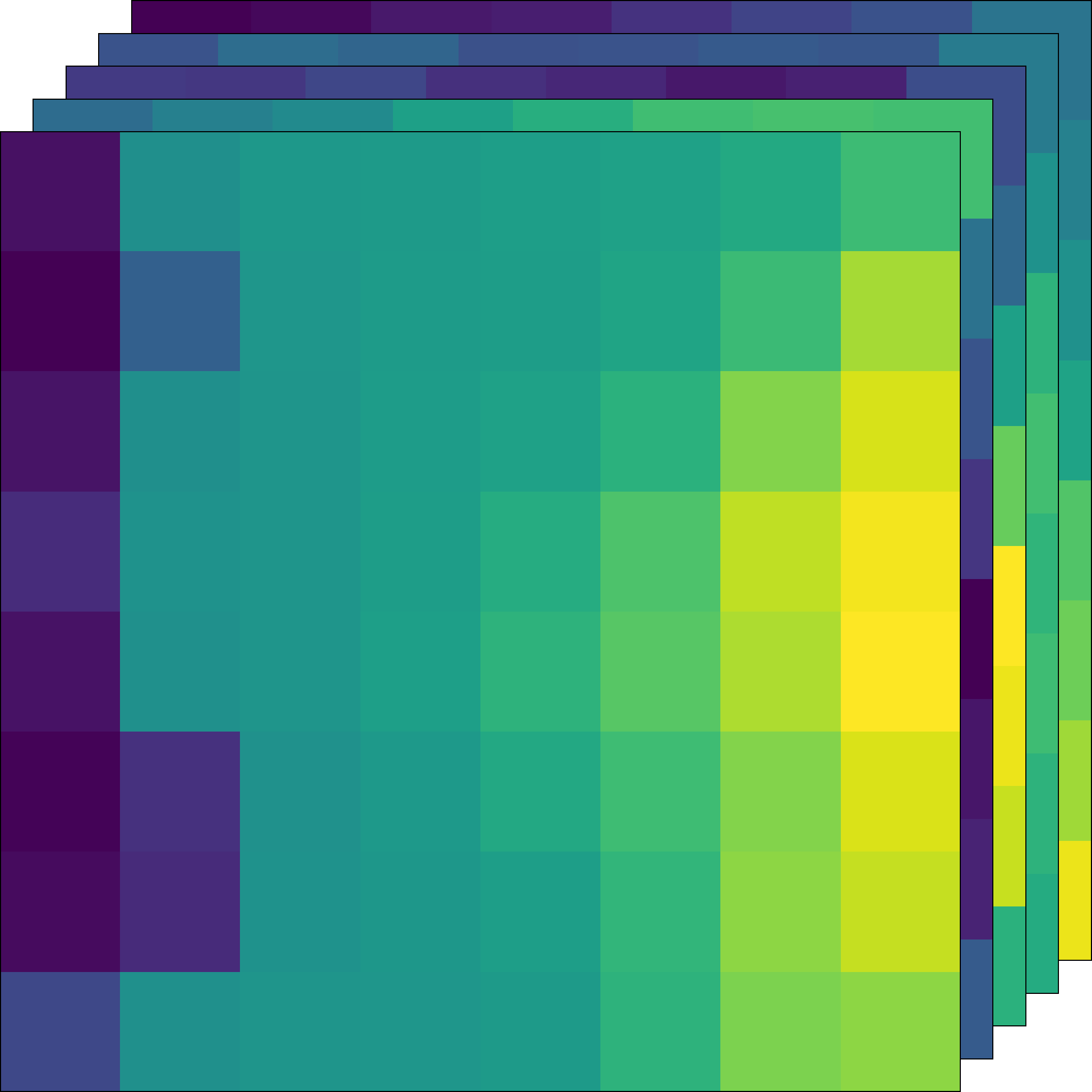

技术框架:Terrain Diffusion框架包含以下几个主要组成部分:1) InfiniteDiffusion算法:用于在无界域上进行扩散采样,生成无限地形。2) 分层扩散模型堆栈:用于将行星上下文与局部细节相结合,实现多尺度地形生成。3) 紧凑的拉普拉斯编码:用于稳定地球尺度动态范围内的输出。4) 开源的无限张量框架:用于恒定内存操作无界张量。整体流程是从行星尺度到局部细节逐步生成地形,并通过拉普拉斯编码和无限张量框架来保证稳定性和效率。

关键创新:最重要的技术创新点是InfiniteDiffusion算法,它将标准的扩散采样过程重新定义,使其适用于无界域。与传统的扩散模型不同,InfiniteDiffusion不需要预先定义一个有限的生成范围,而是可以无限地生成地形。此外,分层扩散模型堆栈和紧凑的拉普拉斯编码也是重要的创新,它们分别用于实现多尺度地形生成和提高输出的稳定性。

关键设计:论文中使用了分层扩散模型,每一层负责不同尺度的地形生成。具体参数设置未知。损失函数未知,但推测会包含对抗损失和感知损失等,以提高生成地形的真实感。网络结构未知,但推测会采用U-Net等常用的扩散模型网络结构。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Terrain Diffusion在消费级GPU上的地形生成速度比传统方法快9倍,实现了交互式的逼真地形生成。该框架能够生成具有复杂结构和自然特征的地形,并且在不同尺度上保持一致性。具体性能数据和对比基线未知。

🎯 应用场景

Terrain Diffusion可应用于游戏开发、虚拟现实、电影制作等领域,为用户提供无限且逼真的虚拟世界。该技术能够降低内容创作成本,提高用户体验,并为未来的无限虚拟世界奠定基础。其潜在价值在于能够创造更加沉浸式和可探索的虚拟环境。

📄 摘要(原文)

For decades, procedural worlds have been built on procedural noise functions such as Perlin noise, which are fast and infinite, yet fundamentally limited in realism and large-scale coherence. We introduce Terrain Diffusion, a generative framework that bridges the fidelity of diffusion models with the properties that made procedural noise indispensable: seamless infinite extent, seed-consistency, and constant-time random access. At its core is InfiniteDiffusion, a novel algorithm for infinite generation that reformulates standard diffusion sampling for unbounded domains. While noise functions remain near-instant, our framework outpaces orbital velocity by 9 times on a consumer GPU, enabling realistic terrain generation at interactive rates. We integrate a hierarchical stack of diffusion models to couple planetary context with local detail, a compact Laplacian encoding to stabilize outputs across Earth-scale dynamic ranges, and an open-source infinite-tensor framework for constant-memory manipulation of unbounded tensors. Together, these components position diffusion models as a practical, scalable foundation for the next generation of infinite virtual worlds.