Geometry-Aware Sparse Depth Sampling for High-Fidelity RGB-D Depth Completion in Robotic Systems

作者: Tony Salloom, Dandi Zhou, Xinhai Sun

分类: cs.CV, cs.RO

发布日期: 2025-12-09

💡 一句话要点

提出几何感知稀疏深度采样,提升机器人RGB-D深度补全精度

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 深度补全 RGB-D 稀疏深度采样 几何感知 机器人视觉

📋 核心要点

- 现有深度补全方法在生成稀疏深度输入时,通常采用均匀随机采样,忽略了真实传感器深度数据质量的几何依赖性。

- 论文提出一种法线引导的稀疏深度采样策略,利用PCA估计表面法线,并以此计算像素级的深度可靠性,指导采样过程。

- 实验表明,该方法能提升深度补全精度,减少伪影,并生成更符合真实传感器特性的训练数据。

📝 摘要(中文)

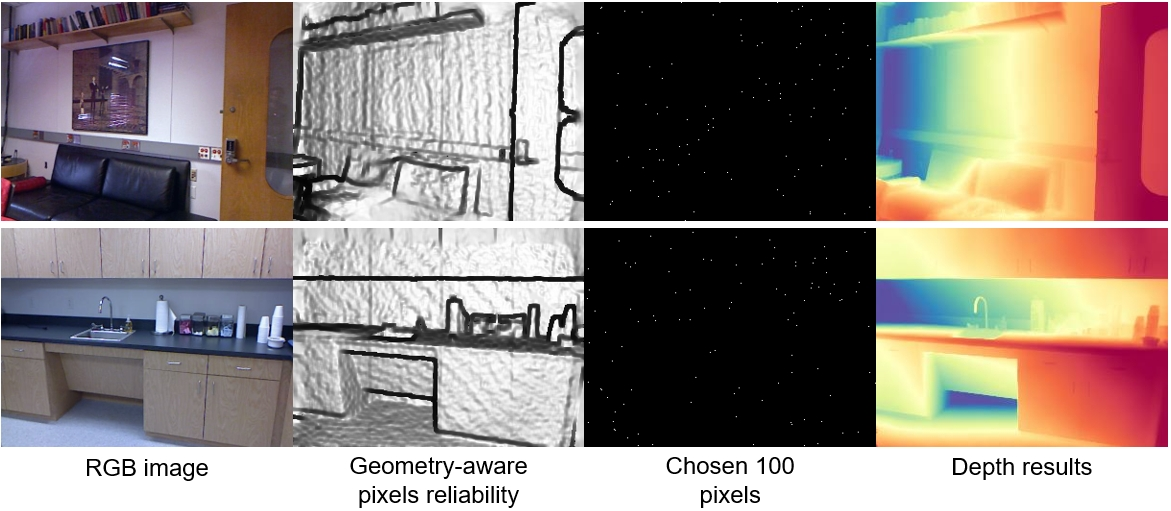

现代工业机器人系统需要精确的三维感知能力,以执行操作、检测和导航任务。RGB-D和立体视觉传感器被广泛使用,但由于传感器限制和环境条件,它们生成的深度图通常存在噪声、不完整或偏差。深度补全方法旨在从RGB图像和稀疏深度输入生成稠密、可靠的深度图。然而,当前深度补全流程的一个关键限制是稀疏深度的生成方式不真实:通常从稠密的ground-truth深度图中均匀随机地选择稀疏像素,忽略了真实传感器表现出的几何依赖性和空间非均匀可靠性。本文提出了一种法线引导的稀疏深度采样策略,该策略利用基于PCA的RGB-D点云表面法线估计来计算每个像素的深度可靠性度量。然后根据该可靠性分布抽取稀疏深度样本。我们将此采样方法与Marigold-DC扩散模型集成,并在NYU Depth v2上使用标准指标进行评估。实验表明,我们的几何感知稀疏深度提高了精度,减少了边缘和不连续区域附近的伪影,并产生了更真实的训练条件,更好地反映了真实传感器的行为。

🔬 方法详解

问题定义:深度补全旨在从RGB图像和稀疏深度图重建稠密深度图。现有方法在生成训练所需的稀疏深度图时,通常采用均匀随机采样,这与真实RGB-D传感器的特性不符。真实传感器受表面几何形状、材质和光照等因素影响,深度数据的可靠性具有空间非均匀性和几何依赖性,均匀采样无法模拟这种特性,导致模型在真实场景下的泛化能力下降。

核心思路:论文的核心思路是模拟真实RGB-D传感器的深度数据获取过程,提出一种几何感知的稀疏深度采样策略。该策略不再均匀随机地选择稀疏深度像素,而是根据每个像素的深度可靠性进行采样。深度可靠性通过分析RGB-D点云的局部几何结构来估计,从而使稀疏深度采样更贴近真实传感器的行为。

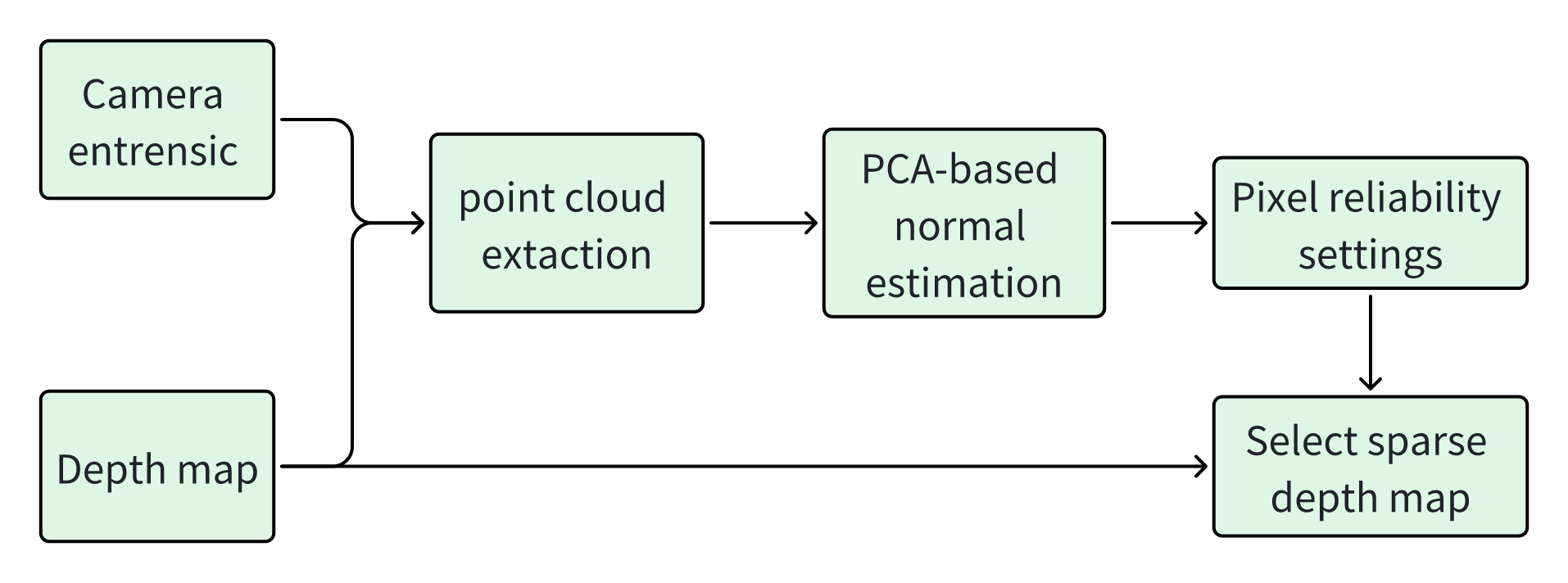

技术框架:整体流程包括以下几个步骤:1) 输入RGB-D图像;2) 使用PCA方法估计每个像素的表面法线;3) 基于表面法线计算每个像素的深度可靠性度量;4) 根据深度可靠性分布进行稀疏深度采样;5) 将采样的稀疏深度图和RGB图像输入到Marigold-DC深度补全模型中进行训练或推理。

关键创新:最重要的技术创新点在于提出了几何感知的稀疏深度采样策略。与现有方法中常用的均匀随机采样相比,该策略能够更好地模拟真实RGB-D传感器的深度数据获取过程,从而使训练数据更具真实性,提升模型的泛化能力。本质区别在于,该方法考虑了深度数据的几何依赖性,而现有方法则忽略了这一重要因素。

关键设计:论文使用PCA方法估计表面法线,并基于法线与视线方向的夹角计算深度可靠性。具体来说,夹角越大,深度可靠性越低。此外,论文还将该采样方法与Marigold-DC扩散模型集成,利用扩散模型的强大生成能力来提升深度补全的精度。没有提及具体的参数设置、损失函数、网络结构等技术细节。

🖼️ 关键图片

📊 实验亮点

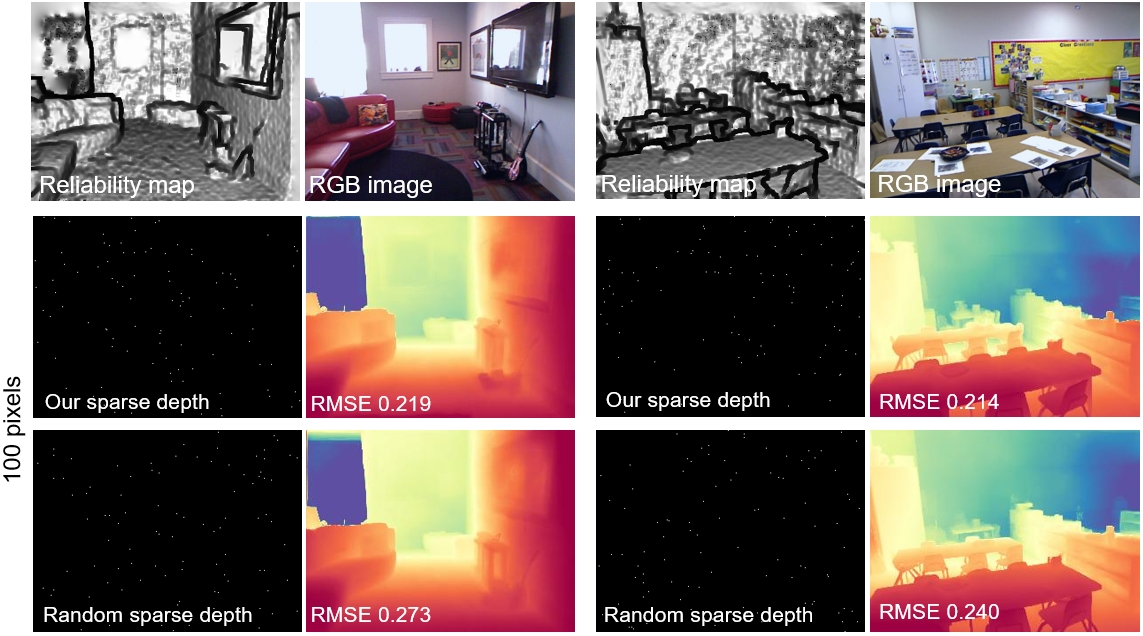

实验结果表明,该方法在NYU Depth v2数据集上取得了显著的性能提升。与使用均匀随机采样的基线方法相比,该方法能够提高深度补全的精度,减少边缘和不连续区域附近的伪影。此外,该方法生成的稀疏深度图更符合真实传感器的特性,从而使训练数据更具真实性,提升了模型的泛化能力。具体的性能数据和提升幅度未知。

🎯 应用场景

该研究成果可广泛应用于工业机器人、自动驾驶、增强现实等领域。在工业机器人中,高质量的深度图对于物体抓取、装配和检测至关重要。在自动驾驶中,精确的深度信息有助于环境感知和路径规划。在增强现实中,稠密的深度图可以提供更逼真的虚拟现实体验。该研究通过提高深度补全的精度和真实性,为这些应用提供了更可靠的三维感知能力。

📄 摘要(原文)

Accurate three-dimensional perception is essential for modern industrial robotic systems that perform manipulation, inspection, and navigation tasks. RGB-D and stereo vision sensors are widely used for this purpose, but the depth maps they produce are often noisy, incomplete, or biased due to sensor limitations and environmental conditions. Depth completion methods aim to generate dense, reliable depth maps from RGB images and sparse depth input. However, a key limitation in current depth completion pipelines is the unrealistic generation of sparse depth: sparse pixels are typically selected uniformly at random from dense ground-truth depth, ignoring the fact that real sensors exhibit geometry-dependent and spatially nonuniform reliability. In this work, we propose a normal-guided sparse depth sampling strategy that leverages PCA-based surface normal estimation on the RGB-D point cloud to compute a per-pixel depth reliability measure. The sparse depth samples are then drawn according to this reliability distribution. We integrate this sampling method with the Marigold-DC diffusion-based depth completion model and evaluate it on NYU Depth v2 using the standard metrics. Experiments show that our geometry-aware sparse depth improves accuracy, reduces artifacts near edges and discontinuities, and produces more realistic training conditions that better reflect real sensor behavior.