From Orbit to Ground: Generative City Photogrammetry from Extreme Off-Nadir Satellite Images

作者: Fei Yu, Yu Liu, Luyang Tang, Mingchao Sun, Zengye Ge, Rui Bu, Yuchao Jin, Haisen Zhao, He Sun, Yangyan Li, Mu Xu, Wenzheng Chen, Baoquan Chen

分类: cs.CV, cs.GR

发布日期: 2025-12-08 (更新: 2025-12-09)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于生成模型的城市摄影测量方法,从极端倾斜卫星图像合成地面视角。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 卫星图像 三维重建 城市建模 生成模型 摄影测量

📋 核心要点

- 现有方法难以从极端倾斜的卫星图像中重建城市,主要挑战在于视角差距大、图像质量差。

- 该方法将城市几何建模为2.5D高度图,并使用生成纹理恢复网络增强图像外观,从而稳定重建过程。

- 实验表明,该方法能够从少量卫星图像中重建大规模城市区域,并生成逼真的地面视图。

📝 摘要(中文)

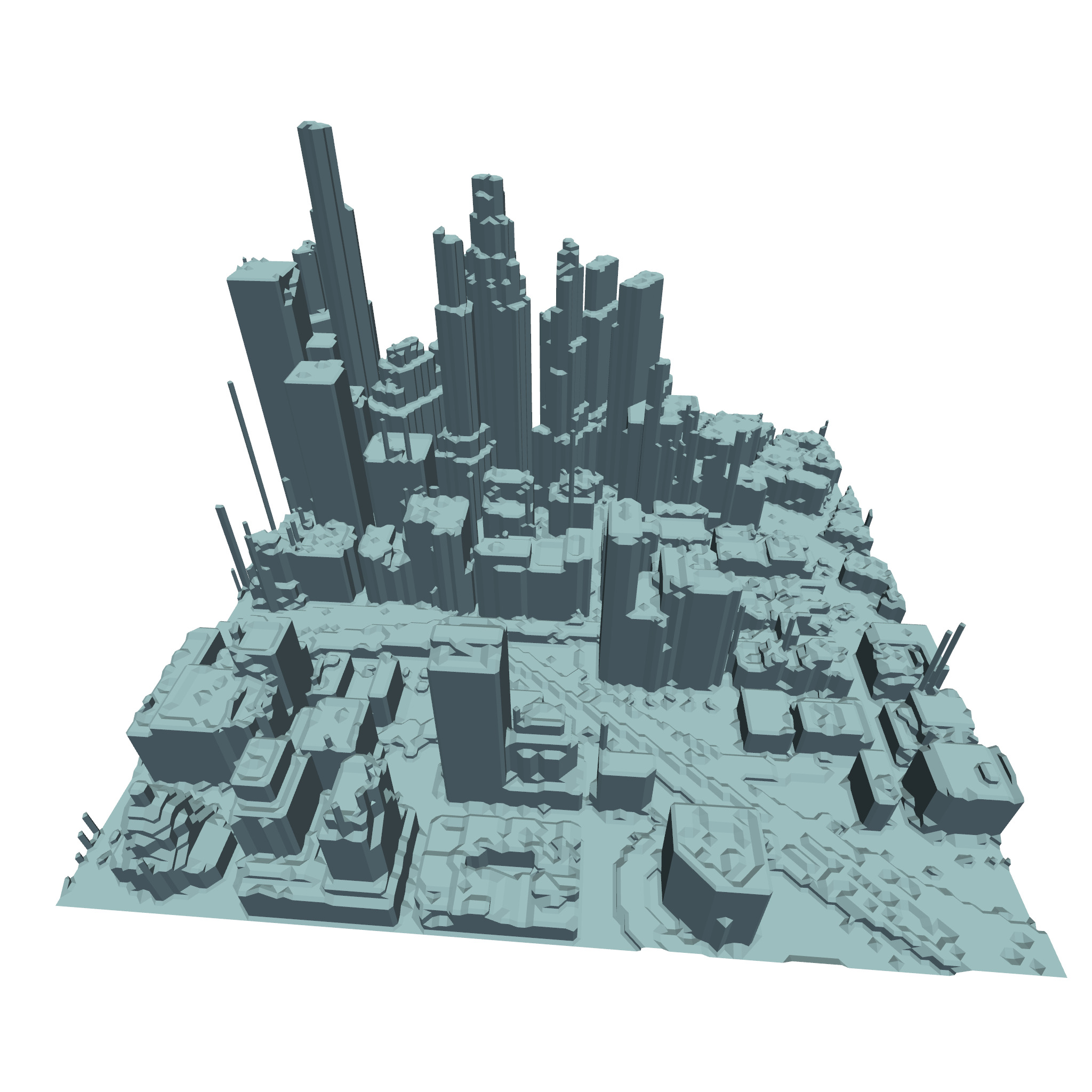

本文提出了一种从卫星图像进行城市级3D重建的方法,旨在从稀疏的轨道图像中合成地面视角,解决极端视角外推问题。该问题需要推断近90°的视角差距,而输入图像存在严重的立面透视缩短和纹理缺陷,导致NeRF和3DGS等现有重建引擎失效。针对城市结构和卫星输入的特点,我们提出了两项关键设计。首先,我们将城市几何建模为2.5D高度图,实现为一个Z轴单调的符号距离场(SDF),以匹配自上而下的城市建筑布局。这稳定了几何优化,生成具有清晰屋顶和垂直拉伸立面的水密网格。其次,我们通过可微渲染技术从卫星图像绘制网格外观。针对卫星图像可能包含远距离模糊图像的问题,我们进一步训练了一个生成纹理恢复网络来增强外观,从退化的输入中恢复高频、逼真的纹理细节。通过大规模城市重建的实验,证明了我们方法的可扩展性和鲁棒性。例如,我们仅使用几张卫星图像重建了一个4平方公里的真实区域,在合成逼真的地面视图方面实现了最先进的性能。生成的模型不仅具有视觉吸引力,而且可以作为高保真、可应用于城市规划和模拟等下游任务的资产。

🔬 方法详解

问题定义:论文旨在解决从极端倾斜角度的卫星图像中进行城市级3D重建的问题。现有方法,如NeRF和3DGS,在处理这种具有严重透视变形和低质量纹理的图像时会失效,无法有效推断地面视角的图像。现有方法难以处理卫星图像的极端视角和质量问题,导致重建效果不佳。

核心思路:论文的核心思路是将城市几何建模为2.5D高度图,并结合生成模型进行纹理恢复。2.5D高度图能够稳定几何优化,生成水密网格,而生成模型则可以从低质量的卫星图像中恢复高频纹理细节。这种结合的方式能够有效应对卫星图像的挑战,实现高质量的城市重建。

技术框架:该方法主要包含两个阶段:几何重建和纹理生成。首先,使用Z轴单调的符号距离场(SDF)表示城市几何,并从卫星图像中优化SDF。然后,使用可微渲染技术将卫星图像投影到重建的几何体上,并训练一个生成纹理恢复网络来增强图像外观。整体流程是从卫星图像到2.5D几何再到高质量纹理的生成。

关键创新:该方法最重要的技术创新点在于将2.5D高度图建模与生成纹理恢复网络相结合。与现有方法相比,该方法能够更好地处理卫星图像的极端视角和质量问题,生成更稳定、更逼真的城市模型。现有方法通常难以处理卫星图像的透视变形和低质量纹理,而该方法通过2.5D几何约束和纹理生成,有效克服了这些问题。

关键设计:在几何重建方面,使用Z轴单调的SDF来表示城市几何,并采用基于梯度的优化方法来拟合卫星图像。在纹理生成方面,设计了一个生成对抗网络(GAN),用于从低质量的卫星图像中恢复高频纹理细节。损失函数包括几何一致性损失、图像重建损失和对抗损失。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

该方法在多个大规模城市区域进行了实验,结果表明,该方法能够从少量卫星图像中重建高质量的城市3D模型,并在合成地面视图方面取得了最先进的性能。例如,仅使用几张卫星图像,就成功重建了一个4平方公里的真实区域,生成的地面视图具有高度的真实感和细节。

🎯 应用场景

该研究成果可应用于城市规划、城市仿真、自动驾驶、虚拟现实等领域。高质量的城市3D模型可以为城市规划提供数据支持,为自动驾驶提供环境感知,为虚拟现实提供逼真的场景。此外,该技术还可以用于灾害评估和应急响应,通过快速重建受灾区域的3D模型,为救援工作提供支持。

📄 摘要(原文)

City-scale 3D reconstruction from satellite imagery presents the challenge of extreme viewpoint extrapolation, where our goal is to synthesize ground-level novel views from sparse orbital images with minimal parallax. This requires inferring nearly $90^\circ$ viewpoint gaps from image sources with severely foreshortened facades and flawed textures, causing state-of-the-art reconstruction engines such as NeRF and 3DGS to fail. To address this problem, we propose two design choices tailored for city structures and satellite inputs. First, we model city geometry as a 2.5D height map, implemented as a Z-monotonic signed distance field (SDF) that matches urban building layouts from top-down viewpoints. This stabilizes geometry optimization under sparse, off-nadir satellite views and yields a watertight mesh with crisp roofs and clean, vertically extruded facades. Second, we paint the mesh appearance from satellite images via differentiable rendering techniques. While the satellite inputs may contain long-range, blurry captures, we further train a generative texture restoration network to enhance the appearance, recovering high-frequency, plausible texture details from degraded inputs. Our method's scalability and robustness are demonstrated through extensive experiments on large-scale urban reconstruction. For example, in our teaser figure, we reconstruct a $4\,\mathrm{km}^2$ real-world region from only a few satellite images, achieving state-of-the-art performance in synthesizing photorealistic ground views. The resulting models are not only visually compelling but also serve as high-fidelity, application-ready assets for downstream tasks like urban planning and simulation. Project page can be found at https://pku-vcl-geometry.github.io/Orbit2Ground/.