MSN: Multi-directional Similarity Network for Hand-crafted and Deep-synthesized Copy-Move Forgery Detection

作者: Liangwei Jiang, Jinluo Xie, Yecheng Huang, Hua Zhang, Hongyu Yang, Di Huang

分类: cs.CV

发布日期: 2025-12-08

💡 一句话要点

提出多方向相似性网络MSN,用于检测手工和深度合成的复制-粘贴图像篡改。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 图像取证 复制-粘贴篡改检测 深度学习 相似性学习 多方向CNN

📋 核心要点

- 现有复制-粘贴篡改检测方法在复杂变换和精细操作下,对篡改区域的表示和定位能力不足,难以有效检测。

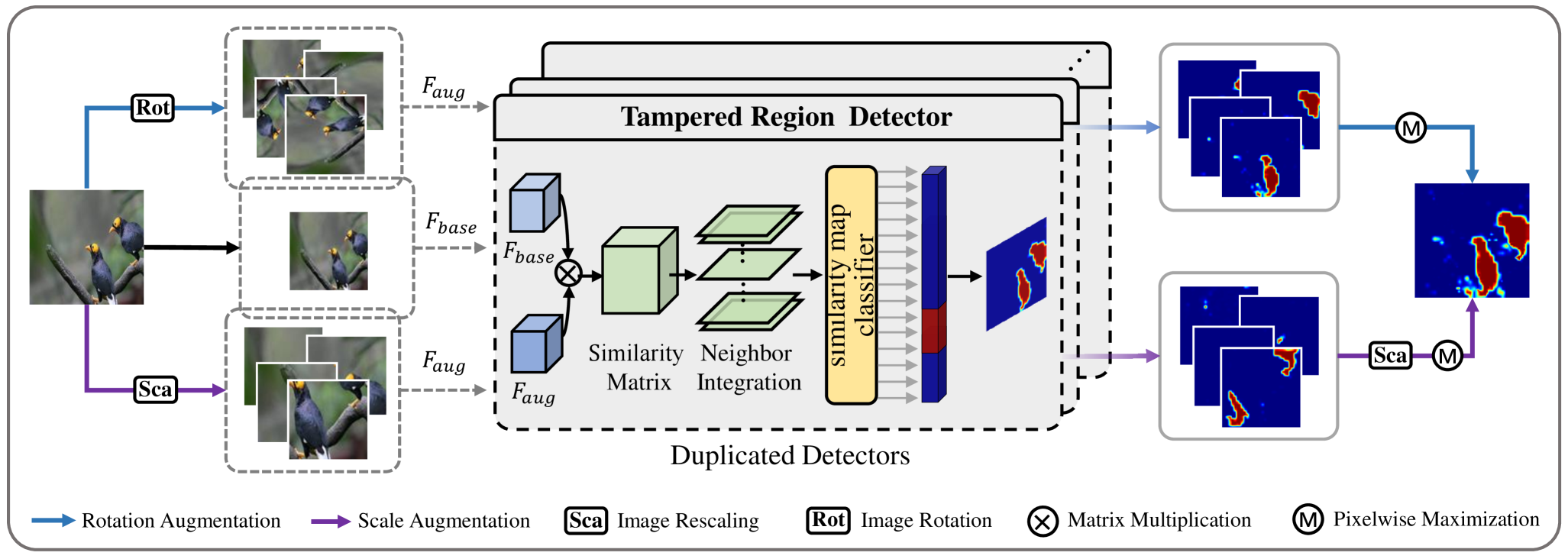

- 提出多方向相似性网络(MSN),通过多方向CNN进行分层特征编码,并设计2D相似性矩阵解码器,提升表示和定位能力。

- 在CASIA CMFD、CoMoFoD以及新构建的深度合成数据集上进行实验,结果表明MSN方法达到了state-of-the-art的性能。

📝 摘要(中文)

复制-粘贴图像篡改旨在通过复制-粘贴操作来复制特定对象或隐藏特定内容,这可以通过一系列手动操作以及最新的基于深度生成网络的交换来实现。对于篡改区域的复杂变换和微调操作,其检测变得越来越具有挑战性。在本文中,我们提出了一种新颖的双流模型,即多方向相似性网络(MSN),用于准确高效的复制-粘贴篡改检测。它分别解决了现有深度检测模型在表示和定位方面的两个主要局限性。在表示方面,图像通过多方向CNN网络进行分层编码,并且由于尺度和旋转方面的各种增强,该特征更好地衡量了两个流中采样块之间的相似性。在定位方面,我们设计了一个基于2-D相似性矩阵的解码器,与当前基于1-D相似性向量的解码器相比,它充分利用了整个图像中的空间信息,从而提高了检测篡改区域的能力。除了该方法之外,还提出了一个由各种深度神经网络生成的新篡改数据库,作为检测日益增长的深度合成复制-粘贴的新基准。在两个经典的图像取证基准(即CASIA CMFD和CoMoFoD)以及新提出的基准上进行了广泛的实验。报告了最先进的结果,证明了所提出方法的有效性。

🔬 方法详解

问题定义:论文旨在解决复制-粘贴图像篡改检测问题,特别是针对手工操作和深度生成网络合成的篡改图像。现有方法在表示篡改区域的复杂变换和精细操作方面存在不足,并且在定位篡改区域时无法充分利用空间信息,导致检测精度不高。

核心思路:论文的核心思路是通过多方向的特征提取增强图像表示能力,并利用2D相似性矩阵充分挖掘空间信息,从而提高篡改区域的检测精度。多方向CNN能够捕捉不同尺度和旋转角度的特征,增强了对复杂变换的鲁棒性。2D相似性矩阵能够更好地利用图像的空间上下文信息,提高定位精度。

技术框架:MSN模型是一个双流网络,包含以下主要模块:1) 多方向CNN编码器:用于提取图像的多尺度、多方向特征。2) 特征相似性计算模块:计算两个流中特征块之间的相似性。3) 2D相似性矩阵解码器:利用相似性矩阵进行篡改区域的定位。整个流程是,输入图像经过双流网络提取特征,计算特征相似性,然后通过2D相似性矩阵解码器得到篡改区域的预测结果。

关键创新:论文的关键创新在于:1) 提出了多方向CNN,增强了对复杂变换的鲁棒性。2) 设计了2D相似性矩阵解码器,充分利用了空间信息,提高了定位精度。3) 构建了一个新的深度合成复制-粘贴篡改数据集,为该领域的研究提供了新的基准。

关键设计:多方向CNN的具体实现细节(例如卷积核大小、层数等)未知。2D相似性矩阵解码器的具体结构和损失函数未知。论文中提到了数据增强策略,包括尺度和旋转变换,但具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MSN方法在CASIA CMFD、CoMoFoD以及新构建的深度合成数据集上均取得了state-of-the-art的性能。具体性能数据和提升幅度在摘要中未明确给出,但强调了相对于现有方法的显著优势。新数据集的构建也为深度合成图像篡改检测提供了新的基准。

🎯 应用场景

该研究成果可应用于数字图像取证、信息安全、版权保护等领域。通过检测图像中的复制-粘贴篡改,可以帮助识别伪造图像,维护信息的真实性和可靠性。未来,该技术可以集成到图像编辑软件、社交媒体平台等,自动检测和预警潜在的篡改行为。

📄 摘要(原文)

Copy-move image forgery aims to duplicate certain objects or to hide specific contents with copy-move operations, which can be achieved by a sequence of manual manipulations as well as up-to-date deep generative network-based swapping. Its detection is becoming increasingly challenging for the complex transformations and fine-tuned operations on the tampered regions. In this paper, we propose a novel two-stream model, namely Multi-directional Similarity Network (MSN), to accurate and efficient copy-move forgery detection. It addresses the two major limitations of existing deep detection models in \textbf{representation} and \textbf{localization}, respectively. In representation, an image is hierarchically encoded by a multi-directional CNN network, and due to the diverse augmentation in scales and rotations, the feature achieved better measures the similarity between sampled patches in two streams. In localization, we design a 2-D similarity matrix based decoder, and compared with the current 1-D similarity vector based one, it makes full use of spatial information in the entire image, leading to the improvement in detecting tampered regions. Beyond the method, a new forgery database generated by various deep neural networks is presented, as a new benchmark for detecting the growing deep-synthesized copy-move. Extensive experiments are conducted on two classic image forensics benchmarks, \emph{i.e.} CASIA CMFD and CoMoFoD, and the newly presented one. The state-of-the-art results are reported, which demonstrate the effectiveness of the proposed approach.