MeshSplatting: Differentiable Rendering with Opaque Meshes

作者: Jan Held, Sanghyun Son, Renaud Vandeghen, Daniel Rebain, Matheus Gadelha, Yi Zhou, Anthony Cioppa, Ming C. Lin, Marc Van Droogenbroeck, Andrea Tagliasacchi

分类: cs.CV

发布日期: 2025-12-07

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出MeshSplatting,通过可微渲染优化网格几何与外观,实现实时新视角合成。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 可微渲染 网格重建 新视角合成 神经渲染 实时渲染

📋 核心要点

- 基于点的splatting方法虽然实现了实时渲染,但与AR/VR和游戏引擎中常用的网格管线不兼容。

- MeshSplatting通过可微渲染联合优化网格的几何体和外观,并强制网格连接性和表面一致性。

- 实验表明,MeshSplatting在Mip-NeRF360数据集上优于现有方法,且训练更快、内存占用更少。

📝 摘要(中文)

本文提出了一种基于网格的重建方法MeshSplatting,它通过可微渲染联合优化几何体和外观。MeshSplatting通过限制Delaunay三角剖分来强制连接性,并细化表面一致性,从而创建端到端平滑、视觉高质量的网格,这些网格可以在实时3D引擎中高效渲染。在Mip-NeRF360数据集上,MeshSplatting相比当前最先进的基于网格的新视角合成方法MiLo,PSNR提高了+0.69 dB,同时训练速度提高了2倍,内存使用量减少了2倍,从而将神经渲染与交互式3D图形连接起来,以实现无缝的实时场景交互。

🔬 方法详解

问题定义:现有基于点的splatting方法,如3D Gaussian Splatting,虽然在实时渲染的新视角合成方面取得了显著进展,但它们与传统的基于网格的渲染管线不兼容。这限制了它们在AR/VR和游戏引擎等领域的应用。因此,需要一种能够生成高质量、可高效渲染的网格模型的方法。

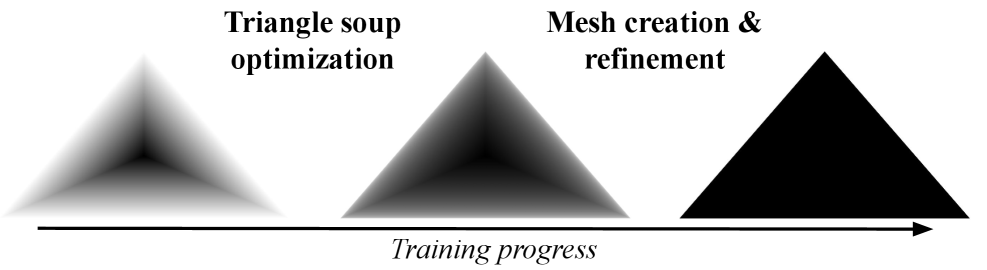

核心思路:MeshSplatting的核心思路是通过可微渲染来联合优化网格的几何体和外观。通过这种方式,可以直接从图像数据中学习得到高质量的网格模型,而无需依赖中间的表面重建步骤。此外,通过强制网格的连接性和表面一致性,可以进一步提高网格的质量和渲染效率。

技术框架:MeshSplatting的整体框架包括以下几个主要步骤:1) 初始化一个网格模型;2) 使用可微渲染器将网格模型渲染成图像;3) 计算渲染图像与目标图像之间的损失;4) 使用梯度下降法更新网格的几何体和外观参数。该框架的关键在于可微渲染器的设计,它需要能够计算渲染过程对网格参数的梯度。

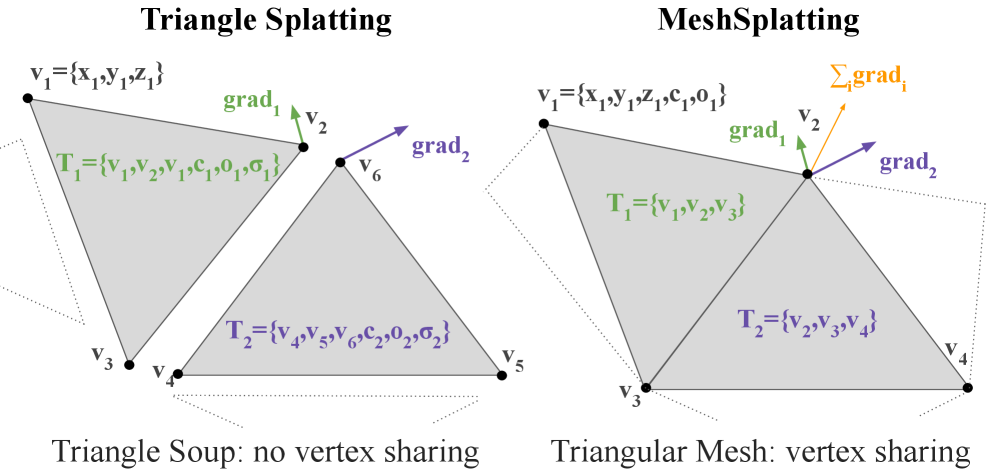

关键创新:MeshSplatting的关键创新在于其基于网格的可微渲染方法。与传统的基于点的splatting方法不同,MeshSplatting直接优化网格的几何体和外观,从而生成可以直接在现有3D引擎中使用的网格模型。此外,MeshSplatting还引入了限制Delaunay三角剖分来强制连接性,并细化表面一致性,进一步提高了网格的质量。

关键设计:MeshSplatting的关键设计包括:1) 使用可微的Delaunay三角剖分来维护网格的拓扑结构;2) 使用基于物理的渲染模型来模拟光照效果;3) 使用多种损失函数来约束网格的几何体和外观,包括图像重建损失、表面平滑损失和法线一致性损失。

🖼️ 关键图片

📊 实验亮点

MeshSplatting在Mip-NeRF360数据集上取得了显著的性能提升,相比于当前最先进的基于网格的新视角合成方法MiLo,PSNR提高了+0.69 dB。同时,MeshSplatting的训练速度提高了2倍,内存使用量减少了2倍。这些结果表明,MeshSplatting是一种高效且高质量的网格重建方法。

🎯 应用场景

MeshSplatting具有广泛的应用前景,包括AR/VR、游戏开发、机器人导航、三维重建等领域。它可以用于创建高质量的3D场景模型,并实现实时的交互式渲染。该技术有望推动神经渲染在实际应用中的普及,并促进虚拟世界与现实世界的融合。

📄 摘要(原文)

Primitive-based splatting methods like 3D Gaussian Splatting have revolutionized novel view synthesis with real-time rendering. However, their point-based representations remain incompatible with mesh-based pipelines that power AR/VR and game engines. We present MeshSplatting, a mesh-based reconstruction approach that jointly optimizes geometry and appearance through differentiable rendering. By enforcing connectivity via restricted Delaunay triangulation and refining surface consistency, MeshSplatting creates end-to-end smooth, visually high-quality meshes that render efficiently in real-time 3D engines. On Mip-NeRF360, it boosts PSNR by +0.69 dB over the current state-of-the-art MiLo for mesh-based novel view synthesis, while training 2x faster and using 2x less memory, bridging neural rendering and interactive 3D graphics for seamless real-time scene interaction. The project page is available at https://meshsplatting.github.io/.