CoT4Det: A Chain-of-Thought Framework for Perception-Oriented Vision-Language Tasks

作者: Yu Qi, Yumeng Zhang, Chenting Gong, Xiao Tan, Weiming Zhang, Wei Zhang, Jingdong Wang

分类: cs.CV

发布日期: 2025-12-07

💡 一句话要点

CoT4Det:面向感知型视觉-语言任务的思维链框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 目标检测 思维链 感知任务 大模型 多模态学习 推理能力

📋 核心要点

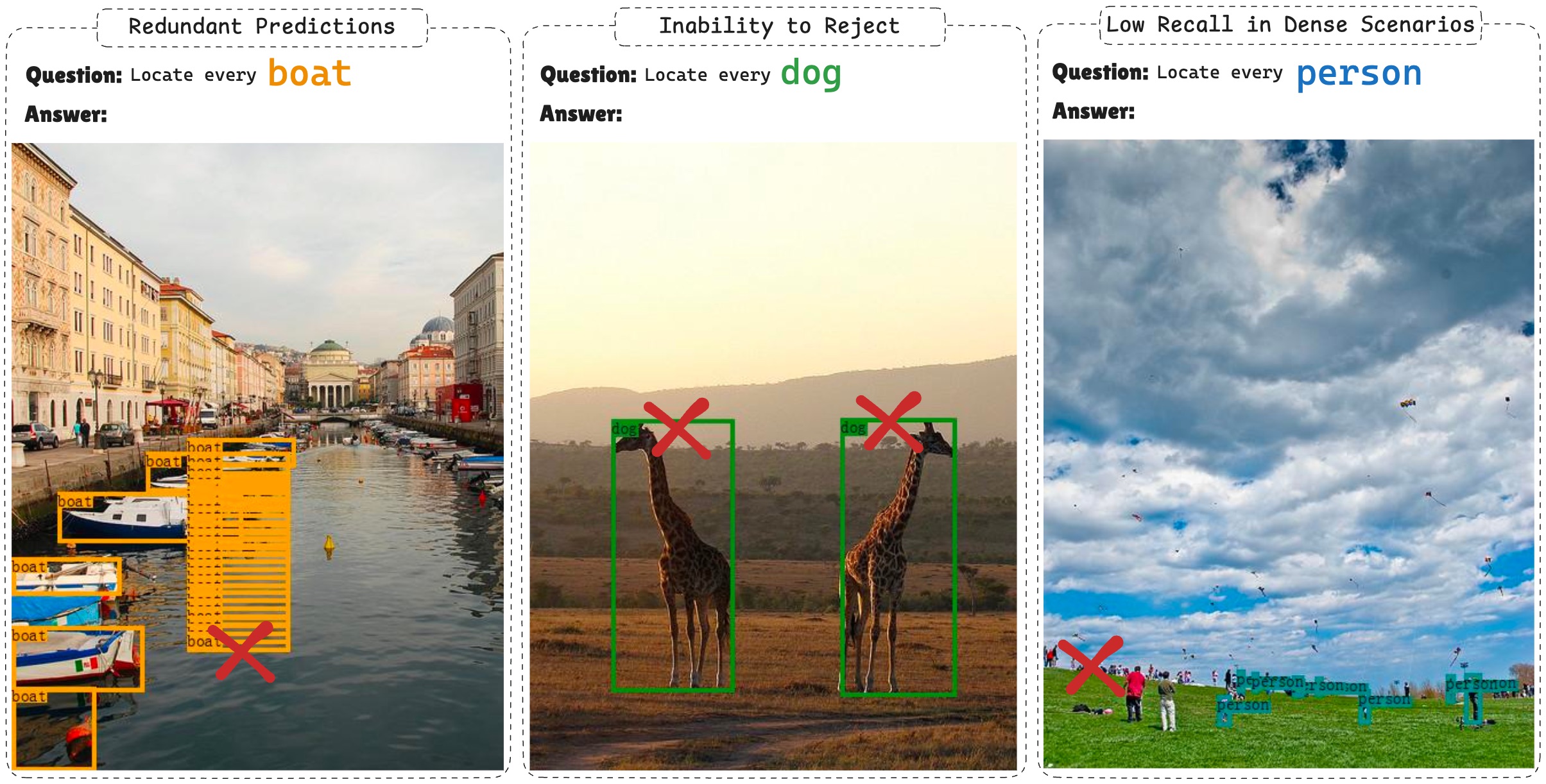

- 现有LVLM在感知任务上表现不佳,尤其在密集场景和小目标检测方面存在挑战。

- CoT4Det将感知任务分解为分类、计数和定位三个步骤,更符合LVLM的推理能力。

- 实验表明,CoT4Det显著提升了感知性能,同时保持了通用视觉语言能力。

📝 摘要(中文)

大型视觉-语言模型(LVLMs)在广泛的视觉-语言任务中表现出了卓越的性能,例如通用视觉问答和光学字符识别(OCR)。然而,它们在以感知为中心任务(如目标检测、语义分割和深度估计)上的性能明显低于特定任务的专家模型。例如,Qwen2.5-VL-7B-Instruct在COCO2017 val上仅达到19%的mAP,尤其是在密集场景和小目标召回方面表现不佳。本文提出了一种简单而有效的策略——检测思维链(CoT4Det),它将感知任务重新构建为三个可解释的步骤:分类、计数和定位,每个步骤都更自然地与LVLM的推理能力相一致。大量实验表明,该方法在不影响通用视觉语言能力的前提下,显著提高了感知性能。使用标准的Qwen2.5-VL-7B-Instruct,CoT4Det将COCO2017 val上的mAP从19.0%提高到33.0%,并在各种感知基准测试中取得了有竞争力的结果,在RefCOCO系列上优于基线+2%,在Flickr30k实体上优于基线19%。

🔬 方法详解

问题定义:现有的大型视觉-语言模型(LVLM)在通用视觉语言任务中表现出色,但在目标检测、语义分割等感知任务中,性能远低于专门的模型。尤其是在处理包含大量目标或小目标的复杂场景时,LVLM的检测精度和召回率显著下降,难以满足实际应用的需求。

核心思路:CoT4Det的核心思想是将复杂的感知任务分解为更简单的、更符合LVLM推理能力的子任务。通过模仿人类解决问题的思维过程,将目标检测任务分解为“分类(识别目标类别)”、“计数(确定目标数量)”和“定位(确定目标位置)”三个步骤。这种分解使得LVLM能够逐步推理,从而提高感知性能。

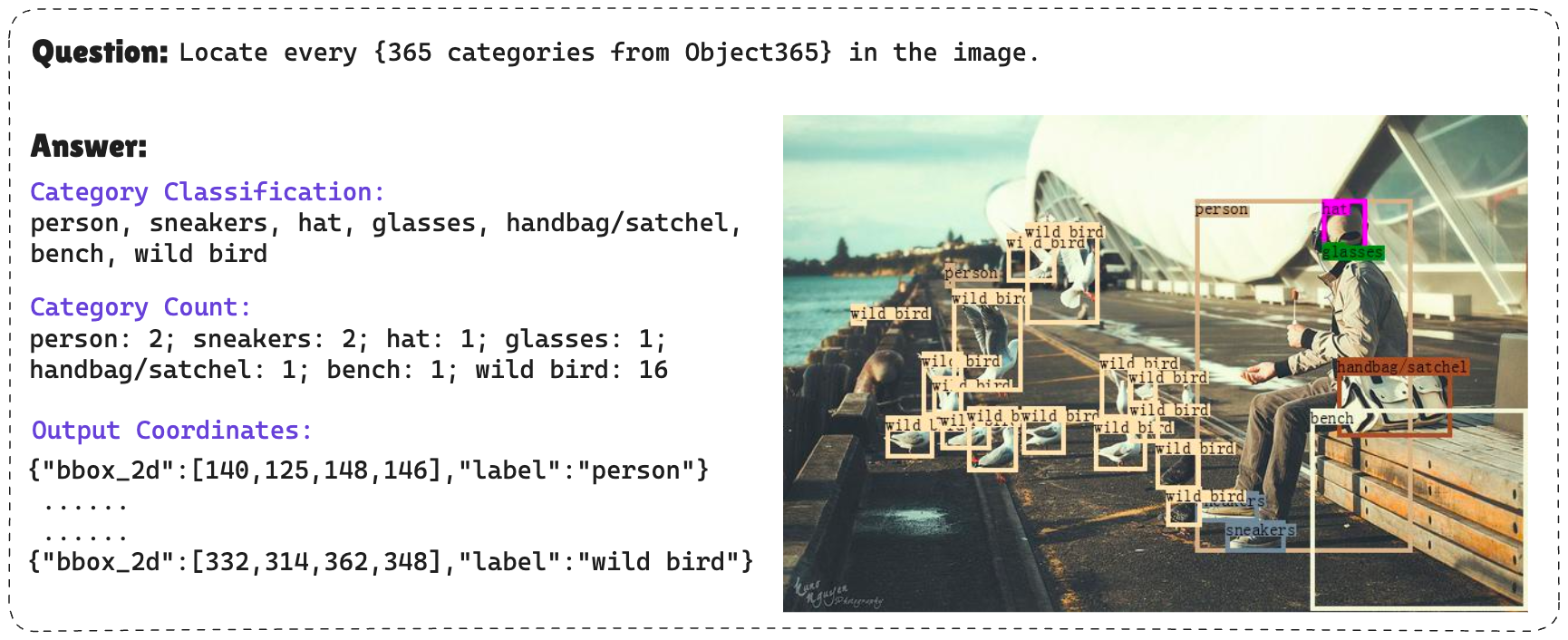

技术框架:CoT4Det的整体框架包含三个主要阶段:1) 分类阶段:LVLM首先识别图像中存在的物体类别。2) 计数阶段:LVLM确定每个类别的物体数量。3) 定位阶段:LVLM根据前两个阶段的结果,定位每个物体的位置,输出边界框坐标。这三个阶段可以顺序执行,形成一个思维链,引导LVLM逐步完成目标检测任务。

关键创新:CoT4Det的关键创新在于将复杂的感知任务分解为更易于LVLM处理的子任务,并利用思维链的方式引导LVLM进行推理。与直接让LVLM预测目标位置相比,CoT4Det通过分类和计数两个中间步骤,显著提高了检测精度和召回率。

关键设计:CoT4Det的关键设计包括:1) 使用特定的prompt来引导LVLM执行分类、计数和定位任务。2) 针对不同的数据集和任务,调整prompt的内容和格式,以获得最佳性能。3) 可以结合不同的LVLM,例如Qwen2.5-VL-7B-Instruct,来验证CoT4Det的有效性。具体的损失函数和网络结构取决于所使用的LVLM。

🖼️ 关键图片

📊 实验亮点

CoT4Det在COCO2017 val数据集上将Qwen2.5-VL-7B-Instruct的mAP从19.0%提升到33.0%,显著提高了目标检测性能。此外,CoT4Det在RefCOCO系列数据集上优于基线2%,在Flickr30k实体数据集上优于基线19%,表明其在各种感知基准测试中具有竞争力。

🎯 应用场景

CoT4Det具有广泛的应用前景,可应用于智能监控、自动驾驶、机器人导航、医学图像分析等领域。通过提高LVLM在感知任务中的性能,CoT4Det可以使这些应用更加可靠和高效。未来,CoT4Det可以进一步扩展到其他感知任务,例如语义分割和深度估计,从而构建更强大的视觉-语言系统。

📄 摘要(原文)

Large Vision-Language Models (LVLMs) have demonstrated remarkable success in a broad range of vision-language tasks, such as general visual question answering and optical character recognition (OCR). However, their performance on perception-centric tasks -- such as object detection, semantic segmentation, and depth estimation -- remains significantly inferior to that of task-specific expert models. For example, Qwen2.5-VL-7B-Instruct achieves only 19% mAP on COCO2017 val, particularly struggling with dense scenes and small object recall. In this work, we introduce Chain-of-Thought for Detection (CoT4Det), a simple but efficient strategy that reformulates perception tasks into three interpretable steps: classification, counting, and grounding -- each more naturally aligned with the reasoning capabilities of LVLMs. Extensive experiments demonstrate that our method significantly improves perception performance without compromising general vision language capabilities. With a standard Qwen2.5-VL-7B-Instruct, CoT4Det boosts mAP from 19.0% to 33.0% on COCO2017 val and achieves competitive results across a variety of perception benchmarks, outperforming baselines by +2% on RefCOCO series and 19% on Flickr30k entities.