DragMesh: Interactive 3D Generation Made Easy

作者: Tianshan Zhang, Zeyu Zhang, Hao Tang

分类: cs.CV

发布日期: 2025-12-06

🔗 代码/项目: GITHUB | PROJECT_PAGE

💡 一句话要点

DragMesh:提出解耦运动生成框架,实现实时交互式3D物体可动性生成

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 3D生成 可动性生成 运动学推理 对偶四元数 VAE 实时交互 解耦框架

📋 核心要点

- 现有铰接运动方法难以兼顾物理一致性和实时性,且生成式方法常违反运动学约束。

- DragMesh提出解耦的运动学推理和运动生成框架,利用KPP-Net预测关节参数,DQ-VAE生成运动轨迹。

- DragMesh实现了实时交互式3D铰接,无需对新物体进行重新训练,朝着生成式3D智能迈出一步。

📝 摘要(中文)

生成模型在创建静态3D内容方面表现出色,但构建能够理解物体如何移动和响应交互的系统仍然是一个根本性的挑战。目前,用于铰接运动的方法正处于十字路口:它们要么在物理上一致但速度太慢而无法实时使用,要么是生成式的但违反了基本的运动学约束。我们提出了DragMesh,这是一个强大的框架,用于实时交互式3D铰接,围绕轻量级运动生成核心构建。我们的核心贡献是一种新颖的解耦运动学推理和运动生成框架。首先,我们通过将语义意图推理(确定关节类型)与几何回归(使用我们的运动学预测网络(KPP-Net)确定轴和原点)解耦来推断潜在的关节参数。其次,为了利用对偶四元数的紧凑、连续和无奇异性的特性来表示刚体运动,我们开发了一种新颖的对偶四元数VAE(DQ-VAE)。该DQ-VAE接收这些预测的先验,以及原始的用户拖动,以生成完整的、合理的运动轨迹。为了确保严格遵守运动学,我们使用FiLM(特征线性调制)条件作用将关节先验注入到DQ-VAE非自回归Transformer解码器的每一层。这种持久的、多尺度的指导通过数值稳定的叉积损失来补充,以保证轴对齐。这种解耦设计允许DragMesh实现实时性能,并能够在不重新训练的情况下对新物体进行合理的生成式铰接,为生成式3D智能提供了一个实际的步骤。

🔬 方法详解

问题定义:现有方法在处理3D物体的可动性生成时,要么计算复杂度高,难以达到实时性要求;要么是基于生成模型,但生成的运动不符合基本的运动学约束,例如关节错位、运动不自然等。因此,如何实现既能保证运动学合理性,又能达到实时交互的3D物体可动性生成是一个关键问题。

核心思路:DragMesh的核心思路是将运动学推理和运动生成解耦。首先,通过一个专门的网络(KPP-Net)预测物体的关节类型、轴和原点等运动学参数。然后,利用这些参数作为先验信息,指导一个基于对偶四元数VAE(DQ-VAE)的生成模型生成完整的运动轨迹。这种解耦的设计使得模型可以专注于运动生成,同时保证运动的合理性。

技术框架:DragMesh的整体框架包含两个主要模块:运动学预测网络(KPP-Net)和对偶四元数VAE(DQ-VAE)。首先,用户通过拖拽操作提供交互输入。KPP-Net接收输入,预测物体的关节参数。然后,DQ-VAE接收KPP-Net的预测结果和用户的拖拽输入,生成完整的运动轨迹。为了保证运动学约束,KPP-Net的预测结果被注入到DQ-VAE的每一层,并通过一个叉积损失函数来保证轴对齐。

关键创新:DragMesh的关键创新在于解耦的运动学推理和运动生成框架,以及对偶四元数VAE(DQ-VAE)的应用。通过解耦,模型可以分别处理运动学约束和运动生成,从而提高效率和生成质量。DQ-VAE利用对偶四元数的紧凑、连续和无奇异性特性,更好地表示刚体运动。

关键设计:KPP-Net使用几何回归来预测关节的轴和原点。DQ-VAE使用非自回归Transformer解码器,并在每一层使用FiLM(Feature-wise Linear Modulation)条件作用注入KPP-Net的预测结果。此外,为了保证轴对齐,模型使用了一个数值稳定的叉积损失函数。这些设计保证了生成的运动轨迹既符合运动学约束,又具有良好的生成质量。

🖼️ 关键图片

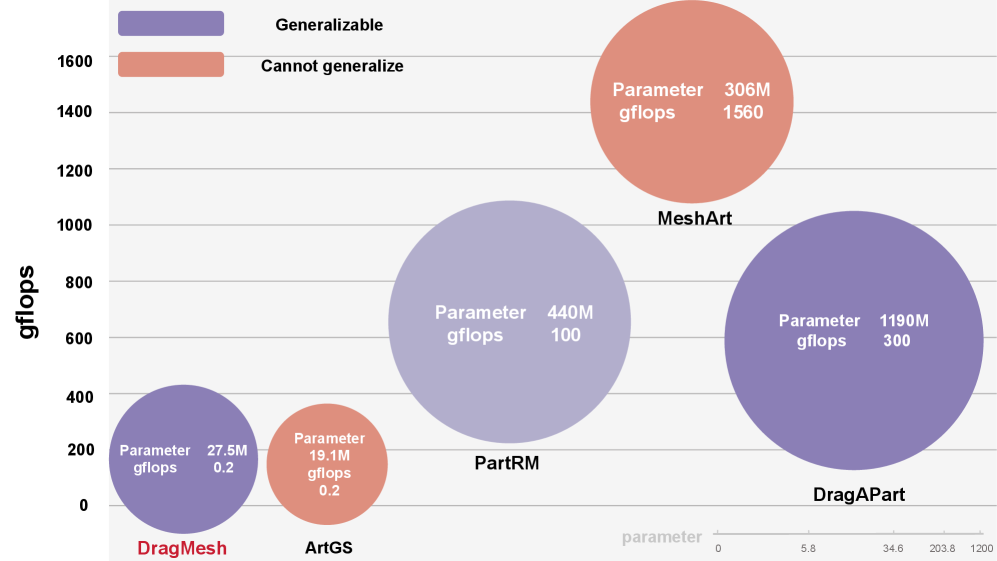

📊 实验亮点

DragMesh实现了实时交互式3D铰接,可以在不重新训练的情况下对新物体进行操作。通过解耦运动学推理和运动生成,DragMesh在保证运动学合理性的同时,实现了实时性能。具体性能数据未知,但论文强调了其在实时性和泛化性方面的优势。

🎯 应用场景

DragMesh可应用于游戏开发、虚拟现实、机器人控制等领域。例如,在游戏开发中,可以快速生成角色或物体的动画,提高开发效率。在虚拟现实中,用户可以与虚拟物体进行交互,并观察到物体的自然运动。在机器人控制中,可以生成机器人的运动轨迹,实现更复杂的任务。

📄 摘要(原文)

While generative models have excelled at creating static 3D content, the pursuit of systems that understand how objects move and respond to interactions remains a fundamental challenge. Current methods for articulated motion lie at a crossroads: they are either physically consistent but too slow for real-time use, or generative but violate basic kinematic constraints. We present DragMesh, a robust framework for real-time interactive 3D articulation built around a lightweight motion generation core. Our core contribution is a novel decoupled kinematic reasoning and motion generation framework. First, we infer the latent joint parameters by decoupling semantic intent reasoning (which determines the joint type) from geometric regression (which determines the axis and origin using our Kinematics Prediction Network (KPP-Net)). Second, to leverage the compact, continuous, and singularity-free properties of dual quaternions for representing rigid body motion, we develop a novel Dual Quaternion VAE (DQ-VAE). This DQ-VAE receives these predicted priors, along with the original user drag, to generate a complete, plausible motion trajectory. To ensure strict adherence to kinematics, we inject the joint priors at every layer of the DQ-VAE's non-autoregressive Transformer decoder using FiLM (Feature-wise Linear Modulation) conditioning. This persistent, multi-scale guidance is complemented by a numerically-stable cross-product loss to guarantee axis alignment. This decoupled design allows DragMesh to achieve real-time performance and enables plausible, generative articulation on novel objects without retraining, offering a practical step toward generative 3D intelligence. Code: https://github.com/AIGeeksGroup/DragMesh. Website: https://aigeeksgroup.github.io/DragMesh.