SplatPainter: Interactive Authoring of 3D Gaussians from 2D Edits via Test-Time Training

作者: Yang Zheng, Hao Tan, Kai Zhang, Peng Wang, Leonidas Guibas, Gordon Wetzstein, Wang Yifan

分类: cs.CV, cs.GR

发布日期: 2025-12-05

备注: project page https://y-zheng18.github.io/SplatPainter/

💡 一句话要点

SplatPainter:基于测试时训练,通过2D编辑交互式创作3D高斯模型

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 交互式编辑 测试时训练 状态感知模型 3D内容创作

📋 核心要点

- 现有3D高斯模型编辑方法速度慢、破坏模型特征,且缺乏精细控制能力,难以满足交互式编辑需求。

- SplatPainter通过状态感知的feedforward模型,直接预测高斯参数更新,实现快速、精确的3D模型编辑。

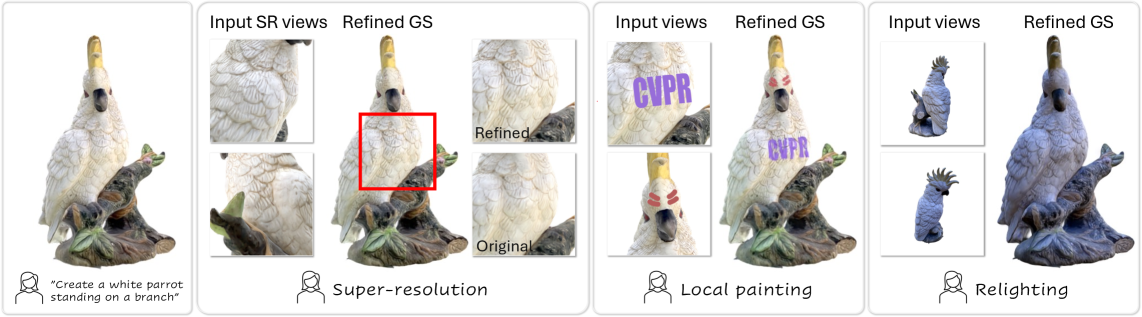

- 该方法支持局部细节优化、绘制和全局颜色调整等多种编辑任务,并达到交互级别的速度。

📝 摘要(中文)

3D高斯溅射技术极大地推动了照片级真实感3D资产的创建,但交互式优化和编辑方面仍存在关键缺口。现有的基于扩散或优化的方法不适用于此任务,因为它们通常速度慢、破坏原始资产的特征,或缺乏精细控制的精度。为了解决这个问题,我们提出了一种状态感知的feedforward模型,可以通过用户提供的2D视图连续编辑3D高斯资产。我们的方法直接预测对紧凑、特征丰富的高斯表示的属性更新,并利用测试时训练来创建状态感知的迭代工作流程。该方法的多功能性允许单个架构执行各种任务,包括高保真局部细节优化、局部绘制和一致的全局重新着色,所有这些都以交互速度进行,为流畅和直观的3D内容创作铺平了道路。

🔬 方法详解

问题定义:论文旨在解决3D高斯溅射模型交互式编辑的问题。现有方法,如基于扩散模型或优化的方法,在速度、精度和对原始模型特征的保持方面存在不足,难以实现快速、精细的编辑。

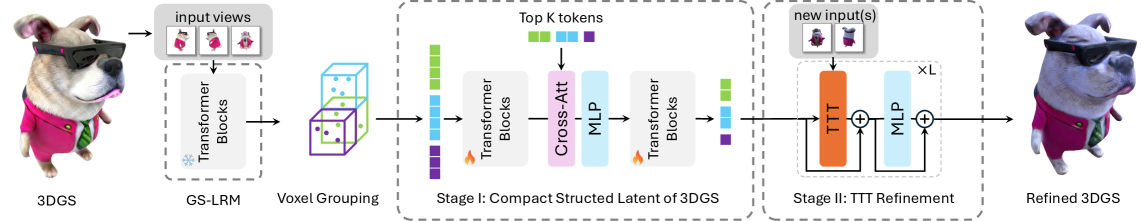

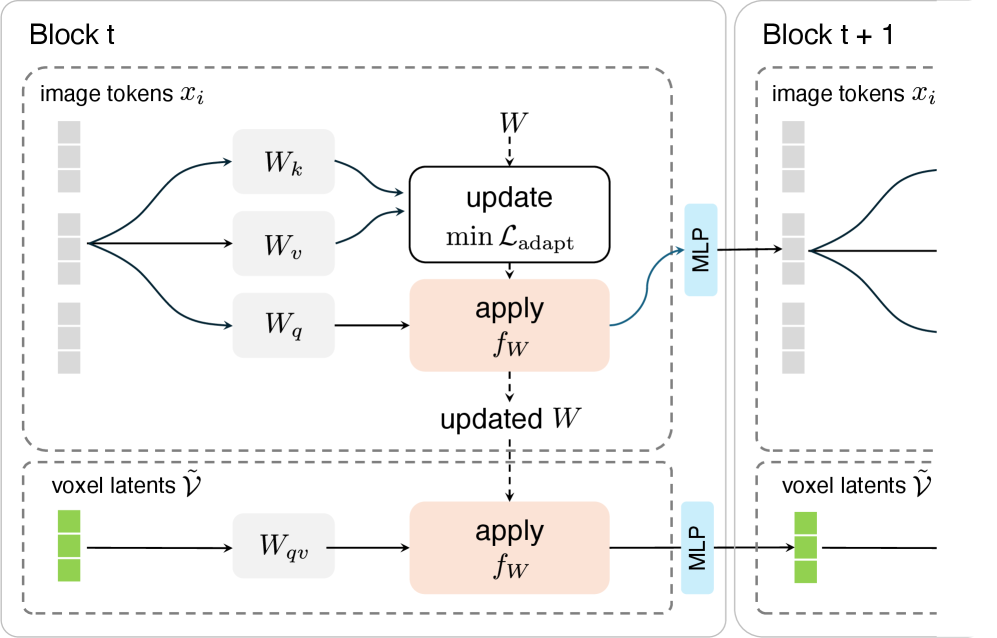

核心思路:论文的核心思路是利用一个状态感知的feedforward模型,直接预测3D高斯模型的参数更新。通过测试时训练(Test-Time Training),模型能够根据用户的编辑操作和当前模型状态进行迭代优化,从而实现快速、精确的编辑。

技术框架:整体框架包含以下几个主要步骤:1) 用户在2D视图中进行编辑操作(如绘制、选择区域等);2) 编辑操作被输入到状态感知的feedforward模型中;3) 模型预测3D高斯模型的参数更新;4) 根据预测的更新调整3D高斯模型;5) 渲染更新后的3D模型,并显示给用户。这个过程可以迭代进行,直到用户满意为止。

关键创新:最重要的技术创新点在于使用状态感知的feedforward模型和测试时训练。与传统的优化方法相比,该方法能够直接预测参数更新,避免了耗时的优化过程。测试时训练使得模型能够根据用户的具体编辑操作进行自适应调整,提高了编辑的精度和效率。此外,使用紧凑、特征丰富的高斯表示也有助于提高模型的性能。

关键设计:模型使用一个feedforward神经网络,输入包括用户的编辑操作(如2D绘制的mask、颜色等)和当前3D高斯模型的特征表示。网络的输出是3D高斯模型参数的更新量。损失函数的设计需要考虑编辑的精度和对原始模型特征的保持。测试时训练过程中,可以使用户提供的编辑操作作为监督信号,对模型进行微调。具体的网络结构和参数设置需要根据具体的应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

SplatPainter实现了交互级别的3D高斯模型编辑速度,显著优于现有的基于扩散或优化的方法。该方法支持多种编辑任务,包括局部细节优化、绘制和全局颜色调整,并且能够保持原始模型的特征。实验结果表明,SplatPainter能够生成高质量的编辑结果,并且具有良好的用户体验。

🎯 应用场景

该研究成果可广泛应用于3D内容创作、游戏开发、虚拟现实、增强现实等领域。用户可以利用该方法快速、直观地编辑3D模型,例如调整模型的颜色、形状、细节等。该方法还可以用于修复和改进现有的3D模型,提高3D资产的质量和效率。未来,该技术有望成为3D内容创作的重要工具。

📄 摘要(原文)

The rise of 3D Gaussian Splatting has revolutionized photorealistic 3D asset creation, yet a critical gap remains for their interactive refinement and editing. Existing approaches based on diffusion or optimization are ill-suited for this task, as they are often prohibitively slow, destructive to the original asset's identity, or lack the precision for fine-grained control. To address this, we introduce \ourmethod, a state-aware feedforward model that enables continuous editing of 3D Gaussian assets from user-provided 2D view(s). Our method directly predicts updates to the attributes of a compact, feature-rich Gaussian representation and leverages Test-Time Training to create a state-aware, iterative workflow. The versatility of our approach allows a single architecture to perform diverse tasks, including high-fidelity local detail refinement, local paint-over, and consistent global recoloring, all at interactive speeds, paving the way for fluid and intuitive 3D content authoring.