Joint 3D Geometry Reconstruction and Motion Generation for 4D Synthesis from a Single Image

作者: Yanran Zhang, Ziyi Wang, Wenzhao Zheng, Zheng Zhu, Jie Zhou, Jiwen Lu

分类: cs.CV

发布日期: 2025-12-04

备注: 18 Pages

🔗 代码/项目: GITHUB

💡 一句话要点

提出MoRe4D,联合进行3D几何重建和运动生成,从单张图像合成4D场景。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 4D场景生成 几何重建 运动生成 扩散模型 单视图重建

📋 核心要点

- 现有方法在单图生成4D场景时,常将几何与运动解耦,导致时空不一致和泛化性差。

- MoRe4D联合进行运动生成和几何重建,利用深度信息引导运动归一化,实现几何与动态的有效集成。

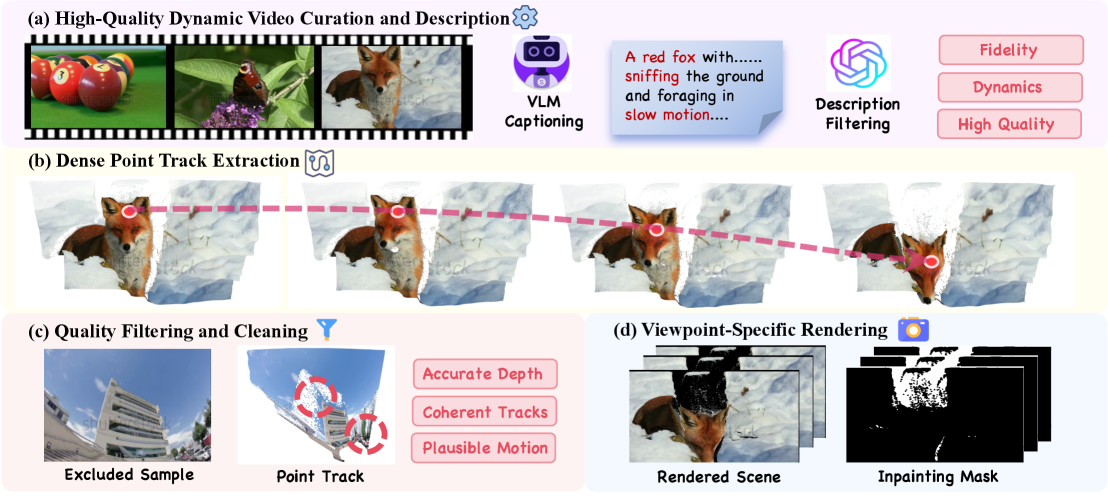

- 论文构建了大规模4D场景数据集TrajScene-60K,实验证明MoRe4D能生成高质量、多视角一致的4D场景。

📝 摘要(中文)

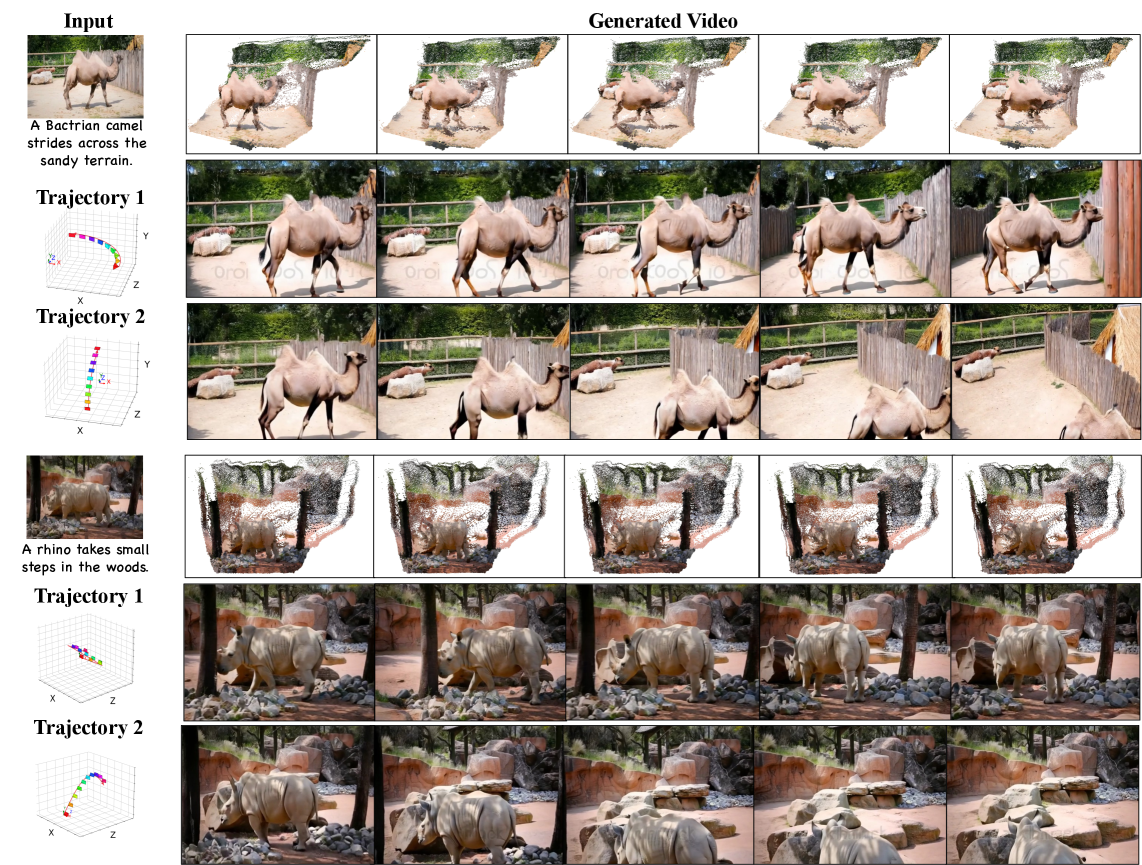

从单张静态图像生成交互式和动态的4D场景仍然是一个核心挑战。现有的大多数先生成后重建以及先重建后生成的方法将几何与运动解耦,导致时空不一致和泛化能力差。为了解决这些问题,我们扩展了先重建后生成的框架,联合进行运动生成和几何重建,用于4D合成(MoRe4D)。我们首先引入了TrajScene-60K,一个包含60,000个视频样本的大规模数据集,具有密集的点轨迹,解决了高质量4D场景数据稀缺的问题。基于此,我们提出了一个基于扩散的4D场景轨迹生成器(4D-STraG),以联合生成几何一致和运动合理的4D点轨迹。为了利用单视图先验,我们设计了一种深度引导的运动归一化策略和一个运动感知模块,用于有效的几何和动态集成。然后,我们提出了一个4D视图合成模块(4D-ViSM),用于从4D点轨迹表示渲染具有任意相机轨迹的视频。实验表明,MoRe4D从单张图像生成具有多视图一致性和丰富动态细节的高质量4D场景。

🔬 方法详解

问题定义:现有方法在从单张图像生成4D动态场景时,通常将3D几何重建和运动生成两个步骤解耦,导致生成的结果在时空上不一致,并且泛化能力较差。核心痛点在于如何有效地将单视图图像中的几何信息与动态运动信息结合起来,生成逼真且一致的4D场景。

核心思路:MoRe4D的核心思路是联合进行3D几何重建和运动生成,避免了传统方法中几何和运动信息分离的问题。通过深度引导的运动归一化策略和运动感知模块,将单视图图像中的深度信息融入到运动生成过程中,从而保证生成结果的几何一致性和运动合理性。这样设计的目的是为了克服单视图信息不足的挑战,并提高生成4D场景的真实感。

技术框架:MoRe4D的整体框架包含三个主要模块:1) 4D场景轨迹生成器(4D-STraG):基于扩散模型,用于联合生成几何一致和运动合理的4D点轨迹。2) 深度引导的运动归一化策略和运动感知模块:利用单视图深度信息,将几何信息融入到运动生成过程中。3) 4D视图合成模块(4D-ViSM):用于从4D点轨迹表示渲染具有任意相机轨迹的视频。整个流程是从单张图像开始,首先利用深度信息进行引导,然后生成4D点轨迹,最后渲染成视频。

关键创新:MoRe4D的关键创新在于联合进行3D几何重建和运动生成,以及深度引导的运动归一化策略。与现有方法相比,MoRe4D不再将几何和运动信息分离处理,而是通过深度信息将两者紧密结合,从而生成更逼真和一致的4D场景。此外,大规模数据集TrajScene-60K的构建也为该领域的研究提供了重要的数据支持。

关键设计:在4D-STraG中,使用了扩散模型来生成4D点轨迹,具体实现细节未知。深度引导的运动归一化策略的具体实现方式未知,但其目的是为了将单视图深度信息融入到运动生成过程中。运动感知模块的网络结构和参数设置未知。损失函数的设计也未知,但需要保证生成结果的几何一致性和运动合理性。

🖼️ 关键图片

📊 实验亮点

MoRe4D在生成高质量4D场景方面表现出色,能够生成具有多视图一致性和丰富动态细节的视频。由于论文中没有提供具体的性能数据和对比基线,因此无法量化MoRe4D的提升幅度。但是,从视觉效果上看,MoRe4D生成的4D场景明显优于现有方法,尤其是在几何一致性和运动真实性方面。

🎯 应用场景

MoRe4D具有广泛的应用前景,例如虚拟现实、增强现实、游戏开发和电影制作等领域。它可以用于从单张照片生成动态的3D场景,为用户提供更沉浸式的体验。此外,该技术还可以用于机器人导航和自动驾驶等领域,帮助机器人更好地理解和感知周围环境。未来,MoRe4D有望成为4D内容生成的重要工具。

📄 摘要(原文)

Generating interactive and dynamic 4D scenes from a single static image remains a core challenge. Most existing generate-then-reconstruct and reconstruct-then-generate methods decouple geometry from motion, causing spatiotemporal inconsistencies and poor generalization. To address these, we extend the reconstruct-then-generate framework to jointly perform Motion generation and geometric Reconstruction for 4D Synthesis (MoRe4D). We first introduce TrajScene-60K, a large-scale dataset of 60,000 video samples with dense point trajectories, addressing the scarcity of high-quality 4D scene data. Based on this, we propose a diffusion-based 4D Scene Trajectory Generator (4D-STraG) to jointly generate geometrically consistent and motion-plausible 4D point trajectories. To leverage single-view priors, we design a depth-guided motion normalization strategy and a motion-aware module for effective geometry and dynamics integration. We then propose a 4D View Synthesis Module (4D-ViSM) to render videos with arbitrary camera trajectories from 4D point track representations. Experiments show that MoRe4D generates high-quality 4D scenes with multi-view consistency and rich dynamic details from a single image. Code: https://github.com/Zhangyr2022/MoRe4D.