EMMA: Efficient Multimodal Understanding, Generation, and Editing with a Unified Architecture

作者: Xin He, Longhui Wei, Jianbo Ouyang, Minghui Liao, Lingxi Xie, Qi Tian

分类: cs.CV

发布日期: 2025-12-04 (更新: 2025-12-15)

备注: Project Page: https://emma-umm.github.io/emma/

💡 一句话要点

EMMA:提出一种高效统一的多模态理解、生成和编辑架构

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 统一架构 图像生成 图像编辑 视觉理解 高效模型 自编码器

📋 核心要点

- 现有统一多模态模型计算成本高昂,难以兼顾理解、生成和编辑任务的效率与性能。

- EMMA通过高效自编码器压缩视觉token,并采用通道级联和共享-解耦网络,降低计算复杂度。

- 实验表明,EMMA-4B在效率和性能上超越现有统一模型,并与专用模型具有竞争力。

📝 摘要(中文)

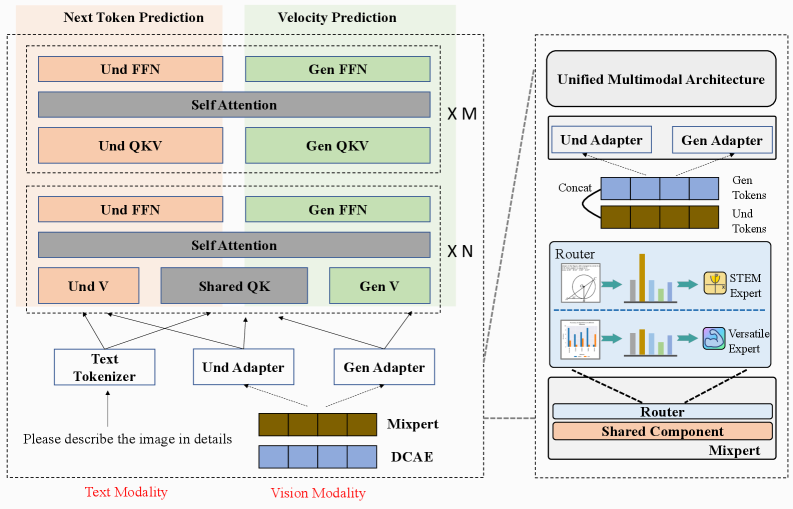

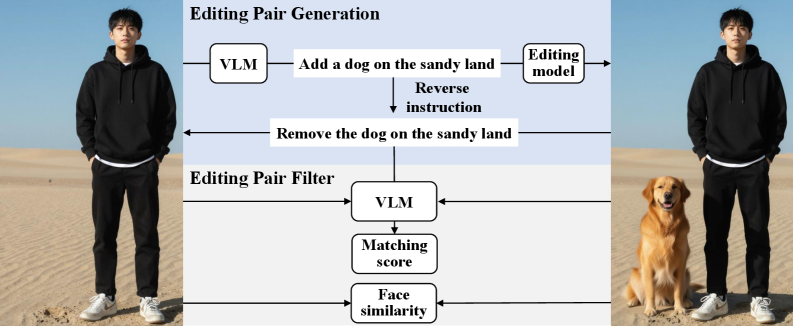

本文提出了一种名为EMMA的高效统一架构,用于多模态理解、生成和编辑。EMMA主要包含以下几个部分:1) 一个具有32倍压缩率的高效自编码器,显著减少了生成所需的token数量,并通过对图像应用相同的压缩率,确保了理解和生成任务之间的训练平衡。2) 视觉理解和生成token之间采用通道级联而非token级联,进一步减少了统一架构中的视觉token数量。3) 一个共享-解耦网络,能够在满足特定任务建模需求的同时,实现跨任务的相互改进。4) 视觉理解编码器采用混合专家机制,以少量参数增加显著提升了感知能力。大量实验表明,EMMA-4B在效率和性能方面均显著优于最先进的统一多模态方法(如BAGEL-7B),并且与最新的多模态理解和生成专家(如Qwen3-VL和Qwen-Image)相比,取得了具有竞争力的结果。我们相信EMMA为未来统一多模态架构的发展奠定了坚实的基础。

🔬 方法详解

问题定义:现有统一多模态模型通常面临计算效率低下的问题,尤其是在处理图像生成和编辑任务时,需要大量的计算资源。此外,如何在理解、生成和编辑等不同任务之间实现平衡,并使它们相互促进,也是一个挑战。

核心思路:EMMA的核心思路是通过高效的视觉token压缩、通道级联和共享-解耦网络来降低计算复杂度,并利用混合专家机制提升感知能力。通过统一的架构,实现多模态理解、生成和编辑任务的协同优化。

技术框架:EMMA的整体架构包含一个高效的自编码器,用于压缩视觉token;一个共享-解耦网络,用于处理不同任务;以及一个混合专家视觉理解编码器。图像首先通过自编码器进行压缩,然后与文本token一起输入到共享-解耦网络中进行处理。最后,根据任务类型,输出理解、生成或编辑结果。

关键创新:EMMA的关键创新在于以下几点:1) 高压缩率的自编码器,显著减少了视觉token的数量。2) 通道级联,进一步降低了计算复杂度。3) 共享-解耦网络,实现了跨任务的知识共享和迁移。4) 混合专家机制,提升了视觉感知能力。与现有方法相比,EMMA在效率和性能上取得了更好的平衡。

关键设计:EMMA采用32倍压缩率的自编码器,以减少视觉token的数量。通道级联将视觉和文本token在通道维度上进行拼接,而非token维度,从而减少了token的数量。共享-解耦网络包含共享的底层网络和特定任务的顶层网络,以实现知识共享和任务定制。混合专家机制采用多个专家网络,并根据输入动态选择合适的专家进行处理。

🖼️ 关键图片

📊 实验亮点

EMMA-4B在效率和性能上均显著优于最先进的统一多模态方法(如BAGEL-7B),并且与最新的多模态理解和生成专家(如Qwen3-VL和Qwen-Image)相比,取得了具有竞争力的结果。实验结果表明,EMMA在多项任务上都取得了显著的性能提升。

🎯 应用场景

EMMA具有广泛的应用前景,包括智能图像编辑、视觉问答、图像描述生成、多模态对话等。它可以应用于智能客服、内容创作、教育娱乐等领域,并有望推动多模态人工智能的发展。

📄 摘要(原文)

We propose EMMA, an efficient and unified architecture for multimodal understanding, generation and editing. Specifically, EMMA primarily consists of 1) An efficient autoencoder with a 32x compression ratio, which significantly reduces the number of tokens required for generation. This also ensures the training balance between understanding and generation tasks by applying the same compression ratio to images. 2) Channel-wise concatenation instead of token-wise concatenation among visual understanding and generation tokens, which further reduces the visual tokens in unified architectures. 3) A shared-and-decoupled network that enables mutual improvements across tasks while meeting the task-specific modeling requirements. 4) A mixture-of-experts mechanism adopted for visual understanding encoder, which substantially improves perceptual capabilities with a few parameters increase. Extensive experiments have shown that EMMA-4B can significantly outperform state-of-the-art unified multimodal approaches (e.g., BAGEL-7B) in both efficiency and performance, while also achieving competitive results compared to recent multimodal understanding and generation experts (e.g., Qwen3-VL and Qwen-Image). We believe that EMMA lays a solid foundation for the future development of unified multimodal architectures.