I2I-Bench: A Comprehensive Benchmark Suite for Image-to-Image Editing Models

作者: Juntong Wang, Jiarui Wang, Huiyu Duan, Jiaxiang Kang, Guangtao Zhai, Xiongkuo Min

分类: cs.CV

发布日期: 2025-12-04

💡 一句话要点

提出I2I-Bench,一个全面的图像到图像编辑模型评测基准。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像编辑 基准测试 性能评估 多模态模型 自动化评估

📋 核心要点

- 现有图像编辑基准存在任务范围窄、评估维度不足和依赖人工标注等问题,限制了其可扩展性和应用性。

- I2I-Bench通过构建包含多样化任务、全面评估维度和严格对齐验证的基准来解决上述问题。

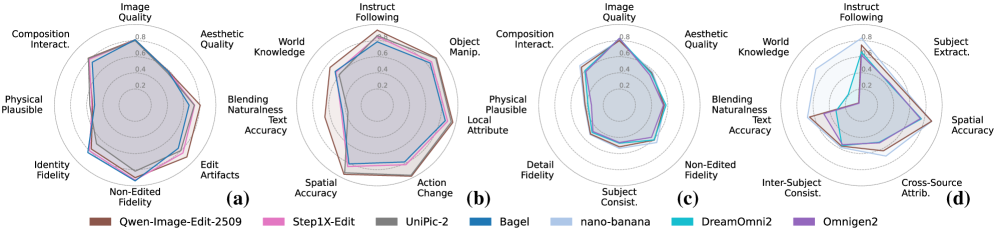

- 该基准测试了多个主流图像编辑模型,揭示了它们在不同维度上的性能差距和优劣。

📝 摘要(中文)

图像编辑模型发展迅速,但全面的评估仍然是一个重大挑战。现有的图像编辑基准通常存在任务范围有限、评估维度不足以及严重依赖人工标注等问题,这极大地限制了它们的可扩展性和实际应用性。为了解决这个问题,我们提出了I2I-Bench,这是一个全面的图像到图像编辑模型基准,其特点是:(i)多样化的任务,涵盖单图像和多图像编辑任务的10个任务类别;(ii)全面的评估维度,包括30个解耦和细粒度的评估维度,以及集成了专用工具和大型多模态模型(LMM)的自动化混合评估方法;(iii)严格的对齐验证,证明了我们的基准评估与人类偏好之间的一致性。使用I2I-Bench,我们对许多主流图像编辑模型进行了基准测试,研究了各种维度上编辑模型之间的差距和权衡。我们将开源I2I-Bench的所有组件,以促进未来的研究。

🔬 方法详解

问题定义:现有图像到图像编辑模型的评估基准存在诸多问题。首先,任务范围有限,无法覆盖所有类型的图像编辑任务。其次,评估维度不够全面,难以细致地衡量模型的各项性能指标。最后,过度依赖人工标注,导致评估成本高昂且难以扩展。这些问题阻碍了图像编辑模型的进一步发展和应用。

核心思路:I2I-Bench的核心思路是构建一个全面、自动化且与人类偏好对齐的图像编辑模型评估基准。通过引入多样化的任务类别、细粒度的评估维度和自动化的评估方法,I2I-Bench旨在克服现有基准的局限性,为图像编辑模型的研究和开发提供更可靠的评估工具。

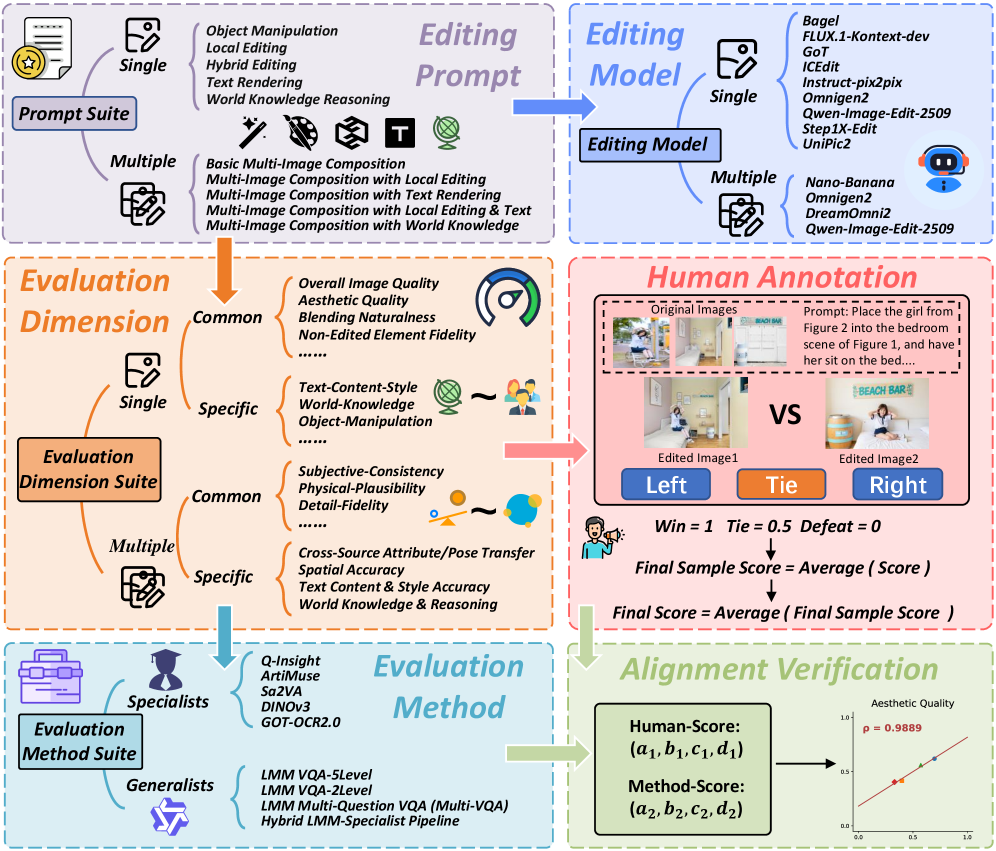

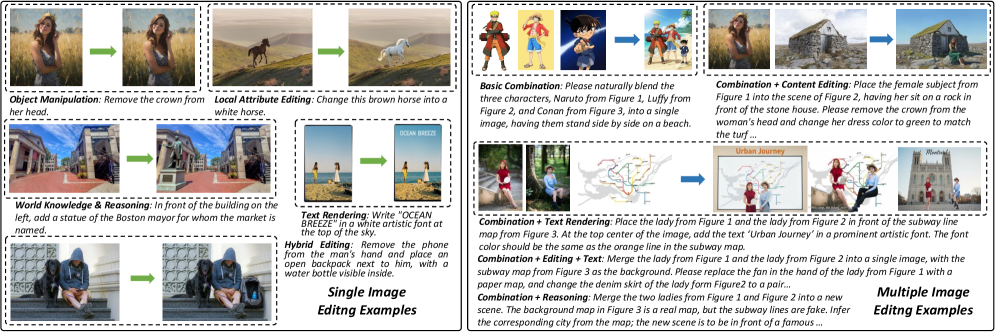

技术框架:I2I-Bench的技术框架主要包含三个组成部分:任务定义、评估维度和评估方法。任务定义部分涵盖了10个任务类别,包括单图像和多图像编辑任务。评估维度部分定义了30个解耦和细粒度的评估指标,用于衡量模型的不同性能方面。评估方法部分采用混合评估策略,结合了专用工具和大型多模态模型(LMM),以实现自动化的性能评估。

关键创新:I2I-Bench的关键创新在于其全面的评估维度和自动化的混合评估方法。与现有基准相比,I2I-Bench提供了更细粒度的性能评估,能够更准确地反映模型的优缺点。此外,通过引入大型多模态模型,I2I-Bench实现了自动化的性能评估,大大降低了评估成本和时间。

关键设计:在评估维度方面,I2I-Bench设计了30个解耦和细粒度的评估指标,涵盖了图像质量、编辑效果、语义一致性等多个方面。在评估方法方面,I2I-Bench采用了混合评估策略,结合了传统的图像质量评估指标和基于大型多模态模型的语义评估指标。此外,I2I-Bench还进行了严格的对齐验证,确保评估结果与人类偏好保持一致。

🖼️ 关键图片

📊 实验亮点

I2I-Bench对多个主流图像编辑模型进行了基准测试,揭示了它们在不同维度上的性能差距和优劣。实验结果表明,不同的模型在不同的任务和评估指标上表现各异,没有一个模型能够在所有方面都取得最佳性能。I2I-Bench的评估结果为模型选择和优化提供了有价值的参考。

🎯 应用场景

I2I-Bench可广泛应用于图像编辑模型的开发、评估和选择。研究人员可以使用I2I-Bench来评估新模型的性能,并与其他模型进行比较。开发者可以使用I2I-Bench来优化模型的参数,提高模型的性能。用户可以使用I2I-Bench来选择最适合自己需求的图像编辑模型。该基准的开源将促进图像编辑领域的进一步发展。

📄 摘要(原文)

Image editing models are advancing rapidly, yet comprehensive evaluation remains a significant challenge. Existing image editing benchmarks generally suffer from limited task scopes, insufficient evaluation dimensions, and heavy reliance on manual annotations, which significantly constrain their scalability and practical applicability. To address this, we propose \textbf{I2I-Bench}, a comprehensive benchmark for image-to-image editing models, which features (i) diverse tasks, encompassing 10 task categories across both single-image and multi-image editing tasks, (ii) comprehensive evaluation dimensions, including 30 decoupled and fine-grained evaluation dimensions with automated hybrid evaluation methods that integrate specialized tools and large multimodal models (LMMs), and (iii) rigorous alignment validation, justifying the consistency between our benchmark evaluations and human preferences. Using I2I-Bench, we benchmark numerous mainstream image editing models, investigating the gaps and trade-offs between editing models across various dimensions. We will open-source all components of I2I-Bench to facilitate future research.