SAM3-I: Segment Anything with Instructions

作者: Jingjing Li, Yue Feng, Yuchen Guo, Jincai Huang, Yongri Piao, Qi Bi, Miao Zhang, Xiaoqi Zhao, Qiang Chen, Shihao Zou, Wei Ji, Huchuan Lu, Li Cheng

分类: cs.CV

发布日期: 2025-12-04 (更新: 2025-12-16)

备注: Preliminary results; work in progress

💡 一句话要点

SAM3-I:通过指令感知的级联自适应机制增强SAM3,实现指令驱动的图像分割

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像分割 自然语言指令 视觉-语言模型 级联自适应 SAM3 指令跟随 开放词汇分割

📋 核心要点

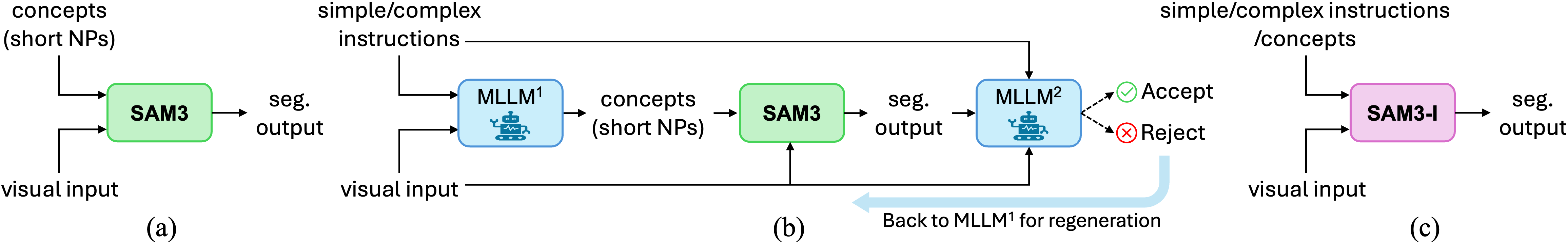

- 现有SAM3依赖外部多模态代理将复杂指令转化为名词短语,表达能力受限,无法精确表示特定实例。

- SAM3-I提出指令感知的级联自适应机制,将指令语义与SAM3的视觉-语言表示对齐,实现直接指令跟随分割。

- 实验表明SAM3-I性能优异,能有效扩展SAM3以遵循自然语言指令,同时保持其强大的概念基础。

📝 摘要(中文)

Segment Anything Model 3 (SAM3) 通过可提示的概念分割推进了开放词汇分割,允许用户分割与给定概念对应的所有实例,这些概念通常用简短的名词短语 (NP) 提示指定。虽然这标志着 SAM 系列首次集成语言级别的概念,但实际应用通常需要更丰富的表达,包括属性、空间关系、功能、动作、状态,甚至是对实例的隐式推理。目前,SAM3 依赖于外部多模态代理将复杂指令转换为 NP,然后进行迭代掩码过滤。然而,这些 NP 级别的概念仍然过于粗糙,通常无法精确地表示特定实例。本文提出了 SAM3-I,这是一个增强的框架,它统一了 SAM 系列中的概念级理解和指令级推理。SAM3-I 引入了一种指令感知的级联自适应机制,该机制逐步将表达性指令语义与 SAM3 现有的视觉-语言表示对齐,从而实现直接的指令跟随分割,而不会牺牲其原始的概念驱动能力。此外,我们设计了一个结构化的指令分类法,涵盖概念、简单和复杂级别,并开发了一个可扩展的数据引擎来构建具有多样化指令-掩码对的数据集。实验表明,SAM3-I 提供了有吸引力的性能,表明 SAM3 可以有效地扩展以遵循自然语言指令,同时保持其强大的概念基础。我们开源了 SAM3-I,并提供了实用的微调工作流程,使研究人员能够将其适应于特定领域的应用。

🔬 方法详解

问题定义:SAM3虽然在开放词汇分割上取得了进展,但其依赖于将复杂指令转换为简单的名词短语,这限制了其处理复杂指令的能力,无法精确分割用户意图的特定实例。现有方法需要借助外部多模态代理进行转换和迭代过滤,效率较低且精度不高。

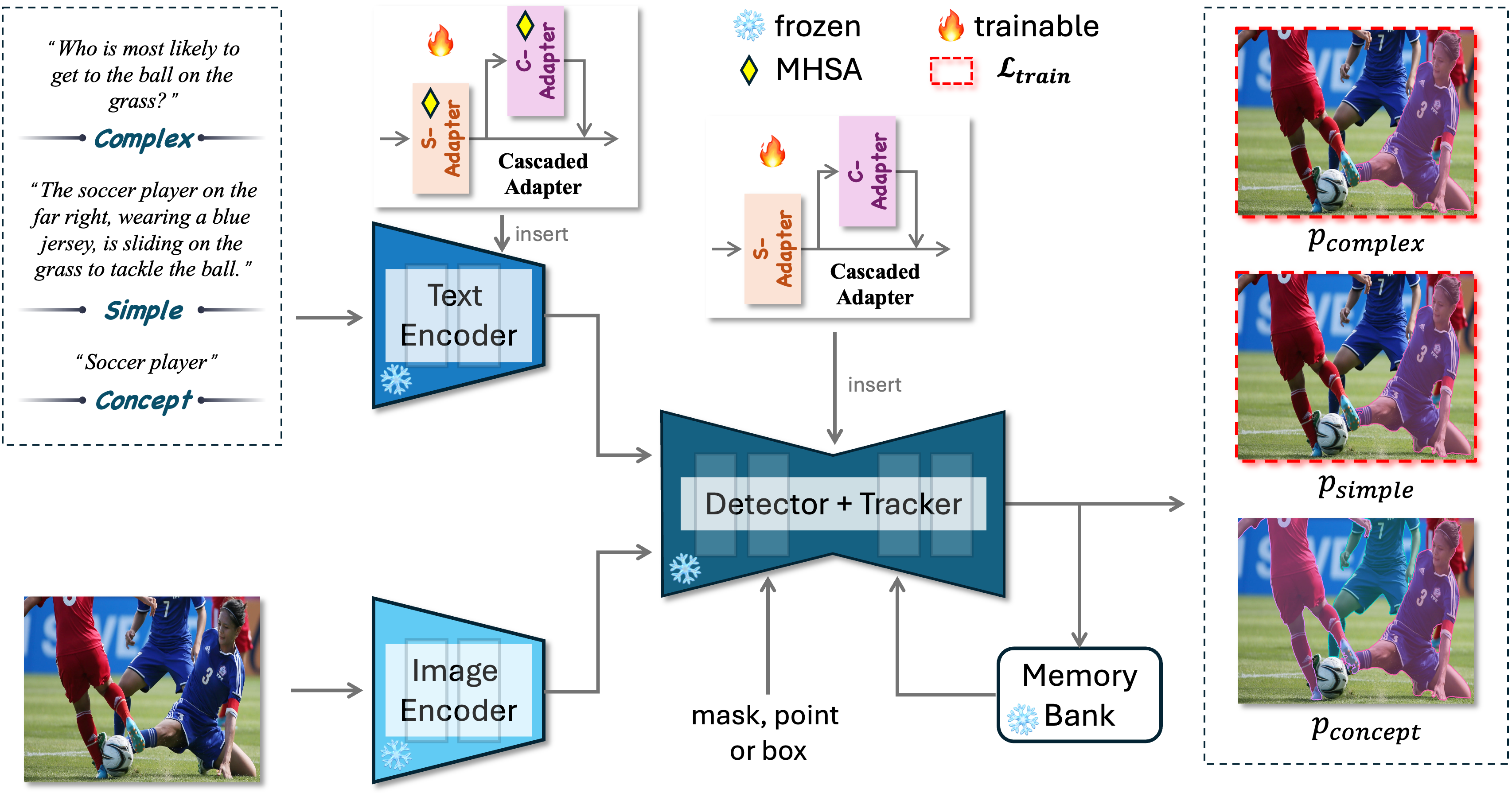

核心思路:SAM3-I的核心思路是通过指令感知的级联自适应机制,直接将复杂的自然语言指令融入到SAM3的视觉-语言表示中,从而实现对指令的直接理解和执行。这种方法避免了中间转换步骤,提高了分割的精度和效率。

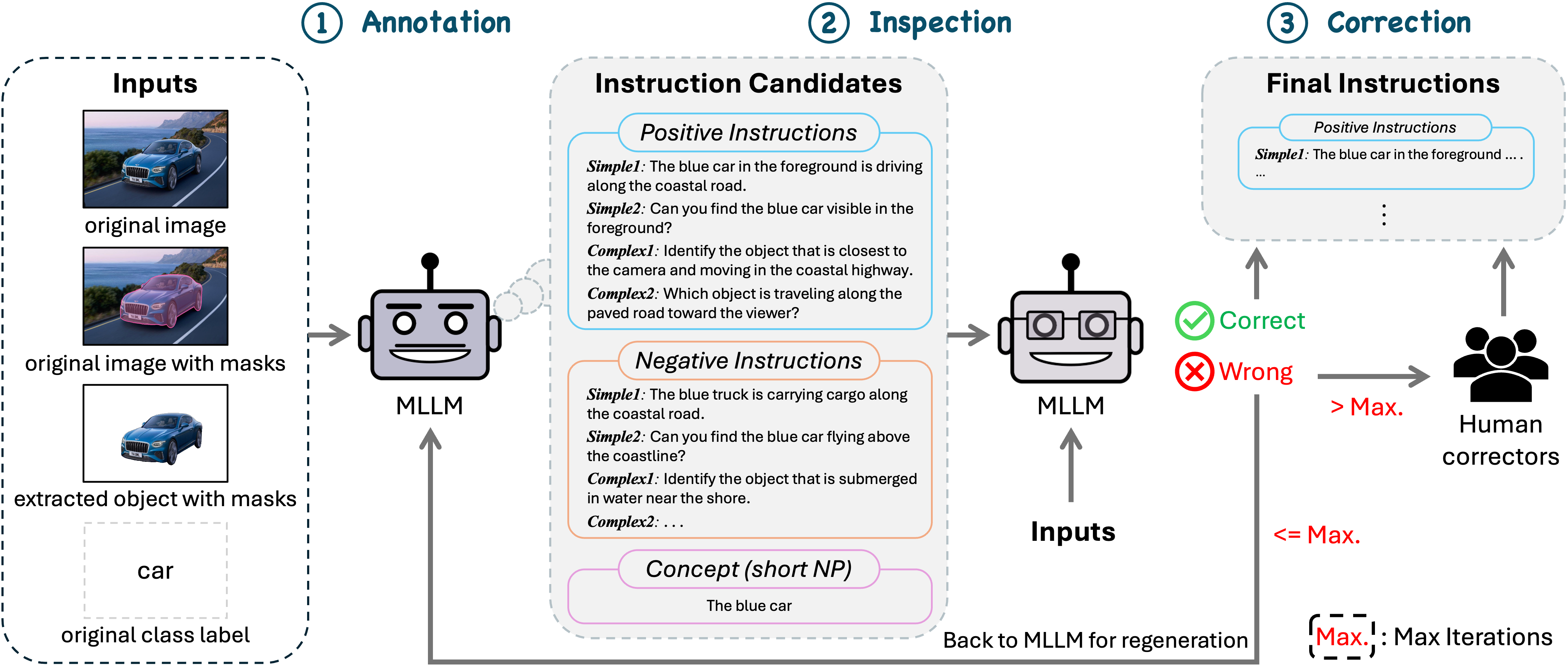

技术框架:SAM3-I的整体框架包含以下几个主要模块:1) 指令编码器:用于提取自然语言指令的语义特征。2) 视觉-语言对齐模块:通过级联自适应机制,将指令语义与SAM3的视觉特征进行对齐。3) 分割模块:利用对齐后的视觉-语言特征,生成与指令对应的分割掩码。4) 数据引擎:用于构建包含多样化指令-掩码对的数据集,支持模型的训练和评估。

关键创新:SAM3-I的关键创新在于指令感知的级联自适应机制。该机制通过多层级的自适应,逐步将指令语义融入到SAM3的视觉表示中,从而实现对复杂指令的精确理解和执行。这种方法避免了对外部多模态代理的依赖,提高了分割的精度和效率。

关键设计:SAM3-I的关键设计包括:1) 结构化的指令分类法,涵盖概念、简单和复杂级别,用于指导数据收集和模型训练。2) 可扩展的数据引擎,用于生成包含多样化指令-掩码对的数据集。3) 级联自适应机制的具体实现,包括自注意力机制、交叉注意力机制等,用于实现视觉-语言特征的对齐。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了SAM3-I的有效性,表明其在遵循自然语言指令进行图像分割方面具有显著优势。具体性能数据和对比基线未在摘要中明确给出,但强调了SAM3-I在保持SAM3原有概念驱动能力的同时,能够更好地理解和执行复杂指令。

🎯 应用场景

SAM3-I可应用于各种需要精确图像分割的场景,例如:机器人导航、医学图像分析、自动驾驶、图像编辑等。通过自然语言指令,用户可以方便地指定需要分割的目标,从而提高工作效率和精度。未来,该技术有望在智能家居、工业自动化等领域发挥重要作用。

📄 摘要(原文)

Segment Anything Model 3 (SAM3) has advanced open-vocabulary segmentation through promptable concept segmentation, allowing users to segment all instances corresponding to a given concept, typically specified with short noun-phrase (NP) prompts. While this marks the first integration of language-level concepts within the SAM family, real-world usage typically requires far richer expressions that include attributes, spatial relations, functionalities, actions, states, and even implicit reasoning over instances. Currently, SAM3 relies on external multi-modal agents to convert complex instructions into NPs and then conduct iterative mask filtering. However, these NP-level concepts remain overly coarse, often failing to precisely represent a specific instance. In this work, we present SAM3-I, an enhanced framework that unifies concept-level understanding and instruction-level reasoning within the SAM family. SAM3-I introduces an instruction-aware cascaded adaptation mechanism that progressively aligns expressive instruction semantics with SAM3's existing vision-language representations, enabling direct instruction-following segmentation without sacrificing its original concept-driven capabilities. Furthermore, we design a structured instruction taxonomy spanning concept, simple, and complex levels, and develop a scalable data engine to construct a dataset with diverse instruction-mask pairs. Experiments show that SAM3-I delivers appealing performance, demonstrating that SAM3 can be effectively extended to follow natural-language instructions while preserving its strong concept grounding. We open-source SAM3-I and provide practical fine-tuning workflows, enabling researchers to adapt it to domain-specific applications. The source code is available here.