Controllable Long-term Motion Generation with Extended Joint Targets

作者: Eunjong Lee, Eunhee Kim, Sanghoon Hong, Eunho Jung, Jihoon Kim

分类: cs.CV

发布日期: 2025-12-04

备注: WACV 2026

💡 一句话要点

COMET:基于Transformer的实时可控长时程人体运动生成框架

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体运动生成 长时程控制 Transformer 条件变分自编码器 参考引导反馈 实时动画 运动风格迁移

📋 核心要点

- 现有方法在实时生成可控角色运动时,难以兼顾细粒度控制和长时程稳定性,限制了交互式应用。

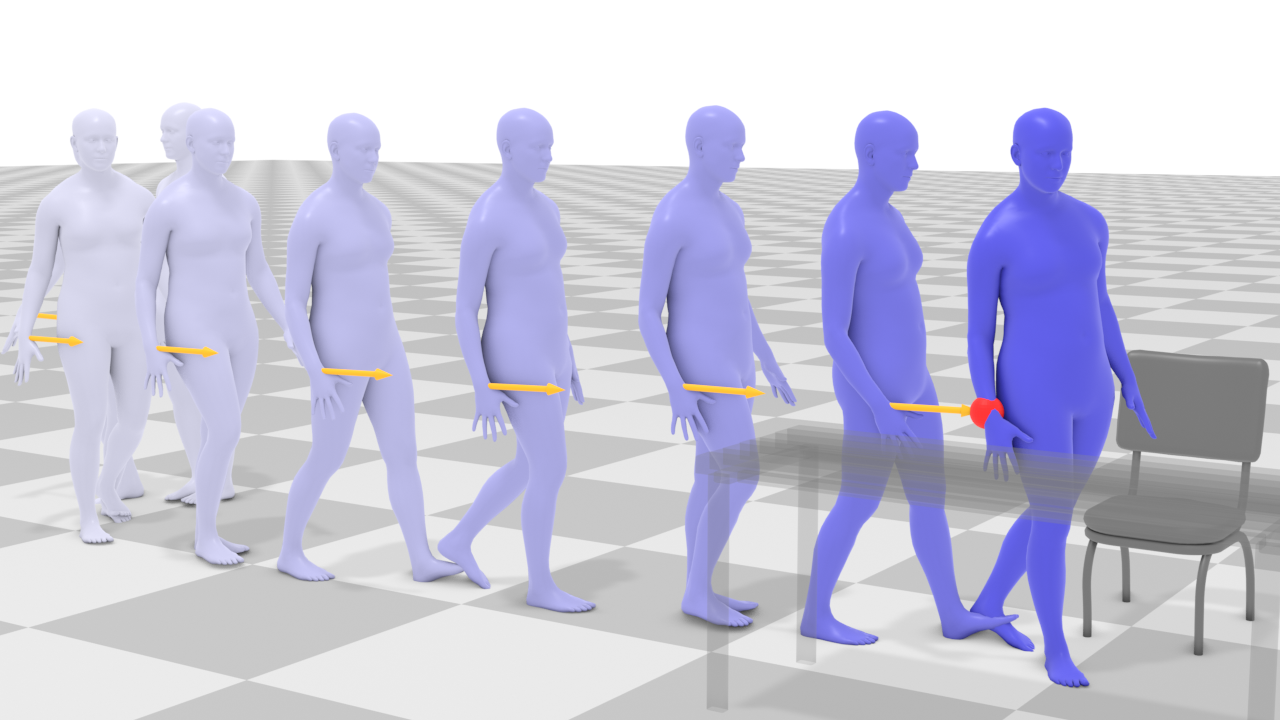

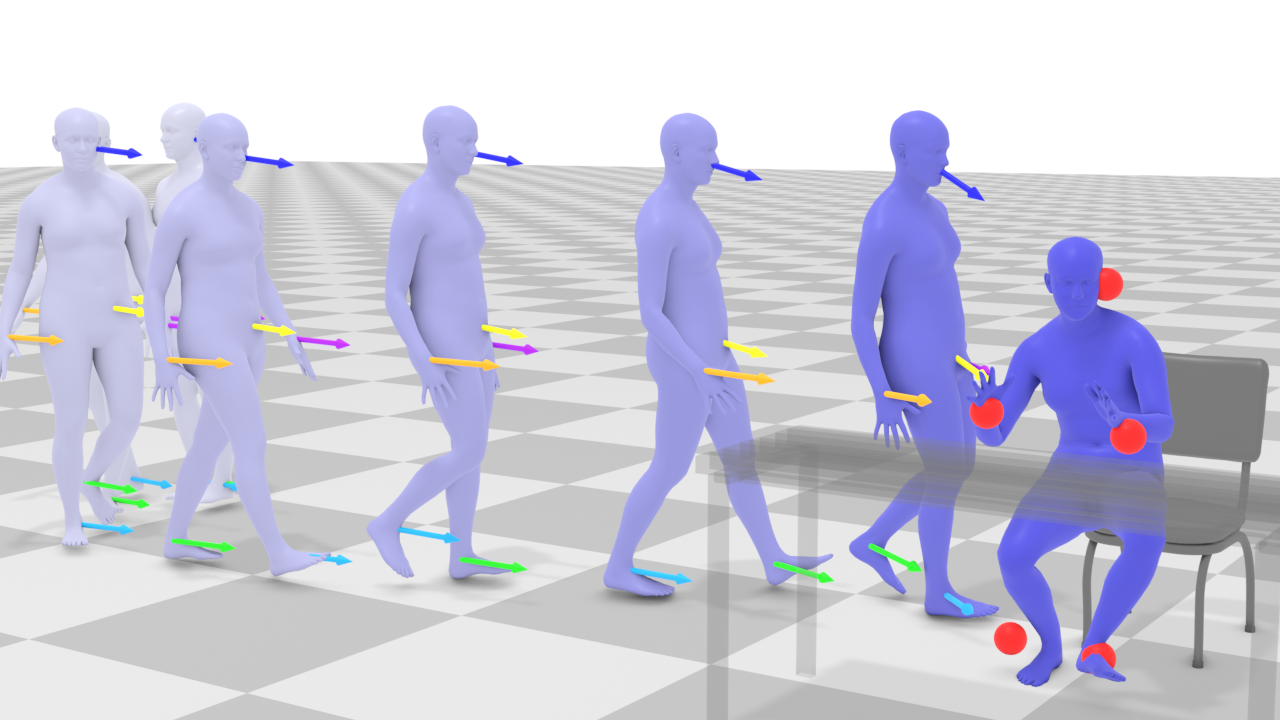

- COMET提出了一种基于Transformer的自回归框架,通过参考引导反馈机制,实现精确控制和长期稳定。

- 实验表明,COMET在运动质量和实时性方面显著优于现有方法,适用于复杂的交互式应用。

📝 摘要(中文)

本文提出COMET,一个自回归框架,能够实时生成稳定且可控的角色运动。现有方法通常无法提供细粒度的控制,或者在长序列上出现运动质量下降,限制了它们在交互式应用中的使用。COMET基于高效的Transformer条件变分自编码器,能够对任意用户指定的关节进行精确的交互式控制,适用于目标到达和中间帧生成等任务,且仅需单个模型。为了确保长期的时序稳定性,引入了一种新颖的参考引导反馈机制,以防止误差累积。该机制还可作为即插即用的风格化模块,实现实时的风格迁移。大量评估表明,COMET能够以实时速度稳健地生成高质量的运动,在复杂的运动控制任务中显著优于现有方法,证明了其在要求苛刻的交互式应用中的可用性。

🔬 方法详解

问题定义:现有方法在生成长时程人体运动时,面临两个主要问题:一是难以提供细粒度的控制,例如精确控制特定关节的运动轨迹;二是容易出现误差累积,导致运动质量随时间推移而下降,无法保证长期稳定性。这些问题限制了现有方法在交互式应用中的使用,例如实时游戏和虚拟现实。

核心思路:COMET的核心思路是利用Transformer的强大建模能力,构建一个条件变分自编码器(CVAE),并引入参考引导反馈机制。CVAE负责生成运动序列,而参考引导反馈机制则通过不断将生成的运动与参考运动进行比较,并进行校正,从而防止误差累积,保证长期稳定性。同时,该反馈机制还可以用于风格迁移,实现运动风格的实时控制。

技术框架:COMET的整体架构包含三个主要模块:运动编码器、运动解码器和参考引导反馈模块。运动编码器将输入的运动序列编码成潜在向量,运动解码器则根据潜在向量和控制信号生成新的运动序列。参考引导反馈模块计算生成运动与参考运动之间的差异,并将该差异反馈给解码器,用于校正生成的运动。整个框架采用自回归的方式进行训练和推理,能够生成长时程的运动序列。

关键创新:COMET的关键创新在于参考引导反馈机制。该机制不仅能够防止误差累积,保证长期稳定性,还可以作为即插即用的风格化模块,实现运动风格的实时控制。与现有方法相比,COMET能够提供更精确的控制,生成更稳定的运动,并支持更丰富的交互式应用。

关键设计:COMET采用Transformer作为编码器和解码器的基本结构,利用其强大的序列建模能力。损失函数包括重构损失、KL散度和对抗损失,用于保证生成运动的质量和多样性。参考引导反馈模块通过计算生成运动与参考运动之间的欧氏距离来衡量差异,并将该距离作为反馈信号。此外,COMET还采用了一种自适应的反馈权重,用于平衡稳定性和控制性。

🖼️ 关键图片

📊 实验亮点

COMET在多个运动控制任务上进行了评估,包括目标到达和中间帧生成。实验结果表明,COMET在运动质量和实时性方面显著优于现有方法。例如,在目标到达任务中,COMET能够以更高的成功率到达目标,并且生成的运动更加自然流畅。在中间帧生成任务中,COMET能够生成更逼真、更稳定的中间帧,减少了运动的抖动和失真。

🎯 应用场景

COMET具有广泛的应用前景,包括虚拟现实、增强现实、游戏开发、机器人控制和动画制作等领域。它可以用于创建更逼真、更具交互性的虚拟角色,提升用户体验。例如,在虚拟现实游戏中,用户可以通过COMET实时控制虚拟角色的运动,实现更自然、更流畅的交互。在机器人控制领域,COMET可以用于生成机器人的运动轨迹,使其能够更好地适应复杂环境。

📄 摘要(原文)

Generating stable and controllable character motion in real-time is a key challenge in computer animation. Existing methods often fail to provide fine-grained control or suffer from motion degradation over long sequences, limiting their use in interactive applications. We propose COMET, an autoregressive framework that runs in real time, enabling versatile character control and robust long-horizon synthesis. Our efficient Transformer-based conditional VAE allows for precise, interactive control over arbitrary user-specified joints for tasks like goal-reaching and in-betweening from a single model. To ensure long-term temporal stability, we introduce a novel reference-guided feedback mechanism that prevents error accumulation. This mechanism also serves as a plug-and-play stylization module, enabling real-time style transfer. Extensive evaluations demonstrate that COMET robustly generates high-quality motion at real-time speeds, significantly outperforming state-of-the-art approaches in complex motion control tasks and confirming its readiness for demanding interactive applications.