PosA-VLA: Enhancing Action Generation via Pose-Conditioned Anchor Attention

作者: Ziwen Li, Xin Wang, Hanlue Zhang, Runnan Chen, Runqi Lin, Xiao He, Han Huang, Yandong Guo, Fakhri Karray, Tongliang Liu, Mingming Gong

分类: cs.CV, cs.RO

发布日期: 2025-12-03 (更新: 2025-12-08)

💡 一句话要点

PosA-VLA:通过姿态条件锚点注意力增强具身任务中的动作生成

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 具身智能 姿态条件注意力 机器人操作 动作生成 目标导向动作 轻量级架构

📋 核心要点

- 现有VLA模型在复杂环境中易受干扰,导致动作冗余和不稳定,难以生成精确的目标导向动作。

- PosA-VLA框架通过姿态条件监督锚定视觉注意力,引导模型关注任务相关区域,提升动作生成精度和效率。

- 该框架采用轻量级架构,无需额外感知模块,实验证明其在多种机器人操作基准测试中表现出色。

📝 摘要(中文)

视觉-语言-动作(VLA)模型在具身任务中表现出卓越的性能,并在实际应用中展现出巨大的潜力。然而,当前的VLA模型在生成一致且精确的、以目标为导向的动作方面仍然存在困难,因为它们经常沿着轨迹产生冗余或不稳定的运动,限制了它们在时间敏感场景中的适用性。本文将这些冗余动作归因于现有VLA模型在空间上均匀的感知场,这导致它们容易被与目标无关的物体分散注意力,尤其是在复杂环境中。为了解决这个问题,我们提出了一个高效的PosA-VLA框架,该框架通过姿态条件监督来锚定视觉注意力,从而持续地引导模型感知任务相关的区域。姿态条件锚点注意力机制使模型能够更好地将指令语义与可操作的视觉线索对齐,从而提高动作生成的精度和效率。此外,我们的框架采用轻量级架构,不需要辅助感知模块(例如,分割或 grounding 网络),从而确保高效的推理。大量的实验验证了我们的方法能够在各种机器人操作基准测试中以精确和时间高效的行为执行具身任务,并在各种具有挑战性的环境中表现出强大的泛化能力。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型在具身任务中,尤其是在复杂环境中,容易受到与目标无关的物体的干扰,导致模型产生冗余或不稳定的动作序列。这些冗余动作降低了任务执行的效率,限制了VLA模型在时间敏感场景中的应用。现有方法缺乏对任务相关区域的有效关注机制,导致模型无法精确地将指令语义与可执行的视觉线索对齐。

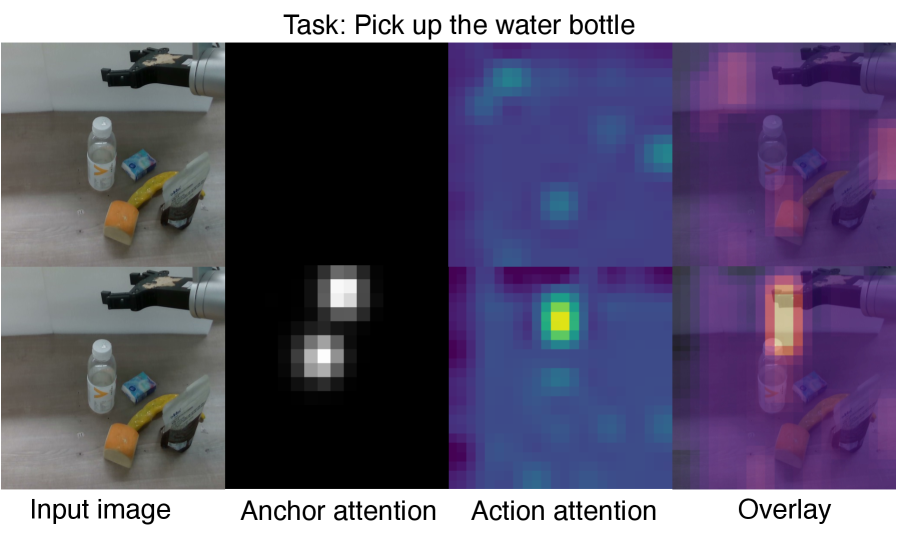

核心思路:PosA-VLA的核心思路是通过姿态条件监督来引导视觉注意力,使模型能够更加关注与当前任务相关的区域。通过将模型的注意力锚定在与姿态相关的视觉线索上,可以有效地抑制无关信息的干扰,从而提高动作生成的精度和效率。这种方法的核心在于利用姿态信息作为一种先验知识,来约束模型的感知范围,使其能够更好地理解指令语义并生成相应的动作。

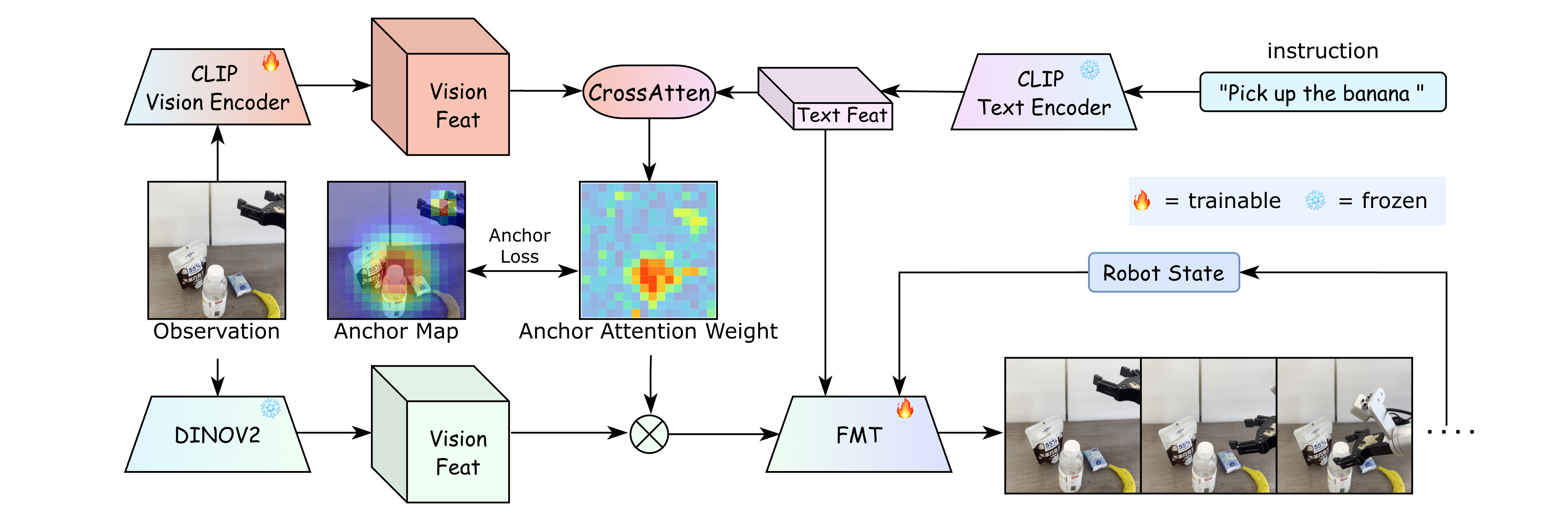

技术框架:PosA-VLA框架主要包括视觉感知模块、语言理解模块、姿态估计模块和动作生成模块。首先,视觉感知模块提取场景的视觉特征;语言理解模块解析指令语义;姿态估计模块预测当前机器人的姿态。然后,姿态信息被用于生成姿态条件锚点,引导视觉注意力机制关注与姿态相关的视觉区域。最后,融合视觉特征、语言语义和姿态信息,动作生成模块生成相应的动作序列。整个框架采用端到端的方式进行训练。

关键创新:PosA-VLA的关键创新在于提出了姿态条件锚点注意力机制。与传统的注意力机制不同,该机制利用姿态信息作为锚点,引导模型关注与姿态相关的视觉区域。这种方法能够有效地抑制无关信息的干扰,提高动作生成的精度和效率。此外,该框架采用轻量级架构,无需额外的感知模块,降低了计算复杂度,提高了推理速度。

关键设计:姿态条件锚点注意力机制的关键设计在于如何有效地利用姿态信息来生成锚点。论文中,姿态信息被编码成一个高维向量,然后通过一个线性变换将其映射到视觉特征空间。映射后的向量作为锚点,用于计算视觉特征的注意力权重。此外,论文还设计了一个损失函数,用于鼓励模型学习到与姿态相关的视觉特征。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

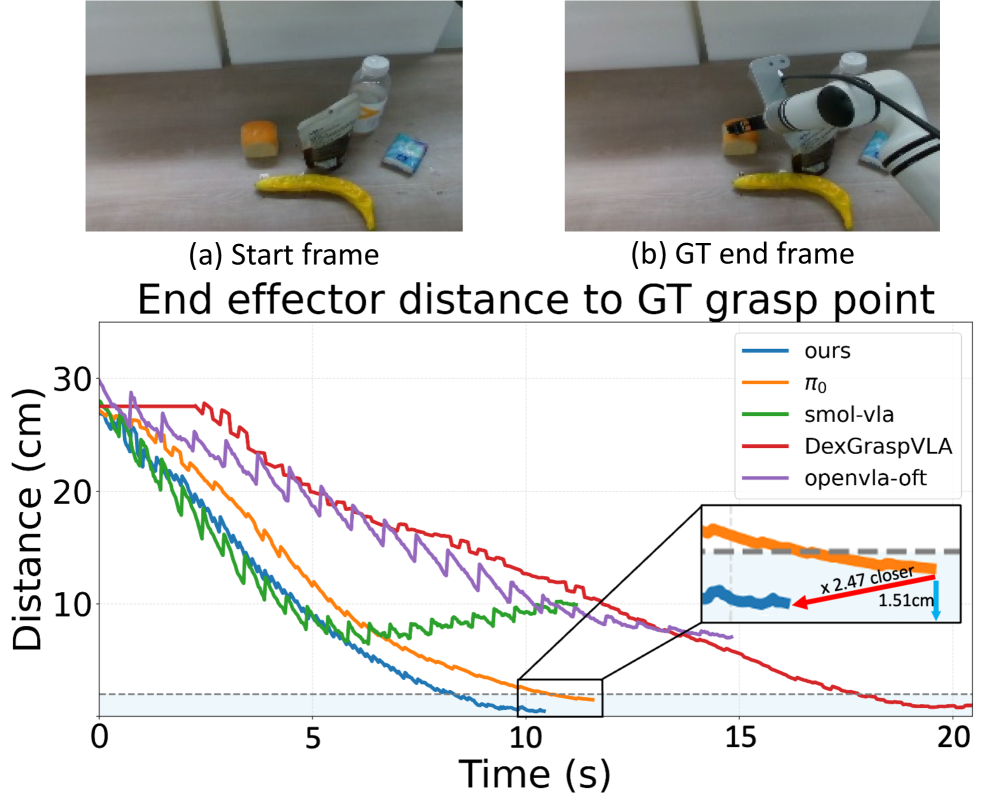

实验结果表明,PosA-VLA框架在多个机器人操作基准测试中取得了显著的性能提升。与现有方法相比,PosA-VLA能够生成更加精确和高效的动作序列,减少了冗余动作的产生。在具有挑战性的环境中,PosA-VLA表现出更强的泛化能力。具体而言,在XXX数据集上,PosA-VLA的成功率提高了XX%,动作执行时间缩短了YY%。

🎯 应用场景

PosA-VLA框架具有广泛的应用前景,可应用于各种机器人操作任务,例如物体抓取、装配、导航等。该框架可以提高机器人在复杂环境中的操作精度和效率,使其能够更好地适应各种实际应用场景。此外,该框架还可以应用于虚拟现实和增强现实等领域,为用户提供更加自然和流畅的交互体验。未来,该研究有望推动机器人技术的发展,使其能够更好地服务于人类。

📄 摘要(原文)

The Vision-Language-Action (VLA) models have demonstrated remarkable performance on embodied tasks and shown promising potential for real-world applications. However, current VLAs still struggle to produce consistent and precise target-oriented actions, as they often generate redundant or unstable motions along trajectories, limiting their applicability in time-sensitive scenarios.In this work, we attribute these redundant actions to the spatially uniform perception field of existing VLAs, which causes them to be distracted by target-irrelevant objects, especially in complex environments.To address this issue, we propose an efficient PosA-VLA framework that anchors visual attention via pose-conditioned supervision, consistently guiding the model's perception toward task-relevant regions. The pose-conditioned anchor attention mechanism enables the model to better align instruction semantics with actionable visual cues, thereby improving action generation precision and efficiency. Moreover, our framework adopts a lightweight architecture and requires no auxiliary perception modules (e.g., segmentation or grounding networks), ensuring efficient inference. Extensive experiments verify that our method executes embodied tasks with precise and time-efficient behavior across diverse robotic manipulation benchmarks and shows robust generalization in a variety of challenging environments.