Flux4D: Flow-based Unsupervised 4D Reconstruction

作者: Jingkang Wang, Henry Che, Yun Chen, Ze Yang, Lily Goli, Sivabalan Manivasagam, Raquel Urtasun

分类: cs.CV, cs.LG, cs.RO

发布日期: 2025-12-02

备注: NeurIPS 2025. Project page: https://waabi.ai/flux4d/

💡 一句话要点

Flux4D:基于光流的无监督大规模动态场景4D重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 4D重建 动态场景 无监督学习 3D高斯溅射 可微渲染

📋 核心要点

- 现有动态场景重建方法依赖人工标注或受限于单场景优化,泛化性差,难以扩展到大规模数据集。

- Flux4D通过预测3D高斯及其运动,并结合光度损失和“尽可能静态”正则化,实现无监督动态场景分解。

- 实验表明,Flux4D在室外驾驶数据集上,重建速度、泛化性和质量均优于现有方法,且无需预训练模型。

📝 摘要(中文)

从视觉观测中重建大规模动态场景是计算机视觉中的一项根本性挑战,对机器人和自主系统具有至关重要的意义。虽然最近的可微渲染方法,如神经辐射场(NeRF)和3D高斯溅射(3DGS)已经实现了令人印象深刻的逼真重建,但它们受到可扩展性的限制,并且需要注释来解耦actor运动。现有的自监督方法试图通过利用运动线索和几何先验来消除显式注释,但它们仍然受到per-scene优化和对超参数调整的敏感性的限制。本文介绍了一种简单且可扩展的框架Flux4D,用于大规模动态场景的4D重建。Flux4D直接预测3D高斯及其运动动态,以完全无监督的方式重建传感器观测。通过仅采用光度损失并强制执行“尽可能静态”的正则化,Flux4D直接从原始数据中学习分解动态元素,而无需预训练的监督模型或基础先验,只需跨多个场景进行训练。我们的方法能够在几秒钟内有效地重建动态场景,有效地扩展到大型数据集,并且能够很好地推广到未见过的环境,包括罕见和未知的对象。在室外驾驶数据集上的实验表明,Flux4D在可扩展性、泛化性和重建质量方面显著优于现有方法。

🔬 方法详解

问题定义:现有动态场景重建方法,如NeRF和3DGS,在处理大规模动态场景时面临挑战。它们通常需要大量的标注数据来解耦场景中的运动,或者只能针对单个场景进行优化,泛化能力有限。此外,这些方法对超参数的敏感性较高,需要耗时的调参过程。

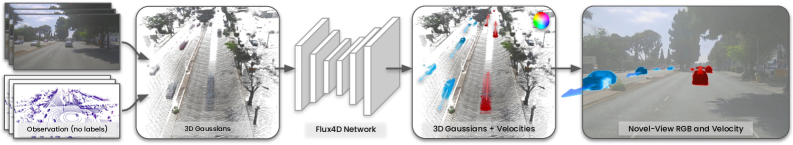

核心思路:Flux4D的核心思路是直接从原始数据中学习动态场景的分解,而无需任何人工标注或预训练模型。它通过预测3D高斯及其运动动态来表示场景,并利用光度损失和“尽可能静态”的正则化来约束学习过程。这种方法鼓励模型将场景中的静态部分建模为静态的3D高斯,而将动态部分建模为运动的3D高斯。

技术框架:Flux4D的整体框架包括以下几个主要步骤:1) 从多视角图像中提取特征;2) 使用这些特征来预测3D高斯及其运动动态;3) 使用可微渲染技术将3D高斯投影到图像平面上,生成合成图像;4) 计算合成图像与真实图像之间的光度损失,并使用“尽可能静态”的正则化来约束学习过程;5) 使用优化算法来更新3D高斯及其运动动态,以最小化损失函数。

关键创新:Flux4D最重要的技术创新点在于其完全无监督的学习方式。与现有的需要人工标注或预训练模型的方法不同,Flux4D可以直接从原始数据中学习动态场景的分解。这使得Flux4D能够更好地泛化到未见过的场景,并且能够更容易地扩展到大规模数据集。

关键设计:Flux4D的关键设计包括以下几个方面:1) 使用3D高斯来表示场景,这使得模型能够有效地表示场景中的几何和外观信息;2) 使用光度损失来约束学习过程,这使得模型能够学习到与真实图像一致的场景表示;3) 使用“尽可能静态”的正则化来鼓励模型将场景中的静态部分建模为静态的3D高斯,这有助于提高重建质量。

🖼️ 关键图片

📊 实验亮点

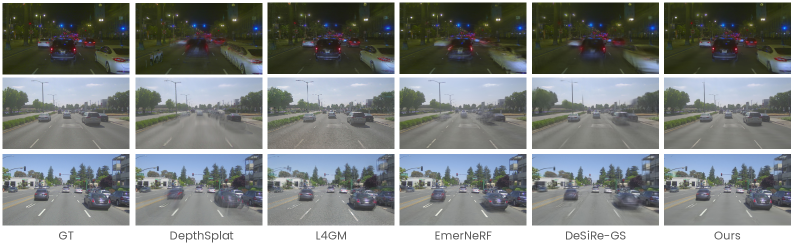

Flux4D在多个室外驾驶数据集上进行了评估,实验结果表明,Flux4D在可扩展性、泛化性和重建质量方面显著优于现有方法。具体来说,Flux4D能够在几秒钟内重建动态场景,并且能够很好地推广到未见过的环境,包括罕见和未知的对象。此外,Flux4D的重建质量也明显优于现有方法,能够更准确地捕捉场景中的几何和外观信息。

🎯 应用场景

Flux4D在机器人、自动驾驶、增强现实等领域具有广泛的应用前景。例如,它可以用于自动驾驶汽车的环境感知,帮助车辆理解周围的动态环境,从而做出更安全的决策。此外,它还可以用于增强现实应用中,将虚拟物体与真实场景进行无缝融合,提供更沉浸式的用户体验。未来,Flux4D有望成为构建智能系统的关键技术之一。

📄 摘要(原文)

Reconstructing large-scale dynamic scenes from visual observations is a fundamental challenge in computer vision, with critical implications for robotics and autonomous systems. While recent differentiable rendering methods such as Neural Radiance Fields (NeRF) and 3D Gaussian Splatting (3DGS) have achieved impressive photorealistic reconstruction, they suffer from scalability limitations and require annotations to decouple actor motion. Existing self-supervised methods attempt to eliminate explicit annotations by leveraging motion cues and geometric priors, yet they remain constrained by per-scene optimization and sensitivity to hyperparameter tuning. In this paper, we introduce Flux4D, a simple and scalable framework for 4D reconstruction of large-scale dynamic scenes. Flux4D directly predicts 3D Gaussians and their motion dynamics to reconstruct sensor observations in a fully unsupervised manner. By adopting only photometric losses and enforcing an "as static as possible" regularization, Flux4D learns to decompose dynamic elements directly from raw data without requiring pre-trained supervised models or foundational priors simply by training across many scenes. Our approach enables efficient reconstruction of dynamic scenes within seconds, scales effectively to large datasets, and generalizes well to unseen environments, including rare and unknown objects. Experiments on outdoor driving datasets show Flux4D significantly outperforms existing methods in scalability, generalization, and reconstruction quality.