Visual Sync: Multi-Camera Synchronization via Cross-View Object Motion

作者: Shaowei Liu, David Yifan Yao, Saurabh Gupta, Shenlong Wang

分类: cs.CV, cs.AI, cs.LG, cs.RO

发布日期: 2025-12-01

备注: Accepted to NeurIPS 2025. Project page: https://stevenlsw.github.io/visualsync/

💡 一句话要点

VisualSync:通过跨视角物体运动实现多相机视频同步

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 多相机同步 视频同步 三维重建 对极约束 运动估计

📋 核心要点

- 现有方法在多相机视频同步方面存在局限,依赖于受控环境、特定目标、手动校正或昂贵的硬件。

- VisualSync利用多视角动态特性,通过优化框架对齐未标定、未同步的视频,核心是利用同步后的对极约束。

- 实验结果表明,VisualSync在多个数据集上优于现有方法,实现了低于50毫秒的中值同步误差。

📝 摘要(中文)

本文提出VisualSync,一个基于多视角动态特性的优化框架,旨在以毫秒级精度对齐未标定、未同步的多相机视频。核心思想是:当一个3D运动点在两个相机中同时可见时,一旦正确同步,它将满足对极约束。VisualSync利用现成的3D重建、特征匹配和稠密跟踪技术提取轨迹、相对位姿和跨视角对应关系,然后联合最小化对极误差来估计每个相机的时间偏移。在四个不同的、具有挑战性的数据集上的实验表明,VisualSync优于基线方法,实现了低于50毫秒的中值同步误差。

🔬 方法详解

问题定义:多相机视频同步旨在解决不同相机拍摄的视频在时间轴上的对齐问题。现有方法通常需要特定的硬件设备、受控的拍摄环境或者人工干预,难以应用于消费级相机拍摄的非受控场景。这些方法在实际应用中存在很大的局限性。

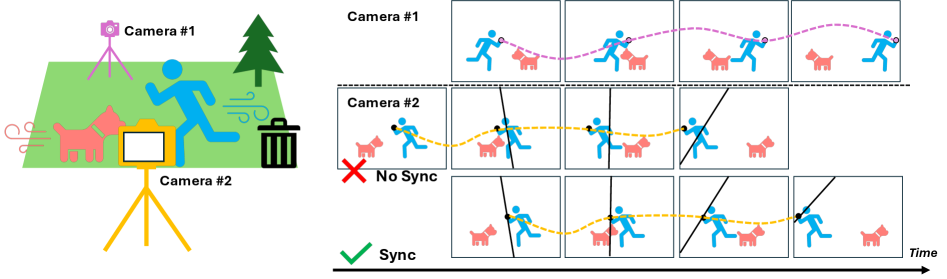

核心思路:VisualSync的核心思路是利用三维空间中运动的点在不同相机视角下的投影关系。当多个相机同步后,同一个三维点在不同相机中的投影点应该满足对极约束。通过最小化违反对极约束的程度,可以反推出相机之间的时间偏移量。

技术框架:VisualSync的整体框架包括以下几个步骤:1) 使用现成的3D重建技术从视频中重建场景的三维结构;2) 利用特征匹配和稠密跟踪技术提取视频中运动物体的轨迹,并建立跨视角的对应关系;3) 根据重建的三维结构和提取的轨迹,计算相机之间的相对位姿;4) 构建优化问题,以最小化对极误差为目标函数,估计每个相机的时间偏移量。

关键创新:VisualSync的关键创新在于它将多相机视频同步问题转化为一个优化问题,通过最小化对极误差来估计相机的时间偏移量。这种方法不需要特定的硬件设备或人工干预,可以应用于消费级相机拍摄的非受控场景。此外,该方法利用了现成的3D重建、特征匹配和稠密跟踪技术,降低了算法的实现难度。

关键设计:VisualSync的关键设计包括:1) 使用鲁棒的特征匹配算法来建立跨视角的对应关系,以减少噪声的影响;2) 使用RANSAC算法来剔除错误的对应关系;3) 使用非线性优化算法来最小化对极误差,以获得更精确的时间偏移量估计。损失函数的设计直接关系到同步的精度,需要仔细选择。

🖼️ 关键图片

📊 实验亮点

VisualSync在四个不同的数据集上进行了评估,包括室内和室外场景,以及不同类型的运动物体。实验结果表明,VisualSync优于现有的基线方法,实现了低于50毫秒的中值同步误差。与现有方法相比,VisualSync在同步精度和鲁棒性方面都有显著提升。

🎯 应用场景

VisualSync具有广泛的应用前景,例如:体育赛事分析、音乐会录制、电影制作、家庭视频编辑等。它可以帮助用户轻松地将多个相机拍摄的视频同步起来,从而创建更具吸引力的视频内容。此外,该技术还可以应用于机器人导航、自动驾驶等领域,为多传感器融合提供更准确的时间同步。

📄 摘要(原文)

Today, people can easily record memorable moments, ranging from concerts, sports events, lectures, family gatherings, and birthday parties with multiple consumer cameras. However, synchronizing these cross-camera streams remains challenging. Existing methods assume controlled settings, specific targets, manual correction, or costly hardware. We present VisualSync, an optimization framework based on multi-view dynamics that aligns unposed, unsynchronized videos at millisecond accuracy. Our key insight is that any moving 3D point, when co-visible in two cameras, obeys epipolar constraints once properly synchronized. To exploit this, VisualSync leverages off-the-shelf 3D reconstruction, feature matching, and dense tracking to extract tracklets, relative poses, and cross-view correspondences. It then jointly minimizes the epipolar error to estimate each camera's time offset. Experiments on four diverse, challenging datasets show that VisualSync outperforms baseline methods, achieving an median synchronization error below 50 ms.