UniDiff: Parameter-Efficient Adaptation of Diffusion Models for Land Cover Classification with Multi-Modal Remotely Sensed Imagery and Sparse Annotations

作者: Yuzhen Hu, Saurabh Prasad

分类: cs.CV

发布日期: 2025-11-29

备注: Camera-ready for WACV 2026

💡 一句话要点

UniDiff:一种参数高效的扩散模型,用于多模态遥感图像和稀疏标注的土地覆盖分类。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱五:交互与反应 (Interaction & Reaction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感图像 土地覆盖分类 多模态融合 扩散模型 参数高效学习

📋 核心要点

- 现有遥感图像土地覆盖分类方法在稀疏标注下性能受限,难以充分利用多模态数据。

- UniDiff通过参数高效地适配预训练扩散模型,并结合伪RGB锚定,实现多模态数据的有效融合。

- 实验结果表明,UniDiff在稀疏标注条件下,显著提升了多模态遥感图像土地覆盖分类的性能。

📝 摘要(中文)

稀疏标注从根本上限制了多模态遥感:即使是最新的监督方法,如MSFMamba,也受到标注数据可用性的限制,尽管架构有所进步,但限制了它们的实际部署。ImageNet预训练模型提供了丰富的视觉表示,但如果没有大型标注数据集,将它们适应于异构模态(如高光谱成像(HSI)和合成孔径雷达(SAR))仍然具有挑战性。我们提出了UniDiff,这是一个参数高效的框架,它仅使用目标域数据将单个ImageNet预训练扩散模型适配到多个传感模态。UniDiff结合了基于FiLM的时间步长-模态条件化、约5%参数的参数高效适配以及伪RGB锚定,以保留预训练表示并防止灾难性遗忘。这种设计使得能够在稀疏标注下从遥感数据中有效提取特征。我们使用两个已建立的多模态基准数据集的结果表明,预训练扩散模型的无监督适配有效地缓解了标注约束,并实现了多模态遥感数据的有效融合。

🔬 方法详解

问题定义:论文旨在解决多模态遥感图像土地覆盖分类中,由于标注数据稀疏导致现有方法性能受限的问题。现有方法难以有效利用多模态数据(如高光谱图像HSI和合成孔径雷达SAR),并且难以将ImageNet预训练模型的知识迁移到遥感领域。

核心思路:论文的核心思路是利用预训练的扩散模型作为特征提取器,并通过参数高效的方式将其适配到目标遥感领域。通过无监督的方式学习遥感数据的特征表示,并结合伪RGB锚定来保留预训练模型的知识,从而缓解稀疏标注带来的问题。

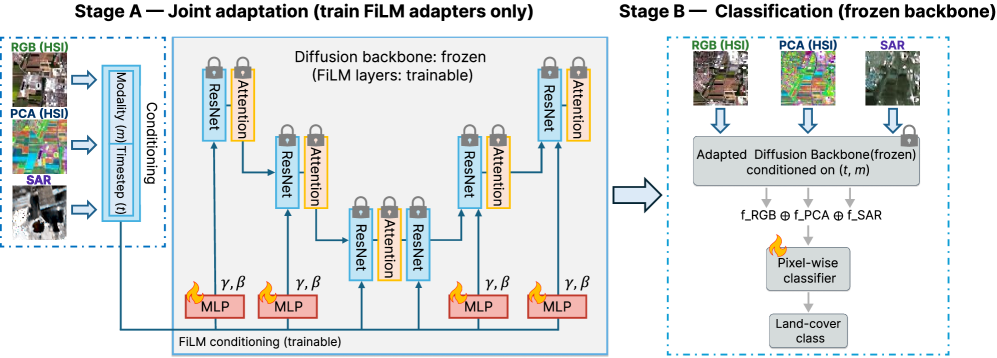

技术框架:UniDiff的整体框架包括以下几个主要模块:1) 预训练扩散模型:使用ImageNet预训练的扩散模型作为基础特征提取器。2) 时间步长-模态条件化:使用FiLM层将时间步长和模态信息融入到扩散模型的每一层中,从而实现对不同模态数据的适配。3) 参数高效适配:仅更新扩散模型中约5%的参数,以减少训练成本并防止过拟合。4) 伪RGB锚定:将遥感数据转换为伪RGB图像,并将其作为扩散模型的输入,以保留预训练模型的知识。

关键创新:UniDiff的关键创新在于:1) 参数高效的扩散模型适配方法,能够在稀疏标注下有效利用多模态遥感数据。2) 伪RGB锚定策略,能够保留预训练模型的知识,防止灾难性遗忘。3) 基于FiLM的时间步长-模态条件化,能够有效地融合不同模态的信息。

关键设计:UniDiff的关键设计包括:1) 使用FiLM层进行时间步长-模态条件化,具体实现方式未知。2) 参数高效适配的具体参数选择策略未知。3) 伪RGB图像的生成方式,可能涉及波段选择或线性变换等操作,具体细节未知。4) 损失函数的设计,可能包括重建损失和分类损失等,具体细节未知。

🖼️ 关键图片

📊 实验亮点

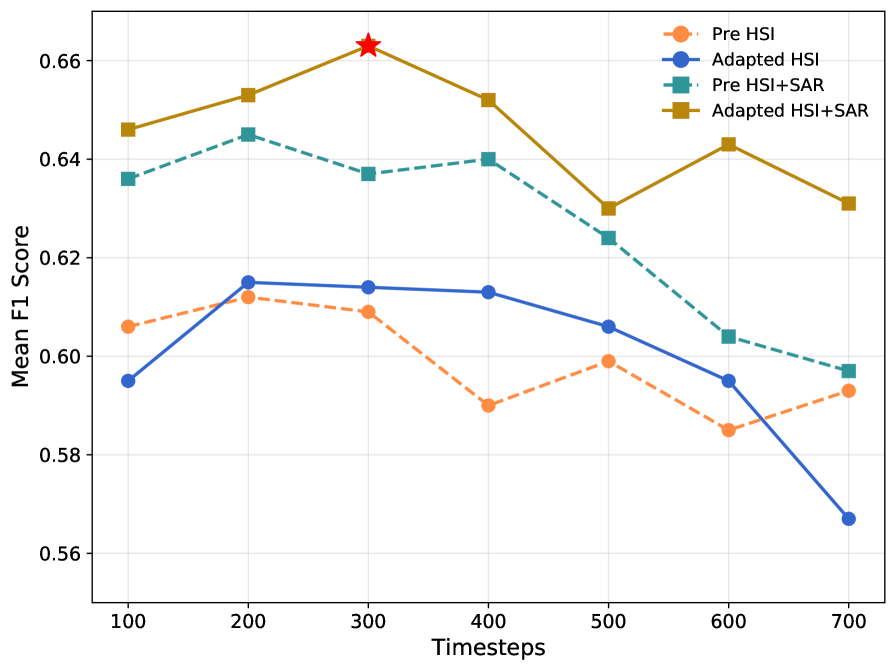

UniDiff在两个多模态遥感基准数据集上进行了评估,结果表明,该方法在稀疏标注条件下显著优于现有方法。具体性能数据和提升幅度在论文中给出,但此处未提供。

🎯 应用场景

UniDiff可应用于各种遥感图像分析任务,如土地覆盖分类、农作物监测、城市规划和灾害评估等。该方法能够有效利用多模态遥感数据,并在标注数据稀疏的情况下提高分类精度,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Sparse annotations fundamentally constrain multimodal remote sensing: even recent state-of-the-art supervised methods such as MSFMamba are limited by the availability of labeled data, restricting their practical deployment despite architectural advances. ImageNet-pretrained models provide rich visual representations, but adapting them to heterogeneous modalities such as hyperspectral imaging (HSI) and synthetic aperture radar (SAR) without large labeled datasets remains challenging. We propose UniDiff, a parameter-efficient framework that adapts a single ImageNet-pretrained diffusion model to multiple sensing modalities using only target-domain data. UniDiff combines FiLM-based timestep-modality conditioning, parameter-efficient adaptation of approximately 5% of parameters, and pseudo-RGB anchoring to preserve pre-trained representations and prevent catastrophic forgetting. This design enables effective feature extraction from remote sensing data under sparse annotations. Our results with two established multi-modal benchmarking datasets demonstrate that unsupervised adaptation of a pre-trained diffusion model effectively mitigates annotation constraints and achieves effective fusion of multi-modal remotely sensed data.