DenseScan: Advancing 3D Scene Understanding with 2D Dense Annotation

作者: Zirui Wang, Tao Zhang

分类: cs.CV, cs.AI

发布日期: 2025-11-28

备注: Workshop on Space in Vision, Language, and Embodied AI at NeurIPS 2025

💡 一句话要点

DenseScan:利用2D密集标注提升3D场景理解能力

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D场景理解 多模态学习 视觉语言模型 数据集 语义标注

📋 核心要点

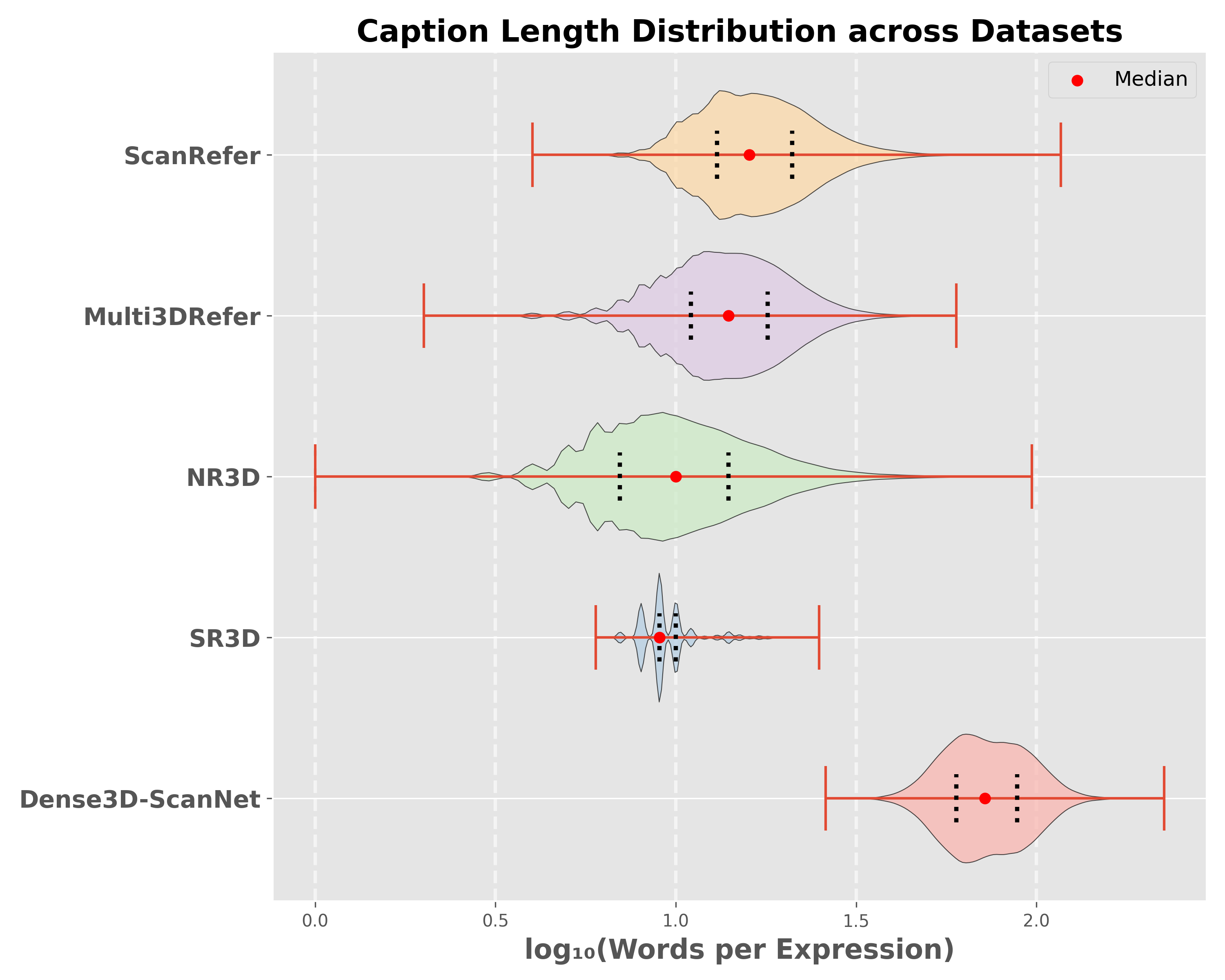

- 现有3D场景理解数据集缺乏细致的语义标注,限制了视觉语言任务的性能。

- DenseScan利用多视角2D图像和多模态大型语言模型自动生成详细的3D场景描述。

- 实验表明,DenseScan显著提高了3D环境中对象级理解和问答性能。

📝 摘要(中文)

3D理解是现实世界AI辅助的关键能力。高质量数据在推动3D理解领域发展中起着重要作用。当前的3D场景理解数据集通常提供几何和实例级别的信息,但缺乏细致的语义标注,这对于细微的视觉语言任务是必要的。本文介绍了DenseScan,这是一个新颖的数据集,它通过一个自动化的流程,利用多视角2D图像和多模态大型语言模型(MLLM)生成详细的多层次描述。我们的方法能够对场景元素进行密集描述,确保全面的对象级描述,捕捉上下文相关的细节。此外,我们通过基于场景的问题生成来扩展这些标注,生成整合对象属性、空间关系和场景上下文的高级查询。通过将几何细节与语义丰富性相结合,DenseScan拓宽了下游任务的范围,从详细的视觉语言导航到交互式问答。实验结果表明,与传统的标注流程相比,我们的方法显著提高了3D环境中对象级理解和问答性能。我们发布了带标注的数据集和我们的标注流程,以促进机器人、增强现实等领域的未来研究和应用。通过DenseScan,我们旨在促进3D场景理解的新途径,使研究人员和从业人员能够利用更丰富、更具上下文意识的标注来应对现实世界环境的复杂性。

🔬 方法详解

问题定义:现有3D场景理解数据集主要关注几何和实例层面的信息,缺乏丰富的语义标注,难以支持复杂的视觉语言任务,例如细粒度的对象描述和上下文相关的推理。现有标注方法成本高昂,难以扩展到大规模数据集。

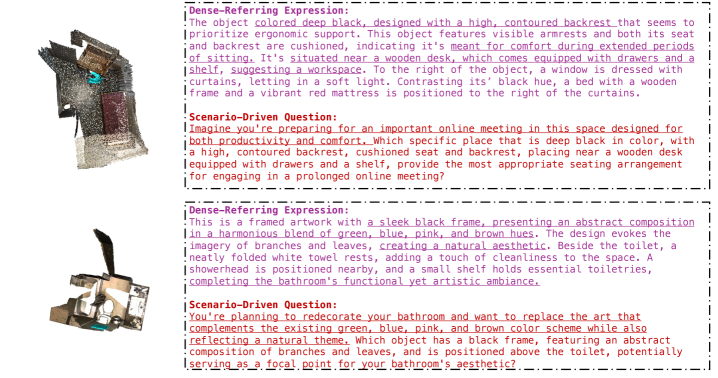

核心思路:DenseScan的核心思路是利用多模态大型语言模型(MLLM)的强大语义理解能力,结合多视角2D图像信息,自动生成3D场景的密集语义标注。通过2D图像的密集标注,反向推导3D场景的语义信息,从而降低标注成本,提高标注效率和质量。

技术框架:DenseScan的整体流程包括以下几个主要阶段:1) 多视角2D图像采集;2) 利用MLLM对2D图像进行密集标注,生成对象级别的描述;3) 将2D标注反投影到3D场景中,生成3D场景的语义标注;4) 基于场景生成问题,进一步丰富数据集的内容。该流程利用自动化的pipeline,显著降低了人工标注的成本。

关键创新:DenseScan的关键创新在于利用MLLM自动生成3D场景的密集语义标注,并结合多视角信息提高标注的准确性和一致性。通过场景问题生成,进一步扩展了数据集的应用范围,使其能够支持更复杂的视觉语言任务。与传统方法相比,DenseScan能够以更低的成本和更高的效率生成更丰富、更具上下文意识的3D场景标注。

关键设计:DenseScan的关键设计包括:1) 选择合适的MLLM模型,并对其进行微调,以提高其在3D场景理解任务中的性能;2) 设计有效的2D标注策略,以确保能够捕捉到场景中所有重要的对象和关系;3) 设计合理的反投影算法,将2D标注准确地映射到3D场景中;4) 设计多样化的场景问题生成策略,以覆盖不同的场景和任务需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DenseScan数据集显著提高了3D环境中对象级理解和问答性能。与传统标注流程相比,DenseScan能够生成更丰富、更具上下文意识的标注,从而提升了下游任务的性能。具体性能提升数据未知,但论文强调了在对象级理解和问答方面的显著改进。

🎯 应用场景

DenseScan数据集和标注流程可广泛应用于机器人、增强现实、视觉语言导航、交互式问答等领域。该研究成果有助于提升机器人对复杂环境的理解能力,使其能够更好地与人类进行交互。此外,DenseScan还可以用于训练更强大的视觉语言模型,从而推动人工智能技术的发展。

📄 摘要(原文)

3D understanding is a key capability for real-world AI assistance. High-quality data plays an important role in driving the development of the 3D understanding community. Current 3D scene understanding datasets often provide geometric and instance-level information, yet they lack the rich semantic annotations necessary for nuanced visual-language tasks.In this work, we introduce DenseScan, a novel dataset with detailed multi-level descriptions generated by an automated pipeline leveraging multi-view 2D images and multimodal large language models (MLLMs). Our approach enables dense captioning of scene elements, ensuring comprehensive object-level descriptions that capture context-sensitive details. Furthermore, we extend these annotations through scenario-based question generation, producing high-level queries that integrate object properties, spatial relationships, and scene context. By coupling geometric detail with semantic richness, DenseScan broadens the range of downstream tasks, from detailed visual-language navigation to interactive question answering. Experimental results demonstrate that our method significantly enhances object-level understanding and question-answering performance in 3D environments compared to traditional annotation pipelines. We release both the annotated dataset and our annotation pipeline to facilitate future research and applications in robotics, augmented reality, and beyond. Through DenseScan, we aim to catalyze new avenues in 3D scene understanding, allowing researchers and practitioners to tackle the complexities of real-world environments with richer, more contextually aware annotations.