ReactionMamba: Generating Short &Long Human Reaction Sequences

作者: Hajra Anwar Beg, Baptiste Chopin, Hao Tang, Mohamed Daoudi

分类: cs.CV

发布日期: 2025-11-28

💡 一句话要点

ReactionMamba:提出基于Mamba的框架,用于生成长短时程的人体反应动作序列

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱五:交互与反应 (Interaction & Reaction)

关键词: 人体动作生成 Mamba模型 状态空间模型 运动VAE 长序列建模

📋 核心要点

- 现有方法在生成长时程、复杂的人体反应动作时,往往难以保证时间一致性和计算效率。

- ReactionMamba的核心在于利用Mamba状态空间模型来捕捉动作序列中的时间依赖关系,并结合VAE进行高效编码。

- 实验表明,ReactionMamba在多个数据集上实现了与现有方法相当甚至更好的性能,并在推理速度上取得了显著提升。

📝 摘要(中文)

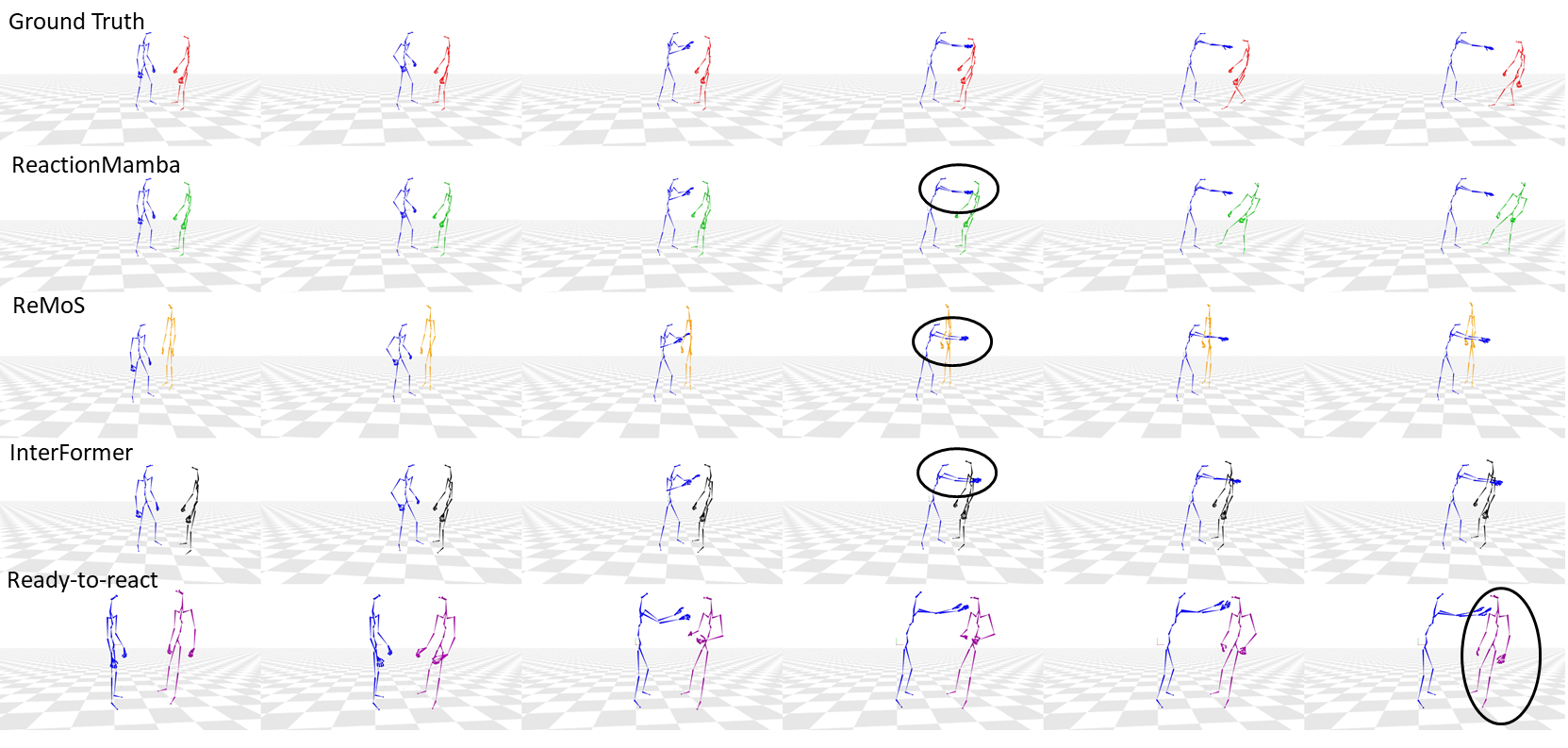

ReactionMamba是一个用于生成长时程3D人体反应动作的新框架。它结合了运动VAE(Motion VAE)进行高效的运动编码,以及基于Mamba的状态空间模型来解码时间上一致的反应。这种设计使ReactionMamba能够生成短序列的简单动作和长序列的复杂动作,如舞蹈和武术。在NTU120-AS、Lindy Hop和InterX三个数据集上的评估表明,与InterFormer、ReMoS和Ready-to-React等先前方法相比,ReactionMamba在真实性、多样性和长序列生成方面表现出竞争优势,同时在推理速度方面实现了显著提升。

🔬 方法详解

问题定义:现有的人体动作生成方法,尤其是在生成长时程的反应动作序列时,面临着时间一致性难以保证和计算复杂度高的问题。这些方法通常难以捕捉动作之间的长期依赖关系,并且在生成复杂动作(如舞蹈和武术)时表现不佳。

核心思路:ReactionMamba的核心思路是利用Mamba状态空间模型来建模人体动作序列中的时间依赖关系。Mamba模型具有线性复杂度,能够高效地处理长序列数据,并且能够更好地捕捉动作之间的长期依赖关系。结合运动VAE,实现高效的运动编码和解码。

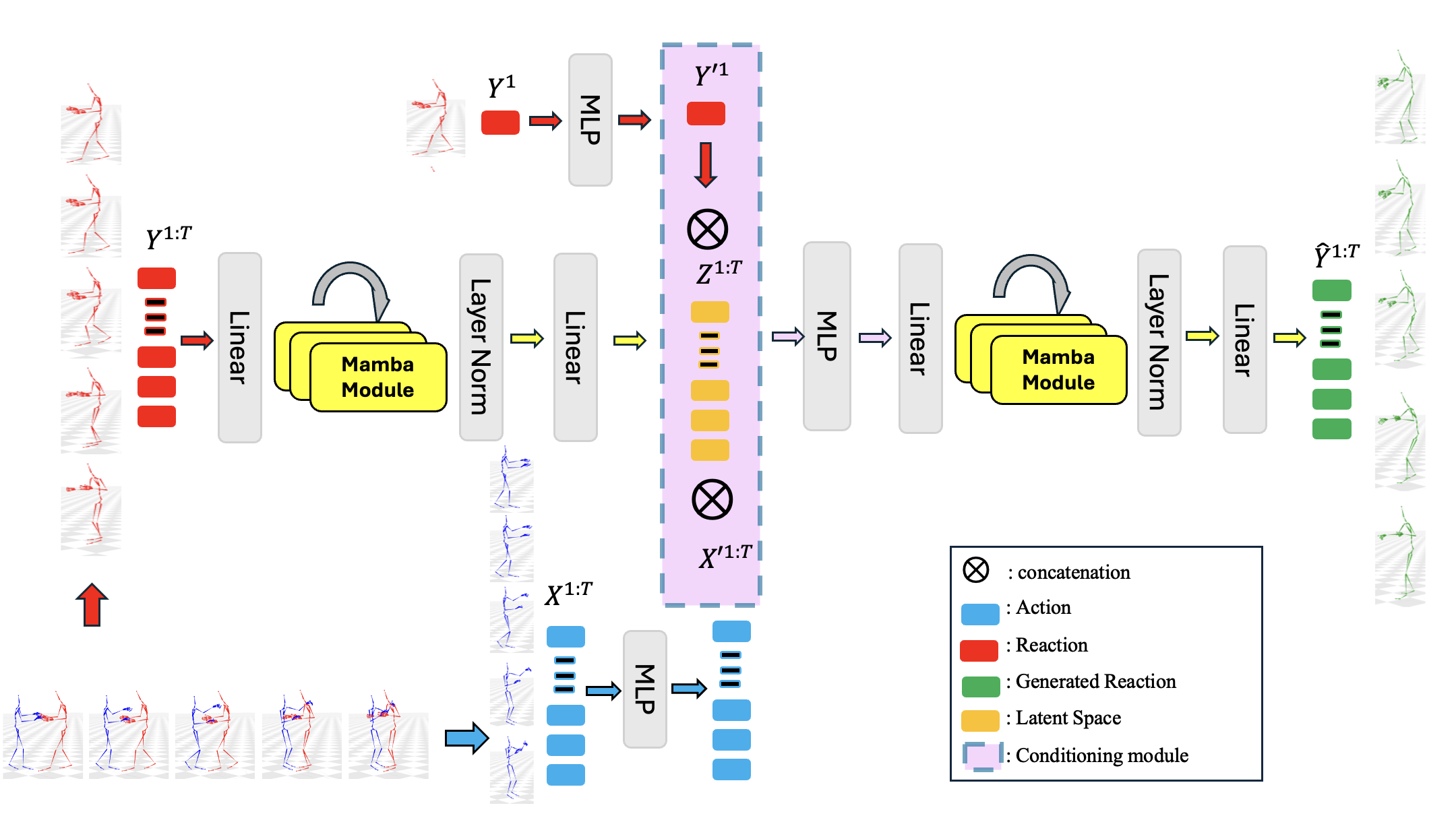

技术框架:ReactionMamba的整体框架包括两个主要模块:运动VAE编码器和Mamba解码器。首先,运动VAE将输入的3D人体动作序列编码成一个低维的潜在空间表示。然后,Mamba解码器利用这个潜在空间表示生成时间上一致的反应动作序列。框架包含训练和推理两个阶段。

关键创新:ReactionMamba的关键创新在于将Mamba状态空间模型引入到人体动作生成领域。与传统的循环神经网络(RNN)或Transformer模型相比,Mamba模型具有线性复杂度,能够更高效地处理长序列数据,并且能够更好地捕捉动作之间的长期依赖关系。此外,结合运动VAE,实现了高效的运动编码和解码。

关键设计:运动VAE采用标准结构,用于将高维动作数据压缩到低维潜在空间。Mamba解码器使用多个Mamba块堆叠而成,每个Mamba块包含选择机制和状态空间模型。损失函数包括VAE的重构损失和KL散度损失,以及用于鼓励生成多样性的对抗损失。具体参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

ReactionMamba在NTU120-AS、Lindy Hop和InterX三个数据集上进行了评估,实验结果表明,与InterFormer、ReMoS和Ready-to-React等现有方法相比,ReactionMamba在真实性、多样性和长序列生成方面表现出竞争优势。更重要的是,ReactionMamba在推理速度方面实现了显著提升,这使得它更适合于实时应用。

🎯 应用场景

ReactionMamba可应用于虚拟现实、游戏开发、动画制作等领域,用于生成逼真的人体反应动作。例如,在虚拟现实游戏中,可以根据玩家的行为生成相应的角色反应动作,从而增强游戏的沉浸感。此外,该技术还可以用于训练机器人,使其能够更好地与人类进行交互。

📄 摘要(原文)

We present ReactionMamba, a novel framework for generating long 3D human reaction motions. Reaction-Mamba integrates a motion VAE for efficient motion encoding with Mamba-based state-space models to decode temporally consistent reactions. This design enables ReactionMamba to generate both short sequences of simple motions and long sequences of complex motions, such as dance and martial arts. We evaluate ReactionMamba on three datasets--NTU120-AS, Lindy Hop, and InterX--and demonstrate competitive performance in terms of realism, diversity, and long-sequence generation compared to previous methods, including InterFormer, ReMoS, and Ready-to-React, while achieving substantial improvements in inference speed.