AutocleanEEG ICVision: Automated ICA Artifact Classification Using Vision-Language AI

作者: Zag ElSayed, Grace Westerkamp, Gavin Gammoh, Yanchen Liu, Peyton Siekierski, Craig Erickson, Ernest Pedapati

分类: cs.CV, cs.LG, eess.IV, q-bio.QM

发布日期: 2025-11-28

备注: 6 pages, 8 figures

期刊: Conference ICMI2026

💡 一句话要点

ICVision:利用视觉-语言AI自动分类脑电ICA伪迹,模拟专家级脑电分析。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脑电信号处理 独立成分分析 伪迹分类 视觉语言模型 GPT-4 Vision

📋 核心要点

- 传统脑电ICA伪迹分类依赖手工特征,泛化性差,难以模拟专家经验。

- ICVision利用GPT-4 Vision直接解析ICA可视化信息,模拟专家视觉认知和推理过程。

- 实验表明,ICVision在伪迹分类上超越现有方法,同时保留了重要的脑信号,且输出结果具有高度可解释性。

📝 摘要(中文)

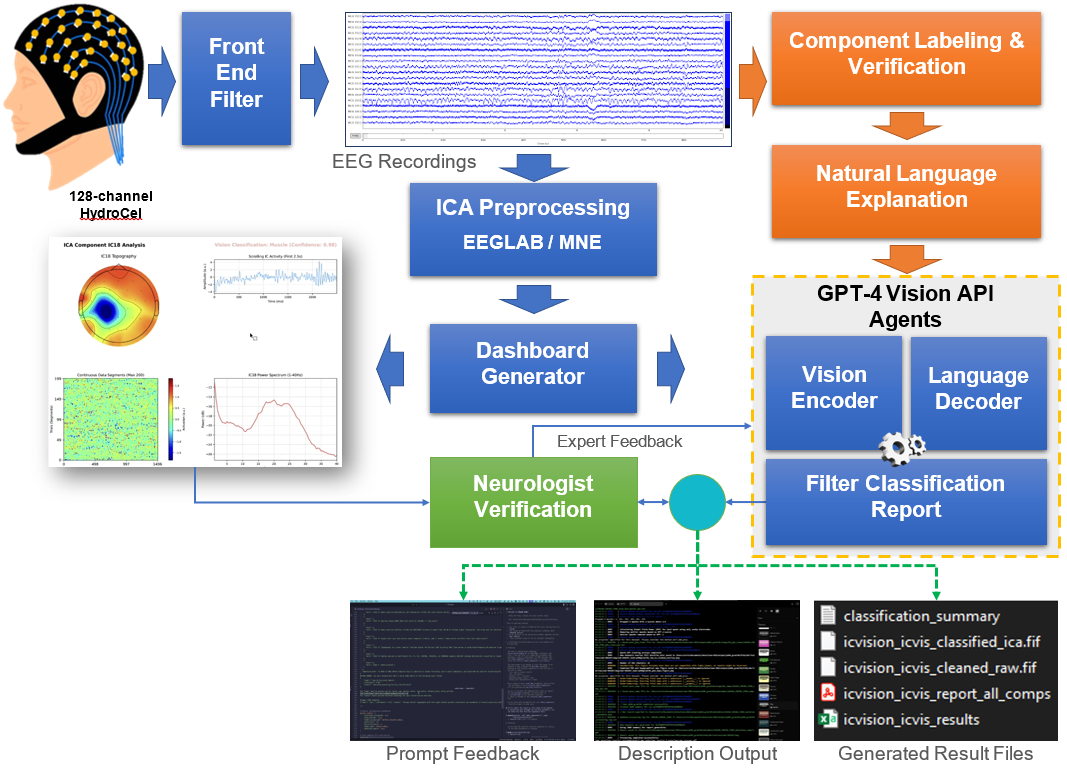

本文提出了一种名为EEG Autoclean Vision Language AI (ICVision) 的新型系统,该系统通过AI智能体的视觉和自然语言推理来模拟专家级的脑电ICA成分分类。与依赖手工特征的传统分类器(如ICLabel)不同,ICVision直接解释ICA仪表板的可视化信息,包括地形图、时间序列、功率谱和ERP图,利用多模态大型语言模型(GPT-4 Vision)。这使得AI能够像训练有素的神经科医生一样观察和解释脑电成分,是AI智能体视觉认知在神经生理学中的首次科学实现。ICVision将每个成分分类为六个标准类别之一(脑、眼、心脏、肌肉、通道噪声和其他噪声),并返回置信度评分和类似人类的解释。在来自124个脑电数据集的3,168个ICA成分上进行评估,ICVision与专家共识达成了k = 0.677的一致性,超过了MNE ICLabel,同时在模棱两可的情况下保留了临床相关的脑信号。超过97%的输出被专家评审员评为可解释和可操作。作为开源EEG Autoclean平台的核心模块,ICVision标志着科学AI的范式转变,模型不仅可以分类,还可以观察、推理和交流。它为全球可扩展、可解释和可重复的脑电工作流程打开了大门,标志着能够在脑科学及其他领域进行专家级视觉决策的AI智能体的出现。

🔬 方法详解

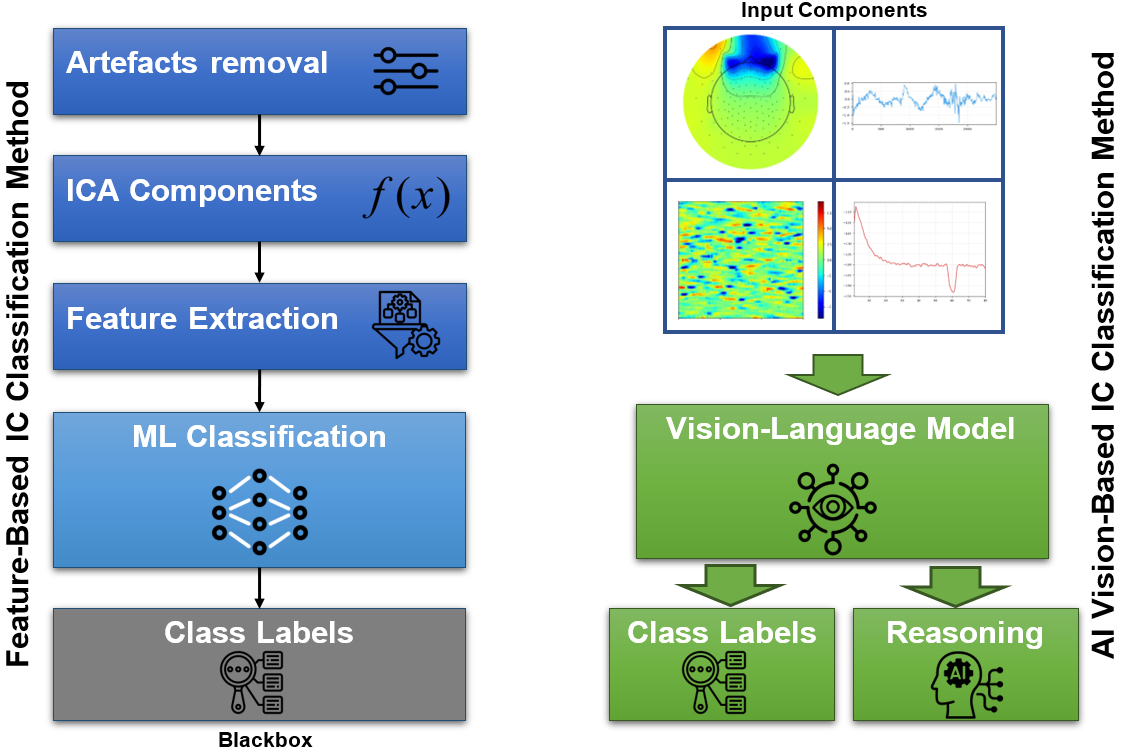

问题定义:脑电信号分析中,独立成分分析(ICA)被广泛用于分离不同的信号源,包括大脑活动和各种伪迹(如眼动、肌肉活动、噪声等)。准确识别和去除这些伪迹对于后续的脑电分析至关重要。然而,现有的自动ICA成分分类方法,如ICLabel,主要依赖于手工设计的特征,这些特征可能无法充分捕捉复杂伪迹的特征,导致分类准确率不高,且缺乏可解释性。此外,这些方法难以模拟专家在识别伪迹时的视觉认知和推理过程。

核心思路:ICVision的核心思路是利用多模态大型语言模型(GPT-4 Vision)直接分析ICA成分的可视化表示,例如地形图、时间序列、功率谱等。通过让AI“看到”并“理解”这些可视化信息,ICVision能够模拟专家在识别伪迹时的视觉认知过程,从而实现更准确、更可解释的伪迹分类。这种方法避免了手工特征工程的局限性,并充分利用了大型语言模型强大的视觉理解和推理能力。

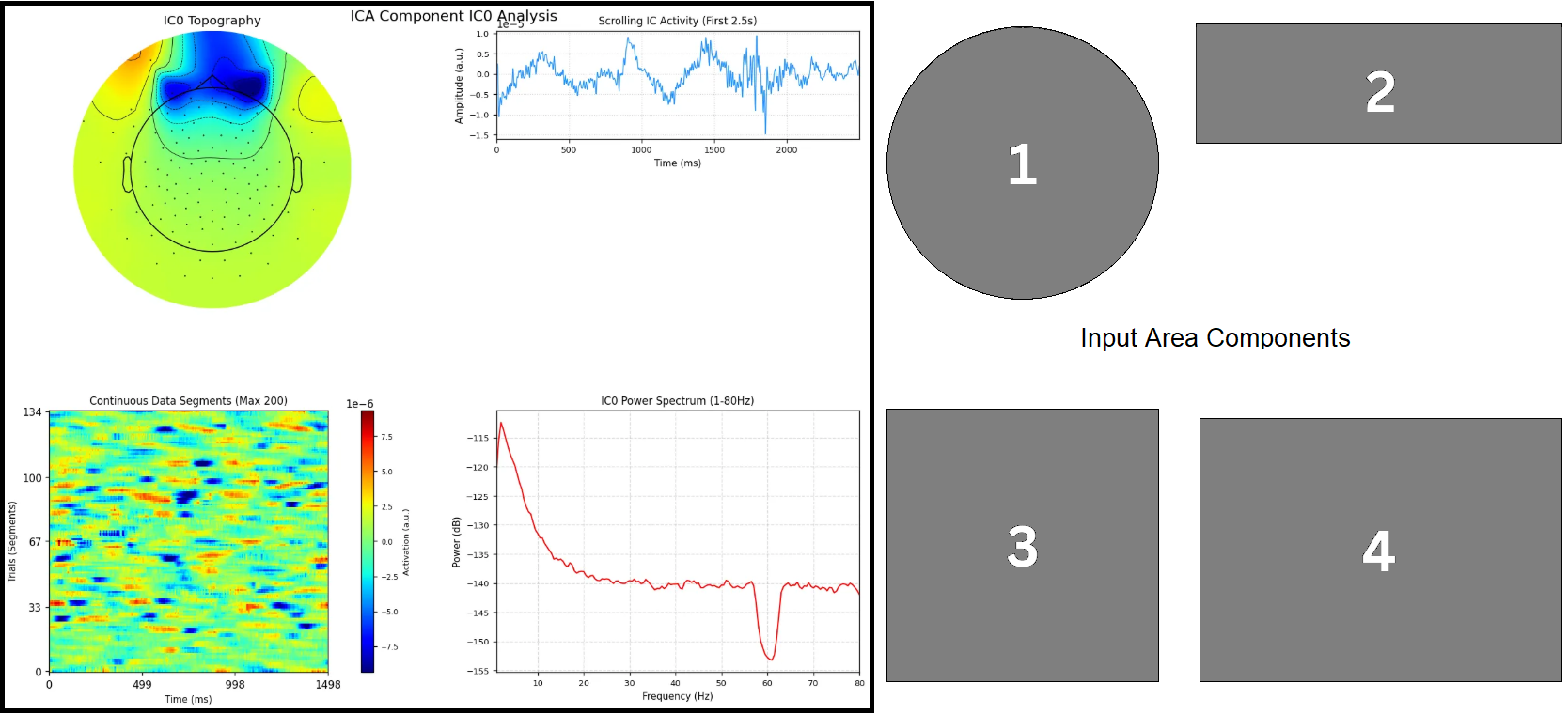

技术框架:ICVision的整体框架包括以下几个主要步骤:1) 输入ICA成分的仪表板可视化信息,包括地形图、时间序列、功率谱和ERP图;2) 使用GPT-4 Vision模型对这些可视化信息进行分析,提取视觉特征;3) GPT-4 Vision模型基于提取的视觉特征和预训练的知识,对ICA成分进行分类,并生成相应的解释;4) 输出分类结果(脑、眼、心脏、肌肉、通道噪声和其他噪声)以及置信度评分和人类可理解的解释。

关键创新:ICVision最重要的技术创新点在于它将视觉-语言AI应用于脑电ICA成分分类,实现了AI智能体视觉认知在神经生理学中的首次科学实现。与传统的基于手工特征的分类方法不同,ICVision直接从可视化信息中学习,能够更好地捕捉复杂伪迹的特征,并提供可解释的分类结果。此外,ICVision还能够模拟专家在识别伪迹时的视觉认知和推理过程,从而实现更接近人类专家水平的分类性能。

关键设计:ICVision的关键设计包括:1) 使用GPT-4 Vision作为核心模型,利用其强大的视觉理解和推理能力;2) 将ICA成分的仪表板可视化信息作为模型的输入,使模型能够直接“看到”并“理解”这些信息;3) 设计合适的提示语(prompts),引导GPT-4 Vision模型进行分类和解释;4) 使用大量脑电数据对模型进行评估和验证,确保其具有良好的泛化性能。

🖼️ 关键图片

📊 实验亮点

ICVision在3,168个ICA成分上的评估中,与专家共识达成k = 0.677的一致性,超过了MNE ICLabel。超过97%的输出被专家评审员评为可解释和可操作。该模型在保留临床相关脑信号方面表现出色,表明其在实际应用中的潜力。

🎯 应用场景

ICVision可应用于大规模脑电数据自动预处理,提高脑电研究效率和可重复性。其可解释性输出有助于临床医生理解AI决策过程,辅助诊断。该技术还可推广至其他医学图像分析任务,例如脑部MRI图像分析,具有广阔的应用前景。

📄 摘要(原文)

We introduce EEG Autoclean Vision Language AI (ICVision) a first-of-its-kind system that emulates expert-level EEG ICA component classification through AI-agent vision and natural language reasoning. Unlike conventional classifiers such as ICLabel, which rely on handcrafted features, ICVision directly interprets ICA dashboard visualizations topography, time series, power spectra, and ERP plots, using a multimodal large language model (GPT-4 Vision). This allows the AI to see and explain EEG components the way trained neurologists do, making it the first scientific implementation of AI-agent visual cognition in neurophysiology. ICVision classifies each component into one of six canonical categories (brain, eye, heart, muscle, channel noise, and other noise), returning both a confidence score and a human-like explanation. Evaluated on 3,168 ICA components from 124 EEG datasets, ICVision achieved k = 0.677 agreement with expert consensus, surpassing MNE ICLabel, while also preserving clinically relevant brain signals in ambiguous cases. Over 97% of its outputs were rated as interpretable and actionable by expert reviewers. As a core module of the open-source EEG Autoclean platform, ICVision signals a paradigm shift in scientific AI, where models do not just classify, but see, reason, and communicate. It opens the door to globally scalable, explainable, and reproducible EEG workflows, marking the emergence of AI agents capable of expert-level visual decision-making in brain science and beyond.