Video-CoM: Interactive Video Reasoning via Chain of Manipulations

作者: Hanoona Rasheed, Mohammed Zumri, Muhammad Maaz, Ming-Hsuan Yang, Fahad Shahbaz Khan, Salman Khan

分类: cs.CV

发布日期: 2025-11-28

备注: Technical Report

🔗 代码/项目: GITHUB

💡 一句话要点

提出Video-CoM,通过链式操作实现交互式视频推理,提升时空理解能力。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频推理 交互式学习 链式操作 多模态学习 强化学习 视频理解 时空推理 视觉操作

📋 核心要点

- 现有多模态大语言模型在视频理解中存在瓶颈,视觉输入被视为静态上下文,缺乏重新观察和验证机制。

- Video-CoM通过链式操作(CoM)进行迭代视觉动作,主动收集和提炼证据,实现交互式视频推理。

- 在多个视频推理基准测试中,Video-CoM性能提升3.6%,且训练样本量远少于其他大型模型,验证了有效性。

📝 摘要(中文)

本文提出了一种新的交互式视频推理范式,旨在将视频转化为一个主动的认知工作空间,使模型能够“思考视频”。为此,作者提出了Video CoM模型,该模型通过链式操作(CoM)进行推理,执行迭代的视觉动作来收集和提炼证据。为了支持这种行为,作者构建了一个名为Video CoM Instruct的包含18K指令的微调数据集,专门用于多步操作推理。除了监督学习之外,作者还通过强化学习和推理感知的群体相对策略优化(GRPO)来优化操作策略。与以往仅依赖稀疏答案奖励的工作不同,本文的方法引入了步级的推理奖励,引导模型进行有根据且一致的推理。Video CoM在九个视频推理基准测试中取得了优异的成绩,与最新的模型相比,平均性能提高了3.6%,并且仅使用25K SFT和3K GRPO视频样本进行训练,样本量远少于同等规模的模型。消融研究表明,推理感知的奖励提高了准确性和可解释性。

🔬 方法详解

问题定义:现有方法在视频理解中,通常将视频编码后,推理完全在文本中进行,缺乏与视频的交互,导致模型无法重新观察、重新聚焦或验证证据,从而在需要精细时空理解的任务上表现不佳。现有方法的痛点在于将视频视为静态上下文,缺乏动态交互和证据验证机制。

核心思路:本文的核心思路是将视频转化为一个主动的认知工作空间,允许模型通过执行一系列视觉操作来与视频进行交互,从而更好地理解视频内容。通过迭代地收集和提炼证据,模型可以更准确地进行推理。这种“思考视频”的范式旨在克服现有方法中存在的语义瓶颈。

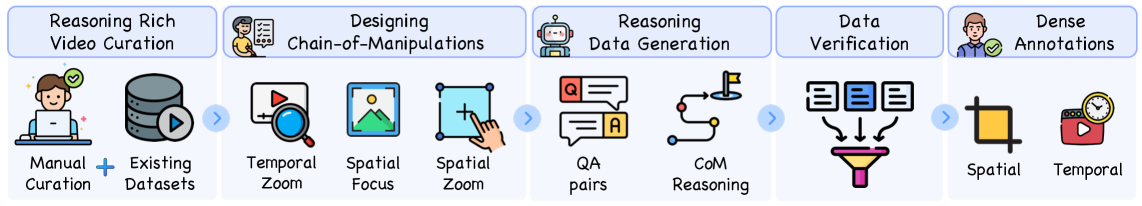

技术框架:Video-CoM的整体框架包含以下几个主要模块:1) 视频编码器:用于将视频帧编码成视觉特征。2) 链式操作(CoM)模块:该模块负责执行一系列视觉操作,例如裁剪、缩放、目标检测等,以提取相关的视觉证据。3) 推理模块:利用提取的视觉证据进行推理,并生成最终的答案。4) 奖励模块:在强化学习阶段,用于评估模型的推理质量,并提供奖励信号。整个流程是迭代的,CoM模块根据推理模块的反馈,不断调整操作策略,直到获得满意的答案。

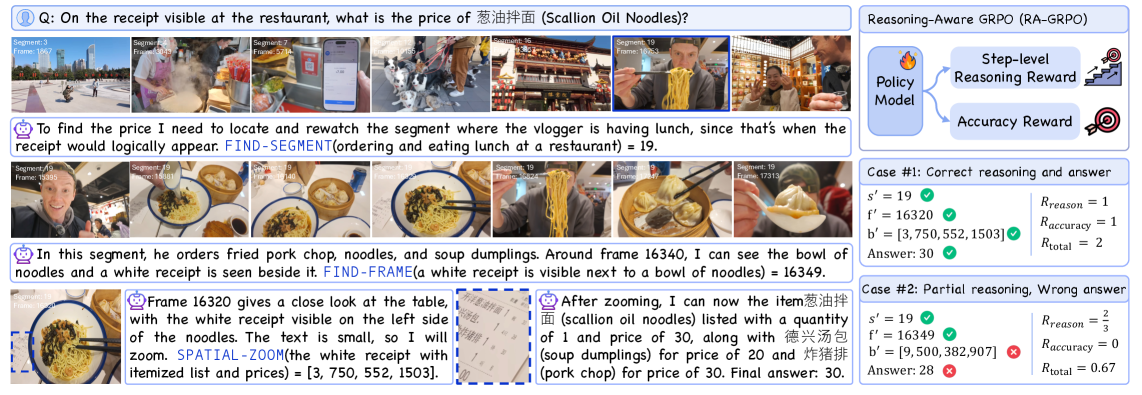

关键创新:最重要的技术创新点在于引入了交互式视频推理范式,以及相应的链式操作(CoM)机制。与现有方法相比,Video-CoM不再将视频视为静态输入,而是允许模型主动地与视频进行交互,从而更好地理解视频内容。此外,推理感知的群体相对策略优化(GRPO)也是一个重要的创新点,它通过引入步级的推理奖励,引导模型进行有根据且一致的推理。

关键设计:在训练阶段,作者构建了一个包含18K指令的微调数据集Video CoM Instruct,用于监督学习。此外,作者还使用了强化学习来优化操作策略,并引入了推理感知的群体相对策略优化(GRPO)。GRPO的关键在于设计了步级的推理奖励,该奖励基于模型的推理过程和最终答案的准确性来计算。具体的网络结构和参数设置在论文中没有详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

Video-CoM在九个视频推理基准测试中取得了显著的性能提升,平均性能比现有最先进的模型提高了3.6%。更重要的是,Video-CoM仅使用25K SFT和3K GRPO视频样本进行训练,训练样本量远少于其他大型模型,这表明该方法具有很高的效率和泛化能力。消融实验表明,推理感知的奖励机制能够提高模型的准确性和可解释性。

🎯 应用场景

该研究成果可应用于智能监控、自动驾驶、视频编辑、智能客服等领域。例如,在智能监控中,模型可以自动分析监控视频,识别异常行为并发出警报。在自动驾驶中,模型可以理解复杂的交通场景,并做出相应的决策。该研究的未来影响在于推动视频理解技术的发展,使其能够更好地服务于人类社会。

📄 摘要(原文)

Recent multimodal large language models (MLLMs) have advanced video understanding, yet most still "think about videos" ie once a video is encoded, reasoning unfolds entirely in text, treating visual input as a static context. This passive paradigm creates a semantic bottleneck: models cannot rewatch, refocus, or verify evidence, leading to shallow visual reasoning on tasks requiring fine grained spatio temporal understanding. In this work, we introduce Interactive Video Reasoning, a new paradigm that transforms video into an active cognitive workspace, enabling models to "think with videos". Our model, Video CoM, reasons through a Chain of Manipulations (CoM), performing iterative visual actions to gather and refine evidence. To support this behavior, we construct Video CoM Instruct, an 18K instruction tuning dataset curated for multi step manipulation reasoning. Beyond supervised learning, we further optimize the manipulation policy via reinforcement learning with reasoning aware Group Relative Policy Optimization (GRPO). Unlike prior work that relies solely on sparse answer rewards, our method introduces step level reasoning rewards, guiding the model toward grounded and consistent reasoning. Video CoM achieves strong results across nine video reasoning benchmarks, improving average performance by 3.6 percent over recent state of the art models, while training on only 25K SFT and 3K GRPO video samples, significantly fewer than comparable large scale models. Ablation studies demonstrate that reasoning aware rewards improve both accuracy and interpretability. Code: https://github.com/mbzuai-oryx/Video-CoM