Instruction Tuning of Large Language Models for Tabular Data Generation-in One Day

作者: Milad Abdollahzadeh, Abdul Raheem, Zilong Zhao, Uzair Javaid, Kevin Yee, Nalam Venkata Abhishek, Tram Truong-Huu, Biplab Sikdar

分类: cs.CV

发布日期: 2025-11-28

备注: Accepted International Conference on Machine Learning (ICML 2025), 1st Workshop on Foundation Models for Structured Data

💡 一句话要点

针对表格数据生成,提出高效指令调优方法,一天内可媲美GPT-4o

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 表格数据生成 指令调优 大型语言模型 数据增强 Llama3.1-8B-Instruct

📋 核心要点

- 现有工作主要集中于表格数据的问答和推理,忽略了表格数据生成任务,限制了LLM在表格数据领域的应用。

- 通过构建高质量的表格数据指令数据集,并结合指令调优,提升LLM在有限资源下的表格数据生成能力。

- 实验表明,使用少量数据和计算资源,即可使开源LLM达到与商业LLM GPT-4o相当的表格数据生成性能。

📝 摘要(中文)

本文首次探索了指令调优在提升大型语言模型(LLMs)表格数据生成能力方面的有效性。现有工作主要关注表格数据的问答和推理任务,而忽略了表格数据生成。考虑到表格指令调优对数据和计算资源的高要求,本文旨在研究在有限数据和计算资源下进行表格数据生成的指令调优。为此,首先创建了一个高质量的表格数据指令数据集,以提高LLM的理解能力。然后,使用该数据集的训练集对开源LLM(Llama3.1-8B-Instruct)进行指令调优,以提高其表格数据生成性能。实验结果表明,通过使用高质量数据集,并在A100 GPU上使用仅7K条指令进行不到6小时的指令调优,即可实现与最强大的商业LLM GPT-4o相媲美的表格数据生成性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在表格数据生成任务上的性能瓶颈。现有方法主要集中在表格数据的问答和推理,缺乏对表格数据生成能力的有效提升。同时,指令调优通常需要大量数据和计算资源,限制了其在表格数据生成领域的应用。

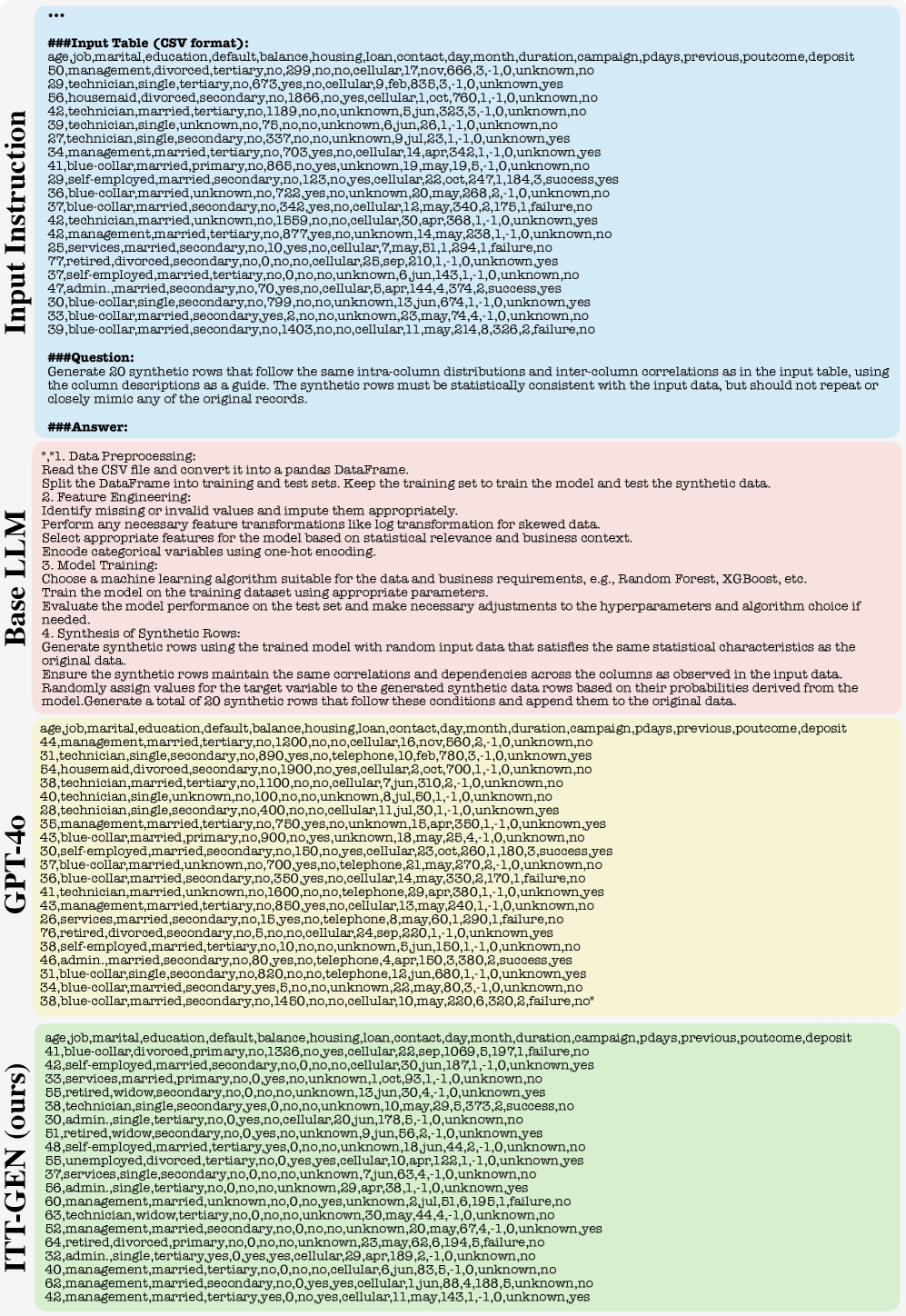

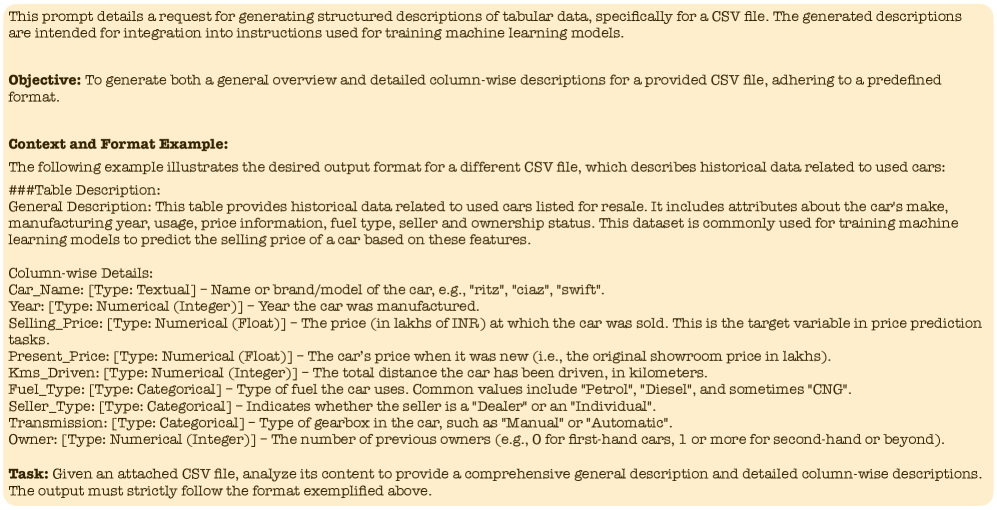

核心思路:论文的核心思路是构建一个高质量的表格数据指令数据集,并通过指令调优的方式,使LLM能够更好地理解和生成表格数据。通过精心设计的指令,引导LLM学习表格数据的结构和语义信息,从而提高其生成能力。

技术框架:整体流程包括两个主要阶段:1) 构建高质量的表格数据指令数据集;2) 使用该数据集对开源LLM(Llama3.1-8B-Instruct)进行指令调优。数据集构建过程未知,指令调优采用标准的监督学习方式。

关键创新:关键创新在于构建了一个高质量的表格数据指令数据集,该数据集能够有效地提高LLM对表格数据的理解能力,从而提升其生成性能。此外,论文验证了在有限数据和计算资源下进行指令调优的可行性。

关键设计:论文的关键设计在于数据集的质量和指令的设计。具体的数据集构建方法和指令设计细节未知。指令调优过程中使用的参数设置、损失函数和网络结构等细节也未知,但推测采用了标准的指令调优流程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用高质量数据集,并在A100 GPU上使用仅7K条指令进行不到6小时的指令调优,即可实现与最强大的商业LLM GPT-4o相媲美的表格数据生成性能。这表明,通过有效的指令调优,可以在有限资源下显著提升LLM的表格数据生成能力。

🎯 应用场景

该研究成果可应用于金融、医疗、电商等领域,帮助用户快速生成各种类型的表格数据,例如财务报表、病历记录、产品目录等。这可以提高数据处理效率,降低人工成本,并为数据分析和决策提供支持。未来,该技术有望进一步扩展到更复杂的表格数据生成任务,例如生成具有特定约束或关系的表格数据。

📄 摘要(原文)

Tabular instruction tuning has emerged as a promising research direction for improving LLMs understanding of tabular data. However, the majority of existing works only consider question-answering and reasoning tasks over tabular data, leaving tabular data generation largely unnoticed. In this work, for the first time, we explore the efficacy of instruction tuning in improving LLMs tabular data generation capabilities. More specifically, given the high data and computation requirements of tabular instruction tuning, we aim to address the possibility of instruction tuning for tabular data generation with limited data and computational resources. To achieve this, we first create a high-quality instruction dataset for tabular data, enabling efficient LLM comprehension. We then instruction-tune an open-source LLM (Llama3.1-8B-Instruct) on the training set of this dataset to improve its tabular data generation performance. Our experimental results show that by using our high-quality dataset and instruction-tuning on only 7K instructions with an A100 GPU, for less than 6 hours, we achieve tabular data generation performance on par with the most capable commercial LLM, GPT-4o.