Pathryoshka: Compressing Pathology Foundation Models via Multi-Teacher Knowledge Distillation with Nested Embeddings

作者: Christian Grashei, Christian Brechenmacher, Rao Muhammad Umer, Jingsong Liu, Carsten Marr, Ewa Szczurek, Peter J. Schüffler

分类: cs.CV

发布日期: 2025-11-28

💡 一句话要点

Pathryoshka:通过嵌套嵌入的多教师知识蒸馏压缩病理学基础模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 病理学 基础模型 知识蒸馏 多教师学习 模型压缩

📋 核心要点

- 现有病理学基础模型参数量巨大,计算资源需求高,限制了其在资源受限环境下的应用。

- Pathryoshka采用多教师知识蒸馏和嵌套嵌入,在减小模型尺寸的同时,保持甚至提升性能。

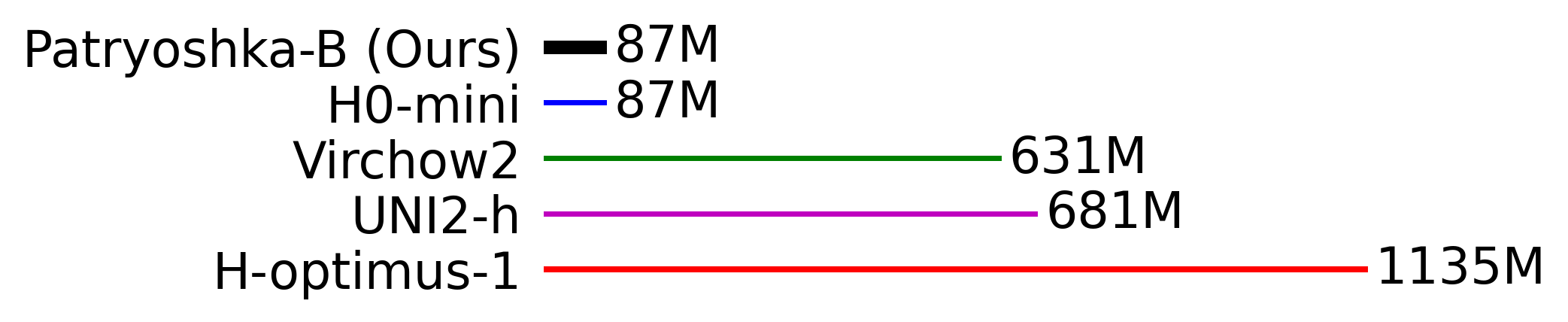

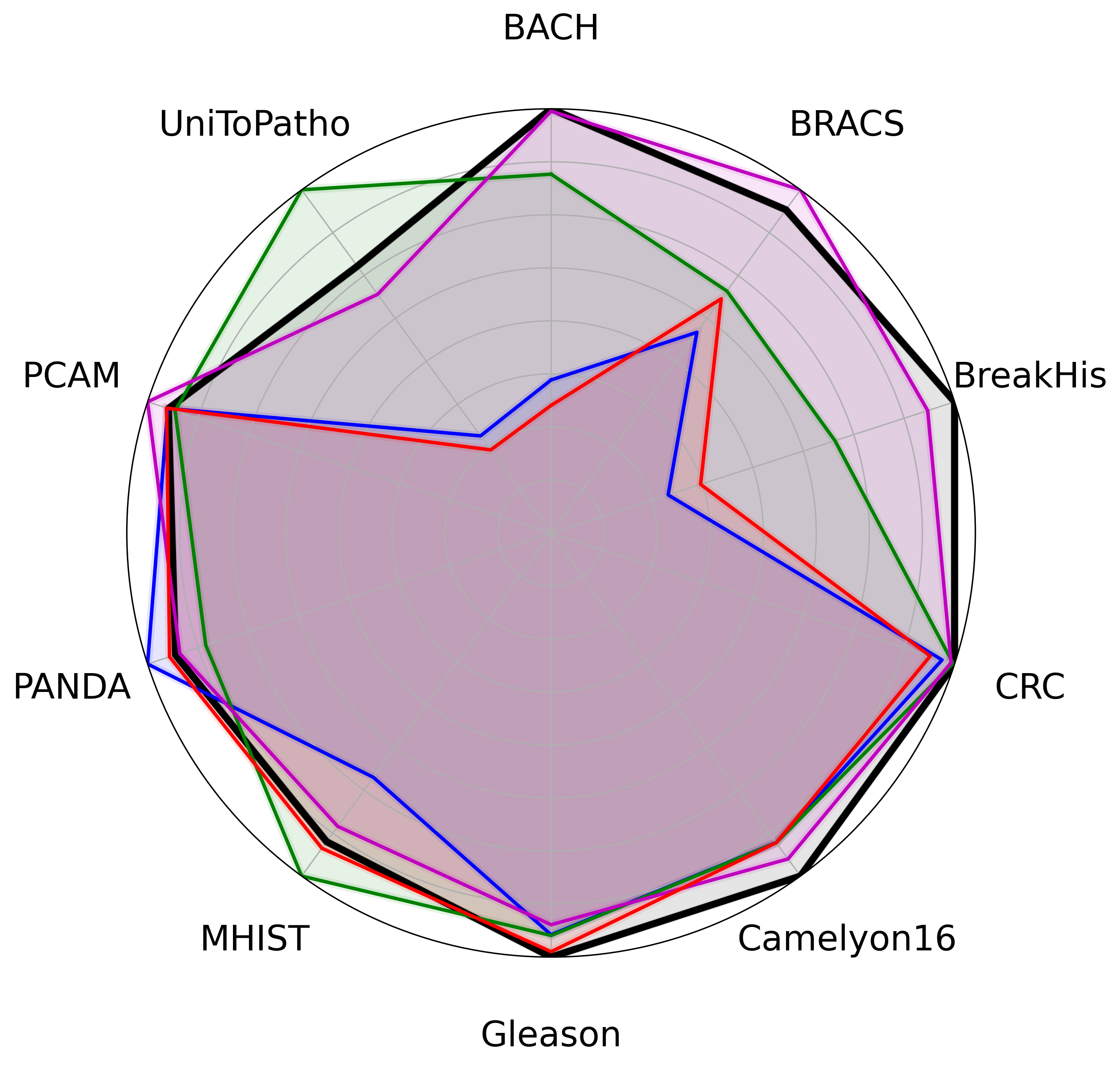

- 实验表明,Pathryoshka在多个病理学数据集上实现了与大型教师模型相当的性能,模型大小减少86-92%。

📝 摘要(中文)

病理学基础模型(FMs)推动了计算病理学的显著进展。然而,这些高性能模型可能轻松超过十亿参数,并产生高维嵌入,从而限制了它们在计算资源紧张情况下的研究或临床应用。本文介绍Pathryoshka,一个受RADIO蒸馏和Matryoshka表征学习启发的的多教师蒸馏框架,旨在减小病理学FM的大小,同时允许适应性嵌入维度。我们在十个具有不同下游任务的公共病理学基准上,使用蒸馏模型评估了我们的框架。与更大的教师模型相比,Pathryoshka在性能相当的情况下,将模型大小减少了86-92%。在准确率方面,它比同等大小的先进单教师蒸馏模型平均高出7.0。通过实现高效的本地部署,同时不牺牲准确性或表征丰富性,Pathryoshka为更广泛的研究和临床社区普及了最先进的病理学FM。

🔬 方法详解

问题定义:现有病理学基础模型(FMs)虽然性能优异,但模型体积庞大,参数量巨大,导致计算和存储成本高昂,难以在资源有限的环境中部署和应用。这限制了病理学FMs在更广泛的研究和临床场景中的使用。现有单教师知识蒸馏方法在压缩模型的同时,往往会造成较大的性能损失。

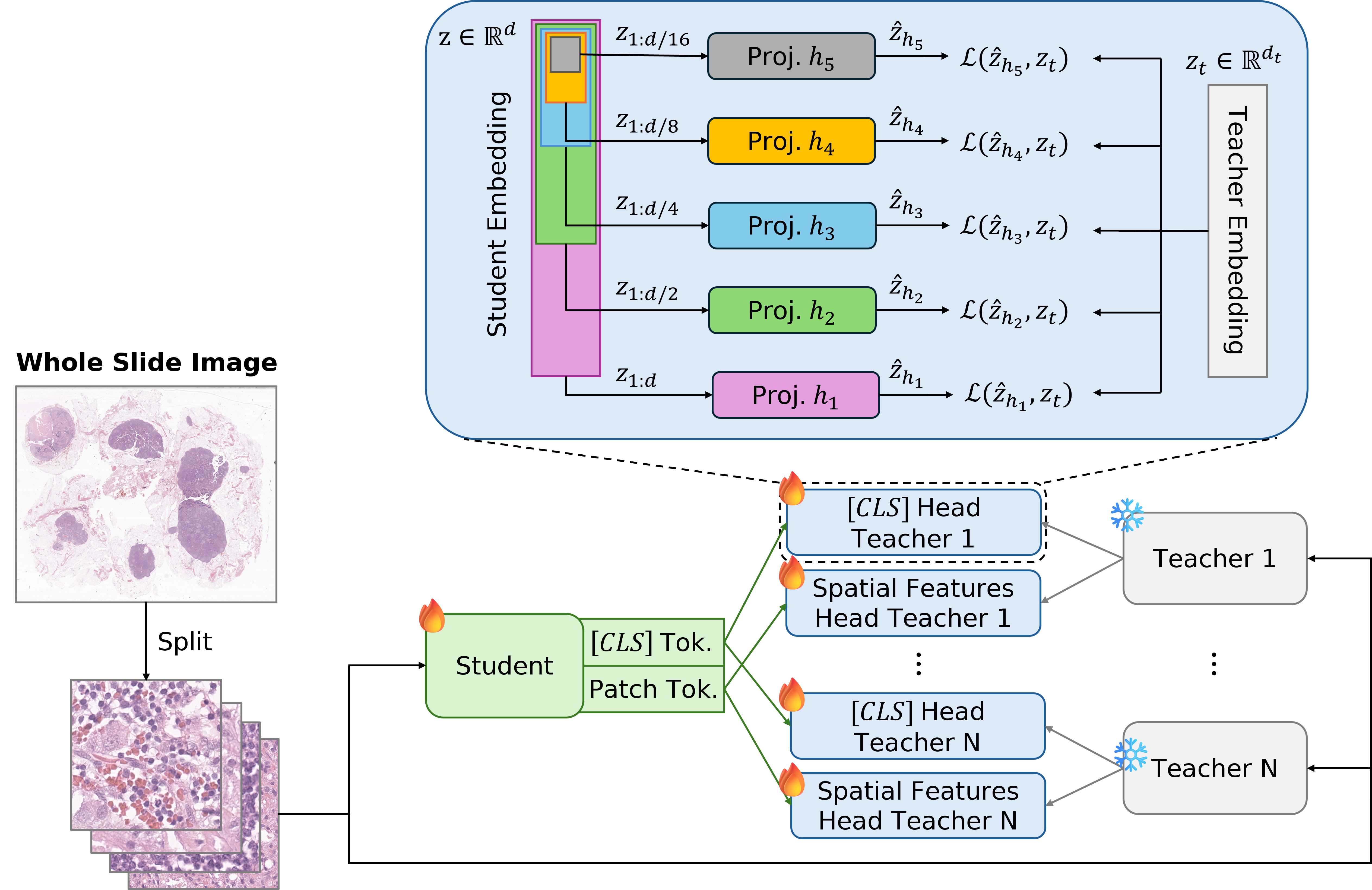

核心思路:Pathryoshka的核心思路是利用多教师知识蒸馏,从多个大型病理学FMs中提取知识,并将其传递到一个小型学生模型中。同时,借鉴Matryoshka表征学习的思想,学习嵌套的嵌入表示,使得学生模型可以灵活地调整嵌入维度,以适应不同的下游任务和计算资源限制。通过这种方式,Pathryoshka旨在在显著减小模型尺寸的同时,保持甚至提升模型性能。

技术框架:Pathryoshka框架主要包含以下几个模块:1) 多教师模型:使用多个预训练好的大型病理学FMs作为教师模型。2) 学生模型:一个小型神经网络,用于学习教师模型的知识。3) 知识蒸馏模块:利用RADIO蒸馏方法,将教师模型的知识传递给学生模型。4) 嵌套嵌入模块:学习具有不同维度的嵌套嵌入表示,使得学生模型可以灵活地调整嵌入维度。整个流程包括:首先,利用多个教师模型对病理图像进行编码,得到高维嵌入表示。然后,利用知识蒸馏模块,将教师模型的嵌入表示和预测结果传递给学生模型。最后,学生模型学习具有不同维度的嵌套嵌入表示,并用于下游任务。

关键创新:Pathryoshka的关键创新在于以下几个方面:1) 采用多教师知识蒸馏,可以从多个教师模型中提取更丰富的知识,从而提升学生模型的性能。2) 借鉴Matryoshka表征学习的思想,学习嵌套的嵌入表示,使得学生模型可以灵活地调整嵌入维度,以适应不同的下游任务和计算资源限制。3) 结合RADIO蒸馏方法,可以有效地将教师模型的知识传递给学生模型。

关键设计:Pathryoshka的关键设计包括:1) 教师模型的选择:选择多个具有不同架构和训练数据的病理学FMs作为教师模型,以增加知识的多样性。2) 知识蒸馏损失函数:采用RADIO蒸馏损失函数,包括特征蒸馏损失和预测蒸馏损失,以确保学生模型能够学习到教师模型的嵌入表示和预测结果。3) 嵌套嵌入维度:根据下游任务和计算资源限制,选择合适的嵌套嵌入维度。4) 学生模型架构:选择一个小型神经网络作为学生模型,例如ResNet或Transformer。

🖼️ 关键图片

📊 实验亮点

Pathryoshka在十个公共病理学基准数据集上进行了评估,实验结果表明,与大型教师模型相比,Pathryoshka在性能相当的情况下,将模型大小减少了86-92%。在准确率方面,Pathryoshka比同等大小的先进单教师蒸馏模型平均高出7.0%。这些结果表明,Pathryoshka能够有效地压缩病理学基础模型,同时保持甚至提升模型性能。

🎯 应用场景

Pathryoshka具有广泛的应用前景,可用于病理图像分析、疾病诊断、预后预测等领域。通过压缩病理学基础模型,Pathryoshka使得这些模型能够在资源受限的环境中部署和应用,例如移动设备、边缘计算平台等。这将有助于推动精准医疗的发展,提高医疗诊断的效率和准确性,并为患者提供更好的医疗服务。未来,Pathryoshka可以进一步扩展到其他医学图像分析领域,例如放射影像学、眼科图像分析等。

📄 摘要(原文)

Pathology foundation models (FMs) have driven significant progress in computational pathology. However, these high-performing models can easily exceed a billion parameters and produce high-dimensional embeddings, thus limiting their applicability for research or clinical use when computing resources are tight. Here, we introduce Pathryoshka, a multi-teacher distillation framework inspired by RADIO distillation and Matryoshka Representation Learning to reduce pathology FM sizes while allowing for adaptable embedding dimensions. We evaluate our framework with a distilled model on ten public pathology benchmarks with varying downstream tasks. Compared to its much larger teachers, Pathryoshka reduces the model size by 86-92% at on-par performance. It outperforms state-of-the-art single-teacher distillation models of comparable size by a median margin of 7.0 in accuracy. By enabling efficient local deployment without sacrificing accuracy or representational richness, Pathryoshka democratizes access to state-of-the-art pathology FMs for the broader research and clinical community.