Analyzing Image Beyond Visual Aspect: Image Emotion Classification via Multiple-Affective Captioning

作者: Zibo Zhou, Zhengjun Zhai, Huimin Chen, Wei Dai, Hansen Yang

分类: cs.CV

发布日期: 2025-11-28

💡 一句话要点

提出ACIEC框架,通过多重情感描述进行图像情感分类,有效弥补情感鸿沟。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像情感分类 情感描述生成 对比学习 预训练语言模型 情感鸿沟

📋 核心要点

- 现有图像情感分类方法受限于“情感鸿沟”,难以有效利用预训练视觉模型的知识。

- 提出ACIEC框架,通过生成情感描述文本,利用语言的多样性和丰富性来弥补情感鸿沟。

- 实验表明,ACIEC在多个基准测试中取得了优异的结果,验证了其有效性。

📝 摘要(中文)

图像情感分类(IEC)是一个长期研究领域,随着深度学习的快速发展,受到了越来越多的关注。尽管最近的进展利用了预训练视觉模型中编码的知识,但它们的有效性受到“情感鸿沟”的限制,限制了预训练知识在IEC任务中的适用性。心理学已经证明,语言具有高度的可变性,包含多样且丰富的信息,并且可以有效地消除“情感鸿沟”。受此启发,我们提出了一种新的基于情感描述的图像情感分类(ACIEC)方法,该方法基于纯文本对图像情感进行分类,从而有效地捕获图像中的情感信息。在我们的方法中,设计了一种分层多级对比损失,用于检测图像中的情感概念,同时提出了一种情感属性链式推理来生成情感句子。然后,利用预训练语言模型来综合情感概念和情感句子以进行IEC。此外,设计了一种基于语义相似性采样的对比损失,以解决情感数据集中大的类内差异和小的类间差异的问题。此外,我们还考虑了嵌入文本的图像,而之前的研究忽略了这些图像。大量的实验表明,我们的方法可以有效地弥合情感鸿沟,并在多个基准测试中取得优异的结果。

🔬 方法详解

问题定义:图像情感分类(IEC)旨在识别图像所表达的情感。现有方法主要依赖视觉特征,但由于“情感鸿沟”的存在,视觉特征难以准确捕捉图像中的情感信息。此外,现有方法忽略了包含嵌入文本的图像,这部分图像也蕴含着丰富的情感信息。

核心思路:论文的核心思路是利用语言来弥补“情感鸿沟”。通过生成图像的情感描述文本,将图像的情感信息转化为文本信息,然后利用预训练语言模型进行情感分类。语言具有高度的可变性和丰富性,能够更有效地表达情感。

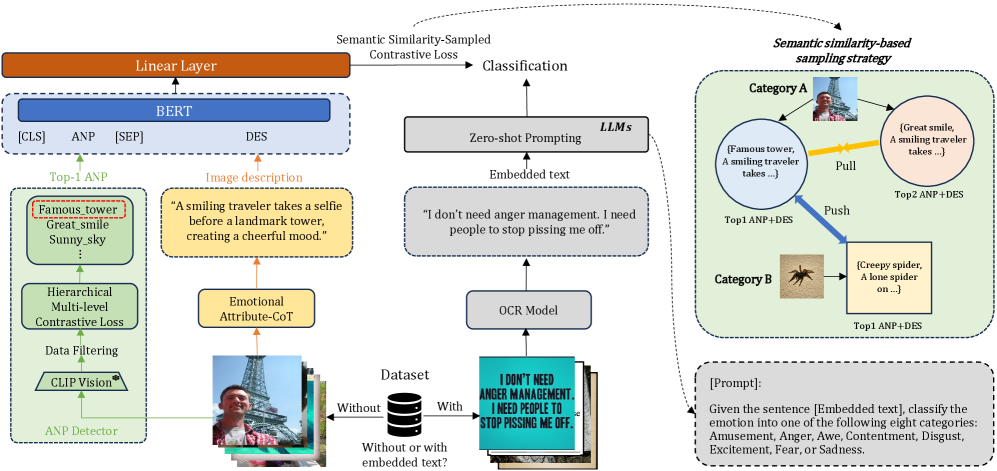

技术框架:ACIEC框架主要包含以下几个模块:1)情感概念检测模块:利用分层多级对比损失,从图像中检测情感概念。2)情感描述生成模块:利用情感属性链式推理,生成情感句子。3)情感分类模块:利用预训练语言模型,综合情感概念和情感句子进行情感分类。此外,还设计了基于语义相似性采样的对比损失,以解决情感数据集中类内差异大和类间差异小的问题。对于包含嵌入文本的图像,也将其文本信息纳入考虑。

关键创新:论文的关键创新在于:1)提出了一种基于情感描述的图像情感分类框架,利用语言来弥补“情感鸿沟”。2)设计了一种分层多级对比损失,用于检测图像中的情感概念。3)提出了一种情感属性链式推理,用于生成情感句子。4)设计了一种基于语义相似性采样的对比损失,以解决情感数据集中类内差异大和类间差异小的问题。

关键设计:1)分层多级对比损失:通过对比图像特征、情感概念特征和情感属性特征,学习更具判别性的情感表示。2)情感属性链式推理:通过逐步推理情感属性,生成更连贯和丰富的情感句子。3)基于语义相似性采样的对比损失:通过选择语义相似的样本进行对比学习,提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

论文在多个基准数据集上进行了实验,结果表明ACIEC框架能够有效提升图像情感分类的性能。具体而言,ACIEC在benchmark数据集上相比现有方法取得了显著的提升,证明了其有效性,具体提升幅度在论文中有详细数据。

🎯 应用场景

该研究成果可应用于情感分析、舆情监控、智能推荐等领域。例如,可以分析社交媒体上的图片,了解用户的情绪状态,从而进行个性化推荐或危机干预。此外,该方法还可以应用于智能客服、人机交互等领域,提高机器的情感理解能力。

📄 摘要(原文)

Image emotion classification (IEC) is a longstanding research field that has received increasing attention with the rapid progress of deep learning. Although recent advances have leveraged the knowledge encoded in pre-trained visual models, their effectiveness is constrained by the "affective gap" , limits the applicability of pre-training knowledge for IEC tasks. It has been demonstrated in psychology that language exhibits high variability, encompasses diverse and abundant information, and can effectively eliminate the "affective gap". Inspired by this, we propose a novel Affective Captioning for Image Emotion Classification (ACIEC) to classify image emotion based on pure texts, which effectively capture the affective information in the image. In our method, a hierarchical multi-level contrastive loss is designed for detecting emotional concepts from images, while an emotional attribute chain-of-thought reasoning is proposed to generate affective sentences. Then, a pre-trained language model is leveraged to synthesize emotional concepts and affective sentences to conduct IEC. Additionally, a contrastive loss based on semantic similarity sampling is designed to solve the problem of large intra-class differences and small inter-class differences in affective datasets. Moreover, we also take the images with embedded texts into consideration, which were ignored by previous studies. Extensive experiments illustrate that our method can effectively bridge the affective gap and achieve superior results on multiple benchmarks.