Geometry-Consistent 4D Gaussian Splatting for Sparse-Input Dynamic View Synthesis

作者: Yiwei Li, Jiannong Cao, Penghui Ruan, Divya Saxena, Songye Zhu, Yinfeng Cao

分类: cs.CV

发布日期: 2025-11-28

💡 一句话要点

提出GC-4DGS,通过几何一致性提升稀疏输入下动态场景的4D高斯溅射渲染质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 动态场景渲染 高斯溅射 几何一致性 稀疏视图 多视图立体 单目深度估计 AIoT 数字孪生

📋 核心要点

- 现有动态高斯溅射方法在稀疏视图输入下性能显著下降,原因是4D几何体学习不连贯,限制了实际应用。

- GC-4DGS通过动态一致性检查策略减少MVS不确定性,并利用全局-局部深度正则化方法提取时空一致的几何信息。

- 实验表明,GC-4DGS在N3DV和Technicolor数据集上优于RF-DeRF和原始4DGS,且易于部署在IoT边缘设备上。

📝 摘要(中文)

高斯溅射已被认为是动态场景视图合成的一种新方法,在数字孪生等AIoT应用中显示出巨大潜力。然而,当只有稀疏输入视图可用时,现有的动态高斯溅射方法性能显著下降,限制了其在实践中的应用。这个问题源于输入视图减少时4D几何体的不连贯学习。本文提出了GC-4DGS,一个将几何一致性注入4D高斯溅射(4DGS)的新框架,从稀疏输入视图提供实时和高质量的动态场景渲染。虽然基于学习的多视图立体(MVS)和单目深度估计器(MDEs)提供了几何先验,但由于稀疏输入4D几何优化问题的病态性,直接将它们与4DGS集成会产生次优结果。为了解决这些问题,我们引入了一种动态一致性检查策略,以减少MVS在时空中的估计不确定性。此外,我们提出了一种全局-局部深度正则化方法,从单目深度中提取时空一致的几何信息,从而增强4D体积内连贯的几何和外观学习。在流行的N3DV和Technicolor数据集上的大量实验验证了GC-4DGS在不牺牲效率的情况下提高渲染质量的有效性。值得注意的是,我们的方法在PSNR方面分别优于最新的针对稀疏输入动态视图合成的动态辐射场RF-DeRF和原始4DGS 2.62dB和1.58dB,并且可以在资源受限的IoT边缘设备上无缝部署。

🔬 方法详解

问题定义:论文旨在解决稀疏输入视图下,动态高斯溅射(4DGS)方法渲染质量显著下降的问题。现有方法在稀疏视图下难以学习到连贯的4D几何体,导致渲染效果不佳。直接将多视图立体(MVS)或单目深度估计(MDE)结果融入4DGS,由于稀疏输入带来的优化问题病态性,效果提升有限。

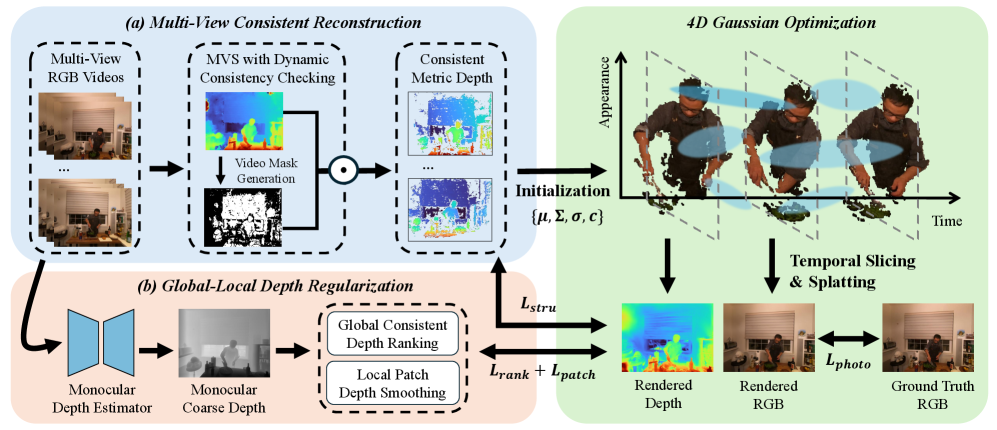

核心思路:论文的核心思路是将几何一致性注入到4DGS中,通过引入动态一致性检查和全局-局部深度正则化,增强4D体积内几何和外观学习的连贯性。通过更可靠的几何先验信息,提升稀疏视图下的渲染质量。

技术框架:GC-4DGS框架主要包含以下几个阶段:1) 利用MVS和MDE获取几何先验;2) 引入动态一致性检查策略,减少MVS在时空中的不确定性;3) 提出全局-局部深度正则化方法,从单目深度中提取时空一致的几何信息;4) 将增强的几何信息融入4DGS进行优化和渲染。

关键创新:论文的关键创新在于:1) 提出了动态一致性检查策略,有效降低了MVS在时空中的估计误差;2) 设计了全局-局部深度正则化方法,从单目深度估计中提取更可靠的时空一致几何信息,并将其融入到4DGS的优化过程中。

关键设计:动态一致性检查策略的具体实现方式(未知)。全局-局部深度正则化方法中,全局正则化和局部正则化的具体损失函数形式(未知)。MVS和MDE的具体网络结构选择(未知)。

🖼️ 关键图片

📊 实验亮点

GC-4DGS在N3DV和Technicolor数据集上进行了广泛的实验验证。实验结果表明,GC-4DGS在PSNR指标上分别优于最新的动态辐射场方法RF-DeRF 2.62dB,优于原始4DGS 1.58dB。同时,该方法保持了较高的渲染效率,可以在资源受限的IoT边缘设备上部署。

🎯 应用场景

该研究成果可应用于数字孪生、虚拟现实、增强现实、自动驾驶等领域。尤其是在资源受限的IoT边缘设备上,高质量的动态场景渲染具有重要的实际价值。未来,该技术有望推动AIoT应用的发展,例如远程协作、智能监控等。

📄 摘要(原文)

Gaussian Splatting has been considered as a novel way for view synthesis of dynamic scenes, which shows great potential in AIoT applications such as digital twins. However, recent dynamic Gaussian Splatting methods significantly degrade when only sparse input views are available, limiting their applicability in practice. The issue arises from the incoherent learning of 4D geometry as input views decrease. This paper presents GC-4DGS, a novel framework that infuses geometric consistency into 4D Gaussian Splatting (4DGS), offering real-time and high-quality dynamic scene rendering from sparse input views. While learning-based Multi-View Stereo (MVS) and monocular depth estimators (MDEs) provide geometry priors, directly integrating these with 4DGS yields suboptimal results due to the ill-posed nature of sparse-input 4D geometric optimization. To address these problems, we introduce a dynamic consistency checking strategy to reduce estimation uncertainties of MVS across spacetime. Furthermore, we propose a global-local depth regularization approach to distill spatiotemporal-consistent geometric information from monocular depths, thereby enhancing the coherent geometry and appearance learning within the 4D volume. Extensive experiments on the popular N3DV and Technicolor datasets validate the effectiveness of GC-4DGS in rendering quality without sacrificing efficiency. Notably, our method outperforms RF-DeRF, the latest dynamic radiance field tailored for sparse-input dynamic view synthesis, and the original 4DGS by 2.62dB and 1.58dB in PSNR, respectively, with seamless deployability on resource-constrained IoT edge devices.