Contrastive Heliophysical Image Pretraining for Solar Dynamics Observatory Records

作者: Shiyu Shen, Zhe Gao, Taifeng Chai, Yang Huang, Bin Pan

分类: cs.CV

发布日期: 2025-11-28

💡 一句话要点

提出SolarCHIP,用于SDO太阳图像的对比预训练,提升跨模态转换和耀斑分类性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 太阳图像分析 对比学习 预训练模型 多模态学习 太阳物理学 耀斑分类 跨模态转换

📋 核心要点

- 现有太阳图像分析方法依赖于从头训练或自然图像预训练,忽略了SDO数据的独特性,导致性能受限。

- SolarCHIP通过多粒度对比学习,对齐跨模态、跨时序和跨空间的信息,从而学习到更鲁棒的太阳图像特征。

- 实验表明,SolarCHIP在跨模态转换和耀斑分类任务上均优于现有方法,尤其在低资源场景下提升显著。

📝 摘要(中文)

深度学习彻底改变了太阳图像分析,但大多数方法从头开始训练特定任务的编码器,或者依赖于忽略太阳动力学天文台(SDO)数据独特特征的自然图像预训练。我们提出了SolarCHIP,一系列对比预训练的视觉骨干网络,专门为多仪器SDO观测设计。SolarCHIP解决了太阳成像中的三个关键挑战:AIA和HMI仪器之间的多模态传感、由于缓慢的时间演化导致的弱类间可分性,以及具有稀疏活动信号的强类内变异性。我们的预训练框架采用多粒度对比目标,共同对齐(1)共时AIA-HMI对之间的全局类token以增强时间判别能力,(2)固定空间索引处的局部patch token以强制位置一致、模态不变的特征,以及(3)不同空间位置的样本内patch以保留细粒度的空间结构。我们训练了基于CNN和Vision Transformer的自编码器,并证明了它们在两个下游任务上的有效性:通过ControlNet实现的HMI和AIA波段之间的跨模态转换,以及全盘耀斑分类。实验结果表明,SolarCHIP在两项任务中都取得了最先进的性能,尤其是在标记数据有限的低资源环境中。消融研究证实,每个对比组件都在不同粒度上贡献了重要的判别能力。通过公开发布预训练权重和训练代码,我们为太阳物理学界提供了一个实用的、即插即用的特征提取器,它降低了计算需求,提高了标签效率,并为各种太阳成像应用建立了一个可重用的基础。

🔬 方法详解

问题定义:现有太阳图像分析方法主要面临三个问题:一是SDO数据包含来自不同仪器(AIA和HMI)的多模态信息,需要有效融合;二是太阳活动演化缓慢,导致类间区分度不高;三是太阳活动具有稀疏性,类内差异大。直接使用自然图像预训练模型无法有效解决这些问题。

核心思路:SolarCHIP的核心思路是利用对比学习,学习一个能够有效区分不同模态、不同时间以及不同空间位置的太阳图像特征表示。通过对比学习,模型能够学习到对模态不变、对时间敏感、对空间位置敏感的特征,从而更好地应对太阳图像分析中的挑战。

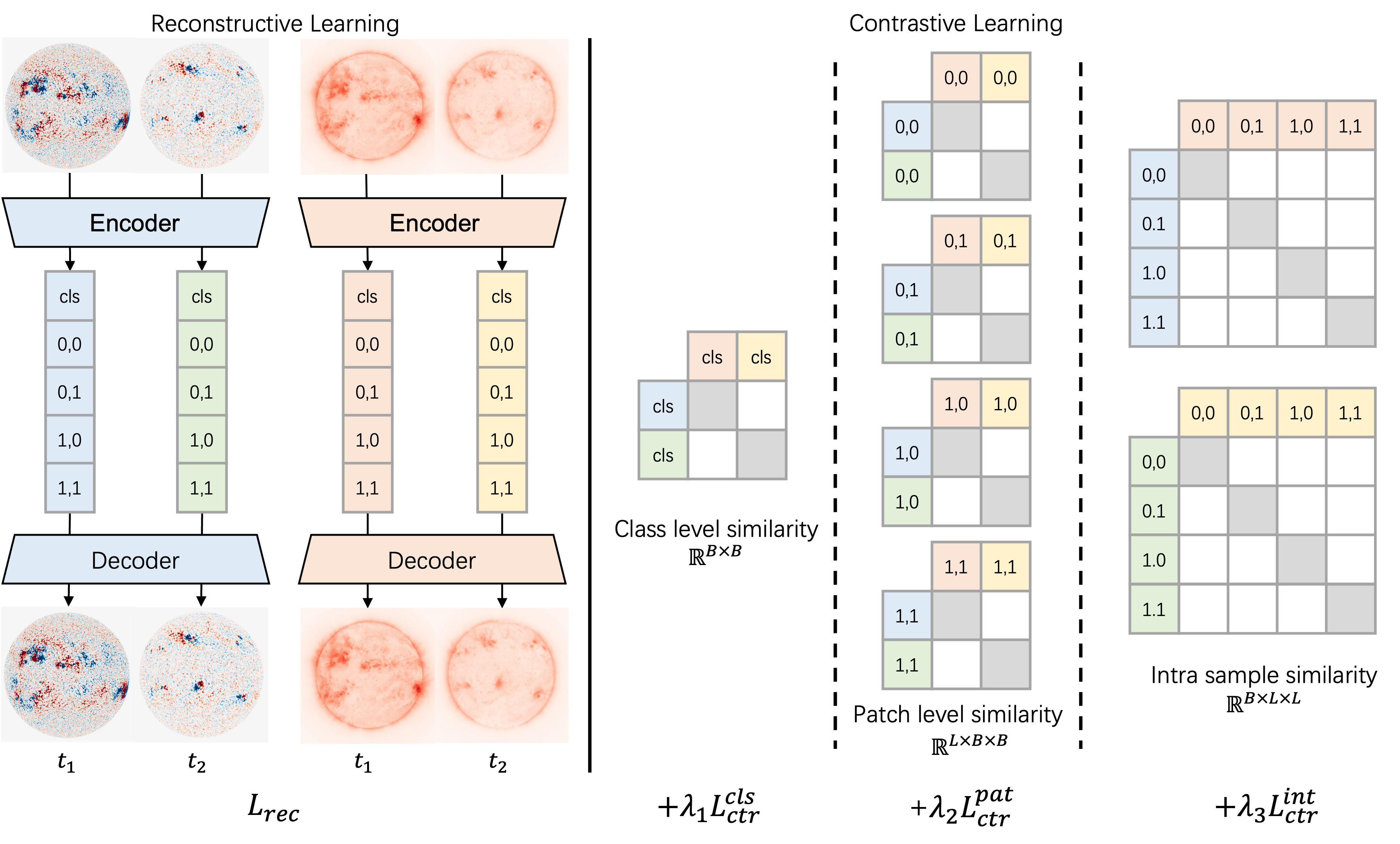

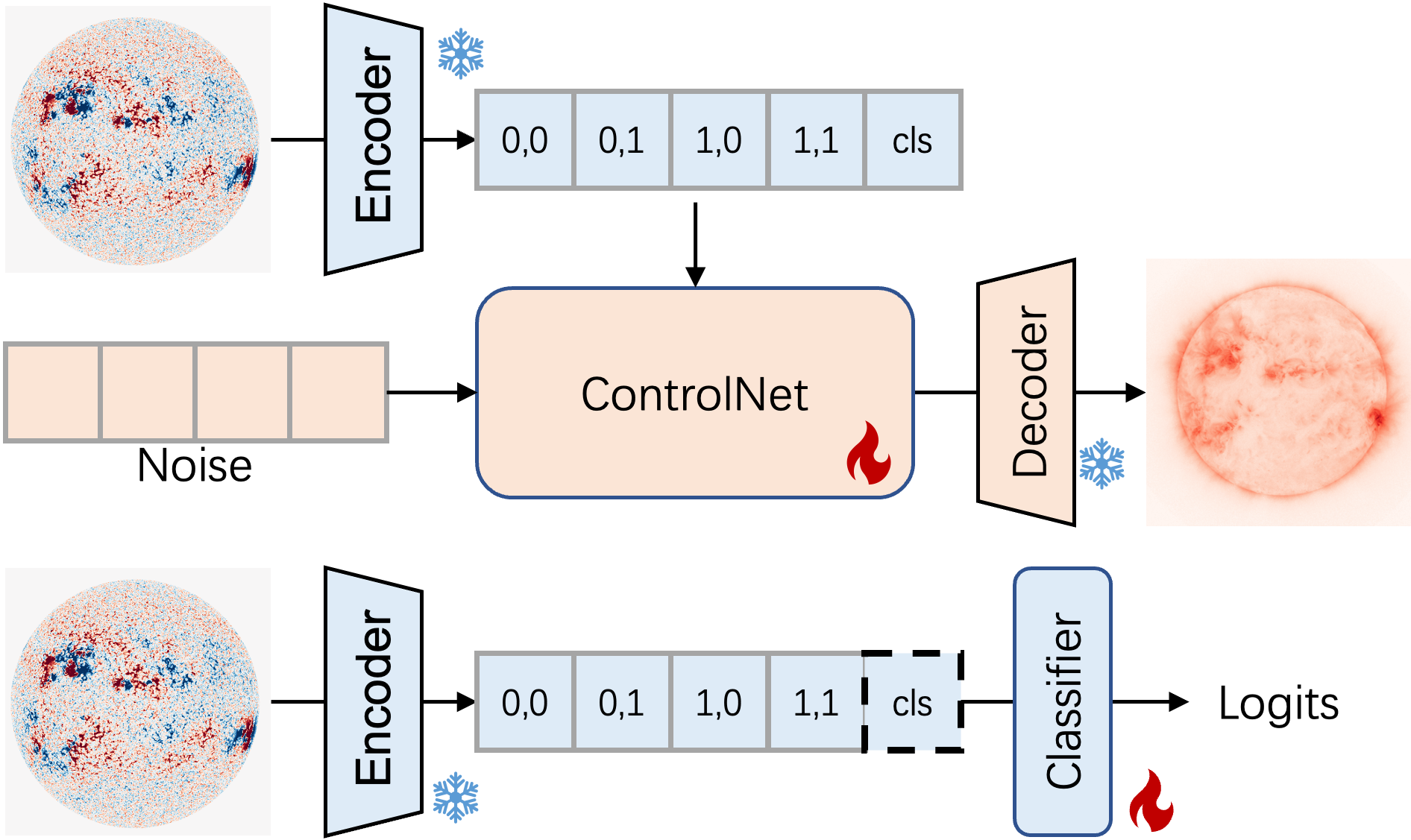

技术框架:SolarCHIP的整体框架是一个对比学习的预训练流程。首先,将AIA和HMI的图像对输入到基于CNN或Vision Transformer的自编码器中。然后,通过多粒度对比损失函数,对齐不同模态、不同时间和不同空间位置的特征表示。具体来说,框架包含三个主要的对比学习目标:(1) 全局类token对齐,增强时间判别能力;(2) 局部patch token对齐,强制位置一致、模态不变的特征;(3) 样本内patch对齐,保留细粒度的空间结构。

关键创新:SolarCHIP的关键创新在于其多粒度的对比学习目标。传统的对比学习方法通常只关注全局特征的对比,而SolarCHIP同时考虑了全局、局部和样本内的对比,从而能够学习到更丰富的太阳图像特征表示。这种多粒度的对比学习方法能够更好地应对太阳图像分析中的多模态、弱类间可分性和强类内变异性等挑战。

关键设计:SolarCHIP的关键设计包括:(1) 使用了基于CNN和Vision Transformer的自编码器作为骨干网络,可以灵活选择;(2) 设计了多粒度的对比损失函数,包括全局类token对比损失、局部patch token对比损失和样本内patch对比损失;(3) 在训练过程中,使用了大量的SDO数据,包括AIA和HMI的图像对,以及相应的标签信息。

🖼️ 关键图片

📊 实验亮点

SolarCHIP在跨模态转换和全盘耀斑分类任务上取得了显著的性能提升。在跨模态转换任务中,SolarCHIP能够生成高质量的AIA图像,视觉效果逼真。在全盘耀斑分类任务中,SolarCHIP的F1-score超过了现有方法,尤其是在低资源环境下,性能提升更为明显。消融实验表明,每个对比组件都对性能提升有贡献。

🎯 应用场景

SolarCHIP可广泛应用于太阳物理学研究,例如太阳耀斑预测、日冕物质抛射检测、太阳活动区识别等。通过提供一个预训练的特征提取器,SolarCHIP可以降低下游任务的计算成本,提高标签效率,并促进太阳图像分析领域的发展。该模型也可应用于其他空间物理图像分析任务。

📄 摘要(原文)

Deep learning has revolutionized solar image analysis, yet most approaches train task-specific encoders from scratch or rely on natural-image pretraining that ignores the unique characteristics of Solar Dynamics Observatory (SDO) data. We introduce SolarCHIP, a family of contrastively pretrained visual backbones tailored to multi-instrument SDO observations. SolarCHIP addresses three key challenges in solar imaging: multimodal sensing across AIA and HMI instruments, weak inter-class separability due to slow temporal evolution, and strong intra-class variability with sparse activity signals. Our pretraining framework employs a multi-granularity contrastive objective that jointly aligns (1) global class tokens across co-temporal AIA-HMI pairs to enhance temporal discrimination, (2) local patch tokens at fixed spatial indices to enforce position-consistent, modality-invariant features, and (3) intra-sample patches across different spatial locations to preserve fine-grained spatial structure. We train both CNN- and Vision Transformer-based autoencoders and demonstrate their effectiveness on two downstream tasks: cross-modal translation between HMI and AIA passbands via ControlNet, and full-disk flare classification. Experimental results show that SolarCHIP achieves state-of-the-art performance across both tasks, with particularly strong gains in low-resource settings where labeled data is limited. Ablation studies confirm that each contrastive component contributes essential discriminative capacity at different granularities. By publicly releasing pretrained weights and training code, we provide the heliophysics community with a practical, plug-and-play feature extractor that reduces computational requirements, improves label efficiency, and establishes a reusable foundation for diverse solar imaging applications.