RobotSeg: A Model and Dataset for Segmenting Robots in Image and Video

作者: Haiyang Mei, Qiming Huang, Hai Ci, Mike Zheng Shou

分类: cs.CV, cs.RO

发布日期: 2025-11-28

备注: Project page: https://github.com/showlab/RobotSeg

💡 一句话要点

RobotSeg:用于图像和视频中机器人分割的模型与数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人分割 视频分割 深度学习 SAM模型 机器人感知

📋 核心要点

- 现有机器人分割方法难以应对机器人形态多样、外观模糊、结构复杂和形状快速变化等挑战。

- RobotSeg通过结构增强的记忆关联器、机器人提示生成器和标签高效训练策略,实现了结构感知、自动和标签高效的机器人分割。

- RobotSeg在自建的VRS数据集上取得了state-of-the-art的性能,为机器人感知领域提供了新的基准。

📝 摘要(中文)

精确的机器人分割是机器人感知的一项基本能力,它能够实现VLA系统的精确视觉伺服、可扩展的以机器人为中心的数据增强、精确的实物到仿真迁移,以及动态人机环境中可靠的安全监控。尽管现代分割模型具有强大的能力,但令人惊讶的是,分割机器人仍然具有挑战性。这是由于机器人形态的多样性、外观的模糊性、结构的复杂性和快速的形状变化。针对这些挑战,我们推出了RobotSeg,一个用于图像和视频中机器人分割的基础模型。RobotSeg建立在通用的SAM 2基础模型之上,但通过引入结构增强的记忆关联器、机器人提示生成器和标签高效的训练策略,解决了其在机器人分割方面的三个局限性,即缺乏对关节机器人的适应性、依赖于手动提示以及需要逐帧训练掩码注释。这些创新共同实现了一个结构感知、自动和标签高效的解决方案。我们进一步构建了视频机器人分割(VRS)数据集,该数据集包含超过2.8k个视频(138k帧),具有多样化的机器人形态和环境。大量的实验表明,RobotSeg在图像和视频上都实现了最先进的性能,为未来机器人感知的进步奠定了坚实的基础。

🔬 方法详解

问题定义:论文旨在解决图像和视频中精确分割机器人的问题。现有方法,特别是基于SAM的模型,在处理关节机器人、自动生成提示以及高效利用标签数据方面存在不足,限制了其在机器人感知领域的应用。

核心思路:论文的核心思路是通过改进SAM模型,使其能够更好地理解机器人的结构信息,自动生成分割提示,并减少对大量标注数据的依赖。通过引入结构增强的记忆关联器,模型能够学习和利用机器人的结构信息。通过机器人提示生成器,模型可以自动生成分割所需的提示,无需人工干预。通过标签高效的训练策略,模型可以在少量标注数据下实现良好的分割性能。

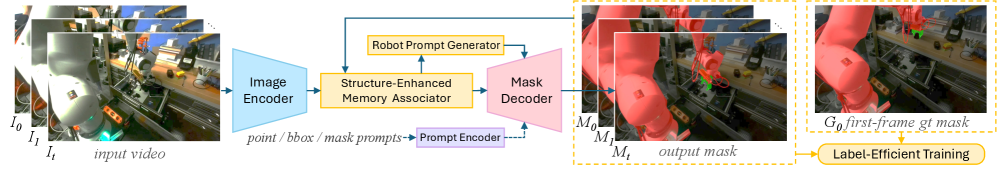

技术框架:RobotSeg的整体框架基于SAM模型,主要包含三个关键模块:结构增强的记忆关联器、机器人提示生成器和标签高效的训练策略。结构增强的记忆关联器用于学习和存储机器人的结构信息。机器人提示生成器用于自动生成分割所需的提示。标签高效的训练策略用于在少量标注数据下训练模型。整个流程包括:输入图像/视频帧,通过结构增强的记忆关联器提取结构特征,使用机器人提示生成器生成分割提示,最后使用改进的SAM模型进行分割。

关键创新:论文的关键创新在于三个方面:1) 结构增强的记忆关联器,能够有效地学习和利用机器人的结构信息,提高分割精度。2) 机器人提示生成器,实现了自动化的分割提示生成,减少了人工干预。3) 标签高效的训练策略,降低了对大量标注数据的需求。这些创新使得RobotSeg在机器人分割任务中具有更高的效率和精度。

关键设计:结构增强的记忆关联器可能采用了图神经网络等结构来建模机器人的关节结构。机器人提示生成器可能使用了基于先验知识或视觉特征的方法来生成提示。标签高效的训练策略可能采用了半监督学习或主动学习等方法来减少标注数据的需求。具体的参数设置、损失函数和网络结构等细节在论文中应该有更详细的描述(未知)。

🖼️ 关键图片

📊 实验亮点

RobotSeg在自建的VRS数据集上取得了state-of-the-art的性能,证明了其在机器人分割任务中的有效性。具体的性能数据和对比基线需要在论文中查找(未知),但摘要中明确指出其优于现有方法,为未来的研究提供了一个强大的基准。

🎯 应用场景

RobotSeg在机器人感知领域具有广泛的应用前景,例如视觉伺服、机器人数据增强、实物到仿真迁移以及人机协作安全监控。该研究可以促进机器人更加智能和自主地完成任务,提高生产效率和安全性,并为机器人技术的进一步发展奠定基础。

📄 摘要(原文)

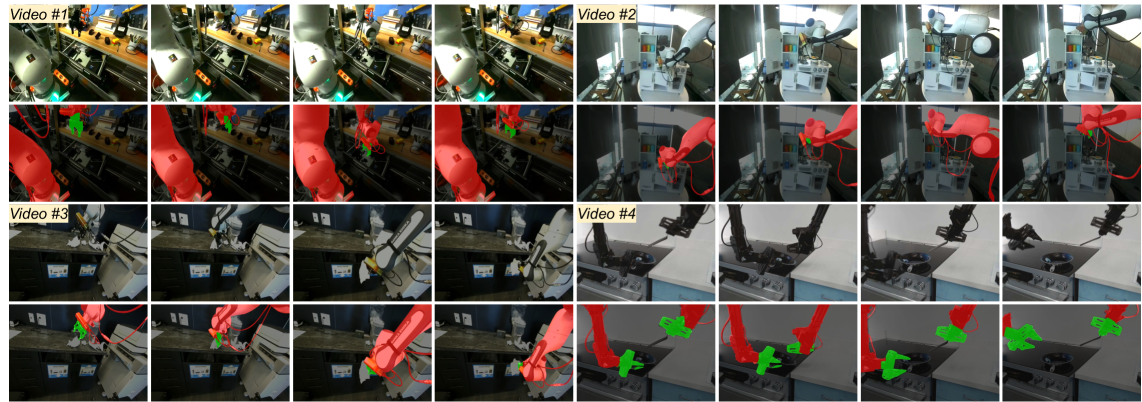

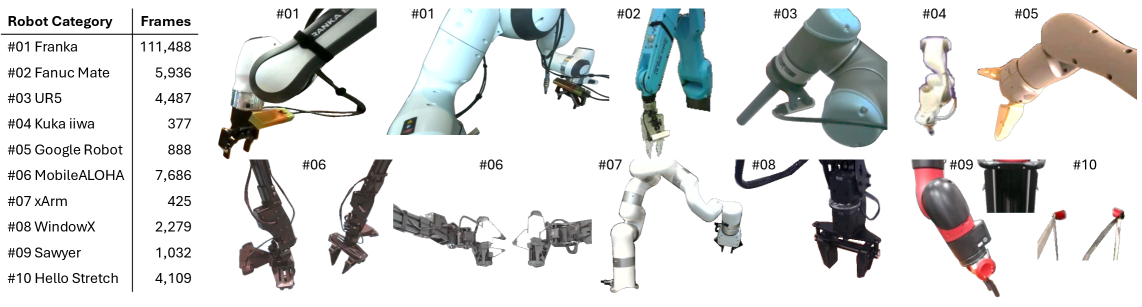

Accurate robot segmentation is a fundamental capability for robotic perception. It enables precise visual servoing for VLA systems, scalable robot-centric data augmentation, accurate real-to-sim transfer, and reliable safety monitoring in dynamic human-robot environments. Despite the strong capabilities of modern segmentation models, surprisingly it remains challenging to segment robots. This is due to robot embodiment diversity, appearance ambiguity, structural complexity, and rapid shape changes. Embracing these challenges, we introduce RobotSeg, a foundation model for robot segmentation in image and video. RobotSeg is built upon the versatile SAM 2 foundation model but addresses its three limitations for robot segmentation, namely the lack of adaptation to articulated robots, reliance on manual prompts, and the need for per-frame training mask annotations, by introducing a structure-enhanced memory associator, a robot prompt generator, and a label-efficient training strategy. These innovations collectively enable a structure-aware, automatic, and label-efficient solution. We further construct the video robot segmentation (VRS) dataset comprising over 2.8k videos (138k frames) with diverse robot embodiments and environments. Extensive experiments demonstrate that RobotSeg achieves state-of-the-art performance on both images and videos, establishing a strong foundation for future advances in robot perception.