CORA: Consistency-Guided Semi-Supervised Framework for Reasoning Segmentation

作者: Prantik Howlader, Hoang Nguyen-Canh, Srijan Das, Jingyi Xu, Hieu Le, Dimitris Samaras

分类: cs.CV

发布日期: 2025-11-21

备注: WACV 2026 accepted

💡 一句话要点

提出CORA框架,利用一致性指导的半监督学习进行推理分割

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推理分割 半监督学习 多模态学习 一致性学习 伪标签过滤

📋 核心要点

- 推理分割需要像素级的标注,数据标注成本高昂,导致模型泛化能力受限。

- CORA利用条件视觉指令、伪标签过滤和对比对齐,实现半监督推理分割。

- 实验表明,CORA在少量标注数据下,显著优于现有方法,达到SOTA水平。

📝 摘要(中文)

本文提出了一种名为CORA的半监督推理分割框架,旨在利用有限的标注数据和大量的无标注图像进行联合学习。推理分割任务需要为复杂指令所指的目标生成像素级的掩码,这需要对场景进行上下文相关的推理。CORA框架包含三个主要组成部分:1) 编码对象之间空间和上下文关系的条件视觉指令;2) 基于多模态LLM在语义等价查询中输出一致性的噪声伪标签过滤器;3) 增强特征一致性的标签和伪标签样本之间的token级对比对齐。这些组件使CORA能够在最小监督下执行鲁棒的推理分割,在受限的标注设置下优于现有的基线方法。在城市场景理解基准数据集Cityscapes上,仅使用100张标注图像,CORA就取得了最先进的结果,超过基线方法+2.3%。类似地,在组织病理学数据集PanNuke上,仅使用180张标注图像,CORA的性能提高了+2.4%。

🔬 方法详解

问题定义:推理分割旨在根据复杂的指令,为图像中的目标生成像素级别的分割掩码。现有的方法依赖于大量的标注数据,而获取高质量的像素级标注成本非常高,尤其是在需要复杂推理的场景下。这导致模型在数据分布发生变化时,性能会显著下降,泛化能力不足。

核心思路:CORA的核心思路是利用半监督学习,结合有限的标注数据和大量的无标注数据,来提升模型的推理分割能力。通过引入条件视觉指令来编码对象之间的关系,利用多模态LLM的一致性来过滤噪声伪标签,并通过对比学习来对齐标注和伪标注样本的特征,从而实现鲁棒的推理分割。

技术框架:CORA框架主要包含三个模块:1) 条件视觉指令模块:该模块用于编码图像中对象之间的空间和上下文关系,为推理分割提供必要的上下文信息。2) 伪标签过滤模块:该模块利用多模态LLM在语义等价查询中的输出一致性,来过滤掉噪声伪标签,保证伪标签的质量。3) 对比对齐模块:该模块通过token级别的对比学习,对齐标注和伪标注样本的特征,增强特征的一致性,提升模型的泛化能力。

关键创新:CORA的关键创新在于其半监督学习框架,它能够有效地利用无标注数据来提升推理分割模型的性能。与传统的监督学习方法相比,CORA只需要少量的标注数据就能达到甚至超过现有方法的性能。此外,CORA提出的伪标签过滤和对比对齐方法,能够有效地解决半监督学习中伪标签噪声的问题,提升模型的鲁棒性。

关键设计:条件视觉指令模块的具体实现方式未知,论文中可能使用了某种图神经网络或者注意力机制来编码对象之间的关系。伪标签过滤模块的关键在于如何定义语义等价查询,以及如何衡量多模态LLM输出的一致性。对比对齐模块的关键在于如何选择合适的对比损失函数,以及如何确定正负样本。这些具体的技术细节需要在论文中进一步查找。

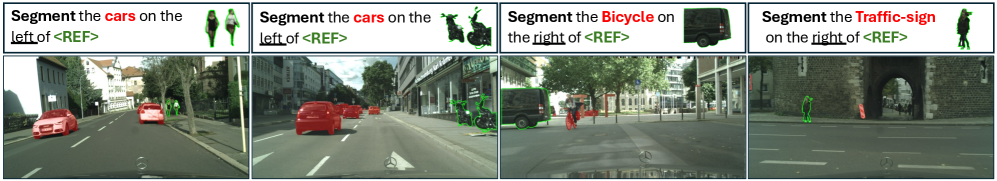

🖼️ 关键图片

📊 实验亮点

CORA在Cityscapes数据集上,仅使用100张标注图像,就超过了现有基线方法+2.3%。在PanNuke数据集上,仅使用180张标注图像,性能提高了+2.4%。这些结果表明,CORA在少量标注数据下,能够有效地提升推理分割模型的性能,具有很强的实用价值。

🎯 应用场景

CORA框架可应用于自动驾驶、医疗影像分析、机器人导航等领域。在自动驾驶中,可以根据自然语言指令分割道路、车辆和行人等目标。在医疗影像分析中,可以辅助医生识别病灶区域。在机器人导航中,可以帮助机器人理解人类指令并执行相应的任务。该研究有助于降低数据标注成本,提高模型的泛化能力,推动相关领域的智能化发展。

📄 摘要(原文)

Reasoning segmentation seeks pixel-accurate masks for targets referenced by complex, often implicit instructions, requiring context-dependent reasoning over the scene. Recent multimodal language models have advanced instruction following segmentation, yet generalization remains limited. The key bottleneck is the high cost of curating diverse, high-quality pixel annotations paired with rich linguistic supervision leading to brittle performance under distribution shift. Therefore, we present CORA, a semi-supervised reasoning segmentation framework that jointly learns from limited labeled data and a large corpus of unlabeled images. CORA introduces three main components: 1) conditional visual instructions that encode spatial and contextual relationships between objects; 2) a noisy pseudo-label filter based on the consistency of Multimodal LLM's outputs across semantically equivalent queries; and 3) a token-level contrastive alignment between labeled and pseudo-labeled samples to enhance feature consistency. These components enable CORA to perform robust reasoning segmentation with minimal supervision, outperforming existing baselines under constrained annotation settings. CORA achieves state-of-the-art results, requiring as few as 100 labeled images on Cityscapes, a benchmark dataset for urban scene understanding, surpassing the baseline by $+2.3\%$. Similarly, CORA improves performance by $+2.4\%$ with only 180 labeled images on PanNuke, a histopathology dataset.