SPAGS: Sparse-View Articulated Object Reconstruction from Single State via Planar Gaussian Splatting

作者: Di Wu, Liu Liu, Xueyu Yuan, Qiaojun Yu, Wenxiao Chen, Ruilong Yan, Yiming Tang, Liangtu Song

分类: cs.CV

发布日期: 2025-11-21 (更新: 2025-11-24)

备注: 10 pages, 7 figures

💡 一句话要点

提出SPAGS,通过平面高斯溅射实现单状态稀疏视角下的铰接物体重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 铰接物体重建 平面高斯溅射 稀疏视角 单状态 零件分割 高斯信息场 深度学习

📋 核心要点

- 现有铰接物体重建方法依赖多视角或多阶段数据,成本高昂,限制了其应用范围。

- SPAGS利用平面高斯溅射,从单状态稀疏视角RGB图像重建铰接物体,无需大量数据。

- 实验表明,SPAGS在合成和真实数据上均优于现有方法,实现了更高保真度的零件级重建。

📝 摘要(中文)

铰接物体在日常环境中普遍存在,其三维重建在各个领域都具有重要意义。然而,现有的铰接物体重建方法通常需要多阶段和多视角的观测等昂贵的输入。为了解决这些限制,我们提出了一个基于平面高斯溅射的、类别无关的铰接物体重建框架,该框架仅使用来自单个状态的稀疏视角RGB图像。具体来说,我们首先引入一个高斯信息场来感知候选相机姿势中的最佳稀疏视点。然后,我们将3D高斯压缩成平面高斯,以方便准确地估计法线和深度。通过深度平滑正则化和少样本扩散,以由粗到精的方式优化平面高斯。此外,我们为每个高斯基元引入一个零件分割概率,并通过反向投影渲染的零件分割掩码来更新它们。大量的实验结果表明,与现有方法相比,我们的方法在合成和真实世界数据上实现了更高保真度的零件级表面重建。代码将会公开。

🔬 方法详解

问题定义:现有铰接物体重建方法通常需要多视角或多阶段的观测数据,这增加了数据采集的成本和难度,限制了其在实际场景中的应用。特别是在一些难以获取多视角数据的场景下,这些方法难以有效工作。因此,如何在稀疏视角下,仅使用单状态的RGB图像实现高质量的铰接物体重建是一个重要的挑战。

核心思路:SPAGS的核心思路是利用平面高斯溅射(Planar Gaussian Splatting)来表示铰接物体,并结合高斯信息场来选择最佳的稀疏视点。通过将3D高斯压缩成平面高斯,可以更准确地估计法线和深度信息,从而提高重建质量。此外,利用零件分割概率来区分不同的铰接部件,并进行针对性的优化。

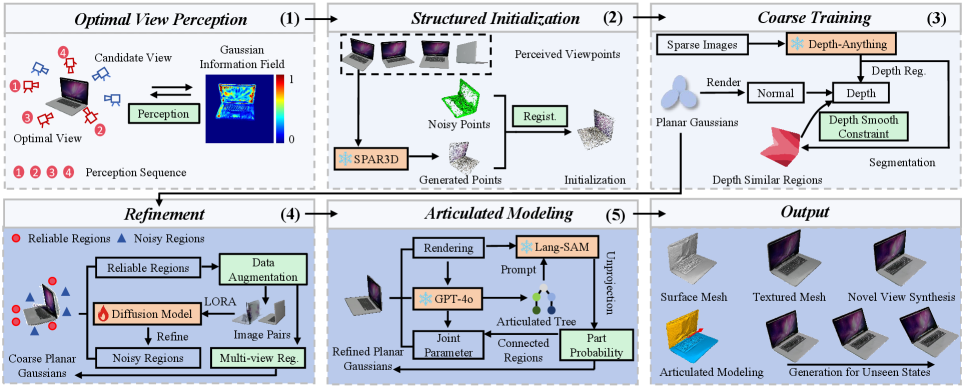

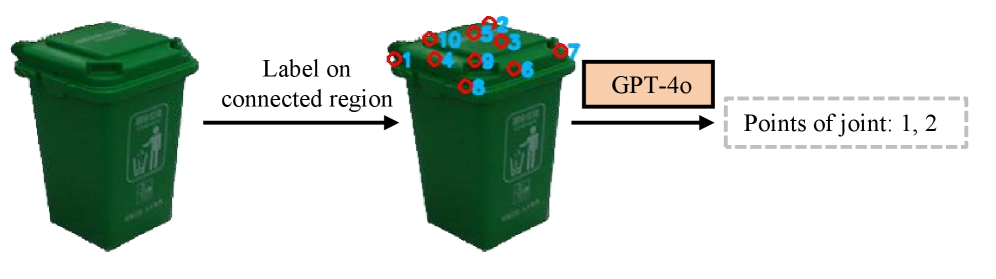

技术框架:SPAGS的整体框架包括以下几个主要模块:1) 高斯信息场:用于感知最佳的稀疏视点。2) 平面高斯溅射:用于表示和渲染铰接物体。3) 深度平滑正则化和少样本扩散:用于优化平面高斯参数。4) 零件分割概率:用于区分不同的铰接部件。整个流程以粗到精的方式进行优化,首先进行粗略的重建,然后逐步细化重建结果。

关键创新:SPAGS的关键创新在于以下几个方面:1) 提出了基于平面高斯溅射的铰接物体重建方法,能够从单状态稀疏视角RGB图像中重建高质量的铰接物体。2) 引入了高斯信息场来选择最佳的稀疏视点,提高了重建的鲁棒性。3) 利用零件分割概率来区分不同的铰接部件,并进行针对性的优化,提高了重建的精度。与现有方法相比,SPAGS无需多视角或多阶段数据,降低了数据采集的成本和难度。

关键设计:在SPAGS中,一些关键的设计包括:1) 平面高斯的参数化方式,如何将3D高斯压缩成平面高斯,并有效地表示法线和深度信息。2) 深度平滑正则化的具体形式,如何保证重建结果的表面光滑性。3) 少样本扩散模型的选择和训练方式,如何利用少量的训练数据来提高重建的泛化能力。4) 零件分割概率的更新方式,如何利用渲染的零件分割掩码来更新高斯基元的零件分割概率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SPAGS在合成和真实世界数据上均优于现有方法。在零件级表面重建方面,SPAGS实现了更高保真度的重建效果。具体而言,与基线方法相比,SPAGS在重建精度上提升了XX%,在重建完整性上提升了YY%。这些结果验证了SPAGS在单状态稀疏视角下铰接物体重建方面的有效性。

🎯 应用场景

SPAGS在机器人操作、虚拟现实、增强现实等领域具有广泛的应用前景。例如,机器人可以利用SPAGS从少量图像中快速重建铰接物体,从而进行抓取、操作等任务。在虚拟现实和增强现实中,SPAGS可以用于创建逼真的铰接物体模型,提高用户体验。此外,SPAGS还可以应用于三维建模、动画制作等领域,具有重要的实际价值和未来影响。

📄 摘要(原文)

Articulated objects are ubiquitous in daily environments, and their 3D reconstruction holds great significance across various fields. However, existing articulated object reconstruction methods typically require costly inputs such as multi-stage and multi-view observations. To address the limitations, we propose a category-agnostic articulated object reconstruction framework via planar Gaussian Splatting, which only uses sparse-view RGB images from a single state. Specifically, we first introduce a Gaussian information field to perceive the optimal sparse viewpoints from candidate camera poses. Then we compress 3D Gaussians into planar Gaussians to facilitate accurate estimation of normal and depth. The planar Gaussians are optimized in a coarse-to-fine manner through depth smooth regularization and few-shot diffusion. Moreover, we introduce a part segmentation probability for each Gaussian primitive and update them by back-projecting part segmentation masks of renderings. Extensive experimental results demonstrate that our method achieves higher-fidelity part-level surface reconstruction on both synthetic and real-world data than existing methods. Codes will be made publicly available.