MatPedia: A Universal Generative Foundation for High-Fidelity Material Synthesis

作者: Di Luo, Shuhui Yang, Mingxin Yang, Jiawei Lu, Yixuan Tang, Xintong Han, Zhuo Chen, Beibei Wang, Chunchao Guo

分类: cs.CV

发布日期: 2025-11-21

💡 一句话要点

MatPedia:用于高保真材质合成的通用生成基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 材质合成 PBR渲染 生成模型 扩散模型 RGB-PBR表示

📋 核心要点

- 现有材质生成方法缺乏统一的RGB-PBR表示,导致任务流程分散,无法有效利用大规模RGB图像数据。

- MatPedia提出了一种联合RGB-PBR表示,将材质编码为相互依赖的RGB外观和PBR属性潜在变量,并利用视频扩散模型捕获它们的相关性。

- MatPedia在MatHybrid-410K数据集上训练,实现了高质量和高多样性的1024x1024材质合成,显著优于现有方法。

📝 摘要(中文)

基于物理的渲染(PBR)材质是照片级真实感图形的基础,但它们的创建仍然是劳动密集型的,并且需要专门的知识。虽然生成模型已经推动了材质合成的发展,但现有方法缺乏统一的表示来桥接自然图像外观和PBR属性,导致零散的特定任务流程,并且无法利用大规模RGB图像数据。我们提出了MatPedia,一个建立在新的联合RGB-PBR表示之上的基础模型,该模型将材质紧凑地编码为两个相互依赖的潜在变量:一个用于RGB外观,一个用于编码互补物理属性的四个PBR贴图。通过将它们公式化为5帧序列并采用视频扩散架构,MatPedia自然地捕获了它们的相关性,同时从RGB生成模型中转移视觉先验。这种联合表示使得能够在单个架构中处理多个材质任务——文本到材质生成、图像到材质生成和内在分解——的统一框架。MatPedia在MatHybrid-410K(一个混合语料库,结合了PBR数据集和大规模RGB图像)上进行训练,实现了原生$1024 imes1024$合成,在质量和多样性方面都大大超过了现有方法。

🔬 方法详解

问题定义:论文旨在解决PBR材质生成过程中,现有方法无法有效统一处理RGB图像外观和PBR物理属性,导致流程割裂,难以利用大规模RGB图像数据的问题。现有方法通常针对特定任务设计,缺乏通用性,且生成质量和多样性受限。

核心思路:论文的核心思路是提出一种联合RGB-PBR表示,将材质的RGB外观和PBR属性编码到相互依赖的潜在空间中。通过这种方式,模型可以同时学习材质的视觉外观和物理属性,从而实现更真实、更多样化的材质生成。同时,利用视频扩散模型来建模RGB外观和PBR属性之间的相关性。

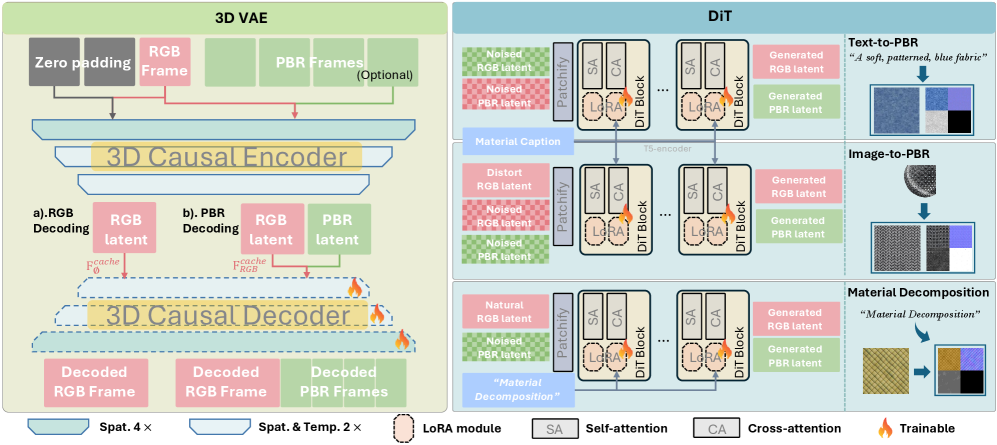

技术框架:MatPedia的整体框架包括一个联合RGB-PBR表示模块和一个视频扩散生成模块。首先,RGB图像和PBR贴图被编码到各自的潜在空间中。然后,这些潜在变量被组合成一个5帧的序列,输入到视频扩散模型中进行训练。训练完成后,可以通过文本或图像输入来生成相应的材质。该框架支持文本到材质生成、图像到材质生成和内在分解等多种任务。

关键创新:MatPedia的关键创新在于提出了联合RGB-PBR表示,并将其与视频扩散模型相结合。这种联合表示能够有效地捕捉RGB外观和PBR属性之间的相关性,从而生成更高质量、更多样化的材质。此外,该框架具有通用性,可以处理多种材质生成任务。

关键设计:论文将RGB图像和四个PBR贴图(例如,base color, normal, roughness, metallic)组合成一个5帧的序列,作为视频扩散模型的输入。视频扩散模型采用U-Net架构,并使用Transformer来建模帧之间的关系。损失函数包括L1损失和感知损失,以提高生成材质的视觉质量。MatHybrid-410K数据集包含PBR数据集和大规模RGB图像,用于训练模型。

🖼️ 关键图片

📊 实验亮点

MatPedia在MatHybrid-410K数据集上进行了训练,并在多个材质生成任务上取得了显著的性能提升。实验结果表明,MatPedia生成的材质在质量和多样性方面都优于现有方法。例如,在文本到材质生成任务中,MatPedia生成的材质的FID分数显著低于其他基线方法,表明其生成质量更高。此外,MatPedia还能够生成具有复杂物理属性的材质,例如各向异性反射和透明度。

🎯 应用场景

MatPedia具有广泛的应用前景,包括游戏开发、电影制作、产品设计和虚拟现实等领域。它可以帮助艺术家和设计师快速生成高质量的PBR材质,从而提高工作效率和创作自由度。此外,MatPedia还可以用于材质编辑和修复,以及基于图像的材质重建等任务,具有重要的实际价值。

📄 摘要(原文)

Physically-based rendering (PBR) materials are fundamental to photorealistic graphics, yet their creation remains labor-intensive and requires specialized expertise. While generative models have advanced material synthesis, existing methods lack a unified representation bridging natural image appearance and PBR properties, leading to fragmented task-specific pipelines and inability to leverage large-scale RGB image data. We present MatPedia, a foundation model built upon a novel joint RGB-PBR representation that compactly encodes materials into two interdependent latents: one for RGB appearance and one for the four PBR maps encoding complementary physical properties. By formulating them as a 5-frame sequence and employing video diffusion architectures, MatPedia naturally captures their correlations while transferring visual priors from RGB generation models. This joint representation enables a unified framework handling multiple material tasks--text-to-material generation, image-to-material generation, and intrinsic decomposition--within a single architecture. Trained on MatHybrid-410K, a mixed corpus combining PBR datasets with large-scale RGB images, MatPedia achieves native $1024\times1024$ synthesis that substantially surpasses existing approaches in both quality and diversity.