SOSControl: Enhancing Human Motion Generation through Saliency-Aware Symbolic Orientation and Timing Control

作者: Ho Yin Au, Junkun Jiang, Jie Chen

分类: cs.CV, cs.MM

发布日期: 2025-11-14

备注: Accepted by AAAI 2026

💡 一句话要点

提出SOSControl框架,通过显著性导向的符号化控制增强人体动作生成。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体动作生成 文本到动作 符号化控制 显著性检测 运动控制

📋 核心要点

- 现有文本到动作生成方法缺乏精确控制,难以指定身体部位的朝向和动作时序。

- 提出SOSControl框架,利用显著性朝向符号(SOS)脚本,实现对关键帧身体部位朝向和动作时序的精确控制。

- 实验表明,SOSControl在运动质量、可控性和泛化性方面优于现有方法,并能生成可解释的脚本。

📝 摘要(中文)

本文提出了一种名为SOSControl的框架,旨在提升文本到动作生成的可控性。传统方法缺乏精确控制,而基于关节关键帧位置的方法仅提供位置引导,难以指定身体部位的朝向和动作时序。为了解决这些问题,我们引入了显著性朝向符号(SOS)脚本,这是一个可编程的符号化框架,用于指定关键帧处身体部位的朝向和动作时序。此外,我们提出了一个自动SOS提取流程,该流程采用时间约束的凝聚聚类进行帧显著性检测,并采用基于显著性的掩码方案(SMS)直接从运动数据生成稀疏、可解释的SOS脚本。SOSControl框架将稀疏SOS脚本中的可用朝向符号视为显著信息,并在动作生成过程中优先满足这些约束。通过结合基于SMS的数据增强和基于梯度的迭代优化,该框架增强了与用户指定约束的对齐。此外,它采用基于ControlNet的ACTOR-PAE解码器,以确保平滑自然的运动输出。大量实验表明,SOS提取流程生成了具有显著关键帧符号注释的可解释脚本,而SOSControl框架在运动质量、可控性和运动时序及身体部位朝向控制的泛化性方面优于现有基线。

🔬 方法详解

问题定义:现有的文本到动作生成框架在控制精度上存在不足,尤其是在指定身体部位的朝向和动作时序方面。基于关节关键帧位置的方法虽然提供了一定的控制,但本质上是位置引导,用户难以直观地操控身体的姿态和动作节奏。因此,如何实现对人体动作生成过程的精细化控制,成为了一个亟待解决的问题。

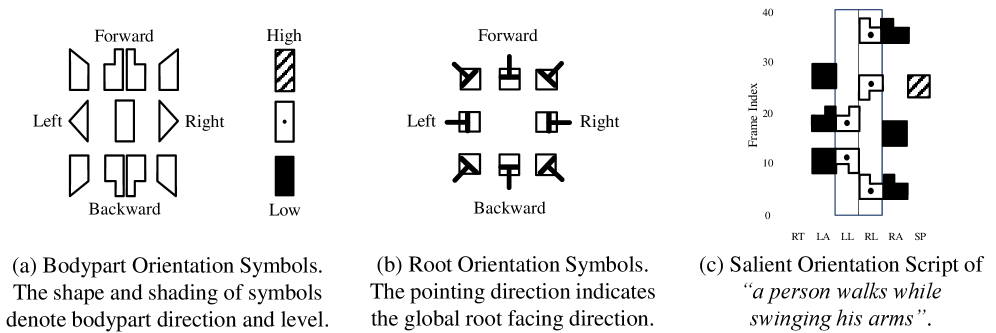

核心思路:SOSControl的核心思路是引入显著性朝向符号(SOS)脚本,将关键帧的身体部位朝向和动作时序进行符号化表示,并将其作为控制信号。通过优先满足这些显著性约束,引导动作生成过程,从而实现对动作的精确控制。这种方法将连续的运动数据转化为离散的符号表示,使得用户可以更加直观地理解和操控动作。

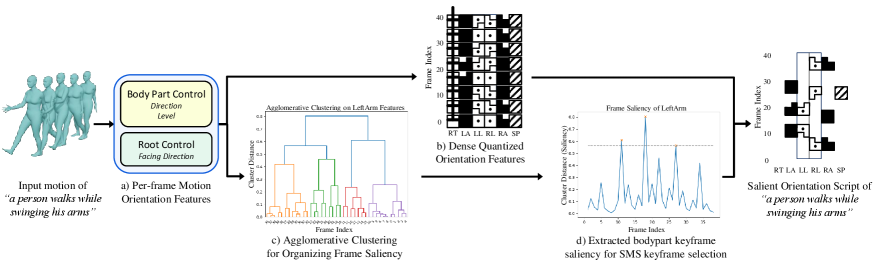

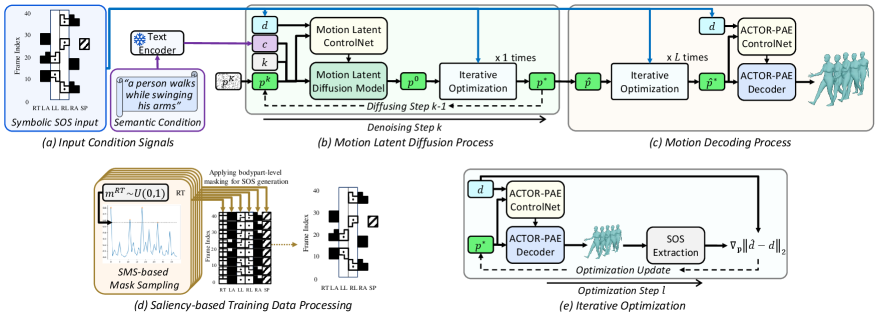

技术框架:SOSControl框架主要包含两个部分:SOS提取流程和动作生成流程。SOS提取流程首先通过时间约束的凝聚聚类进行帧显著性检测,然后利用基于显著性的掩码方案(SMS)从运动数据中生成稀疏的SOS脚本。动作生成流程则将SOS脚本作为输入,通过结合SMS-based数据增强和梯度迭代优化,增强与用户指定约束的对齐。最后,使用基于ControlNet的ACTOR-PAE解码器生成平滑自然的运动输出。

关键创新:该论文的关键创新在于提出了SOS脚本和SOSControl框架。SOS脚本是一种可编程的符号化框架,能够精确地指定关键帧处身体部位的朝向和动作时序。SOSControl框架则将SOS脚本中的朝向符号视为显著信息,并在动作生成过程中优先满足这些约束。与现有方法相比,SOSControl能够提供更加精细和直观的控制,从而生成更加符合用户意图的动作。

关键设计:SOS提取流程中,时间约束的凝聚聚类用于保证提取的关键帧在时间上的连贯性。基于显著性的掩码方案(SMS)用于生成稀疏的SOS脚本,减少了冗余信息。在动作生成流程中,基于SMS的数据增强用于扩充训练数据,提高模型的泛化能力。梯度迭代优化用于增强与用户指定约束的对齐。ControlNet-based ACTOR-PAE解码器则用于生成平滑自然的运动输出。具体的参数设置和损失函数细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SOSControl框架在运动质量、可控性和泛化性方面均优于现有基线方法。通过SOS提取流程生成的脚本具有良好的可解释性,能够清晰地反映动作的关键特征。在用户指定的约束条件下,SOSControl能够生成更加符合用户意图的动作,并且能够保持运动的自然性和流畅性。具体的性能提升数据和对比基线信息在论文中进行了详细描述(未知)。

🎯 应用场景

SOSControl框架具有广泛的应用前景,例如虚拟现实、游戏开发、动画制作等领域。它可以用于创建更加逼真和可控的虚拟角色动作,提升用户体验。此外,该框架还可以应用于康复训练、运动分析等领域,为专业人士提供更加精确的动作控制和分析工具。未来,该技术有望在人机交互、机器人控制等领域发挥更大的作用。

📄 摘要(原文)

Traditional text-to-motion frameworks often lack precise control, and existing approaches based on joint keyframe locations provide only positional guidance, making it challenging and unintuitive to specify body part orientations and motion timing. To address these limitations, we introduce the Salient Orientation Symbolic (SOS) script, a programmable symbolic framework for specifying body part orientations and motion timing at keyframes. We further propose an automatic SOS extraction pipeline that employs temporally-constrained agglomerative clustering for frame saliency detection and a Saliency-based Masking Scheme (SMS) to generate sparse, interpretable SOS scripts directly from motion data. Moreover, we present the SOSControl framework, which treats the available orientation symbols in the sparse SOS script as salient and prioritizes satisfying these constraints during motion generation. By incorporating SMS-based data augmentation and gradient-based iterative optimization, the framework enhances alignment with user-specified constraints. Additionally, it employs a ControlNet-based ACTOR-PAE Decoder to ensure smooth and natural motion outputs. Extensive experiments demonstrate that the SOS extraction pipeline generates human-interpretable scripts with symbolic annotations at salient keyframes, while the SOSControl framework outperforms existing baselines in motion quality, controllability, and generalizability with respect to motion timing and body part orientation control.