Φeat: Physically-Grounded Feature Representation

作者: Giuseppe Vecchio, Adrien Kaiser, Rouffet Romain, Rosalie Martin, Elena Garces, Tamy Boubekeur

分类: cs.CV

发布日期: 2025-11-14

💡 一句话要点

提出Φeat:一种物理可解释的视觉特征表示方法,提升材质识别能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 物理可解释性 自监督学习 材质识别 特征表示 对比学习

📋 核心要点

- 现有自监督视觉特征将高层语义与几何、光照等底层物理因素纠缠,限制了其在需要显式物理推理任务中的应用。

- Φeat通过对比同一材质在不同形状和光照下的图像块,学习对材质特性(反射率、几何结构)敏感的特征表示。

- 实验表明,Φeat能够捕获超出语义分组的物理可解释结构,为物理感知任务提供更强的先验知识。

📝 摘要(中文)

本文提出了一种名为Φeat的物理可解释视觉骨干网络,旨在鼓励模型学习对材质特性敏感的表示,包括反射率线索和几何细观结构。核心思想是采用一种预训练策略,对比同一材质在不同形状和光照条件下的空间裁剪和物理增强。虽然类似的数据已用于诸如内在分解或材质估计等高端监督任务中,但本文证明,纯粹的自监督训练策略,无需显式标签,已经为需要对外部物理因素具有鲁棒性的任务提供了强大的先验知识。通过特征相似性分析和材质选择评估学习到的表示,表明Φeat捕获了超出语义分组的物理可解释结构。这些发现突出了无监督物理特征学习作为视觉和图形学中物理感知基础的潜力。

🔬 方法详解

问题定义:现有自监督学习方法提取的视觉特征,往往将高层语义信息与底层物理属性(如光照、几何形状)混杂在一起,导致模型难以进行精确的物理推理。例如,在材质识别任务中,模型容易受到光照变化的影响,无法准确判断材质的真实属性。因此,需要一种能够解耦语义信息和物理属性,并对物理属性具有鲁棒性的特征表示方法。

核心思路:Φeat的核心思路是利用自监督学习的方式,让模型学习区分同一材质在不同光照条件和几何形状下的图像块。通过这种方式,模型可以学习到与材质本身相关的、不受外部物理因素干扰的特征表示。这种表示能够更好地反映材质的内在属性,从而提高模型在物理推理任务中的性能。

技术框架:Φeat的整体框架基于标准的自监督学习流程。首先,收集包含各种材质在不同光照和几何形状下的图像数据集。然后,对同一材质的图像进行空间裁剪和物理增强(例如,改变光照强度、旋转角度等)。接着,将这些增强后的图像块输入到神经网络中,通过对比学习的方式,让模型学习区分同一材质的不同图像块,并区分不同材质的图像块。最后,利用学习到的特征表示进行下游任务的评估。

关键创新:Φeat的关键创新在于其预训练策略,即通过对比同一材质在不同物理条件下的图像块,来鼓励模型学习对材质特性敏感的特征表示。与传统的自监督学习方法相比,Φeat更加关注图像的物理属性,而不是仅仅关注图像的语义信息。这种预训练策略能够有效地提高模型在物理推理任务中的性能。

关键设计:Φeat的关键设计包括:1) 使用包含各种材质和物理条件的数据集;2) 采用空间裁剪和物理增强相结合的数据增强方法;3) 使用对比学习损失函数,鼓励模型学习区分同一材质的不同图像块,并区分不同材质的图像块;4) 使用标准的卷积神经网络作为骨干网络。

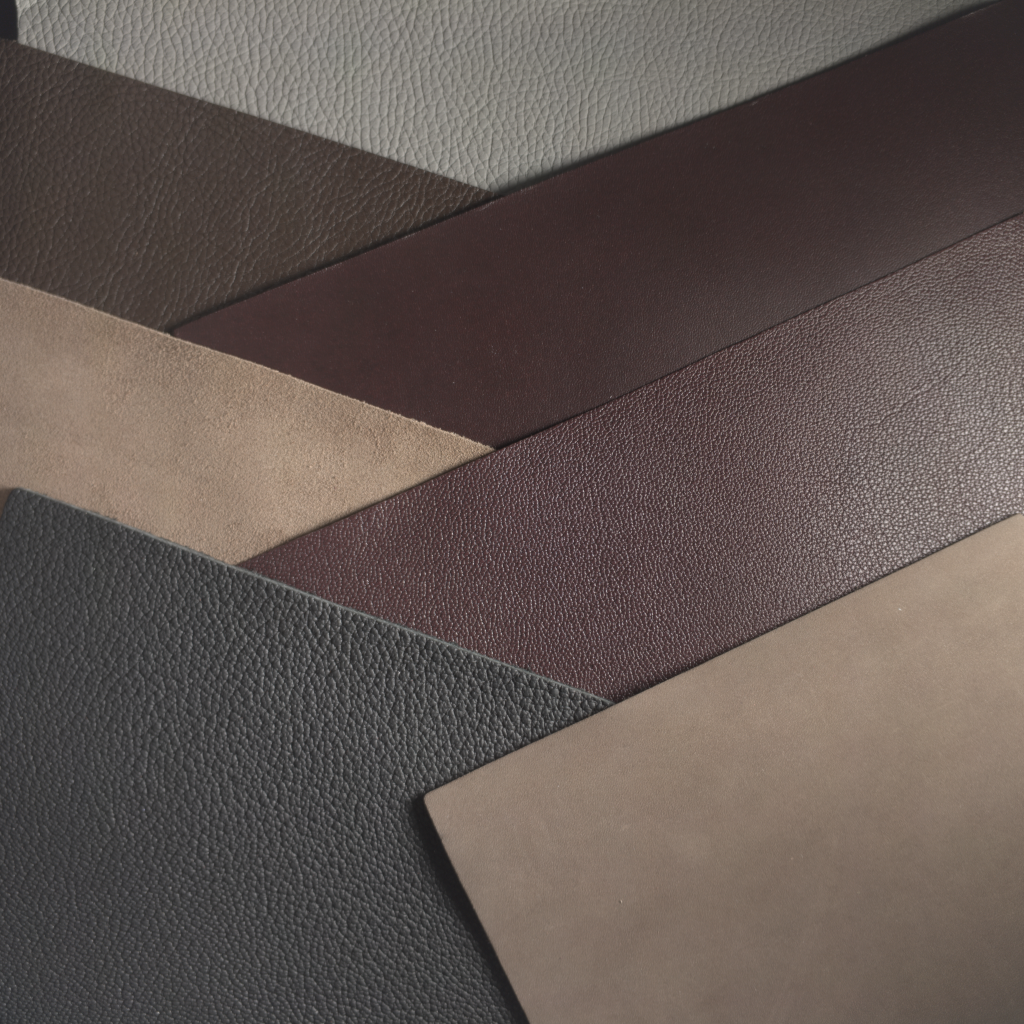

🖼️ 关键图片

📊 实验亮点

实验结果表明,Φeat在材质选择任务中表现出色,能够捕获超出语义分组的物理可解释结构。通过特征相似性分析,验证了Φeat学习到的特征表示对材质特性具有很强的敏感性,并且对光照和几何形状等外部因素具有鲁棒性。与现有的自监督学习方法相比,Φeat在物理推理任务中取得了显著的性能提升。

🎯 应用场景

Φeat具有广泛的应用前景,例如材质识别、三维重建、光照估计、机器人抓取等。在材质识别方面,Φeat可以提高模型对材质属性的识别精度,使其能够更好地理解场景中的物体。在三维重建方面,Φeat可以提供更准确的几何信息,从而提高重建质量。在机器人抓取方面,Φeat可以帮助机器人更好地理解物体的物理属性,从而实现更稳定的抓取。

📄 摘要(原文)

Foundation models have emerged as effective backbones for many vision tasks. However, current self-supervised features entangle high-level semantics with low-level physical factors, such as geometry and illumination, hindering their use in tasks requiring explicit physical reasoning. In this paper, we introduce $Φ$eat, a novel physically-grounded visual backbone that encourages a representation sensitive to material identity, including reflectance cues and geometric mesostructure. Our key idea is to employ a pretraining strategy that contrasts spatial crops and physical augmentations of the same material under varying shapes and lighting conditions. While similar data have been used in high-end supervised tasks such as intrinsic decomposition or material estimation, we demonstrate that a pure self-supervised training strategy, without explicit labels, already provides a strong prior for tasks requiring robust features invariant to external physical factors. We evaluate the learned representations through feature similarity analysis and material selection, showing that $Φ$eat captures physically-grounded structure beyond semantic grouping. These findings highlight the promise of unsupervised physical feature learning as a foundation for physics-aware perception in vision and graphics. These findings highlight the promise of unsupervised physical feature learning as a foundation for physics-aware perception in vision and graphics.