3D Gaussian and Diffusion-Based Gaze Redirection

作者: Abiram Panchalingam, Indu Bodala, Stuart Middleton

分类: cs.CV, cs.AI

发布日期: 2025-11-14

💡 一句话要点

提出DiT-Gaze,结合扩散模型与3D高斯,提升注视方向重定向的真实度和准确性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 注视方向重定向 3D高斯溅射 扩散Transformer 弱监督学习 正交约束 图像合成 人机交互

📋 核心要点

- 现有3D高斯模型在注视方向重定向中难以处理细微且连续的注视变化,限制了合成数据的质量。

- DiT-Gaze结合扩散Transformer、弱监督和正交约束损失,提升图像合成质量,并解耦注视、头部姿势和表情的内部表示。

- 实验表明,DiT-Gaze在感知质量和重定向精度上均超越现有技术,显著降低了注视误差。

📝 摘要(中文)

高保真度的注视方向重定向对于生成增强数据至关重要,这有助于提高注视估计器的泛化能力。3D高斯溅射(3DGS)模型,如GazeGaussian,代表了当前最先进的技术,但难以渲染细微、连续的注视方向变化。本文提出了DiT-Gaze,一个通过结合扩散Transformer (DiT)、跨注视角度的弱监督以及正交约束损失来增强3D注视方向重定向模型的框架。DiT实现了更高保真度的图像合成,而我们使用合成生成的中间注视角度的弱监督策略在训练期间提供了一个平滑的注视方向流形。正交约束损失在数学上强制解耦注视、头部姿势和表情的内部表示。综合实验表明,DiT-Gaze在感知质量和重定向精度方面都达到了新的state-of-the-art,将state-of-the-art的注视误差降低了4.1%,达到6.353度,为创建合成训练数据提供了一种优越的方法。我们的代码和模型将提供给研究社区进行基准测试。

🔬 方法详解

问题定义:论文旨在解决注视方向重定向中,现有3D高斯模型难以生成高质量、连续注视变化图像的问题。现有方法在渲染细微的注视角度变化时表现不佳,导致合成数据质量下降,进而影响注视估计器的泛化能力。

核心思路:论文的核心思路是利用扩散模型强大的图像生成能力,结合3D高斯表示的优势,并通过弱监督和正交约束损失来提升注视方向重定向的真实度和准确性。通过扩散模型生成高保真图像,弱监督保证注视角度的平滑过渡,正交约束解耦不同因素的影响。

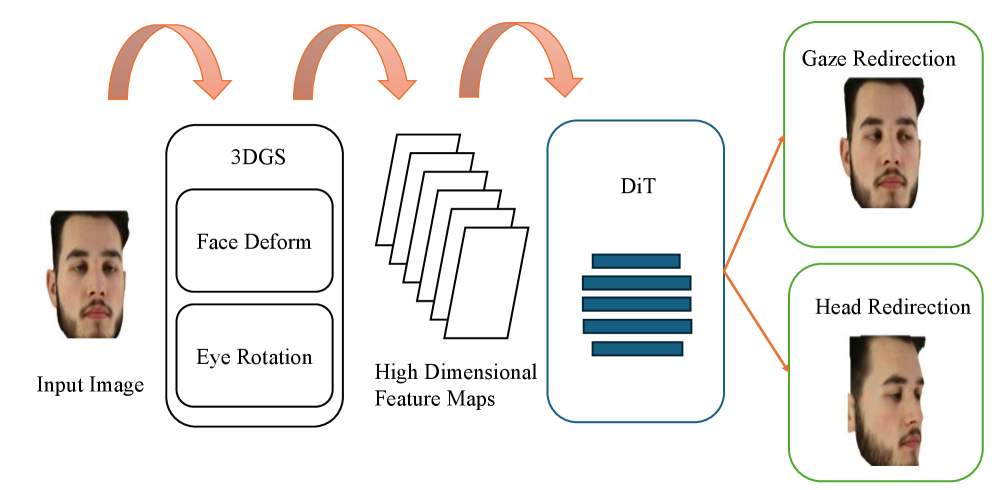

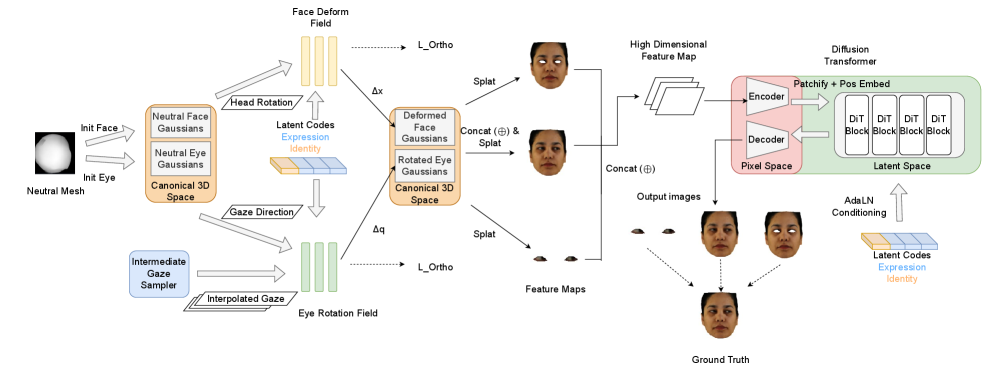

技术框架:DiT-Gaze框架包含以下主要模块:1) 3D高斯表示模块,用于建模头部和面部;2) 扩散Transformer (DiT)模块,用于生成高保真图像;3) 弱监督模块,利用合成的中间注视角度进行训练;4) 正交约束损失模块,用于解耦注视、头部姿势和表情的内部表示。训练流程包括:首先,利用3D高斯模型渲染图像;然后,将渲染结果输入DiT进行图像生成;最后,通过弱监督和正交约束损失进行优化。

关键创新:论文的关键创新在于:1) 将扩散Transformer引入注视方向重定向任务,显著提升了图像生成质量;2) 提出了基于合成中间注视角度的弱监督策略,保证了注视角度的平滑过渡;3) 设计了正交约束损失,有效解耦了注视、头部姿势和表情的内部表示。与现有方法相比,DiT-Gaze能够生成更高质量、更真实的注视方向重定向图像。

关键设计:论文的关键设计包括:1) 扩散Transformer的网络结构和训练策略;2) 弱监督中中间注视角度的生成方法和损失函数设计;3) 正交约束损失的具体形式和权重设置。具体而言,扩散Transformer采用了标准的DiT架构,弱监督通过线性插值生成中间注视角度,正交约束损失通过计算不同表示向量的内积来实现。

🖼️ 关键图片

📊 实验亮点

DiT-Gaze在注视方向重定向任务上取得了显著的性能提升,将state-of-the-art的注视误差降低了4.1%,达到6.353度。实验结果表明,DiT-Gaze在感知质量和重定向精度方面均优于现有方法,为生成高质量的合成训练数据提供了一种有效途径。

🎯 应用场景

该研究成果可广泛应用于注视估计、人机交互、虚拟现实和增强现实等领域。高质量的注视方向重定向技术能够生成大量的合成训练数据,从而提升注视估计器的性能,改善用户体验,并促进相关技术的发展。

📄 摘要(原文)

High-fidelity gaze redirection is critical for generating augmented data to improve the generalization of gaze estimators. 3D Gaussian Splatting (3DGS) models like GazeGaussian represent the state-of-the-art but can struggle with rendering subtle, continuous gaze shifts. In this paper, we propose DiT-Gaze, a framework that enhances 3D gaze redirection models using a novel combination of Diffusion Transformer (DiT), weak supervision across gaze angles, and an orthogonality constraint loss. DiT allows higher-fidelity image synthesis, while our weak supervision strategy using synthetically generated intermediate gaze angles provides a smooth manifold of gaze directions during training. The orthogonality constraint loss mathematically enforces the disentanglement of internal representations for gaze, head pose, and expression. Comprehensive experiments show that DiT-Gaze sets a new state-of-the-art in both perceptual quality and redirection accuracy, reducing the state-of-the-art gaze error by 4.1% to 6.353 degrees, providing a superior method for creating synthetic training data. Our code and models will be made available for the research community to benchmark against.