Hindsight Distillation Reasoning with Knowledge Encouragement Preference for Knowledge-based Visual Question Answering

作者: Yu Zhao, Ying Zhang, Xuhui Sui, Baohang Zhou, Li Shen, Dacheng Tao

分类: cs.CV

发布日期: 2025-11-14

💡 一句话要点

提出HinD框架,通过后见之明蒸馏推理和知识激励偏好优化解决知识型视觉问答问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识型视觉问答 后见之明蒸馏 知识激励偏好优化 多模态大语言模型 思维链推理

📋 核心要点

- 现有KBVQA方法依赖隐式或显式知识,但缺乏明确的多步推理过程,导致推理过程不透明。

- HinD框架通过后见之明蒸馏推理和知识激励偏好优化,激发MLLM的内部知识推理能力。

- 实验表明,HinD在OK-VQA和A-OKVQA上表现出色,无需外部知识或商业API即可实现优越性能。

📝 摘要(中文)

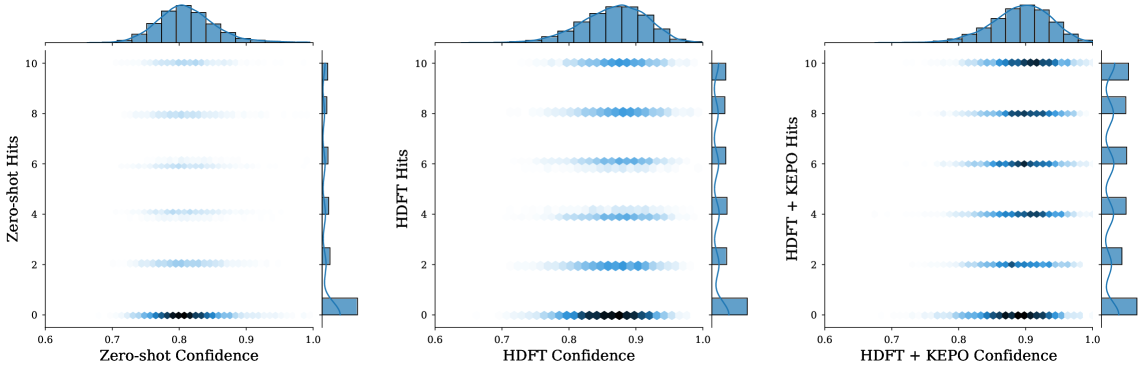

本文提出了一种后见之明蒸馏推理(HinD)框架,并结合知识激励偏好优化(KEPO),旨在激发和利用多模态大型语言模型(MLLM)的内部知识推理能力,解决知识型视觉问答(KBVQA)问题。现有方法或通过上下文学习利用MLLM中的隐式知识,或通过检索增强生成利用显式知识,但缺乏明确的多步推理轨迹。HinD框架首先通过提示一个冻结的7B规模MLLM完成问题和答案之间的推理过程,构建后见之明-零训练数据,解决推理监督问题。然后,将后见之明-零数据自蒸馏到思维链(CoT)生成器和知识生成器中,从而生成顺序步骤和离散事实。其次,为了解决知识正确性和置信度之间的不一致问题,使用KEPO优化知识生成器,优先选择欠置信但有用的知识,而不是过度自信但无用的知识。生成的CoT和采样的知识随后被用于答案预测。在OK-VQA和A-OKVQA上的实验验证了HinD的有效性,表明HinD通过7B规模MLLM的推理,在没有商业模型API或外部知识的情况下实现了卓越的性能。

🔬 方法详解

问题定义:知识型视觉问答(KBVQA)需要结合外部知识,现有方法要么依赖MLLM中的隐式知识,要么通过检索增强生成利用显式知识。然而,这些方法缺乏明确的多步推理轨迹,推理过程不透明,难以解释和优化。此外,知识的正确性和模型置信度之间存在错位,高置信度的知识可能无用,而低置信度的知识可能很有帮助。

核心思路:本文的核心思路是通过后见之明蒸馏,让MLLM学习从问题到答案的推理过程,并显式地生成推理步骤和知识。通过知识激励偏好优化,纠正知识正确性和置信度之间的错位,鼓励模型选择有用的知识。这样可以提高模型的推理能力和答案预测的准确性。

技术框架:HinD框架包含以下主要模块:1) 后见之明-零数据生成:使用冻结的7B规模MLLM,以问题和答案为输入,生成推理过程,构建训练数据。2) 自蒸馏:将后见之明-零数据自蒸馏到思维链(CoT)生成器和知识生成器中。CoT生成器负责生成推理步骤,知识生成器负责生成离散事实。3) 知识激励偏好优化(KEPO):使用KEPO优化知识生成器,使其偏好欠置信但有用的知识。4) 答案预测:利用生成的CoT和采样的知识进行答案预测。

关键创新:1) 后见之明蒸馏:通过让MLLM回顾问题和答案之间的推理过程,显式地学习推理步骤。2) 知识激励偏好优化:纠正知识正确性和置信度之间的错位,鼓励模型选择有用的知识。3) 无需外部知识或商业API:仅使用7B规模MLLM即可实现优越性能。

关键设计:1) 后见之明-零数据生成:使用特定的prompt引导MLLM生成推理过程。2) 自蒸馏:使用标准的蒸馏损失函数训练CoT生成器和知识生成器。3) 知识激励偏好优化:使用偏好学习方法,根据知识的有用性调整知识生成器的输出概率。4) 答案预测:使用生成的CoT和知识,通过注意力机制或类似方法进行答案预测。

🖼️ 关键图片

📊 实验亮点

HinD在OK-VQA和A-OKVQA数据集上取得了显著的性能提升,证明了其有效性。值得注意的是,HinD仅使用7B规模的MLLM,无需外部知识或商业API,即可达到甚至超过现有方法的性能。这表明HinD能够有效地激发和利用MLLM的内部知识推理能力。

🎯 应用场景

该研究成果可应用于各种需要知识推理的视觉问答场景,例如智能客服、教育辅助、医疗诊断等。通过提高模型的推理能力和知识利用效率,可以提升用户体验和问题解决的准确性。未来,该方法可以扩展到其他多模态任务,例如图像描述、视频理解等。

📄 摘要(原文)

Knowledge-based Visual Question Answering (KBVQA) necessitates external knowledge incorporation beyond cross-modal understanding. Existing KBVQA methods either utilize implicit knowledge in multimodal large language models (MLLMs) via in-context learning or explicit knowledge via retrieval augmented generation. However, their reasoning processes remain implicit, without explicit multi-step trajectories from MLLMs. To address this gap, we provide a Hindsight Distilled Reasoning (HinD) framework with Knowledge Encouragement Preference Optimization (KEPO), designed to elicit and harness internal knowledge reasoning ability in MLLMs. First, to tackle the reasoning supervision problem, we propose to emphasize the hindsight wisdom of MLLM by prompting a frozen 7B-size MLLM to complete the reasoning process between the question and its ground truth answer, constructing Hindsight-Zero training data. Then we self-distill Hindsight-Zero into Chain-of-Thought (CoT) Generator and Knowledge Generator, enabling the generation of sequential steps and discrete facts. Secondly, to tackle the misalignment between knowledge correctness and confidence, we optimize the Knowledge Generator with KEPO, preferring under-confident but helpful knowledge over the over-confident but unhelpful one. The generated CoT and sampled knowledge are then exploited for answer prediction. Experiments on OK-VQA and A-OKVQA validate the effectiveness of HinD, showing that HinD with elicited reasoning from 7B-size MLLM achieves superior performance without commercial model APIs or outside knowledge.