Stroke Modeling Enables Vectorized Character Generation with Large Vectorized Glyph Model

作者: Xinyue Zhang, Haolong Li, Jiawei Ma, Chen Ye

分类: cs.CV

发布日期: 2025-11-14

💡 一句话要点

提出基于笔画建模的大型矢量字形模型LVGM,实现矢量化字符生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 矢量字形生成 笔画建模 大型语言模型 序列预测 中文SVG数据集

📋 核心要点

- 现有矢量字形生成方法缺乏对笔画顺序的有效建模,难以生成复杂和风格化的字形。

- LVGM通过将笔画编码为离散嵌入,并利用大型语言模型预测笔画序列,实现矢量字形的生成。

- 实验表明,LVGM在生成质量和数据扩展性方面表现良好,并通过专家验证了生成字形的质量。

📝 摘要(中文)

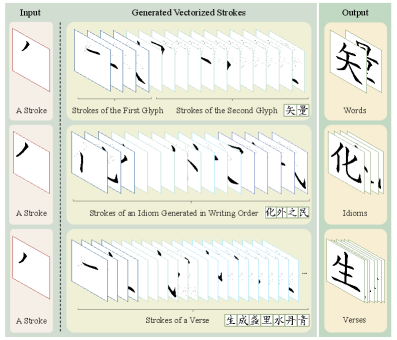

本文提出了一种新型的大型矢量字形模型(LVGM),旨在通过预测下一个笔画来生成矢量化中文字形。该方法首先将笔画编码为离散的潜在变量,称为笔画嵌入。然后,通过微调DeepSeek LLM,训练LVGM来预测下一个笔画嵌入。在给定有限笔画的情况下,该模型能够生成完整的字符、语义优雅的词语,甚至是以矢量形式呈现的未见过的诗句。此外,我们还发布了一个新的大规模中文SVG数据集,其中包含基于笔画的907,267个样本,用于动态矢量化字形生成。实验结果表明,我们的模型在数据规模上具有良好的扩展性。生成的矢量化字形已通过专家和相关人士的验证。

🔬 方法详解

问题定义:论文旨在解决矢量化中文字形生成的问题。现有方法在生成复杂字形和保持风格一致性方面存在挑战,尤其是在处理大规模字形数据时,效率和质量难以兼顾。此外,缺乏大规模的、基于笔画的矢量字形数据集也限制了相关研究的进展。

核心思路:论文的核心思路是利用大型语言模型(LLM)的序列预测能力,将矢量字形生成问题转化为笔画序列预测问题。通过将每个笔画编码为离散的嵌入向量,并训练LLM预测下一个笔画的嵌入向量,从而实现矢量字形的自动生成。这种方法能够有效地捕捉笔画之间的依赖关系,生成更自然、流畅的字形。

技术框架:LVGM的整体框架包括以下几个主要阶段:1) 笔画编码:将矢量字形的笔画数据编码为离散的笔画嵌入向量。2) 模型训练:使用大规模的矢量字形数据集,通过微调DeepSeek LLM,训练LVGM来预测下一个笔画嵌入。3) 字形生成:给定初始笔画序列,LVGM迭代地预测下一个笔画,直到生成完整的字形。4) 数据集构建:构建大规模中文SVG数据集,包含基于笔画的矢量字形数据。

关键创新:该论文的关键创新在于:1) 提出了基于笔画建模的矢量字形生成方法,将矢量字形生成问题转化为序列预测问题。2) 利用大型语言模型(LLM)的强大序列建模能力,提高了矢量字形生成的质量和效率。3) 构建了大规模的中文SVG数据集,为相关研究提供了数据基础。

关键设计:在笔画编码方面,论文可能采用了某种矢量量化方法将连续的笔画参数映射到离散的嵌入向量。在模型训练方面,使用了交叉熵损失函数来优化LLM的参数,使其能够准确地预测下一个笔画的嵌入向量。具体网络结构细节未知,但推测使用了Transformer架构。数据集的构建可能涉及自动化的笔画分割和标注算法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LVGM在生成矢量字形方面表现出色,能够生成语义优雅的词语和未见过的诗句。模型在数据规模上表现出良好的扩展性,表明其具有处理大规模数据的潜力。专家验证表明,LVGM生成的矢量字形质量较高,具有实际应用价值。具体性能数据未知。

🎯 应用场景

该研究成果可应用于字体设计、艺术创作、网络动画、海报设计等领域。通过LVGM,设计师可以快速生成各种风格的矢量字形,提高设计效率。此外,该技术还可以用于生成个性化的字体,满足不同用户的需求。未来,该技术有望应用于虚拟现实、增强现实等新兴领域,为用户提供更加丰富的视觉体验。

📄 摘要(原文)

Vectorized glyphs are widely used in poster design, network animation, art display, and various other fields due to their scalability and flexibility. In typography, they are often seen as special sequences composed of ordered strokes. This concept extends to the token sequence prediction abilities of large language models (LLMs), enabling vectorized character generation through stroke modeling. In this paper, we propose a novel Large Vectorized Glyph Model (LVGM) designed to generate vectorized Chinese glyphs by predicting the next stroke. Initially, we encode strokes into discrete latent variables called stroke embeddings. Subsequently, we train our LVGM via fine-tuning DeepSeek LLM by predicting the next stroke embedding. With limited strokes given, it can generate complete characters, semantically elegant words, and even unseen verses in vectorized form. Moreover, we release a new large-scale Chinese SVG dataset containing 907,267 samples based on strokes for dynamically vectorized glyph generation. Experimental results show that our model has scaling behaviors on data scales. Our generated vectorized glyphs have been validated by experts and relevant individuals.