Phys-Liquid: A Physics-Informed Dataset for Estimating 3D Geometry and Volume of Transparent Deformable Liquids

作者: Ke Ma, Yizhou Fang, Jean-Baptiste Weibel, Shuai Tan, Xinggang Wang, Yang Xiao, Yi Fang, Tian Xia

分类: cs.CV, cs.RO

发布日期: 2025-11-14

备注: 14 pages, 19 figures. Accepted as an oral paper at AAAI-26 (Main Technical Track). Code and dataset: https://github.com/dualtransparency/Phys-Liquid-AAAI Project page: https://dualtransparency.github.io/Phys-Liquid/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Phys-Liquid:用于透明可变形液体三维几何与体积估计的物理信息数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 透明液体 三维重建 体积估计 物理信息数据集 深度学习

📋 核心要点

- 透明液体几何和体积估计受光学复杂性和动态变形影响,现有数据集缺乏真实动态场景下的物理信息模拟数据。

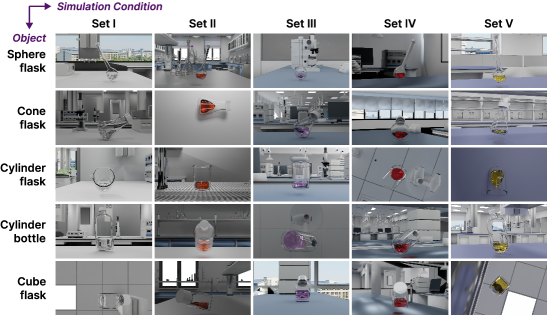

- Phys-Liquid数据集包含97,200张模拟图像和3D网格,涵盖多种场景、光照、颜色和容器旋转,捕捉液体动力学。

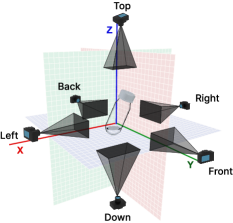

- 提出的四阶段重建和估计流程,通过液体分割、多视图掩码生成、3D网格重建和真实世界缩放,提升了重建精度和一致性。

📝 摘要(中文)

由于光学复杂性和容器运动引起的动态表面变形,估计透明可变形液体的几何和体积属性极具挑战性。执行精确液体操作任务(如分配、抽吸和混合)的自主机器人必须以不可避免地引起这些变形的方式处理容器,从而使准确的液体状态评估变得复杂。目前的数据集缺乏全面的物理信息模拟数据,无法代表各种动态场景下真实的液体行为。为了弥合这一差距,我们推出了 Phys-Liquid,这是一个包含 97,200 张模拟图像和相应 3D 网格的物理信息数据集,捕捉了多个实验室场景、光照条件、液体颜色和容器旋转下的液体动力学。为了验证 Phys-Liquid 的真实性和有效性,我们提出了一个四阶段的重建和估计流程,包括液体分割、多视图掩码生成、3D 网格重建和真实世界缩放。实验结果表明,在重建液体几何形状和体积方面,准确性和一致性得到了提高,优于现有的基准。该数据集和相关的验证方法有助于未来在透明液体感知任务方面的进步。数据集和代码可在 https://dualtransparency.github.io/Phys-Liquid/ 获取。

🔬 方法详解

问题定义:论文旨在解决透明可变形液体在动态场景下的三维几何和体积精确估计问题。现有方法难以应对光学复杂性、动态表面变形以及缺乏足够真实训练数据等挑战,导致在实际应用中性能受限。

核心思路:论文的核心思路是构建一个大规模、物理信息丰富的合成数据集Phys-Liquid,该数据集涵盖了各种动态场景、光照条件和液体属性,从而为训练深度学习模型提供充足且高质量的数据。同时,论文提出了一个四阶段的重建和估计流程,利用多视图信息来提高重建的准确性和鲁棒性。

技术框架:整体框架包含以下四个阶段:1) 液体分割:使用深度学习模型从图像中分割出液体区域。2) 多视图掩码生成:利用不同视角的图像生成液体的多视图掩码。3) 3D网格重建:基于多视图掩码重建液体的三维网格模型。4) 真实世界缩放:将重建的3D模型缩放到真实世界尺度。

关键创新:论文的关键创新在于构建了Phys-Liquid数据集,该数据集不仅规模庞大,而且包含了丰富的物理信息,能够更好地模拟真实世界中液体的行为。此外,论文提出的四阶段重建流程也充分利用了多视图信息,提高了重建的准确性和鲁棒性。

关键设计:数据集的生成使用了物理引擎来模拟液体的动态行为,并考虑了多种光照条件和液体属性。重建流程中,使用了基于深度学习的分割模型和基于多视图几何的重建算法。损失函数的设计也考虑了重建的几何精度和体积一致性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用Phys-Liquid数据集训练的模型在液体几何和体积重建方面取得了显著的性能提升,优于现有基准。具体而言,该方法在重建精度和一致性方面均有提高,为透明液体感知任务提供了新的解决方案。

🎯 应用场景

该研究成果可应用于需要精确液体操作的机器人领域,例如在医疗、制药和化学工业中,机器人可以利用该技术进行精确的液体分配、抽吸和混合。此外,该数据集和方法还可以促进虚拟现实和增强现实应用中更逼真的液体模拟和交互。

📄 摘要(原文)

Estimating the geometric and volumetric properties of transparent deformable liquids is challenging due to optical complexities and dynamic surface deformations induced by container movements. Autonomous robots performing precise liquid manipulation tasks, such as dispensing, aspiration, and mixing, must handle containers in ways that inevitably induce these deformations, complicating accurate liquid state assessment. Current datasets lack comprehensive physics-informed simulation data representing realistic liquid behaviors under diverse dynamic scenarios. To bridge this gap, we introduce Phys-Liquid, a physics-informed dataset comprising 97,200 simulation images and corresponding 3D meshes, capturing liquid dynamics across multiple laboratory scenes, lighting conditions, liquid colors, and container rotations. To validate the realism and effectiveness of Phys-Liquid, we propose a four-stage reconstruction and estimation pipeline involving liquid segmentation, multi-view mask generation, 3D mesh reconstruction, and real-world scaling. Experimental results demonstrate improved accuracy and consistency in reconstructing liquid geometry and volume, outperforming existing benchmarks. The dataset and associated validation methods facilitate future advancements in transparent liquid perception tasks. The dataset and code are available at https://dualtransparency.github.io/Phys-Liquid/.