GSE: Evaluating Sticker Visual Semantic Similarity via a General Sticker Encoder

作者: Heng Er Metilda Chee, Jiayin Wang, Zhiqiang Guo, Weizhi Ma, Min Zhang

分类: cs.CV, cs.MM

发布日期: 2025-11-07

💡 一句话要点

提出通用贴纸编码器GSE,用于评估贴纸视觉语义相似度,并构建Triple-S基准数据集。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 贴纸语义相似度 通用贴纸编码器 对比学习 Triple-S数据集 视觉语义理解

📋 核心要点

- 现有视觉和多模态模型难以捕捉贴纸细微的语义信息,限制了贴纸语义理解。

- 提出通用贴纸编码器GSE,利用Triple-S数据集和其他数据学习鲁棒的贴纸嵌入。

- GSE在未见过的贴纸和下游任务上表现优异,为贴纸理解研究提供标准化工具。

📝 摘要(中文)

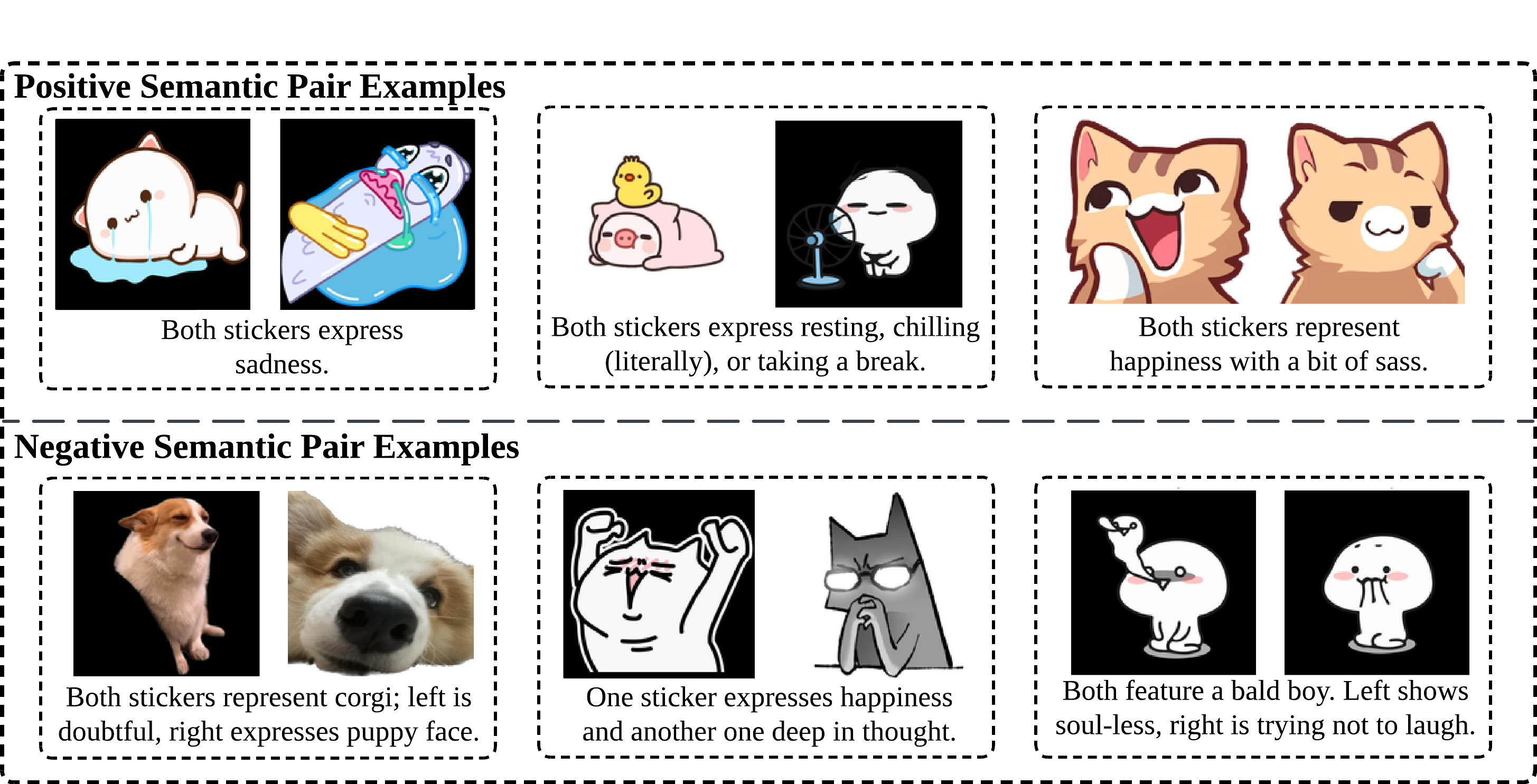

贴纸已成为一种流行的视觉交流形式,但由于其高度多样化和符号化的内容,理解它们的语义关系仍然具有挑战性。本文正式定义了贴纸语义相似度任务,并引入了Triple-S,这是第一个用于此任务的基准,包含905个人工标注的正负贴纸对。通过广泛的评估,我们表明现有的预训练视觉和多模态模型难以捕捉细微的贴纸语义。为了解决这个问题,我们提出了通用贴纸编码器(GSE),这是一个轻量级且通用的模型,它使用Triple-S和其他数据集学习鲁棒的贴纸嵌入。GSE在未见过的贴纸上取得了优异的性能,并在情感分类和贴纸检索等下游任务上表现出强大的结果。通过发布Triple-S和GSE,我们提供了标准化的评估工具和鲁棒的嵌入,从而促进未来在贴纸理解、检索和多模态内容生成方面的研究。Triple-S基准和GSE已公开发布。

🔬 方法详解

问题定义:论文旨在解决贴纸视觉语义相似度评估问题。现有方法,如预训练的视觉和多模态模型,在理解贴纸这种高度抽象和符号化的视觉元素时表现不佳,无法准确捕捉贴纸之间的细微语义差异。这阻碍了贴纸相关的下游任务,如贴纸检索和情感分类。

核心思路:论文的核心思路是设计一个专门针对贴纸的通用编码器(GSE),通过在专门构建的贴纸语义相似度数据集(Triple-S)以及其他相关数据集上进行训练,使GSE能够学习到更鲁棒和具有区分性的贴纸嵌入表示。这种方法避免了直接使用通用视觉模型,而是针对贴纸的特性进行优化。

技术框架:GSE的整体框架包括一个轻量级的神经网络结构,用于提取贴纸的视觉特征。该网络以贴纸图像作为输入,输出贴纸的嵌入向量。训练过程中,GSE使用Triple-S数据集中的正负贴纸对进行对比学习,目标是拉近语义相似的贴纸嵌入,推远语义不相似的贴纸嵌入。此外,GSE还可以利用其他数据集进行预训练或微调,以进一步提升其泛化能力。

关键创新:该论文的关键创新在于:1)正式定义了贴纸语义相似度任务,并构建了首个基准数据集Triple-S;2)提出了通用贴纸编码器GSE,该编码器专门针对贴纸的特性进行设计和训练,能够有效捕捉贴纸的语义信息。与直接使用通用视觉模型相比,GSE能够更好地处理贴纸的抽象性和符号化特点。

关键设计:GSE的具体网络结构未知,但可以推测其可能采用卷积神经网络(CNN)或Transformer等结构来提取视觉特征。损失函数方面,论文可能使用了对比损失(Contrastive Loss)或三元组损失(Triplet Loss)等,以实现对正负贴纸对的区分。此外,论文可能还探索了不同的数据增强方法,以提高GSE的鲁棒性。具体的参数设置和网络结构细节需要在论文原文中查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GSE在Triple-S数据集上取得了显著优于现有预训练视觉和多模态模型的效果,证明了其在贴纸语义理解方面的优势。此外,GSE在情感分类和贴纸检索等下游任务上也表现出强大的性能,验证了其泛化能力和实用价值。具体的性能数据和提升幅度需要在论文原文中查找。

🎯 应用场景

该研究成果可广泛应用于社交媒体、即时通讯、内容创作等领域。通过GSE提取的贴纸嵌入,可以实现更精准的贴纸检索、更智能的情感分类、以及更具创意的多模态内容生成。例如,用户可以通过输入一段文字或一张图片,快速找到与之语义相关的贴纸,从而丰富表达方式和沟通体验。此外,GSE还可以用于分析用户对不同贴纸的偏好,为个性化推荐提供支持。

📄 摘要(原文)

Stickers have become a popular form of visual communication, yet understanding their semantic relationships remains challenging due to their highly diverse and symbolic content. In this work, we formally {define the Sticker Semantic Similarity task} and introduce {Triple-S}, the first benchmark for this task, consisting of 905 human-annotated positive and negative sticker pairs. Through extensive evaluation, we show that existing pretrained vision and multimodal models struggle to capture nuanced sticker semantics. To address this, we propose the {General Sticker Encoder (GSE)}, a lightweight and versatile model that learns robust sticker embeddings using both Triple-S and additional datasets. GSE achieves superior performance on unseen stickers, and demonstrates strong results on downstream tasks such as emotion classification and sticker-to-sticker retrieval. By releasing both Triple-S and GSE, we provide standardized evaluation tools and robust embeddings, enabling future research in sticker understanding, retrieval, and multimodal content generation. The Triple-S benchmark and GSE have been publicly released and are available here.