Sketch-to-Layout: Sketch-Guided Multimodal Layout Generation

作者: Riccardo Brioschi, Aleksandr Alekseev, Emanuele Nevali, Berkay Döner, Omar El Malki, Blagoj Mitrevski, Leandro Kieliger, Mark Collier, Andrii Maksai, Jesse Berent, Claudiu Musat, Efi Kokiopoulou

分类: cs.CV, cs.AI

发布日期: 2025-10-31

备注: 15 pages, 18 figures, GitHub link: https://github.com/google-deepmind/sketch_to_layout, accept at ICCV 2025 Workshop (HiGen)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Sketch-to-Layout框架,利用草图引导多模态布局生成,提升设计直观性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 草图引导 布局生成 多模态学习 Transformer 合成数据

📋 核心要点

- 现有布局生成方法依赖复杂的用户约束,降低了易用性,限制了用户交互的直观性。

- 提出Sketch-to-Layout框架,利用用户草图作为直观约束,指导多模态Transformer生成高质量布局。

- 通过合成草图数据进行训练,并在PubLayNet等数据集上验证,超越现有约束方法,提升设计体验。

📝 摘要(中文)

图形布局生成是一个新兴的研究领域,专注于生成美观的布局,范围从海报设计到文档。虽然最近的研究探索了结合用户约束来指导布局生成的方法,但这些约束通常需要复杂的规范,从而降低了可用性。我们引入了一种创新方法,利用用户提供的草图作为直观的约束,并从经验上证明了这种新的指导方法的有效性,从而将草图到布局问题确立为一个有希望但目前尚未充分探索的研究方向。为了解决草图到布局问题,我们提出了一种基于Transformer的多模态解决方案,使用草图和内容资产作为输入来生成高质量的布局。由于从人工标注者那里收集草图训练数据来训练我们的模型成本很高,因此我们引入了一种新颖而有效的方法来大规模地合成生成训练草图。我们在三个公开可用的数据集上训练和评估我们的模型:PubLayNet、DocLayNet 和 SlidesVQA,结果表明它优于最先进的基于约束的方法,同时提供了更直观的设计体验。为了促进未来的草图到布局研究,我们发布了上述公共数据集的 O(200k) 个合成生成的草图。

🔬 方法详解

问题定义:论文旨在解决图形布局生成中用户约束复杂、不易用的问题。现有方法通常需要用户进行复杂的参数设置或规则定义,缺乏直观性,限制了用户在设计过程中的创造性和灵活性。因此,如何利用更自然、更直观的用户输入来指导布局生成是一个关键挑战。

核心思路:论文的核心思路是利用用户提供的草图作为布局生成的指导信息。草图能够简洁地表达用户的设计意图,提供布局元素的位置、大小和关系等信息。通过将草图与内容资产相结合,模型可以生成符合用户意图的高质量布局。这种方法降低了用户指定约束的复杂性,提高了设计的直观性和易用性。

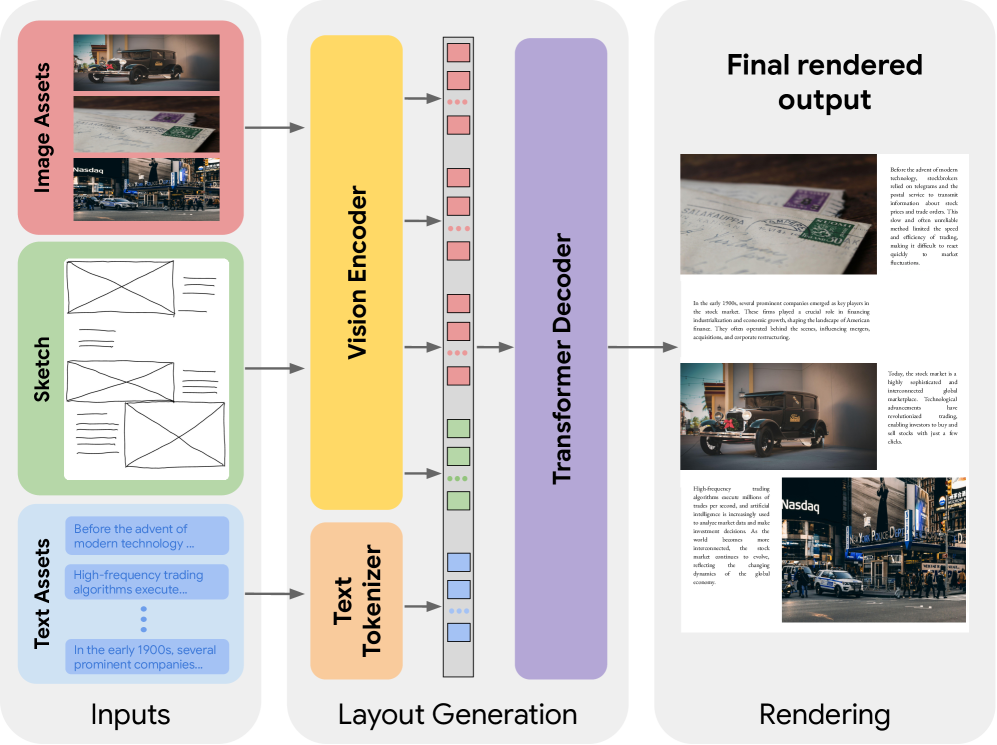

技术框架:Sketch-to-Layout框架采用基于Transformer的多模态架构。该框架包含以下主要模块:1) 草图编码器:将用户提供的草图转换为特征向量表示。2) 内容编码器:将内容资产(如文本、图像)转换为特征向量表示。3) 多模态融合模块:将草图特征和内容特征进行融合,得到融合后的特征表示。4) 布局生成器:基于融合后的特征表示,生成布局元素的坐标、大小等信息。整个流程是端到端可训练的。

关键创新:论文的关键创新在于:1) 提出了一种新的布局生成范式,即Sketch-to-Layout,利用草图作为直观的用户约束。2) 提出了一种高效的合成草图数据生成方法,解决了训练数据不足的问题。3) 采用多模态Transformer架构,有效地融合了草图和内容信息,生成高质量的布局。与现有方法的本质区别在于,它将用户交互方式从复杂的参数设置转变为直观的草图绘制。

关键设计:论文的关键设计包括:1) 合成草图数据生成方法:通过随机扰动现有布局,生成具有不同风格和复杂度的草图。2) 多模态Transformer架构:采用自注意力机制,有效地捕捉草图和内容之间的关系。3) 损失函数:采用回归损失函数,优化布局元素的坐标和大小。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Sketch-to-Layout框架在PubLayNet、DocLayNet和SlidesVQA三个数据集上均优于现有的基于约束的方法。通过用户研究,证明了该方法能够提供更直观的设计体验。此外,论文还发布了O(200k)个合成生成的草图数据集,为未来的研究提供了宝贵资源。

🎯 应用场景

该研究成果可广泛应用于海报设计、文档排版、幻灯片制作等领域。通过草图引导布局生成,可以显著降低设计门槛,提高设计效率,并为用户提供更直观、更灵活的设计体验。未来,该技术有望应用于更复杂的图形设计任务,例如UI设计、游戏场景设计等。

📄 摘要(原文)

Graphic layout generation is a growing research area focusing on generating aesthetically pleasing layouts ranging from poster designs to documents. While recent research has explored ways to incorporate user constraints to guide the layout generation, these constraints often require complex specifications which reduce usability. We introduce an innovative approach exploiting user-provided sketches as intuitive constraints and we demonstrate empirically the effectiveness of this new guidance method, establishing the sketch-to-layout problem as a promising research direction, which is currently under-explored. To tackle the sketch-to-layout problem, we propose a multimodal transformer-based solution using the sketch and the content assets as inputs to produce high quality layouts. Since collecting sketch training data from human annotators to train our model is very costly, we introduce a novel and efficient method to synthetically generate training sketches at scale. We train and evaluate our model on three publicly available datasets: PubLayNet, DocLayNet and SlidesVQA, demonstrating that it outperforms state-of-the-art constraint-based methods, while offering a more intuitive design experience. In order to facilitate future sketch-to-layout research, we release O(200k) synthetically-generated sketches for the public datasets above. The datasets are available at https://github.com/google-deepmind/sketch_to_layout.