Image Hashing via Cross-View Code Alignment in the Age of Foundation Models

作者: Ilyass Moummad, Kawtar Zaher, Hervé Goëau, Alexis Joly

分类: cs.CV, cs.IR, cs.LG

发布日期: 2025-10-31 (更新: 2025-11-03)

💡 一句话要点

提出CroVCA,通过跨视图编码对齐实现高效图像哈希

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像哈希 跨视图学习 二值编码 深度学习 大规模检索

📋 核心要点

- 现有哈希方法流程复杂、目标多项、训练时间长,难以适应大规模检索的需求。

- CroVCA通过跨视图编码对齐,利用二元交叉熵损失和编码率最大化正则化器,学习一致且平衡的二值码。

- 实验表明,CroVCA在多个基准测试中仅需少量训练周期即可达到SOTA,展现了其效率和适应性。

📝 摘要(中文)

高效的大规模检索需要紧凑且具有区分性的表示。基础模型提供了强大的视觉和多模态嵌入,但这些高维空间中的最近邻搜索计算成本很高。哈希提供了一种有效的替代方案,它可以通过二值码实现快速的汉明距离搜索。然而,现有的方法通常依赖于复杂的流程、多项式目标、专为单一学习范式设计的结构以及较长的训练时间。我们引入了CroVCA(跨视图编码对齐),这是一个简单而统一的原则,用于学习在语义对齐的视图中保持一致的二值码。单个二元交叉熵损失强制对齐,而编码率最大化则作为一种反崩塌正则化器,以促进平衡和多样化的编码。为此,我们设计了HashCoder,这是一个轻量级的MLP哈希网络,带有一个最终的批归一化层,以强制平衡编码。HashCoder可以用作冻结嵌入上的探测头,也可以通过LoRA微调有效地调整编码器。在多个基准测试中,CroVCA仅需5个训练周期即可达到最先进的结果。在16位时,它的表现尤其出色——例如,在单个GPU上,COCO上的无监督哈希在2分钟内完成,ImageNet100上的监督哈希在3分钟内完成。这些结果突出了CroVCA的效率、适应性和广泛的适用性。

🔬 方法详解

问题定义:论文旨在解决大规模图像检索中,如何利用预训练模型高效生成高质量二值哈希码的问题。现有方法通常依赖于复杂的多阶段训练流程,需要针对特定数据集或任务进行调整,且训练时间较长,难以充分利用预训练模型的强大表示能力。

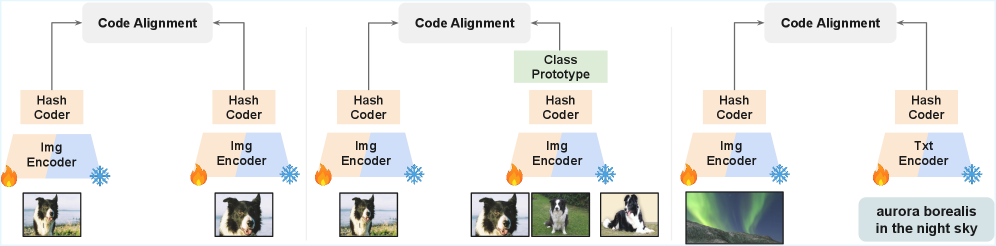

核心思路:论文的核心思路是利用跨视图编码对齐,确保不同视图(例如原始图像和其增强版本)生成的哈希码尽可能一致。通过这种方式,可以学习到对图像语义信息具有鲁棒性的二值码,从而提高检索的准确性。同时,通过编码率最大化,避免哈希码坍塌,保证编码的多样性。

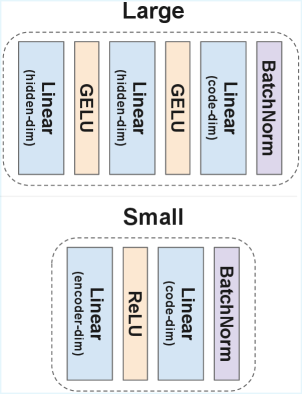

技术框架:整体框架包含两个主要部分:首先,利用预训练的视觉或多模态模型提取图像的特征嵌入;然后,将这些嵌入输入到HashCoder网络中,生成二值哈希码。HashCoder是一个轻量级的多层感知机(MLP),其最后一层使用批归一化(Batch Normalization)来保证编码的平衡性。整个训练过程通过最小化跨视图的二元交叉熵损失和最大化编码率来进行优化。

关键创新:论文的关键创新在于提出了CroVCA(Cross-View Code Alignment)这一简单而有效的哈希学习原则。与现有方法相比,CroVCA无需复杂的多阶段训练,只需一个简单的二元交叉熵损失即可实现跨视图的编码对齐。此外,HashCoder的设计简洁高效,可以作为预训练模型的探测头或通过LoRA进行微调,具有很强的适应性。

关键设计:关键设计包括:1) 使用二元交叉熵损失来衡量不同视图哈希码之间的差异,促使它们对齐;2) 引入编码率最大化作为正则化项,防止哈希码坍塌到单一状态,保证编码的多样性;3) HashCoder网络最后一层使用批归一化,强制编码的平衡性,即每个bit为0和1的概率接近0.5;4) 利用LoRA(Low-Rank Adaptation)技术对预训练模型进行高效微调,降低计算成本。

🖼️ 关键图片

📊 实验亮点

CroVCA在多个图像哈希基准测试中取得了state-of-the-art的结果。例如,在16位哈希码的设置下,COCO数据集上的无监督哈希训练在单个GPU上仅需不到2分钟,ImageNet100数据集上的监督哈希训练仅需约3分钟。这些结果表明,CroVCA在效率和性能上都优于现有方法,尤其是在短码长的情况下表现出色。

🎯 应用场景

该研究成果可广泛应用于大规模图像检索、相似图像搜索、图像聚类等领域。例如,在电商平台中,可以利用该方法快速检索与用户上传图片相似的商品;在图像搜索引擎中,可以提高检索效率和准确性;在内容审核系统中,可以快速识别违规图片。该方法的高效性和适应性使其具有很高的实际应用价值。

📄 摘要(原文)

Efficient large-scale retrieval requires representations that are both compact and discriminative. Foundation models provide powerful visual and multimodal embeddings, but nearest neighbor search in these high-dimensional spaces is computationally expensive. Hashing offers an efficient alternative by enabling fast Hamming distance search with binary codes, yet existing approaches often rely on complex pipelines, multi-term objectives, designs specialized for a single learning paradigm, and long training times. We introduce CroVCA (Cross-View Code Alignment), a simple and unified principle for learning binary codes that remain consistent across semantically aligned views. A single binary cross-entropy loss enforces alignment, while coding-rate maximization serves as an anti-collapse regularizer to promote balanced and diverse codes. To implement this, we design HashCoder, a lightweight MLP hashing network with a final batch normalization layer to enforce balanced codes. HashCoder can be used as a probing head on frozen embeddings or to adapt encoders efficiently via LoRA fine-tuning. Across benchmarks, CroVCA achieves state-of-the-art results in just 5 training epochs. At 16 bits, it particularly well-for instance, unsupervised hashing on COCO completes in under 2 minutes and supervised hashing on ImageNet100 in about 3 minutes on a single GPU. These results highlight CroVCA's efficiency, adaptability, and broad applicability.